Towards Generalizable Implicit In-Context Learning with Attention Routing

作者: Jiaqian Li, Yanshu Li, Ligong Han, Ruixiang Tang, Wenya Wang

分类: cs.CL

发布日期: 2025-09-26

💡 一句话要点

提出In-Context Routing (ICR)方法,提升隐式上下文学习的泛化能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 隐式上下文学习 注意力机制 泛化能力 路由网络 少样本学习

📋 核心要点

- 现有隐式上下文学习方法依赖于任务特定的信息注入,缺乏对ICL内在结构机制的利用,泛化能力受限。

- In-Context Routing (ICR)通过在注意力logits层面内化可泛化的ICL模式,提取可重用的结构方向,提升泛化性。

- 实验结果表明,ICR在多个数据集和LLM上优于现有方法,并在领域外任务中表现出更强的泛化能力。

📝 摘要(中文)

隐式上下文学习(ICL)作为一种新兴范式,旨在模拟大型语言模型(LLM)表征空间中的ICL行为,以零样本成本获得少样本性能。然而,现有方法主要依赖于将偏移向量注入残差流,而这些残差流通常由带标签的演示或特定于任务的对齐构建。这种设计未能充分利用ICL的底层结构机制,并且泛化能力有限。为了解决这个问题,我们提出In-Context Routing (ICR),一种新颖的隐式ICL方法,它在注意力logits级别内化可泛化的ICL模式。它提取ICL期间出现的可重用结构方向,并采用可学习的输入条件路由器来相应地调节注意力logits,从而实现一次训练多次复用的框架。我们在涵盖不同领域的12个真实世界数据集和多个LLM上评估ICR。结果表明,ICR始终优于需要特定于任务的检索或训练的现有隐式ICL方法,同时对现有方法难以处理的领域外任务表现出强大的泛化能力。这些发现使ICR能够推动ICL的实际价值。

🔬 方法详解

问题定义:现有隐式上下文学习方法,例如通过注入偏移向量到残差流中来模拟ICL,但这些偏移向量通常依赖于带标签的演示数据或特定任务的对齐。这种做法的痛点在于,它没有充分利用ICL内在的结构性机制,导致模型在面对新的、未见过的任务时,泛化能力较差。模型需要针对不同的任务进行重新训练或调整,无法实现一次训练,多次复用。

核心思路:ICR的核心思路是在注意力logits层面学习并内化通用的ICL模式。通过提取在ICL过程中出现的、可重复使用的结构性方向,并利用一个可学习的、输入条件化的路由器来调节注意力logits,从而使模型能够根据不同的输入,自适应地调整其注意力机制,模拟ICL的行为。这样,模型就可以在没有明确的标签或任务特定信息的情况下,也能进行有效的上下文学习。

技术框架:ICR的技术框架主要包含两个核心模块:结构方向提取模块和注意力路由模块。首先,结构方向提取模块负责从训练数据中提取通用的ICL模式,这些模式以结构方向的形式表示。然后,注意力路由模块利用一个可学习的路由器,根据输入的上下文信息,动态地调整注意力logits,从而将提取到的结构方向应用到当前的输入中。整个框架采用一次训练,多次复用的模式,无需针对每个新任务进行重新训练。

关键创新:ICR的关键创新在于它将ICL的模式学习从残差流的偏移向量注入,转移到了注意力logits的调节上。这种做法的本质区别在于,它不再依赖于任务特定的信息,而是学习通用的ICL结构,从而提高了模型的泛化能力。此外,可学习的输入条件路由器使得模型能够根据不同的输入,自适应地调整其注意力机制,进一步提高了模型的灵活性和适应性。

关键设计:ICR的关键设计包括:1) 结构方向的提取方法,例如通过分析注意力权重或梯度来识别重要的结构方向;2) 注意力路由器的设计,例如采用MLP或Transformer结构,并使用合适的损失函数进行训练,以确保路由器能够有效地调节注意力logits;3) 损失函数的设计,可能包括对比学习损失或知识蒸馏损失,以鼓励模型学习通用的ICL模式。

🖼️ 关键图片

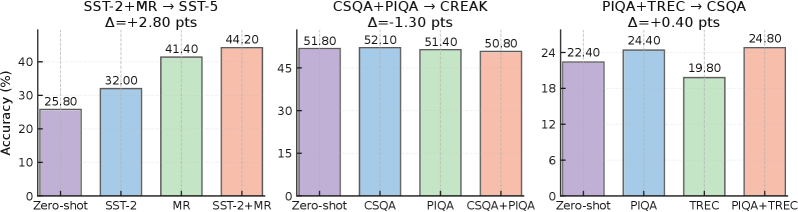

📊 实验亮点

ICR在12个真实世界数据集上进行了评估,涵盖了不同的领域和多个LLM。实验结果表明,ICR始终优于现有的隐式ICL方法,尤其是在领域外任务中,ICR表现出更强的泛化能力。例如,在某些任务上,ICR的性能提升超过了10%,证明了其有效性和优越性。

🎯 应用场景

ICR具有广泛的应用前景,例如在自然语言处理、计算机视觉等领域,可以用于解决少样本学习问题。该方法可以应用于文本分类、图像识别、机器翻译等任务,尤其适用于资源匮乏的场景。通过一次训练,ICR可以快速适应新的任务和领域,降低了模型部署和维护的成本,具有重要的实际应用价值。

📄 摘要(原文)

Implicit in-context learning (ICL) has newly emerged as a promising paradigm that simulates ICL behaviors in the representation space of Large Language Models (LLMs), aiming to attain few-shot performance at zero-shot cost. However, existing approaches largely rely on injecting shift vectors into residual flows, which are typically constructed from labeled demonstrations or task-specific alignment. Such designs fall short of utilizing the structural mechanisms underlying ICL and suffer from limited generalizability. To address this, we propose In-Context Routing (ICR), a novel implicit ICL method that internalizes generalizable ICL patterns at the attention logits level. It extracts reusable structural directions that emerge during ICL and employs a learnable input-conditioned router to modulate attention logits accordingly, enabling a train-once-and-reuse framework. We evaluate ICR on 12 real-world datasets spanning diverse domains and multiple LLMs. The results show that ICR consistently outperforms prior implicit ICL methods that require task-specific retrieval or training, while demonstrating robust generalization to out-of-domain tasks where existing methods struggle. These findings position ICR to push the boundary of ICL's practical value.