Beyond Textual Context: Structural Graph Encoding with Adaptive Space Alignment to alleviate the hallucination of LLMs

作者: Yifang Zhang, Pengfei Duan, Yiwen Yang, Shengwu Xiong

分类: cs.CL, cs.AI

发布日期: 2025-09-26

备注: 11 pages, 5 figures

🔗 代码/项目: GITHUB

💡 一句话要点

提出SSKG-LLM,通过结构化图编码和自适应空间对齐缓解LLM幻觉问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 知识图谱 幻觉缓解 结构化图编码 自适应空间对齐

📋 核心要点

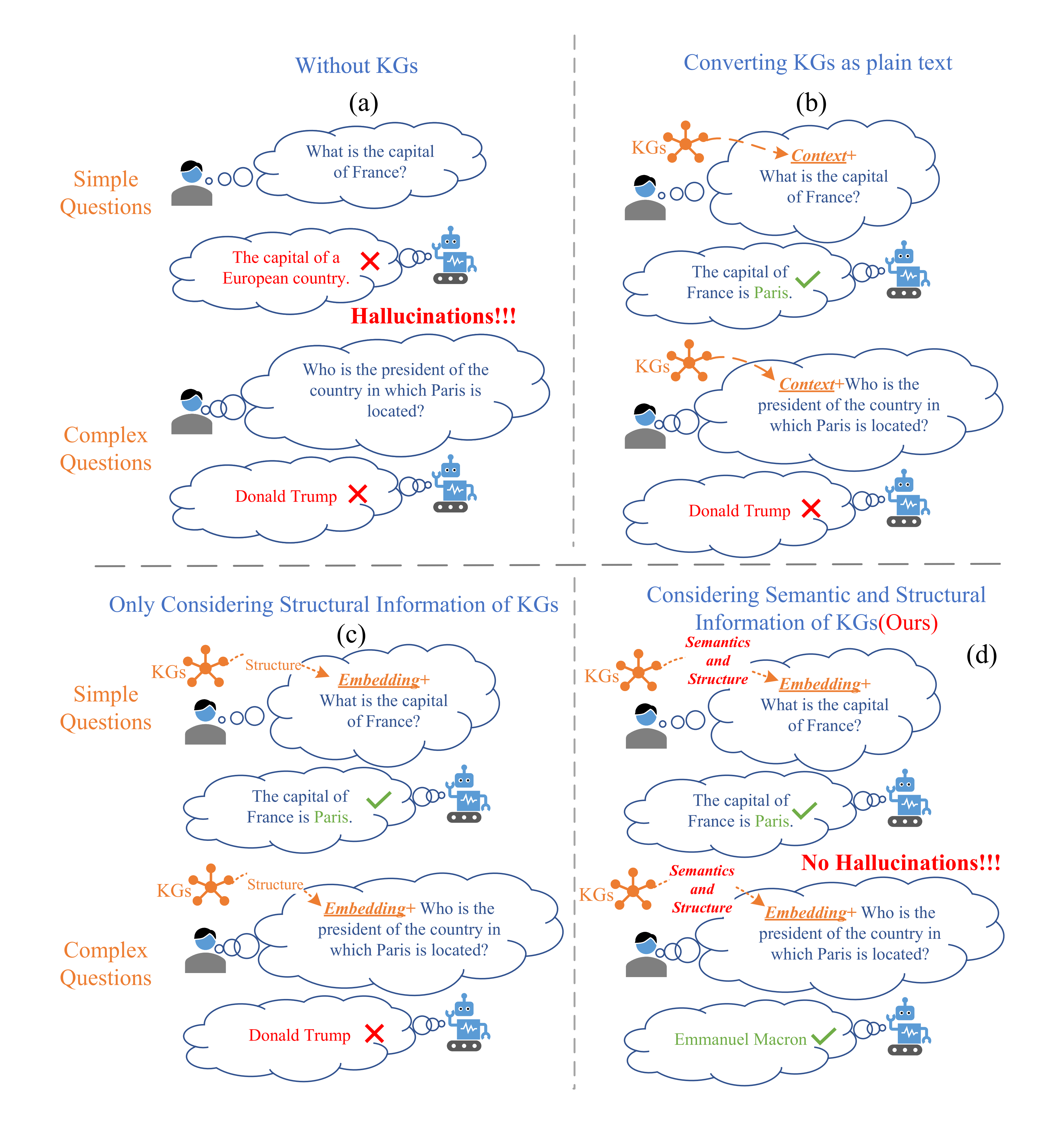

- 现有方法主要将知识图谱视为文本,忽略了其结构信息,导致LLM无法充分利用知识图谱。

- SSKG-LLM模型通过知识图谱检索、编码和适配模块,将知识图谱的结构和语义信息有效融入LLM推理过程。

- 实验结果表明,结合知识图谱结构信息能够显著提升LLM的事实推理能力,有效缓解幻觉问题。

📝 摘要(中文)

目前,解决大型语言模型(LLM)幻觉问题的主要方法是融入知识图谱(KG)。然而,LLM通常将KG视为纯文本,仅提取语义信息,限制了KG关键结构化方面的利用。另一个挑战是KG编码器和LLM文本嵌入之间的嵌入空间存在差距,阻碍了结构化知识的有效整合。为了克服这些障碍,我们提出了SSKG-LLM,一种创新的模型架构,旨在有效地将KG的结构和语义信息整合到LLM的推理过程中。SSKG-LLM包含知识图谱检索(KGR)模块和知识图谱编码(KGE)模块,以保留语义,同时利用结构。然后,加入知识图谱适配(KGA)模块,使LLM能够理解KG嵌入。我们进行了广泛的实验,并提供了详细的分析,以探索结合KG的结构信息如何增强LLM的事实推理能力。我们的代码可在https://github.com/yfangZhang/SSKG-LLM获取。

🔬 方法详解

问题定义:现有的大型语言模型在处理知识密集型任务时,容易产生幻觉,即生成不符合事实的内容。虽然引入知识图谱可以缓解这个问题,但现有方法通常将知识图谱视为纯文本,忽略了其固有的结构信息,导致LLM无法充分利用知识图谱的推理能力。此外,知识图谱编码器和LLM的文本嵌入空间存在差异,阻碍了知识的有效融合。

核心思路:SSKG-LLM的核心思路是将知识图谱的结构信息和语义信息同时融入LLM的推理过程。通过专门设计的模块,模型能够理解和利用知识图谱的结构关系,从而提升LLM的事实推理能力,减少幻觉的产生。模型还通过自适应空间对齐,弥合知识图谱嵌入和LLM文本嵌入之间的差距,实现更有效的知识融合。

技术框架:SSKG-LLM的整体架构包含三个主要模块:知识图谱检索(KGR)、知识图谱编码(KGE)和知识图谱适配(KGA)。首先,KGR模块负责从知识图谱中检索相关的事实三元组。然后,KGE模块将检索到的知识图谱信息编码成向量表示,同时保留语义和结构信息。最后,KGA模块将知识图谱的嵌入空间与LLM的文本嵌入空间进行对齐,使LLM能够更好地理解和利用知识图谱的信息。

关键创新:SSKG-LLM的关键创新在于同时利用知识图谱的结构和语义信息。与以往只关注语义信息的方法不同,SSKG-LLM通过KGE模块显式地编码知识图谱的结构信息,例如节点之间的关系和连接模式。此外,KGA模块的自适应空间对齐机制能够有效地弥合知识图谱嵌入和LLM文本嵌入之间的差距,实现更有效的知识融合。

关键设计:KGE模块可能采用了图神经网络(GNN)等技术来编码知识图谱的结构信息。KGA模块可能使用了对抗训练或相似度学习等方法来实现嵌入空间的对齐。具体的损失函数设计可能包括三元组损失、对比损失等,以保证知识图谱嵌入的质量和对齐效果。具体的网络结构细节和参数设置需要在论文中进一步查找。

🖼️ 关键图片

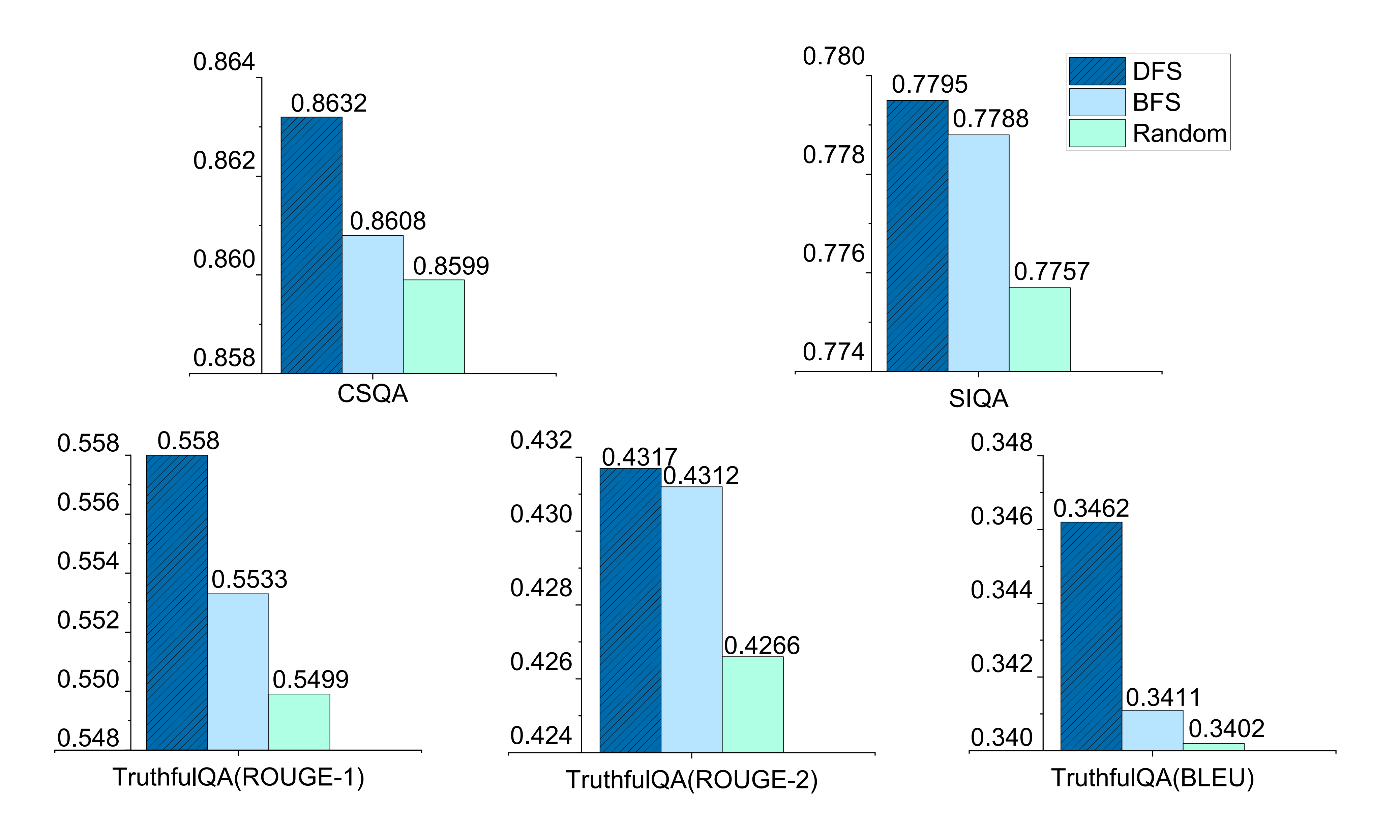

📊 实验亮点

论文通过实验验证了SSKG-LLM的有效性,表明结合知识图谱结构信息能够显著提升LLM的事实推理能力。具体的性能数据、对比基线和提升幅度需要在论文中进一步查找。实验分析还深入探讨了知识图谱结构信息对LLM推理过程的影响。

🎯 应用场景

SSKG-LLM可应用于需要事实性知识支撑的各种自然语言处理任务,例如问答系统、知识图谱补全、对话生成等。该研究有助于提升LLM在这些任务中的准确性和可靠性,减少幻觉的产生,从而提高用户体验和信任度。未来,该方法可以推广到其他类型的结构化数据,例如数据库和表格数据。

📄 摘要(原文)

Currently, the main approach for Large Language Models (LLMs) to tackle the hallucination issue is incorporating Knowledge Graphs(KGs).However, LLMs typically treat KGs as plain text, extracting only semantic information and limiting their use of the crucial structural aspects of KGs. Another challenge is the gap between the embedding spaces of KGs encoders and LLMs text embeddings, which hinders the effective integration of structured knowledge. To overcome these obstacles, we put forward the SSKG-LLM, an innovative model architecture that is designed to efficiently integrate both the Structural and Semantic information of KGs into the reasoning processes of LLMs. SSKG-LLM incorporates the Knowledge Graph Retrieval (KGR) module and the Knowledge Graph Encoding (KGE) module to preserve semantics while utilizing structure. Then, the Knowledge Graph Adaptation (KGA) module is incorporated to enable LLMs to understand KGs embeddings. We conduct extensive experiments and provide a detailed analysis to explore how incorporating the structural information of KGs can enhance the factual reasoning abilities of LLMs. Our code are available at https://github.com/yfangZhang/SSKG-LLM.