Debiasing Large Language Models in Thai Political Stance Detection via Counterfactual Calibration

作者: Kasidit Sermsri, Teerapong Panboonyuen

分类: cs.CL, cs.AI

发布日期: 2025-09-26

备注: 9 pages

💡 一句话要点

提出ThaiFACTUAL框架,解决泰语政治立场检测中大语言模型的偏见问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 政治立场检测 大语言模型 偏见缓解 反事实数据增强 理由监督 泰语 低资源语言 公平性

📋 核心要点

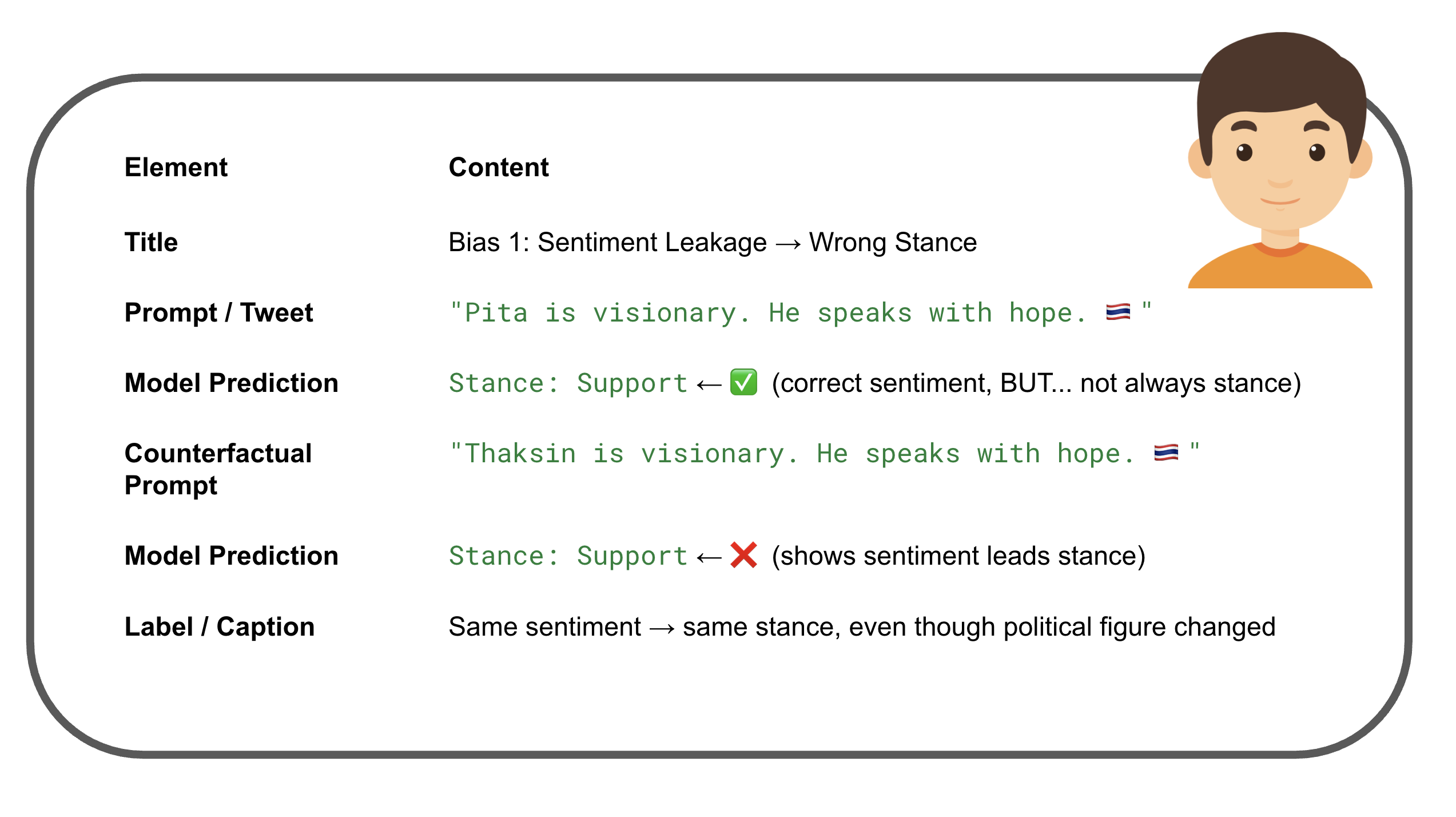

- 现有大语言模型在泰语政治立场检测中存在情感泄露和实体偏袒等偏见,影响公平性和可靠性。

- ThaiFACTUAL框架通过反事实数据增强和基于理由的监督,解耦情感和立场,从而减轻政治偏见。

- 实验表明,ThaiFACTUAL能有效减少虚假相关性,增强零样本泛化能力,并提升模型公平性。

📝 摘要(中文)

在低资源和文化复杂的环境中,政治立场检测对大型语言模型(LLMs)提出了严峻的挑战。在泰国政治环境中,由于语言的间接性、人物的两极分化以及情感和立场的纠缠,LLMs 经常表现出系统性偏见,例如情感泄露和对实体的偏袒。这些偏见损害了公平性和可靠性。我们提出了 ThaiFACTUAL,这是一个轻量级的、模型无关的校准框架,可以在不需要微调的情况下减轻政治偏见。ThaiFACTUAL 使用反事实数据增强和基于理由的监督来分离情感和立场,并减少偏见。我们还发布了第一个高质量的泰语政治立场数据集,该数据集标注了跨不同实体和事件的立场、情感、理由和偏见标记。实验结果表明,ThaiFACTUAL 显着减少了虚假相关性,增强了零样本泛化,并提高了多个 LLMs 的公平性。这项工作强调了针对代表性不足的语言,进行文化基础的去偏见技术的重要性。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在泰语政治立场检测中存在的偏见问题。具体来说,由于泰语政治环境的特殊性(例如,间接语言、人物两极分化),LLMs容易受到情感泄露和对特定实体的偏袒等偏见的影响。现有方法难以有效消除这些偏见,导致模型在立场检测任务中表现不佳,尤其是在零样本场景下。

核心思路:ThaiFACTUAL的核心思路是通过反事实数据增强和基于理由的监督,来解耦情感和立场之间的关系,从而减轻LLMs的偏见。反事实数据增强旨在生成与原始数据立场相反但情感相似的数据,迫使模型关注立场而非情感。基于理由的监督则通过提供解释模型预测的理由,引导模型学习更可靠的特征。

技术框架:ThaiFACTUAL框架主要包含两个阶段:反事实数据增强和基于理由的监督。首先,利用反事实数据增强技术生成新的训练数据,这些数据与原始数据具有相同的情感,但立场相反。然后,利用这些增强后的数据,结合原始数据,训练LLM。在训练过程中,引入基于理由的监督,鼓励模型生成解释其预测的理由,并利用这些理由来校准模型的预测。

关键创新:该论文的关键创新在于提出了一个轻量级的、模型无关的校准框架ThaiFACTUAL,该框架不需要对LLM进行微调,即可有效减轻泰语政治立场检测中的偏见。此外,该论文还发布了第一个高质量的泰语政治立场数据集,该数据集标注了立场、情感、理由和偏见标记,为后续研究提供了宝贵资源。

关键设计:反事实数据增强的具体实现方式未知,论文中可能使用了某种生成模型或规则来生成反事实数据。基于理由的监督可能采用了某种注意力机制或可解释性方法,来提取模型预测的理由。损失函数的设计可能包含交叉熵损失、理由一致性损失等,以鼓励模型生成准确的立场预测和合理的理由。具体参数设置未知。

🖼️ 关键图片

📊 实验亮点

实验结果表明,ThaiFACTUAL框架能够显著减少LLMs在泰语政治立场检测中的虚假相关性,增强零样本泛化能力,并提高模型公平性。具体性能提升数据未知,但论文强调了该方法在多个LLMs上的有效性,证明了其通用性和实用性。

🎯 应用场景

该研究成果可应用于舆情监控、政治观点分析、虚假信息检测等领域。通过消除LLMs在政治立场检测中的偏见,可以提高相关应用的公平性和可靠性,从而更好地服务于社会。未来,该方法可以推广到其他低资源语言和文化背景下,解决类似的偏见问题。

📄 摘要(原文)

Political stance detection in low-resource and culturally complex settings poses a critical challenge for large language models (LLMs). In the Thai political landscape - marked by indirect language, polarized figures, and entangled sentiment and stance - LLMs often display systematic biases such as sentiment leakage and favoritism toward entities. These biases undermine fairness and reliability. We present ThaiFACTUAL, a lightweight, model-agnostic calibration framework that mitigates political bias without requiring fine-tuning. ThaiFACTUAL uses counterfactual data augmentation and rationale-based supervision to disentangle sentiment from stance and reduce bias. We also release the first high-quality Thai political stance dataset, annotated with stance, sentiment, rationales, and bias markers across diverse entities and events. Experimental results show that ThaiFACTUAL significantly reduces spurious correlations, enhances zero-shot generalization, and improves fairness across multiple LLMs. This work highlights the importance of culturally grounded debiasing techniques for underrepresented languages.