Enhancing Low-Rank Adaptation with Structured Nonlinear Transformations

作者: Guanzhi Deng, Mingyang Liu, Dapeng Wu, Yinqiao Li, Linqi Song

分类: cs.CL, cs.AI

发布日期: 2025-09-26

备注: This manuscript has been submitted to IEEE Journal of Selected Topics in Signal Processing (JSTSP) for review. Until the moment I submitted the manuscript to arXiv, we haven't received any review comments from JSTSP

💡 一句话要点

LoRAN:通过结构化非线性变换增强低秩自适应能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低秩自适应 参数高效微调 非线性变换 大型语言模型 激活函数

📋 核心要点

- LoRA的线性特性限制了其表达能力,难以捕捉复杂的非线性关系,从而影响微调效果。

- LoRAN通过在LoRA的低秩更新中引入轻量级的非线性变换来增强模型的表达能力。

- 实验结果表明,LoRAN在摘要和分类任务上均优于QLoRA,证明了非线性变换的有效性。

📝 摘要(中文)

低秩自适应(LoRA)是一种广泛应用于大型语言模型的参数高效微调方法。然而,其线性特性限制了表达能力。本文提出了LoRAN,它是LoRA的非线性扩展,对低秩更新应用轻量级变换。此外,我们引入了Sinter,一种基于正弦的激活函数,它在不增加参数数量的情况下添加结构化扰动。在摘要和分类任务上的实验表明,LoRAN始终优于QLoRA。消融研究表明,Sinter优于Sigmoid、ReLU和Tanh等标准激活函数,突出了激活函数设计在低秩微调中的重要性。

🔬 方法详解

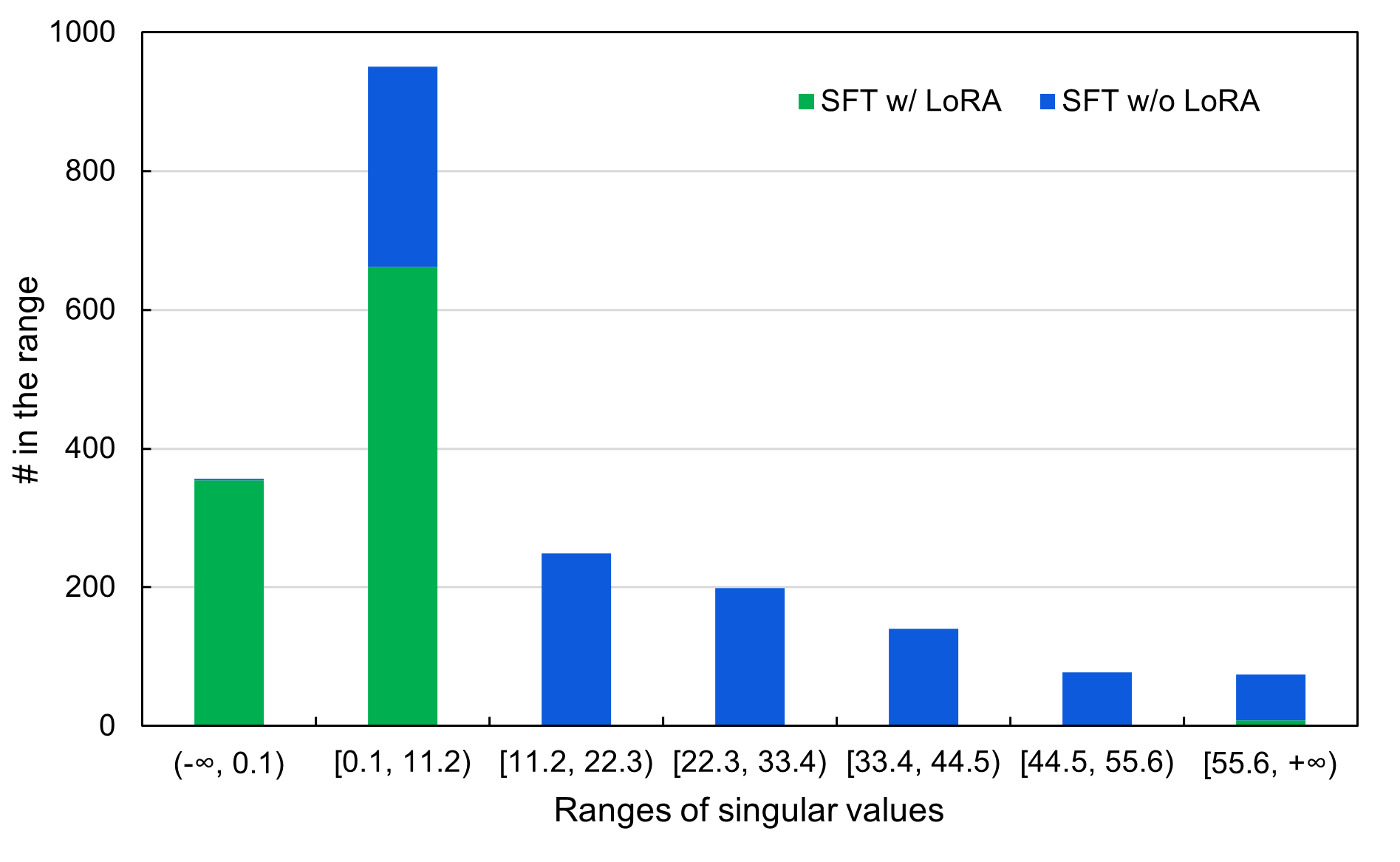

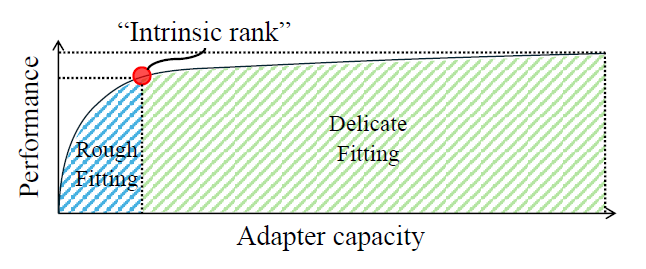

问题定义:LoRA作为一种参数高效的微调方法,由于其固有的线性特性,在处理复杂任务时可能无法充分捕捉模型中的非线性关系,导致微调效果受限。因此,如何增强LoRA的表达能力,使其能够更好地适应各种任务,是一个重要的研究问题。

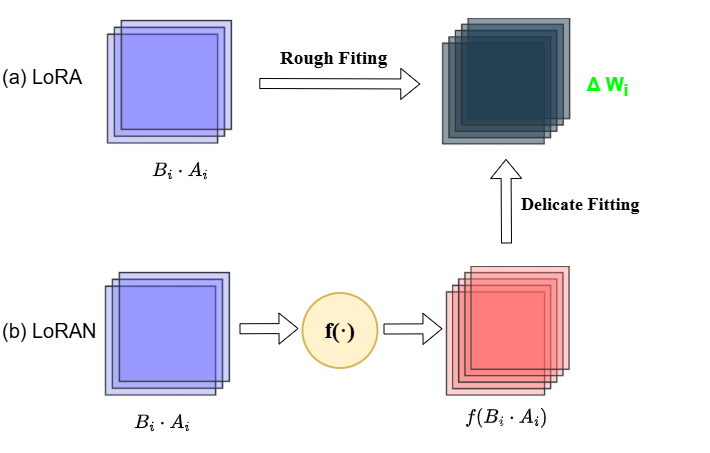

核心思路:LoRAN的核心思路是在LoRA的低秩更新过程中引入非线性变换,从而增强模型的表达能力。通过在低秩更新后应用轻量级的非线性函数,LoRAN能够捕捉更复杂的特征交互,提高微调效果。

技术框架:LoRAN的整体框架是在LoRA的基础上,在低秩更新矩阵后添加一个非线性激活层。具体来说,对于LoRA中的权重更新ΔW = BA,LoRAN将其修改为ΔW = f(BA),其中f(·)表示非线性激活函数。论文还提出了Sinter激活函数,它是一种基于正弦函数的结构化激活函数,旨在在不增加参数量的情况下引入结构化的扰动。

关键创新:LoRAN的关键创新在于引入了非线性变换来增强LoRA的表达能力。与传统的线性LoRA相比,LoRAN能够捕捉更复杂的特征交互,从而提高微调效果。此外,Sinter激活函数的提出也是一个创新点,它在不增加参数量的情况下引入了结构化的扰动,进一步提升了模型的性能。

关键设计:Sinter激活函数的设计是关键。Sinter的公式为Sinter(x) = sin(ωx + φ),其中ω和φ是可学习的参数,用于控制正弦函数的频率和相位。这种设计允许Sinter在不增加参数量的情况下引入结构化的扰动。此外,论文还对不同的激活函数进行了消融实验,证明了Sinter的有效性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,LoRAN在摘要和分类任务上均优于QLoRA。例如,在摘要任务中,LoRAN在ROUGE指标上取得了显著提升。消融研究表明,Sinter激活函数优于Sigmoid、ReLU和Tanh等标准激活函数,证明了其有效性。这些结果表明,LoRAN是一种有效的增强低秩自适应能力的方法。

🎯 应用场景

LoRAN可以广泛应用于各种需要参数高效微调的大型语言模型任务,例如文本摘要、文本分类、机器翻译等。通过增强模型的表达能力,LoRAN可以提高微调效果,从而提升模型在各种任务上的性能。此外,LoRAN的轻量级特性使其易于部署和应用。

📄 摘要(原文)

Low-Rank Adaptation (LoRA) is a widely adopted parameter-efficient fine-tuning method for large language models. However, its linear nature limits expressiveness. We propose LoRAN, a non-linear extension of LoRA that applies lightweight transformations to the low-rank updates. We further introduce Sinter, a sine-based activation that adds structured perturbations without increasing parameter count. Experiments across summarization and classification tasks show that LoRAN consistently improves over QLoRA. Ablation studies reveal that Sinter outperforms standard activations such as Sigmoid, ReLU, and Tanh, highlighting the importance of activation design in lowrank tuning.