Towards Open-Ended Discovery for Low-Resource NLP

作者: Bonaventure F. P. Dossou, Henri Aïdasso

分类: cs.CL, cs.AI

发布日期: 2025-09-22

备注: Proceedings of the 2nd Workshop on Uncertainty-Aware NLP (UncertaiNLP) at EMNLP 2025

💡 一句话要点

面向低资源NLP,提出基于人机交互的开放式语言发现框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低资源NLP 人机交互 开放式学习 语言发现 不确定性估计

📋 核心要点

- 低资源语言NLP面临数据稀缺、标注困难等挑战,现有方法难以有效学习。

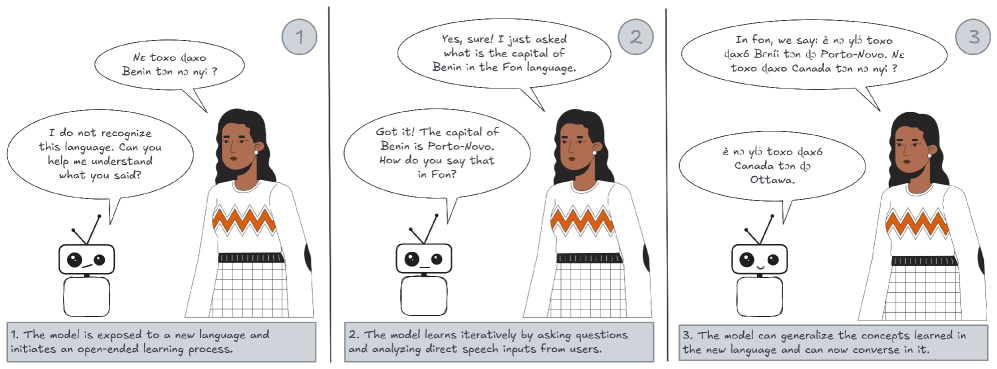

- 提出一种开放式、交互式的语言发现框架,通过人机对话动态学习新语言。

- 该框架结合模型认知不确定性和人类置信度信号,指导交互和知识获取。

📝 摘要(中文)

低资源语言的自然语言处理(NLP)主要受限于文本语料库的匮乏、标准化的正字法以及可扩展的标注流程。尽管大型语言模型的最新进展改善了跨语言迁移,但由于它们依赖于海量的预收集数据和中心化基础设施,因此对于代表性不足的社区而言仍然难以企及。本文提出了一种范式转变,即转向开放式、交互式的语言发现,其中AI系统通过对话而非静态数据集动态地学习新语言。我们认为,语言技术的未来,特别是对于低资源和缺乏文档的语言,必须超越静态数据收集流程,转向交互式的、不确定性驱动的发现,其中学习从人机协作中动态产生,而不是局限于预先存在的数据集。我们提出了一个基于人机联合不确定性的框架,结合了来自模型的认知不确定性与来自人类说话者的犹豫线索和置信度信号,以指导交互、查询选择和记忆保留。本文是一项行动号召:我们提倡重新思考AI如何与缺乏文档的语言中的人类知识互动,从提取式数据收集转向参与式、共同适应的学习过程,在发现和保护世界语言多样性的同时尊重和赋能社区。这一愿景符合以人为本的AI原则,强调AI系统与说话者之间交互式的、合作的模型构建。

🔬 方法详解

问题定义:低资源语言的NLP面临着数据稀缺、缺乏标准正字法和可扩展标注流程的挑战。现有的大型语言模型虽然在跨语言迁移方面有所进展,但它们依赖于海量的预收集数据和中心化基础设施,使得代表性不足的社区难以利用。因此,如何让AI系统在缺乏大量预训练数据的情况下,有效地学习和理解低资源语言是一个关键问题。

核心思路:本文的核心思路是采用开放式、交互式的语言发现方法,让人工智能系统通过与人类的对话动态地学习新语言。这种方法不再依赖于静态的数据集,而是通过人机协作,在交互过程中不断地发现和学习新的语言知识。这种方法的核心在于利用人类的语言知识和AI系统的学习能力,共同构建语言模型。

技术框架:该框架基于人机联合不确定性,主要包含以下几个模块:1) 不确定性估计模块:用于评估模型自身的认知不确定性,例如通过dropout或集成方法。2) 人类信号检测模块:用于检测人类说话者的犹豫线索和置信度信号,例如通过语音分析或文本分析。3) 交互策略模块:根据模型的不确定性和人类的信号,选择合适的查询或交互方式,例如主动学习中的查询策略。4) 记忆保留模块:用于存储和组织学习到的语言知识,例如使用知识图谱或向量数据库。整个流程是一个循环迭代的过程,通过不断地交互和学习,逐步提高模型对低资源语言的理解能力。

关键创新:该论文最重要的技术创新点在于将人机交互引入到低资源语言的学习过程中,并利用联合不确定性来指导交互和知识获取。与传统的静态数据收集和训练方法相比,这种方法更加灵活和高效,能够更好地适应低资源语言的特点。此外,该方法强调以人为本的AI原则,尊重和赋能社区,促进语言多样性的保护。

关键设计:论文中提到结合模型认知不确定性与人类说话者的犹豫线索和置信度信号。具体实现可能包括:使用贝叶斯神经网络或dropout来估计模型的认知不确定性;使用语音停顿、语速变化、重复词语等作为犹豫线索;使用情感分析或置信度评分来评估人类的置信度。这些信号可以被整合到一个奖励函数中,用于指导强化学习中的交互策略。具体的损失函数和网络结构的选择取决于具体的语言和任务,但整体目标是最小化模型的不确定性,并最大化人类的置信度。

🖼️ 关键图片

📊 实验亮点

由于是position paper,没有具体的实验结果。但该论文提出了一个新颖的框架,强调了人机交互在低资源语言学习中的重要性,并提出了利用联合不确定性来指导交互的思路。未来的研究可以基于该框架进行实验验证,并与其他主动学习方法进行比较,以评估其性能和效果。

🎯 应用场景

该研究成果可应用于低资源语言的机器翻译、语音识别、文本生成等领域。通过人机协作,可以有效地构建低资源语言的语言模型,促进不同语言之间的交流和理解。此外,该研究还有助于保护和传承濒危语言,维护语言多样性,并为文化交流提供技术支持。

📄 摘要(原文)

Natural Language Processing (NLP) for low-resource languages remains fundamentally constrained by the lack of textual corpora, standardized orthographies, and scalable annotation pipelines. While recent advances in large language models have improved cross-lingual transfer, they remain inaccessible to underrepresented communities due to their reliance on massive, pre-collected data and centralized infrastructure. In this position paper, we argue for a paradigm shift toward open-ended, interactive language discovery, where AI systems learn new languages dynamically through dialogue rather than static datasets. We contend that the future of language technology, particularly for low-resource and under-documented languages, must move beyond static data collection pipelines toward interactive, uncertainty-driven discovery, where learning emerges dynamically from human-machine collaboration instead of being limited to pre-existing datasets. We propose a framework grounded in joint human-machine uncertainty, combining epistemic uncertainty from the model with hesitation cues and confidence signals from human speakers to guide interaction, query selection, and memory retention. This paper is a call to action: we advocate a rethinking of how AI engages with human knowledge in under-documented languages, moving from extractive data collection toward participatory, co-adaptive learning processes that respect and empower communities while discovering and preserving the world's linguistic diversity. This vision aligns with principles of human-centered AI, emphasizing interactive, cooperative model building between AI systems and speakers.