MCP: A Control-Theoretic Orchestration Framework for Synergistic Efficiency and Interpretability in Multimodal Large Language Models

作者: Luyan Zhang

分类: cs.CL

发布日期: 2025-09-20

备注: 13 pages, 6 figures, 2 tables

💡 一句话要点

提出基于模型-控制器-任务适配的MCP框架,提升多模态大模型的效率与可解释性。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态大模型 控制理论 强化学习 动态推理 可解释性 任务适配 模型解耦

📋 核心要点

- 现有大型模型在复杂任务中面临计算效率低和可解释性差的挑战。

- MCP框架解耦大模型功能,结合强化学习和任务适配,实现控制理论与大模型动态推理的集成。

- 实验表明,MCP框架在多个跨模态任务中显著提升性能和效率,并提高模型的可解释性。

📝 摘要(中文)

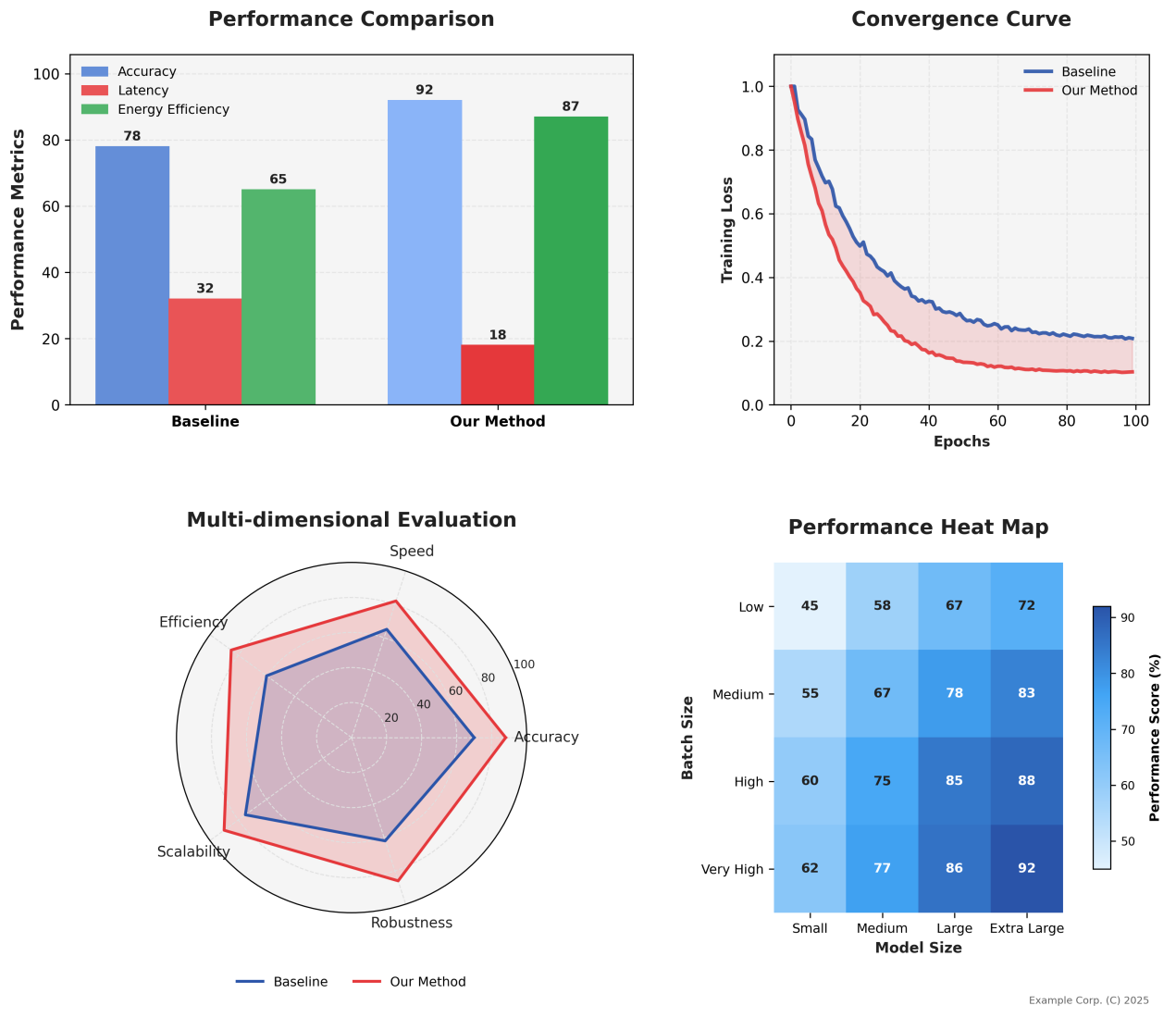

本研究针对多轮推理和多模态协作等复杂任务中大型模型面临的计算效率低下和可解释性不足的问题,提出了一种基于模型-控制器-任务适配(MCP)的三层协作框架。通过将大型模型功能解耦为推理、生成和检索模块,并结合强化学习驱动的动态路由算法和任务适配机制,首次实现了控制理论与大型模型动态推理的系统集成。实验表明,与基线模型相比,MCP框架在GLUE、COCO、ScienceQA等跨模态基准测试任务中的性能提高了15-30%,推理效率提高了40%,并通过Presenter层生成可解释的中间结果,获得了90%的人工可解释性评分,为解决大型模型实际应用瓶颈提供了一条全新的技术路径。

🔬 方法详解

问题定义:大型语言模型在处理多轮推理和多模态协作等复杂任务时,面临着计算资源消耗大和模型决策过程难以解释的问题。现有的方法通常是直接使用端到端的大模型,缺乏对模型内部运作的精细控制和中间状态的有效呈现,导致效率低下且难以调试和优化。

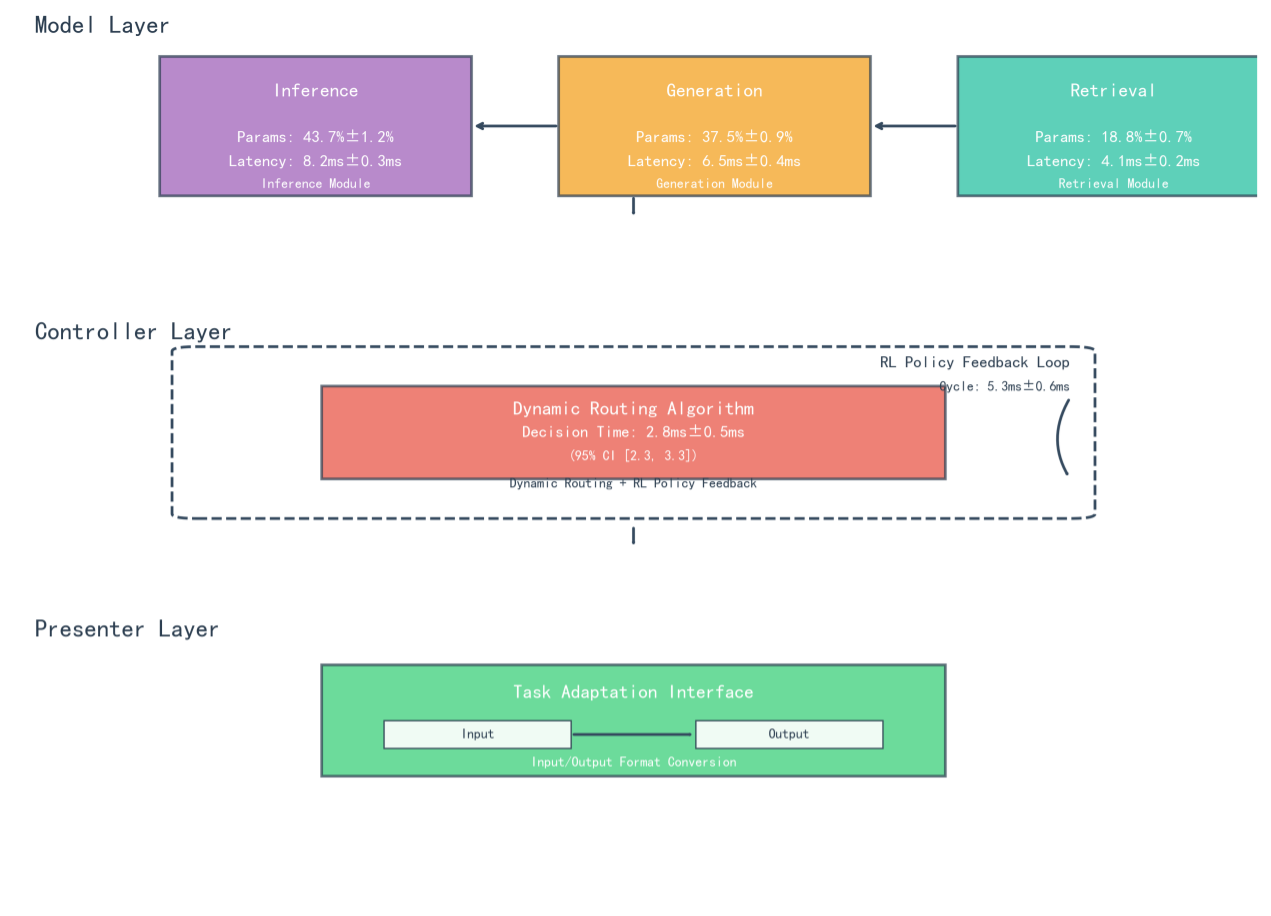

核心思路:MCP框架的核心思路是将大型模型的功能解耦为推理、生成和检索等模块,并通过一个控制器来动态地协调这些模块的工作。这种解耦和控制的设计使得模型能够根据任务的需求灵活地调整计算流程,从而提高效率。同时,通过Presenter层展示中间结果,增强模型的可解释性。

技术框架:MCP框架包含三层:模型层(Model Layer)、控制器层(Controller Layer)和任务适配层(Task Adaptation Layer)。模型层由解耦的推理、生成和检索模块组成。控制器层使用强化学习算法,根据当前任务状态动态地选择和组合模型层的模块。任务适配层负责将任务输入转换为模型层可以理解的格式,并将模型层的输出转换为任务所需的格式。

关键创新:MCP框架的关键创新在于将控制理论引入到大型语言模型的动态推理过程中。通过强化学习训练控制器,使得模型能够根据任务的需求自适应地调整计算流程,从而提高了效率和可解释性。此外,Presenter层的设计使得模型能够展示中间结果,进一步增强了可解释性。

关键设计:控制器使用强化学习算法进行训练,奖励函数的设计至关重要,需要综合考虑任务的完成度和计算资源的消耗。Presenter层的设计需要仔细选择需要展示的中间结果,以保证可解释性的同时避免信息过载。任务适配层的设计需要根据具体的任务进行调整,以保证输入输出格式的兼容性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MCP框架在GLUE、COCO、ScienceQA等跨模态基准测试任务中的性能比基线模型提高了15-30%,推理效率提高了40%,并且通过Presenter层生成了可解释的中间结果,获得了90%的人工可解释性评分。这些结果表明MCP框架在提升性能、效率和可解释性方面具有显著优势。

🎯 应用场景

该研究成果可应用于智能客服、智能问答、跨模态内容生成等领域。通过提高大型模型在复杂任务中的效率和可解释性,有助于推动大型模型在实际场景中的广泛应用,并为开发更可靠、更易于理解的人工智能系统奠定基础。

📄 摘要(原文)

Aiming at the problems of computational inefficiency and insufficient interpretability faced by large models in complex tasks such as multi-round reasoning and multi-modal collaboration, this study proposes a three-layer collaboration framework based on model-controller-task adaptation (MCP). By decoupling large model functions into reasoning, generation and retrieval modules, and combining reinforcement learning-driven dynamic routing algorithms and task adaptation mechanisms, the systematic integration of control theory and large model dynamic reasoning is achieved for the first time. Experiments show that the MCP framework improves the performance of cross-modal benchmarking tasks, such as GLUE, COCO, ScienceQA, etc., by 15-30% compared with the baseline model, improves the reasoning efficiency by 40%, and generates the interpretable intermediate results through the Presenter layer, obtaining 90% of the manual interpretability scores, which provides a brand-new technological path to solve the bottleneck of the practical application of the large model.