Computational Analysis of Conversation Dynamics through Participant Responsivity

作者: Margaret Hughes, Brandon Roy, Elinor Poole-Dayan, Deb Roy, Jad Kabbara

分类: cs.CL, cs.CY

发布日期: 2025-09-19

期刊: Proc. EMNLP (2025) 35500--35519

💡 一句话要点

提出基于响应性的对话质量评估方法,用于分析对话动态。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 对话分析 响应性 大型语言模型 对话质量评估 自然语言处理

📋 核心要点

- 现有工作较少关注对话的亲社会性和建设性特征,缺乏有效量化对话质量的方法。

- 论文核心思想是基于“响应性”来评估对话质量,即一方发言是否回应了另一方。

- 通过语义相似度和大型语言模型两种方法量化响应性,并使用人工标注数据进行评估。

📝 摘要(中文)

本文旨在探索对话中的亲社会性和建设性因素,重点关注“响应性”——即一方的发言是否回应了前一方的发言。研究提出并评估了量化响应性的方法:一是基于发言语义相似度,二是利用大型语言模型(LLM)识别发言间的关系。两种方法均通过人工标注的对话数据集进行评估。选择表现较好的LLM方法,进一步分析响应的性质,判断其是否对前一发言做出了实质性回应。研究将响应性视为对话的基本要素,并开发了对话级别的指标,用于分析不同对话的响应性结构,从而对各种对话进行有意义的表征和区分。

🔬 方法详解

问题定义:论文旨在解决如何量化对话质量,特别是对话中的“响应性”问题。现有方法在评估对话质量时,较少关注发言之间的关联,难以区分建设性和破坏性对话。缺乏有效的方法来衡量一方的发言是否真正回应了另一方,以及回应的质量如何。

核心思路:论文的核心思路是将对话质量与发言之间的“响应性”联系起来。如果一方的发言能够有效地回应另一方,则认为对话质量较高。通过量化发言之间的响应关系,可以更好地理解对话的动态和质量。这种方法能够捕捉到对话中更细微的互动模式,从而更准确地评估对话的建设性。

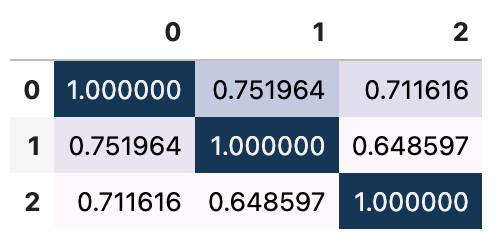

技术框架:该方法包含以下几个主要阶段:1) 数据准备:收集对话数据集,并进行人工标注,标注发言之间的响应关系。2) 响应性量化:使用两种方法量化响应性:a) 基于语义相似度的方法,计算发言之间的语义相似度,作为响应性的指标;b) 基于大型语言模型的方法,利用LLM识别发言之间的关系,判断是否存在响应关系。3) 模型评估:使用人工标注的数据集评估两种方法的性能。4) 响应性质分析:选择表现较好的LLM方法,进一步分析响应的性质,判断其是否为实质性回应。5) 对话级别指标构建:基于响应性链接,构建对话级别的指标,用于分析对话的整体结构和质量。

关键创新:该论文的关键创新在于:1) 提出了一种基于“响应性”的对话质量评估框架,为对话分析提供了一个新的视角。2) 探索了使用大型语言模型来识别发言之间响应关系的方法,并取得了较好的效果。3) 构建了对话级别的指标,用于分析对话的整体结构和质量。

关键设计:在基于LLM的方法中,使用了预训练的语言模型,并针对响应关系识别任务进行了微调。具体的技术细节包括:选择合适的预训练模型(具体模型未知),设计合适的输入格式(例如,将两个发言拼接在一起作为输入),定义合适的损失函数(例如,交叉熵损失函数),以及调整模型的超参数(例如,学习率、batch size等)。在对话级别指标构建方面,设计了多种指标来衡量对话的响应性结构,例如,平均响应长度、响应链的长度、响应类型的分布等(具体指标未知)。

🖼️ 关键图片

📊 实验亮点

论文通过实验验证了基于大型语言模型的响应性量化方法的有效性。虽然具体性能数据未知,但实验结果表明,该方法能够较好地识别发言之间的响应关系,并能够区分实质性回应和非实质性回应。与基于语义相似度的方法相比,基于LLM的方法表现更优,能够更准确地捕捉到发言之间的复杂关系。

🎯 应用场景

该研究成果可应用于在线社区管理、客户服务、教育辅导等领域。通过分析对话的响应性,可以识别不良对话行为,促进积极互动,提升沟通效率。例如,在在线论坛中,可以自动检测和干预恶意评论,维护健康的讨论氛围。在客户服务中,可以评估客服人员的响应质量,提高客户满意度。在教育辅导中,可以分析师生互动模式,优化教学策略。

📄 摘要(原文)

Growing literature explores toxicity and polarization in discourse, with comparatively less work on characterizing what makes dialogue prosocial and constructive. We explore conversational discourse and investigate a method for characterizing its quality built upon the notion of ``responsivity'' -- whether one person's conversational turn is responding to a preceding turn. We develop and evaluate methods for quantifying responsivity -- first through semantic similarity of speaker turns, and second by leveraging state-of-the-art large language models (LLMs) to identify the relation between two speaker turns. We evaluate both methods against a ground truth set of human-annotated conversations. Furthermore, selecting the better performing LLM-based approach, we characterize the nature of the response -- whether it responded to that preceding turn in a substantive way or not. We view these responsivity links as a fundamental aspect of dialogue but note that conversations can exhibit significantly different responsivity structures. Accordingly, we then develop conversation-level derived metrics to address various aspects of conversational discourse. We use these derived metrics to explore other conversations and show that they support meaningful characterizations and differentiations across a diverse collection of conversations.