CultureScope: A Dimensional Lens for Probing Cultural Understanding in LLMs

作者: Jinghao Zhang, Sihang Jiang, Shiwei Guo, Shisong Chen, Yanghua Xiao, Hongwei Feng, Jiaqing Liang, Minggui HE, Shimin Tao, Hongxia Ma

分类: cs.CL, cs.AI

发布日期: 2025-09-19

🔗 代码/项目: GITHUB

💡 一句话要点

提出 CultureScope,一个多维度框架,用于评估大型语言模型中的文化理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 文化理解 大型语言模型 评估框架 文化冰山理论 多维度分类

📋 核心要点

- 现有文化理解评估基准缺乏理论指导,依赖人工标注,难以扩展到不同文化。

- CultureScope 借鉴文化冰山理论,构建多维度文化知识分类体系,实现自动化评估。

- 实验表明,现有 LLM 缺乏文化理解能力,多语言数据并不能有效提升文化理解。

📝 摘要(中文)

随着大型语言模型(LLMs)越来越多地部署在不同的文化环境中,评估其文化理解能力对于确保可信和文化对齐的应用至关重要。然而,现有的大多数基准缺乏全面性,并且难以在不同的文化背景下扩展和调整,因为它们的框架通常缺乏完善的文化理论的指导,并且倾向于依赖专家驱动的手动注释。为了解决这些问题,我们提出了 CultureScope,这是迄今为止最全面的评估框架,用于评估LLMs中的文化理解能力。受到文化冰山理论的启发,我们设计了一种新颖的文化知识分类维度模式,包括3层和140个维度,指导自动构建特定于文化的知识库以及针对任何给定语言和文化的相应评估数据集。实验结果表明,我们的方法可以有效地评估文化理解能力。它们还表明,现有的大型语言模型缺乏全面的文化能力,并且仅仅纳入多语言数据并不一定能提高文化理解能力。所有代码和数据文件均可在https://github.com/HoganZinger/Culture 获取。

🔬 方法详解

问题定义:现有的大型语言模型在跨文化应用中面临文化理解能力不足的问题。现有的评估基准依赖专家标注,成本高昂且难以扩展到不同的文化和语言环境。缺乏一个系统性的、可扩展的文化理解评估框架,阻碍了LLM在文化敏感型应用中的可靠部署。

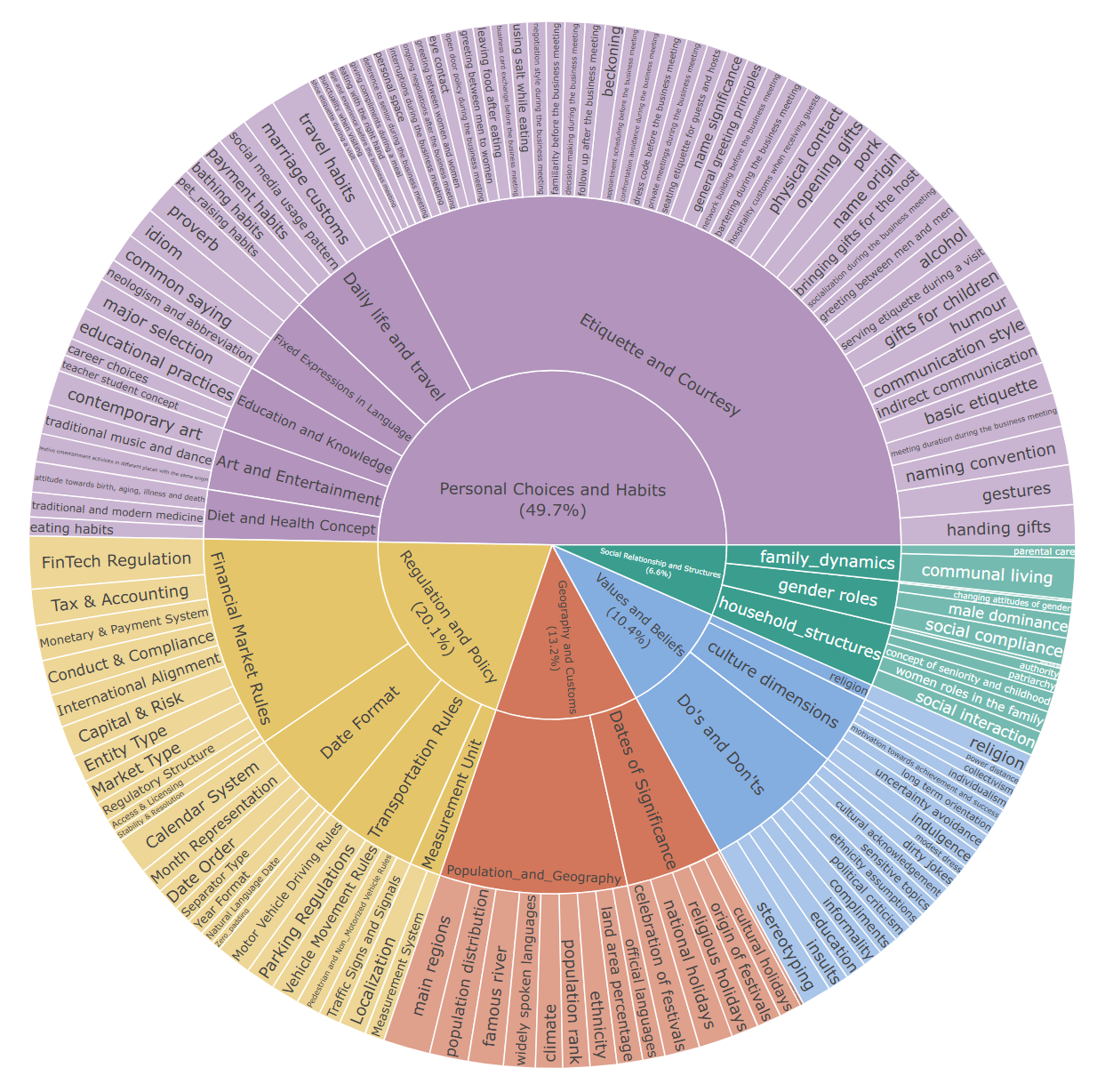

核心思路:CultureScope 的核心思路是借鉴文化冰山理论,将文化知识分解为多个维度,从而构建一个结构化的文化知识体系。通过这种方式,可以更全面、系统地评估 LLM 对不同文化层面的理解程度,并实现自动化评估,降低人工成本。

技术框架:CultureScope 包含以下主要模块:1) 文化知识维度定义:基于文化冰山理论,定义了3层140个维度的文化知识分类体系。2) 文化知识库构建:利用定义的维度体系,自动构建特定于文化和语言的知识库。3) 评估数据集生成:基于知识库,生成用于评估 LLM 文化理解能力的问答数据集。4) 模型评估:使用生成的数据集评估 LLM 的文化理解能力,并分析其在不同文化维度上的表现。

关键创新:CultureScope 的关键创新在于其多维度的文化知识分类体系,该体系基于文化冰山理论,能够更全面地捕捉文化知识的不同层面。此外,CultureScope 实现了文化知识库和评估数据集的自动构建,大大降低了评估成本,并提高了可扩展性。

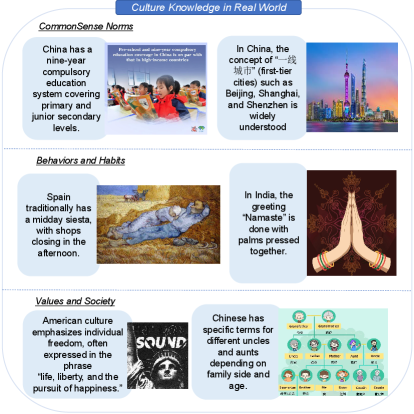

关键设计:CultureScope 的关键设计包括:1) 文化知识维度的具体划分,例如,显性文化层面的维度包括语言、食物、艺术等,隐性文化层面的维度包括价值观、信仰、假设等。2) 知识库构建过程中,使用自动化方法从网络资源中提取文化知识,并进行清洗和整理。3) 评估数据集的生成方式,例如,针对每个文化维度,生成相应的问答对,以测试 LLM 对该维度的理解程度。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CultureScope 能够有效评估 LLM 的文化理解能力。现有 LLM 在 CultureScope 的评估中表现不佳,表明其缺乏全面的文化能力。此外,实验还发现,仅仅增加多语言数据并不能显著提高 LLM 的文化理解能力,需要更深入地研究文化知识的表示和推理方法。

🎯 应用场景

CultureScope 可用于评估和提升大型语言模型在跨文化交流、文化遗产保护、国际教育等领域的应用能力。通过 CultureScope 的评估,可以发现 LLM 在文化理解方面的不足,并针对性地进行改进,从而提高其在文化敏感型任务中的表现。此外,CultureScope 还可以用于比较不同 LLM 的文化理解能力,为用户选择合适的模型提供参考。

📄 摘要(原文)

As large language models (LLMs) are increasingly deployed in diverse cultural environments, evaluating their cultural understanding capability has become essential for ensuring trustworthy and culturally aligned applications. However, most existing benchmarks lack comprehensiveness and are challenging to scale and adapt across different cultural contexts, because their frameworks often lack guidance from well-established cultural theories and tend to rely on expert-driven manual annotations. To address these issues, we propose CultureScope, the most comprehensive evaluation framework to date for assessing cultural understanding in LLMs. Inspired by the cultural iceberg theory, we design a novel dimensional schema for cultural knowledge classification, comprising 3 layers and 140 dimensions, which guides the automated construction of culture-specific knowledge bases and corresponding evaluation datasets for any given languages and cultures. Experimental results demonstrate that our method can effectively evaluate cultural understanding. They also reveal that existing large language models lack comprehensive cultural competence, and merely incorporating multilingual data does not necessarily enhance cultural understanding. All code and data files are available at https://github.com/HoganZinger/Culture