PILOT: Steering Synthetic Data Generation with Psychological & Linguistic Output Targeting

作者: Caitlin Cisar, Emily Sheffield, Joshua Drake, Alden Harrell, Subramanian Chidambaram, Nikita Nangia, Vinayak Arannil, Alex Williams

分类: cs.CL, cs.AI

发布日期: 2025-09-18

💡 一句话要点

PILOT:利用心理语言学输出目标引导合成数据生成,提升控制精度。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 合成数据生成 心理语言学 大型语言模型 角色引导 可控生成

📋 核心要点

- 现有生成式AI依赖自然语言描述用户角色,导致模型推断偏差,无法精确控制合成数据的属性。

- PILOT框架将自然语言角色描述转化为结构化的心理语言学剖析,从而引导LLM生成更可控的数据。

- 实验表明,基于模式的引导显著提升输出一致性,混合方法在多样性和一致性间取得平衡,且保持高质量。

📝 摘要(中文)

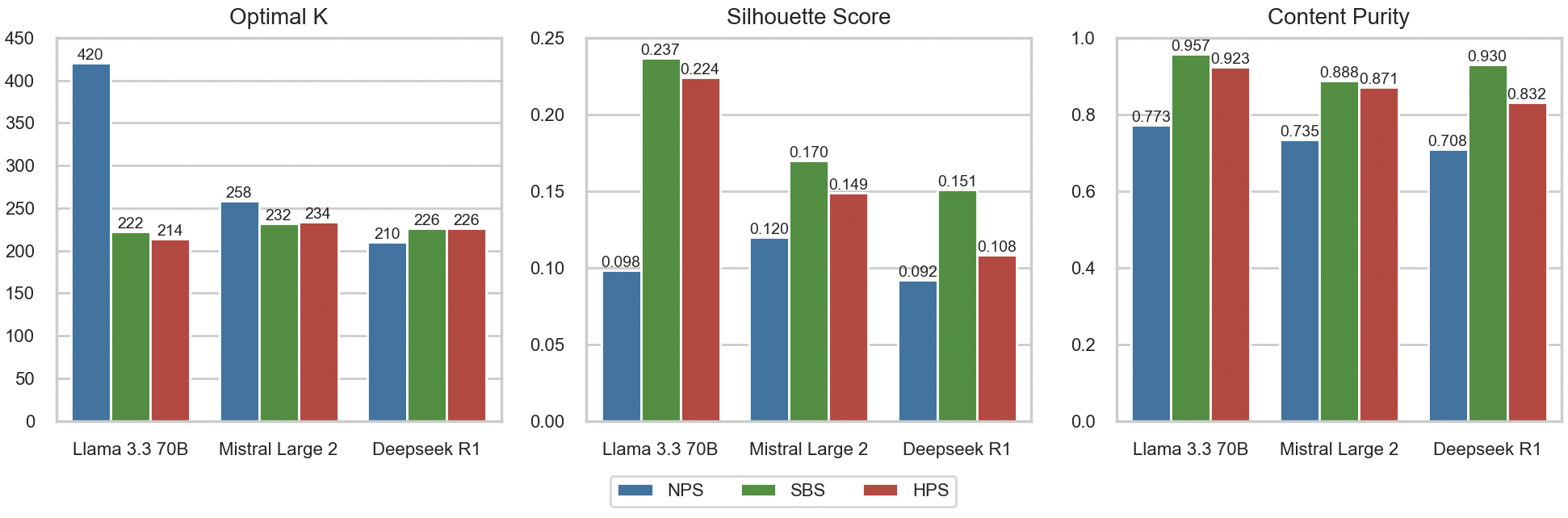

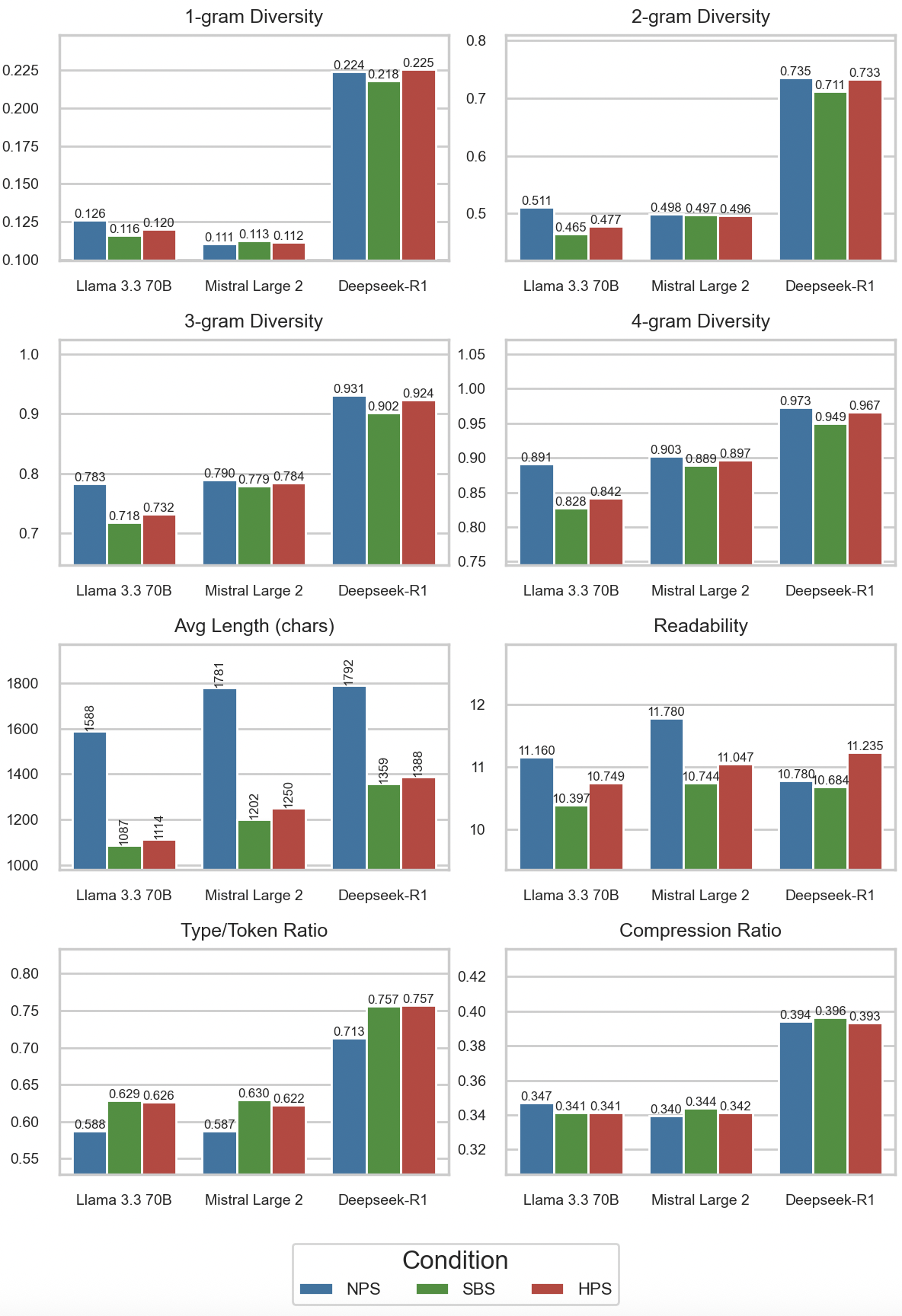

生成式AI应用通常利用用户角色作为合成数据生成的引导机制,但依赖自然语言表示迫使模型对要强调的属性进行不必要的推断,限制了对输出的精确控制。我们引入了PILOT(心理和语言输出目标),这是一个两阶段框架,用于利用结构化的心理语言学剖析来引导大型语言模型。在第一阶段,PILOT将自然语言角色描述转换为多维剖析,其中包含跨语言和心理维度的标准化分数。在第二阶段,这些剖析沿着可测量的变化轴引导生成。我们使用25个合成角色,在三种条件下(自然语言角色引导(NPS)、基于模式的引导(SBS)和混合角色-模式引导(HPS))评估了三种最先进的LLM(Mistral Large 2、Deepseek-R1、LLaMA 3.3 70B)。结果表明,基于模式的方法显著减少了人工角色重复,同时提高了输出一致性,轮廓系数从0.098增加到0.237,主题纯度从0.773增加到0.957。我们的分析揭示了一个根本的权衡:SBS产生更简洁的输出,具有更高的话题一致性,而NPS提供更大的词汇多样性,但降低了可预测性。HPS实现了这些极端之间的平衡,在保持输出多样性的同时保持了结构一致性。专家语言评估证实,PILOT在所有条件下都保持了较高的响应质量,不同引导方法之间没有统计学上的显著差异。

🔬 方法详解

问题定义:现有方法依赖自然语言描述来引导生成式AI,生成合成数据。这种方法的痛点在于,自然语言本身具有歧义性,导致模型在生成过程中会进行不必要的推断,从而难以精确控制生成数据的特定属性(例如,心理特征、语言风格等)。这限制了合成数据在特定应用场景中的有效性。

核心思路:PILOT的核心思路是将自然语言的角色描述转化为结构化的心理语言学剖析。通过将角色描述映射到预定义的心理和语言维度上的标准化分数,可以更精确地控制生成过程,避免模型进行不必要的推断。这种方法旨在提高合成数据的质量和可控性。

技术框架:PILOT框架包含两个主要阶段: 1. 剖析阶段:将自然语言角色描述输入到模型中,模型将其转换为多维的心理语言学剖析,每个维度都有一个标准化的分数。 2. 生成阶段:利用生成的剖析来引导大型语言模型生成文本。通过调整生成过程,使生成的文本与目标剖析相匹配。框架支持三种引导方式:自然语言角色引导(NPS)、基于模式的引导(SBS)和混合角色-模式引导(HPS)。

关键创新:PILOT的关键创新在于使用结构化的心理语言学剖析来引导生成式AI。与传统的自然语言引导方法相比,PILOT能够更精确地控制生成数据的属性,减少模型的不必要推断。此外,PILOT框架具有通用性,可以应用于不同的LLM和不同的心理语言学维度。

关键设计:PILOT的关键设计包括: 1. 心理语言学维度选择:选择合适的心理和语言维度来描述角色特征,例如人格特质、情感倾向、语言风格等。 2. 标准化分数计算:设计算法将自然语言描述映射到标准化分数,确保不同角色描述的可比性。 3. 引导策略:设计不同的引导策略(NPS、SBS、HPS)来平衡生成数据的多样性和一致性。 4. 评估指标:使用轮廓系数和主题纯度等指标来评估生成数据的质量和可控性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,基于模式的引导(SBS)显著提高了输出的一致性,轮廓系数从0.098提升至0.237,主题纯度从0.773提升至0.957。混合角色-模式引导(HPS)在保持输出多样性的同时,也保证了结构的一致性。专家语言评估证实,PILOT在所有引导条件下都保持了较高的响应质量,不同引导方法之间没有显著差异。这些结果验证了PILOT框架的有效性。

🎯 应用场景

PILOT框架可应用于多种场景,例如:创建更逼真和多样化的人物角色用于游戏开发和电影制作;生成更具针对性的营销内容,提高广告效果;构建更可靠的对话系统,提升用户体验;以及生成用于心理学研究的合成数据,加速相关研究进展。该研究的实际价值在于提高合成数据的质量和可控性,从而推动生成式AI在各个领域的应用。

📄 摘要(原文)

Generative AI applications commonly leverage user personas as a steering mechanism for synthetic data generation, but reliance on natural language representations forces models to make unintended inferences about which attributes to emphasize, limiting precise control over outputs. We introduce PILOT (Psychological and Linguistic Output Targeting), a two-phase framework for steering large language models with structured psycholinguistic profiles. In Phase 1, PILOT translates natural language persona descriptions into multidimensional profiles with normalized scores across linguistic and psychological dimensions. In Phase 2, these profiles guide generation along measurable axes of variation. We evaluate PILOT across three state-of-the-art LLMs (Mistral Large 2, Deepseek-R1, LLaMA 3.3 70B) using 25 synthetic personas under three conditions: Natural-language Persona Steering (NPS), Schema-Based Steering (SBS), and Hybrid Persona-Schema Steering (HPS). Results demonstrate that schema-based approaches significantly reduce artificial-sounding persona repetition while improving output coherence, with silhouette scores increasing from 0.098 to 0.237 and topic purity from 0.773 to 0.957. Our analysis reveals a fundamental trade-off: SBS produces more concise outputs with higher topical consistency, while NPS offers greater lexical diversity but reduced predictability. HPS achieves a balance between these extremes, maintaining output variety while preserving structural consistency. Expert linguistic evaluation confirms that PILOT maintains high response quality across all conditions, with no statistically significant differences between steering approaches.