Quantifying Self-Awareness of Knowledge in Large Language Models

作者: Yeongbin Seo, Dongha Lee, Jinyoung Yeo

分类: cs.CL

发布日期: 2025-09-18

💡 一句话要点

提出AQE方法以量化大语言模型知识自感知中的问题侧影响,并提出SCAO方法增强模型侧信号。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 知识自感知 幻觉预测 问题侧效应 语义压缩

📋 核心要点

- 现有LLM的幻觉预测性能可能并非源于真正的自我意识,而是利用了问题侧的表面模式。

- 提出近似问题侧效应(AQE)来量化问题侧信息对幻觉预测的影响,从而区分问题侧和模型侧的贡献。

- 引入语义压缩方法SCAO,通过单字回答压缩语义,增强模型侧信号,实验表明SCAO在减少问题侧线索时表现出色。

📝 摘要(中文)

大型语言模型(LLM)中的幻觉预测通常被解释为一种自我意识的体现。然而,我们认为这种性能可能源于问题侧的捷径,而非真正的模型侧自省。为了 disentangle 这些因素,我们提出了近似问题侧效应(AQE),用于量化问题感知的贡献。我们对多个数据集的分析表明,大部分已报道的成功源于利用问题中的表面模式。此外,我们还介绍了 SCAO(通过单字回答进行语义压缩),这是一种增强模型侧信号使用的方法。实验表明,SCAO 实现了强大且一致的性能,尤其是在问题侧线索减少的设置中,突出了其在培养 LLM 中真正自我意识方面的有效性。

🔬 方法详解

问题定义:论文旨在解决大语言模型(LLM)中知识自感知能力评估不准确的问题。现有方法容易受到问题侧捷径的影响,即模型可能通过识别问题中的表面模式来预测幻觉,而非真正理解并评估自身知识的可靠性。这种问题侧的偏差导致对LLM自我意识的评估产生误导。

核心思路:论文的核心思路是将问题侧的影响与模型侧的自省能力解耦。通过量化问题侧的贡献,可以更准确地评估模型真正的知识自感知能力。同时,通过增强模型侧的信号,可以减少对问题侧捷径的依赖,从而提高模型自我意识的可靠性。

技术框架:论文主要包含两个部分:一是提出近似问题侧效应(AQE)来量化问题侧的影响;二是引入语义压缩方法SCAO来增强模型侧的信号。AQE通过分析模型在不同问题变体上的表现差异来估计问题侧的贡献。SCAO则通过迫使模型用单字回答问题来压缩语义,从而减少问题侧的线索,并迫使模型更多地依赖自身的知识。

关键创新:论文的关键创新在于提出了AQE和SCAO两种互补的方法。AQE提供了一种量化问题侧影响的手段,而SCAO则提供了一种增强模型侧信号的策略。与现有方法相比,该论文的方法更注重区分问题侧和模型侧的贡献,从而更准确地评估LLM的知识自感知能力。

关键设计:AQE的具体实现涉及生成问题的变体,并比较模型在原始问题和变体上的预测结果。SCAO的关键在于设计合适的单字回答任务,并使用相应的损失函数来训练模型。具体的参数设置和网络结构细节在论文中未详细说明,属于未知信息。

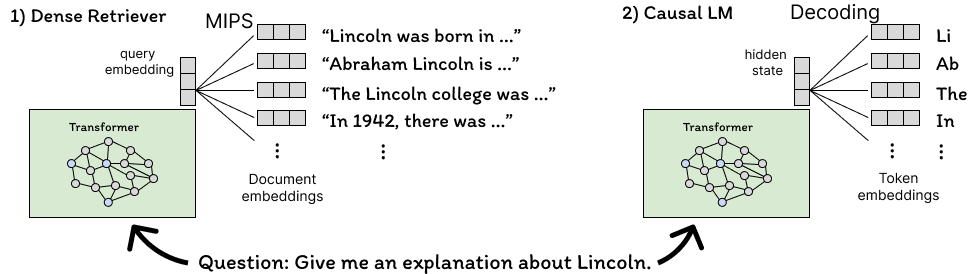

🖼️ 关键图片

📊 实验亮点

实验结果表明,AQE能够有效量化问题侧的影响,揭示了现有方法在评估LLM自我意识方面的局限性。SCAO方法在减少问题侧线索的情况下,显著提高了模型的幻觉预测性能,表明其能够有效增强模型侧的信号。具体的性能数据和对比基线在论文中未详细说明,属于未知信息。

🎯 应用场景

该研究成果可应用于提升大语言模型在知识密集型任务中的可靠性和可信度,例如问答系统、知识图谱推理等。通过更准确地评估模型的知识自感知能力,可以有效减少幻觉现象,提高模型输出的质量。此外,该研究也有助于开发更具自我意识和更值得信赖的人工智能系统。

📄 摘要(原文)

Hallucination prediction in large language models (LLMs) is often interpreted as a sign of self-awareness. However, we argue that such performance can arise from question-side shortcuts rather than true model-side introspection. To disentangle these factors, we propose the Approximate Question-side Effect (AQE), which quantifies the contribution of question-awareness. Our analysis across multiple datasets reveals that much of the reported success stems from exploiting superficial patterns in questions. We further introduce SCAO (Semantic Compression by Answering in One word), a method that enhances the use of model-side signals. Experiments show that SCAO achieves strong and consistent performance, particularly in settings with reduced question-side cues, highlighting its effectiveness in fostering genuine self-awareness in LLMs.