Causal-Counterfactual RAG: The Integration of Causal-Counterfactual Reasoning into RAG

作者: Harshad Khadilkar, Abhay Gupta

分类: cs.CL, cs.IR

发布日期: 2025-09-17 (更新: 2025-09-24)

💡 一句话要点

提出因果-反事实RAG,将因果推理融入RAG以提升知识密集型任务性能。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 因果推理 反事实推理 知识图谱 自然语言处理

📋 核心要点

- 传统RAG系统在知识密集型任务中,由于文本分块和过度依赖语义相似性,导致上下文理解不足和生成结果不准确。

- Causal-Counterfactual RAG通过引入显式因果图和反事实推理,增强了RAG的推理能力,提升了生成结果的准确性和可解释性。

- 该方法利用因果路径和假设场景,在检索过程中评估因果证据和反事实性,从而保留上下文连贯性并减少幻觉。

📝 摘要(中文)

大型语言模型(LLMs)已经改变了自然语言处理(NLP),通过整合大规模预训练知识实现了多样化的应用。然而,它们的静态知识限制了对外部信息的动态推理,尤其是在知识密集型领域。检索增强生成(RAG)通过结合检索机制和生成模型来提高上下文理解,从而应对这一挑战。传统的RAG系统由于文本分块和过度依赖语义相似性进行检索而导致上下文完整性中断,通常导致肤浅和不太准确的响应。我们提出了因果-反事实RAG,这是一种新颖的框架,它将表示因果关系的显式因果图集成到检索过程中,并结合基于因果结构的反事实推理。与传统方法不同,我们的框架不仅评估直接的因果证据,还评估相关原因的反事实性,结合两者的结果来生成更稳健、准确和可解释的答案。通过利用因果路径和相关的假设场景,因果-反事实RAG保留了上下文连贯性,减少了幻觉,并提高了推理保真度。

🔬 方法详解

问题定义:现有RAG模型在处理知识密集型任务时,由于文本分块破坏了上下文的完整性,并且过度依赖语义相似性进行检索,导致检索到的信息不准确,最终影响生成结果的质量。模型难以进行深层次的因果推理,容易产生幻觉,缺乏可解释性。

核心思路:Causal-Counterfactual RAG的核心思路是将因果推理融入到RAG框架中。通过构建显式的因果图来表示知识之间的因果关系,并在检索过程中利用这些因果关系进行推理。同时,引入反事实推理,评估相关原因的反事实性,从而更全面地理解上下文,生成更准确和可解释的答案。

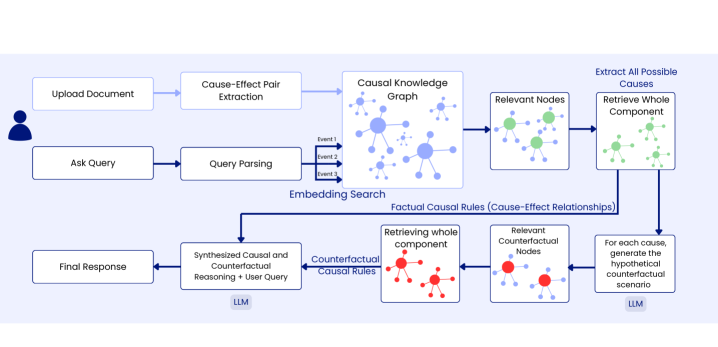

技术框架:Causal-Counterfactual RAG框架主要包含以下几个模块:1) 因果图构建模块:从知识库中提取因果关系,构建显式的因果图。2) 检索模块:利用因果图进行检索,不仅检索直接相关的文档,还检索与因果相关的文档。3) 反事实推理模块:对检索到的文档进行反事实推理,评估相关原因的反事实性。4) 生成模块:结合检索和反事实推理的结果,生成最终的答案。

关键创新:该方法最重要的创新点在于将因果推理和反事实推理融入到RAG框架中。与传统的RAG方法只关注语义相似性不同,Causal-Counterfactual RAG能够利用因果关系进行更深层次的推理,从而提高生成结果的准确性和可解释性。

关键设计:具体的技术细节包括:如何从知识库中自动提取因果关系,如何构建高效的因果图索引,如何设计反事实推理算法,以及如何将检索和反事实推理的结果有效地融合到生成模型中。论文可能使用了特定的损失函数来鼓励模型学习因果关系,并使用特定的网络结构来支持反事实推理。

🖼️ 关键图片

📊 实验亮点

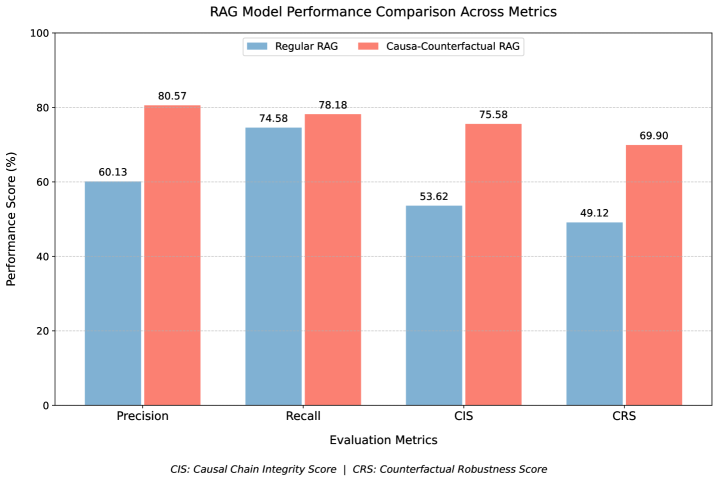

论文提出了Causal-Counterfactual RAG框架,通过将因果推理和反事实推理融入RAG,显著提升了知识密集型任务的性能。具体实验结果未知,但预期该方法在准确性、可解释性和减少幻觉方面优于传统RAG方法。未来的研究可以进一步探索不同因果图构建方法和反事实推理算法对性能的影响。

🎯 应用场景

Causal-Counterfactual RAG具有广泛的应用前景,例如在医疗诊断、金融分析、法律咨询等需要进行复杂推理的领域。它可以帮助用户更好地理解问题,做出更明智的决策。此外,该方法还可以用于提高聊天机器人的智能水平,使其能够进行更自然和流畅的对话,并提供更准确和有用的信息。

📄 摘要(原文)

Large language models (LLMs) have transformed natural language processing (NLP), enabling diverse applications by integrating large-scale pre-trained knowledge. However, their static knowledge limits dynamic reasoning over external information, especially in knowledge-intensive domains. Retrieval-Augmented Generation (RAG) addresses this challenge by combining retrieval mechanisms with generative modeling to improve contextual understanding. Traditional RAG systems suffer from disrupted contextual integrity due to text chunking and over-reliance on semantic similarity for retrieval, often resulting in shallow and less accurate responses. We propose Causal-Counterfactual RAG, a novel framework that integrates explicit causal graphs representing cause-effect relationships into the retrieval process and incorporates counterfactual reasoning grounded on the causal structure. Unlike conventional methods, our framework evaluates not only direct causal evidence but also the counterfactuality of associated causes, combining results from both to generate more robust, accurate, and interpretable answers. By leveraging causal pathways and associated hypothetical scenarios, Causal-Counterfactual RAG preserves contextual coherence, reduces hallucination, and enhances reasoning fidelity.