Towards Better Health Conversations: The Benefits of Context-seeking

作者: Rory Sayres, Yuexing Hao, Abbi Ward, Amy Wang, Beverly Freeman, Serena Zhan, Diego Ardila, Jimmy Li, I-Ching Lee, Anna Iurchenko, Siyi Kou, Kartikeya Badola, Jimmy Hu, Bhawesh Kumar, Keith Johnson, Supriya Vijay, Justin Krogue, Avinatan Hassidim, Yossi Matias, Dale R. Webster, Sunny Virmani, Yun Liu, Quang Duong, Mike Schaekermann

分类: cs.HC, cs.CL, cs.CY

发布日期: 2025-09-14

💡 一句话要点

提出Wayfinding AI,通过主动寻求上下文信息,改善LLM在健康咨询中的表现。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 健康咨询 大型语言模型 上下文信息 对话式AI Wayfinding AI

📋 核心要点

- 现有LLM在健康咨询中存在不准确、片面等问题,难以提供高质量的个性化建议。

- Wayfinding AI通过主动询问用户相关背景信息,更全面地了解用户需求,从而提供更精准的健康建议。

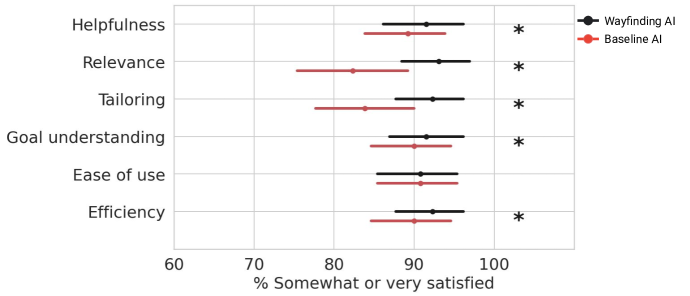

- 实验表明,Wayfinding AI在帮助性、相关性和个性化方面均优于基线AI,显著提升用户体验。

📝 摘要(中文)

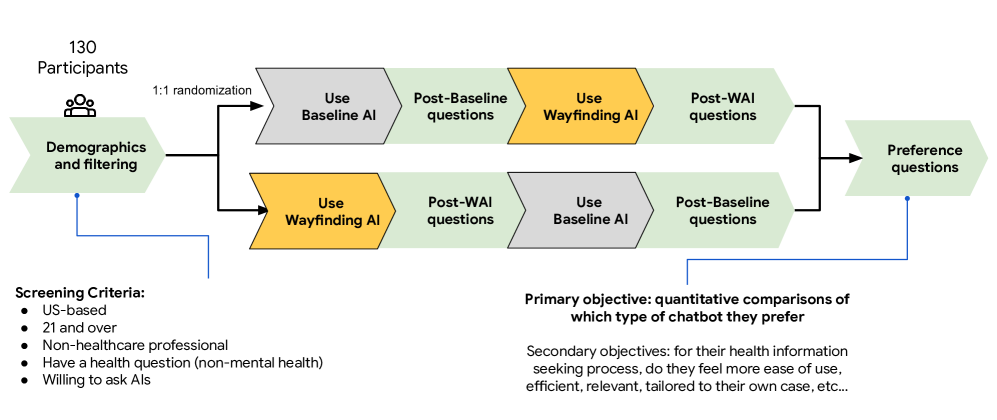

在现代信息环境中,人们在面对健康问题时常常感到困惑。大型语言模型(LLM)虽然可以提供定制化的信息,但也存在不准确、有偏见或误导的风险。本文通过四项混合方法研究(总样本量N=163),探讨了人们如何与LLM互动以解决自身健康问题。定性研究表明,在对话式AI中,寻求上下文信息以获取用户可能不会主动提供的具体细节至关重要。参与者认为LLM主动寻求上下文信息是有价值的,即使这意味着需要多次对话才能得到答案。基于这些发现,我们开发了一种“Wayfinding AI”,能够主动征求上下文信息。在一项随机、双盲研究中,参与者认为Wayfinding AI比基线AI更有帮助、更相关,并且更能满足他们的需求。这些结果表明,主动寻求上下文信息对对话动态具有显著影响,并为对话式AI在健康领域的应用提供了设计模式。

🔬 方法详解

问题定义:现有的大型语言模型在处理健康咨询问题时,往往因为缺乏足够的上下文信息,导致回答不够准确、个性化,甚至可能产生误导。用户可能不清楚哪些信息是重要的,或者不习惯主动提供所有相关细节。因此,如何让LLM在对话中主动获取必要的上下文信息,是提升健康咨询质量的关键问题。

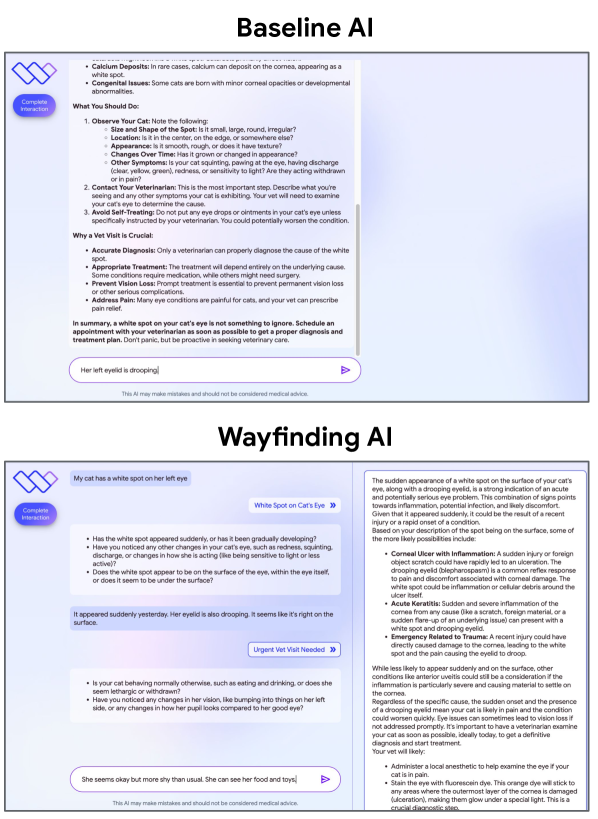

核心思路:本文的核心思路是让LLM具备主动寻求上下文信息的能力。通过设计一种“Wayfinding AI”,使其能够在对话过程中主动询问用户相关的背景信息,例如症状、病史、生活习惯等。这种主动式的交互方式可以帮助LLM更全面地了解用户的情况,从而提供更精准、个性化的健康建议。

技术框架:Wayfinding AI的整体框架主要包含以下几个模块:1) 意图识别模块:用于识别用户提出的健康问题类型;2) 上下文信息需求分析模块:根据问题类型,确定需要获取的上下文信息;3) 对话管理模块:负责生成问题,引导用户提供所需信息;4) 知识库查询模块:利用获取的上下文信息,从知识库中检索相关信息;5) 答案生成模块:根据检索到的信息,生成个性化的健康建议。

关键创新:该论文的关键创新在于将主动寻求上下文信息融入到对话式AI的设计中。与传统的被动式问答系统不同,Wayfinding AI能够主动引导用户提供必要的信息,从而更全面地了解用户需求。这种主动式的交互方式可以显著提升健康咨询的质量和用户体验。

关键设计:在对话管理模块中,设计了一系列问题模板,用于询问用户相关的背景信息。这些问题模板根据不同的健康问题类型进行定制,以确保能够获取到最关键的信息。此外,还采用了一种基于强化学习的策略,用于优化问题生成的顺序和内容,以提高信息获取的效率。

🖼️ 关键图片

📊 实验亮点

实验结果表明,与基线AI相比,Wayfinding AI在帮助性、相关性和个性化方面均有显著提升。具体而言,参与者认为Wayfinding AI提供的建议更贴合自身情况,更容易理解,并且更有助于解决他们的健康问题。这些结果验证了主动寻求上下文信息策略的有效性。

🎯 应用场景

该研究成果可应用于在线健康咨询平台、智能健康助手等领域,帮助用户更便捷地获取个性化的健康建议。通过主动寻求上下文信息,可以显著提升LLM在健康领域的应用价值,并有望改善人们的健康管理水平。未来,该技术还可以扩展到其他需要个性化服务的领域,如教育、金融等。

📄 摘要(原文)

Navigating health questions can be daunting in the modern information landscape. Large language models (LLMs) may provide tailored, accessible information, but also risk being inaccurate, biased or misleading. We present insights from 4 mixed-methods studies (total N=163), examining how people interact with LLMs for their own health questions. Qualitative studies revealed the importance of context-seeking in conversational AIs to elicit specific details a person may not volunteer or know to share. Context-seeking by LLMs was valued by participants, even if it meant deferring an answer for several turns. Incorporating these insights, we developed a "Wayfinding AI" to proactively solicit context. In a randomized, blinded study, participants rated the Wayfinding AI as more helpful, relevant, and tailored to their concerns compared to a baseline AI. These results demonstrate the strong impact of proactive context-seeking on conversational dynamics, and suggest design patterns for conversational AI to help navigate health topics.