SimpleQA Verified: A Reliable Factuality Benchmark to Measure Parametric Knowledge

作者: Lukas Haas, Gal Yona, Giovanni D'Antonio, Sasha Goldshtein, Dipanjan Das

分类: cs.CL

发布日期: 2025-09-09

💡 一句话要点

提出SimpleQA Verified,用于可靠评估LLM参数知识的事实性,并解决现有基准的不足。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 事实性评估 基准数据集 知识库 幻觉缓解

📋 核心要点

- 现有SimpleQA基准存在标签噪声、主题偏差和问题冗余等问题,影响了LLM事实性评估的准确性。

- 通过多阶段过滤,包括去重、主题平衡和来源协调,构建更可靠、更具挑战性的SimpleQA Verified基准。

- 实验表明,Gemini 2.5 Pro在SimpleQA Verified上取得了显著的F1分数提升,优于其他前沿模型。

📝 摘要(中文)

本文提出了SimpleQA Verified,一个包含1000个prompt的基准,用于评估大型语言模型(LLM)基于OpenAI SimpleQA的简短形式的事实性。它解决了OpenAI基准中的关键限制,包括噪声和不正确的标签、主题偏差和问题冗余。SimpleQA Verified是通过严格的多阶段过滤过程创建的,包括去重、主题平衡和来源协调,以产生更可靠和具有挑战性的评估集,以及改进的自动评估器prompt。在这个新的基准上,Gemini 2.5 Pro实现了55.6的最先进的F1分数,优于包括GPT-5在内的其他前沿模型。这项工作为研究界提供了一个更高保真度的工具,以跟踪参数模型事实性的真正进展并减轻幻觉。基准数据集、评估代码和排行榜可在https://www.kaggle.com/benchmarks/deepmind/simpleqa-verified获得。

🔬 方法详解

问题定义:现有SimpleQA基准在评估大型语言模型的事实性时存在诸多问题,包括标签噪声(错误标注)、主题偏差(某些主题过度代表)以及问题冗余(重复问题)。这些问题导致评估结果不可靠,难以准确反映模型的事实性水平。现有方法难以有效过滤和纠正这些问题,从而影响了对LLM的客观评价。

核心思路:SimpleQA Verified的核心思路是通过一个严格的多阶段过滤流程,对原始SimpleQA数据集进行清洗和优化,从而构建一个更高质量、更可靠的基准。该流程旨在消除噪声标签、平衡主题分布、去除冗余问题,并改进自动评估器prompt,从而提供更准确的事实性评估。

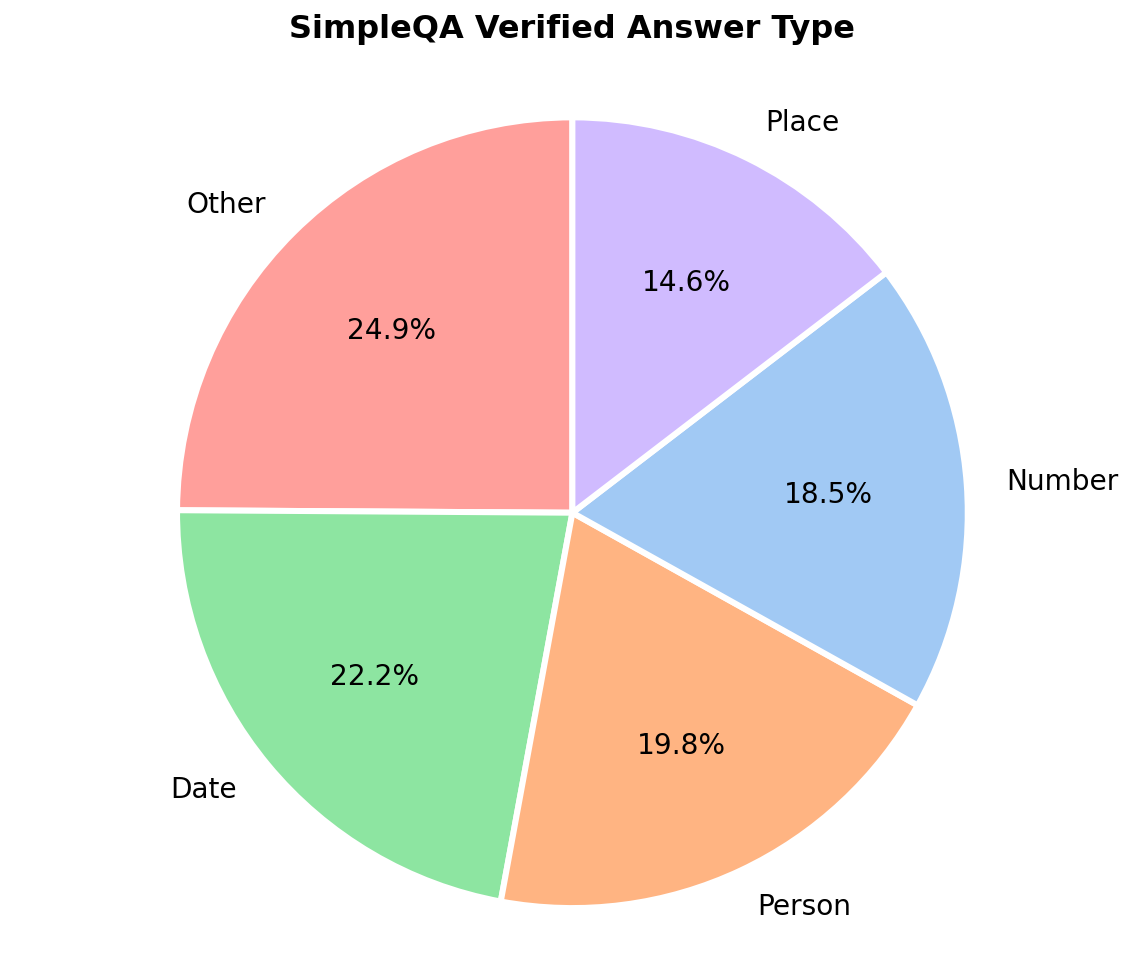

技术框架:SimpleQA Verified的构建流程主要包含以下几个阶段:1) 去重:删除重复的问题,避免模型在相同问题上重复训练或评估。2) 主题平衡:调整数据集的主题分布,确保各个主题的问题数量相对均衡,避免模型在某些主题上表现过度优秀。3) 来源协调:验证答案的来源,确保答案的准确性和可靠性,并纠正错误的标签。4) 改进自动评估器prompt:优化自动评估器的prompt,提高评估的准确性和一致性。

关键创新:SimpleQA Verified的关键创新在于其多阶段的过滤流程,该流程综合考虑了数据集的多个维度(噪声、偏差、冗余),并针对每个维度设计了相应的过滤策略。这种综合性的过滤方法能够更有效地提高数据集的质量,从而提供更可靠的事实性评估。与现有方法相比,SimpleQA Verified更加注重数据集的清洗和优化,而非仅仅依赖于模型的性能。

关键设计:在主题平衡阶段,可能使用了某种采样策略或加权方法,以确保各个主题的问题数量相对均衡。在来源协调阶段,可能使用了外部知识库或人工标注来验证答案的准确性。自动评估器prompt的改进可能涉及到prompt工程的技术,例如使用更清晰的指令、提供更多的上下文信息等。具体的参数设置、损失函数和网络结构等技术细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

Gemini 2.5 Pro在SimpleQA Verified上取得了55.6的F1分数,超越了包括GPT-5在内的其他前沿模型,证明了该基准的有效性和挑战性。这一结果表明,通过更严格的评估,可以更准确地衡量LLM的事实性水平,并推动模型性能的提升。

🎯 应用场景

SimpleQA Verified可用于评估和比较不同大型语言模型的事实性,帮助研究人员和开发者选择更可靠的模型。它还可用于检测和减轻LLM中的幻觉问题,提高模型在知识密集型任务中的性能。该基准的发布将促进LLM事实性研究的进展,并推动更可靠的AI系统的开发。

📄 摘要(原文)

We introduce SimpleQA Verified, a 1,000-prompt benchmark for evaluating Large Language Model (LLM) short-form factuality based on OpenAI's SimpleQA. It addresses critical limitations in OpenAI's benchmark, including noisy and incorrect labels, topical biases, and question redundancy. SimpleQA Verified was created through a rigorous multi-stage filtering process involving de-duplication, topic balancing, and source reconciliation to produce a more reliable and challenging evaluation set, alongside improvements in the autorater prompt. On this new benchmark, Gemini 2.5 Pro achieves a state-of-the-art F1-score of 55.6, outperforming other frontier models, including GPT-5. This work provides the research community with a higher-fidelity tool to track genuine progress in parametric model factuality and to mitigate hallucinations. The benchmark dataset, evaluation code, and leaderboard are available at: https://www.kaggle.com/benchmarks/deepmind/simpleqa-verified.