From Detection to Mitigation: Addressing Gender Bias in Chinese Texts via Efficient Tuning and Voting-Based Rebalancing

作者: Chengyan Wu, Yiqiang Cai, Yufei Cheng, Yun Xue

分类: cs.CL

发布日期: 2025-09-09

备注: NLPCC 2025

💡 一句话要点

提出基于LoRA微调和投票机制的中文性别偏见检测与缓解方法

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 性别偏见检测 自然语言处理 低秩适应 大型语言模型 数据重平衡 多专家投票 中文文本

📋 核心要点

- 现有方法在中文文本性别偏见检测中存在类别不平衡和泛化性不足的问题。

- 利用LoRA高效微调LLM,结合数据重平衡和多专家投票策略,提升检测性能。

- 实验表明,该方法在偏见检测、分类和缓解方面有效,并在NLPCC-2025任务中取得第四名。

📝 摘要(中文)

本文介绍了我们团队针对NLPCC-2025共享任务7的解决方案,该任务关注中文文本中句子级别的性别偏见检测与缓解。该任务旨在通过自动检测、分类和缓解性别偏见,来促进自然语言生成中的公平性和可控性。为了应对这一挑战,我们采用基于大型语言模型(LLM)的微调方法,并通过低秩适应(LoRA)高效地适应偏见检测任务。在数据处理方面,我们构建了一个更加平衡的训练集,以缓解类别不平衡问题,并引入来自多个来源的异构样本,以增强模型的泛化能力。对于检测和分类子任务,我们采用了一种多数投票策略,该策略集成了多个专家模型的输出,以提高性能。此外,为了改进偏见生成检测和缓解,我们设计了一种多温度采样机制,以捕获偏见表达风格的潜在变化。实验结果表明,我们的方法在偏见检测、分类和缓解方面是有效的。我们的方法最终获得了47.90%的平均分,在共享任务中排名第四。

🔬 方法详解

问题定义:该论文旨在解决中文文本中句子级别的性别偏见检测、分类和缓解问题。现有方法在处理中文性别偏见时,面临数据类别不平衡、模型泛化能力弱以及难以捕捉偏见表达多样性等痛点。这些问题限制了自然语言生成系统的公平性和可控性。

核心思路:论文的核心思路是利用大型语言模型强大的表示能力,通过高效的微调方法(LoRA)快速适应性别偏见检测任务。同时,通过数据重平衡策略缓解类别不平衡问题,并引入多源异构数据增强模型的泛化能力。此外,采用多专家投票机制和多温度采样策略,提高检测精度和捕捉偏见表达的多样性。

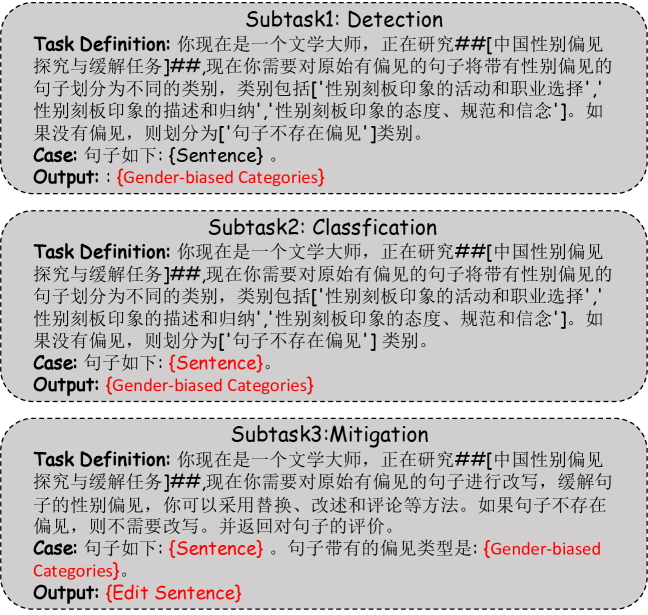

技术框架:整体框架包括以下几个主要模块:1) 数据预处理模块,负责构建平衡的训练集和引入异构数据;2) 模型微调模块,使用LoRA对大型语言模型进行高效微调;3) 偏见检测与分类模块,采用多专家模型和多数投票策略;4) 偏见生成检测与缓解模块,使用多温度采样机制。整个流程旨在提升模型在中文性别偏见检测、分类和缓解方面的性能。

关键创新:论文的关键创新点在于:1) 结合LoRA进行高效微调,降低了计算成本;2) 提出了一种基于多专家模型和多数投票的偏见检测与分类方法,提高了检测精度;3) 设计了一种多温度采样机制,能够捕捉偏见表达风格的潜在变化,从而提升偏见生成检测与缓解效果。

关键设计:在数据处理方面,论文构建了一个更加平衡的训练集,具体方法未知。在模型微调方面,采用了LoRA技术,具体参数设置未知。在偏见检测与分类方面,集成了多个专家模型,具体模型选择和集成方式未知。在偏见生成检测与缓解方面,设计了一种多温度采样机制,具体温度参数设置未知。损失函数未知。

🖼️ 关键图片

📊 实验亮点

该方法在NLPCC-2025共享任务7中取得了47.90%的平均分,排名第四。实验结果表明,所提出的LoRA微调、数据重平衡和多专家投票策略在偏见检测、分类和缓解方面均有效。虽然没有提供具体的性能提升数据,但整体排名证明了该方法的有效性。

🎯 应用场景

该研究成果可应用于自然语言生成、机器翻译、文本审核等领域,有助于构建更加公平、公正的AI系统。通过自动检测和缓解文本中的性别偏见,可以减少社会偏见在AI产品中的传播,提升用户体验,并促进社会公平。

📄 摘要(原文)

This paper presents our team's solution to Shared Task 7 of NLPCC-2025, which focuses on sentence-level gender bias detection and mitigation in Chinese. The task aims to promote fairness and controllability in natural language generation by automatically detecting, classifying, and mitigating gender bias. To address this challenge, we adopt a fine-tuning approach based on large language models (LLMs), efficiently adapt to the bias detection task via Low-Rank Adaptation (LoRA). In terms of data processing, we construct a more balanced training set to alleviate class imbalance and introduce heterogeneous samples from multiple sources to enhance model generalization. For the detection and classification sub-tasks, we employ a majority voting strategy that integrates outputs from multiple expert models to boost performance. Additionally, to improve bias generation detection and mitigation, we design a multi-temperature sampling mechanism to capture potential variations in bias expression styles. Experimental results demonstrate the effectiveness of our approach in bias detection, classification, and mitigation. Our method ultimately achieves an average score of 47.90%, ranking fourth in the shared task.