Are Humans as Brittle as Large Language Models?

作者: Jiahui Li, Sean Papay, Roman Klinger

分类: cs.CL, cs.HC

发布日期: 2025-09-09 (更新: 2025-11-07)

💡 一句话要点

研究表明人类在文本分类任务中对提示词变化的敏感性与大语言模型相似

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 提示词工程 文本分类 人类标注 鲁棒性 提示词脆弱性 对比实验

📋 核心要点

- 大型语言模型对提示词的微小变化非常敏感,但人类是否也如此敏感尚不明确。

- 该研究通过对比人类和LLM在文本分类任务中对提示词变化的反应,探究人类是否也存在提示词脆弱性。

- 实验表明,人类和LLM都对特定类型的提示词修改敏感,但人类对某些类型的错误(如拼写错误)更具鲁棒性。

📝 摘要(中文)

大型语言模型(LLM)的输出不稳定,这既是由于解码过程的非确定性,也是由于提示词的脆弱性。虽然LLM生成过程中的内在非确定性可能通过输出中的分布变化来模仿人类标注中已存在的的不确定性,但人们普遍认为,提示词脆弱性效应是LLM独有的,但这一点尚未得到探索。这就引出了一个问题:人类标注者是否也表现出对提示词变化的类似敏感性?如果是这样,LLM中的提示词脆弱性是否应该被认为是存在问题的?或者,另一种假设是,提示词脆弱性是否正确地反映了人类标注的差异?为了填补这一研究空白,我们系统地比较了提示词修改对LLM的影响,以及相同指令修改对人类标注者的影响,重点关注人类是否对提示词扰动表现出类似的敏感性。为此,我们提示人类和LLM执行一系列基于提示词变化的文本分类任务。我们的研究结果表明,人类和LLM都对特定类型的提示词修改表现出更高的脆弱性,特别是那些涉及替代标签集或标签格式的修改。然而,与LLM相比,人类判断的分布受印刷错误和标签顺序颠倒的影响较小。

🔬 方法详解

问题定义:大型语言模型(LLM)在文本分类任务中表现出对提示词的脆弱性,即提示词的微小变化可能导致输出结果的显著差异。现有研究主要关注LLM的这一特性,而忽略了人类标注者是否也存在类似的现象。因此,该研究旨在探究人类标注者在面对提示词变化时是否也表现出脆弱性,以及这种脆弱性与LLM相比有何异同。

核心思路:该研究的核心思路是通过对比实验,系统地评估人类标注者和LLM在面对不同类型的提示词修改时的表现。通过分析两者输出结果的分布变化,可以判断人类是否也存在提示词脆弱性,并进一步了解其特点。这种对比研究有助于更全面地理解LLM的脆弱性,并为改进LLM的鲁棒性提供新的视角。

技术框架:该研究的技术框架主要包括以下几个步骤:1. 选择一组文本分类任务;2. 设计一系列提示词修改方案,包括标签集替换、标签格式修改、印刷错误、标签顺序颠倒等;3. 提示人类标注者和LLM完成文本分类任务,并记录其输出结果;4. 分析人类和LLM输出结果的分布变化,评估其对提示词修改的敏感性;5. 对比人类和LLM的敏感性差异,并进行深入分析。

关键创新:该研究的关键创新在于首次系统地对比了人类标注者和LLM在面对提示词变化时的表现,揭示了人类也存在提示词脆弱性这一现象。此外,该研究还发现,人类和LLM对不同类型的提示词修改的敏感性存在差异,例如,人类对印刷错误更具鲁棒性。这些发现为理解LLM的脆弱性提供了新的视角,并为改进LLM的鲁棒性提供了新的思路。

关键设计:该研究的关键设计包括:1. 选择了多个文本分类任务,以提高研究结果的泛化性;2. 设计了多种类型的提示词修改方案,以全面评估人类和LLM的敏感性;3. 采用了统计分析方法,对人类和LLM的输出结果进行定量分析;4. 对人类和LLM的敏感性差异进行了深入分析,并提出了可能的解释。

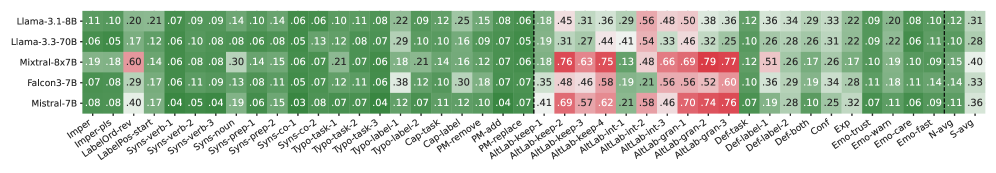

🖼️ 关键图片

📊 实验亮点

实验结果表明,人类和LLM都对特定类型的提示词修改表现出更高的脆弱性,特别是那些涉及替代标签集或标签格式的修改。然而,与LLM相比,人类判断的分布受印刷错误和标签顺序颠倒的影响较小。这表明,虽然人类也存在提示词脆弱性,但其鲁棒性在某些方面优于LLM。

🎯 应用场景

该研究成果可应用于提升大语言模型在实际应用中的鲁棒性,例如在对话系统、文本摘要、机器翻译等领域。通过了解人类和LLM对提示词变化的敏感性差异,可以设计更有效的提示工程方法,减少LLM输出的不确定性,提高其可靠性和实用性。此外,该研究也为评估和改进人类标注质量提供了新的思路。

📄 摘要(原文)

The output of large language models (LLMs) is unstable, due both to non-determinism of the decoding process as well as to prompt brittleness. While the intrinsic non-determinism of LLM generation may mimic existing uncertainty in human annotations through distributional shifts in outputs, it is largely assumed, yet unexplored, that the prompt brittleness effect is unique to LLMs. This raises the question: do human annotators show similar sensitivity to prompt changes? If so, should prompt brittleness in LLMs be considered problematic? One may alternatively hypothesize that prompt brittleness correctly reflects human annotation variances. To fill this research gap, we systematically compare the effects of prompt modifications on LLMs and identical instruction modifications for human annotators, focusing on the question of whether humans are similarly sensitive to prompt perturbations. To study this, we prompt both humans and LLMs for a set of text classification tasks conditioned on prompt variations. Our findings indicate that both humans and LLMs exhibit increased brittleness in response to specific types of prompt modifications, particularly those involving the substitution of alternative label sets or label formats. However, the distribution of human judgments is less affected by typographical errors and reversed label order than that of LLMs.