MoGU V2: Toward a Higher Pareto Frontier Between Model Usability and Security

作者: Yanrui Du, Fenglei Fan, Sendong Zhao, Jiawei Cao, Ting Liu, Bing Qin

分类: cs.CL

发布日期: 2025-09-08

💡 一句话要点

MoGU V2:提升LLM可用性与安全性帕累托前沿的框架

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 安全性 可用性 动态路由 帕累托前沿

📋 核心要点

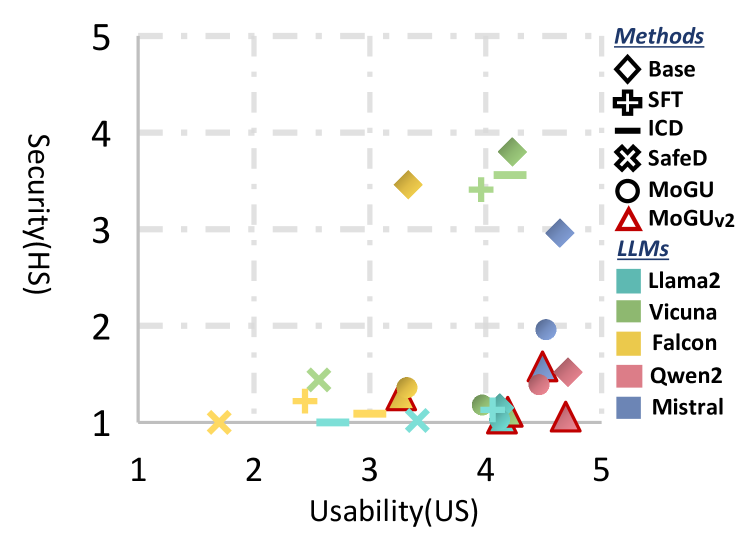

- 现有LLM安全方法常以牺牲可用性为代价,导致模型过于保守,无法满足实际应用需求。

- MoGU V2通过更紧密耦合的路由器和隐藏状态,动态平衡安全优化和可用性优化,提升帕累托前沿。

- MoGU V2在多种LLM上表现出强大的适应性和安全性,且能通过数据混合策略抵御指令微调带来的安全风险。

📝 摘要(中文)

随着大型语言模型(LLMs)日益普及,其安全性问题日益突出,特别是对恶意指令保持无害响应的能力。虽然现有方法在提高LLMs安全性方面取得进展,但往往导致保守的、以拒绝为主的响应,从而损害了实际可用性。这带来了一个关键挑战:如何在LLMs的可用性和安全性之间提升帕累托前沿,而不是进行权衡。为了解决这个问题,我们提出了MoGU框架,该框架通过层内路由器动态分配权重,从而平衡了安全优化和可用性优化变体的贡献。针对MoGU框架的参数冗余和性能瓶颈等局限性,我们进一步提出了改进的MoGU_v2框架,该框架建立了路由器和隐藏状态之间更紧密的耦合。在MoGU_v2中,路由器仅嵌入在编码高度可分类安全特征的层中,并且在路由器优化期间激活骨干模块以实现双向适应。MoGU_V2在各种LLMs系列中表现出强大的适应性和稳定的改进,包括主流LLMs、设备端LLMs和推理LLMs。同时,即使面对指令微调带来的风险,MoGU_v2也可以通过简单的数据混合策略轻松恢复安全性,而不会影响任务性能的提升。这些全面的改进突显了MoGU_V2作为一种强大而通用的解决方案,可用于缓解实际应用中的安全风险。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在安全性和可用性之间难以兼顾的问题。现有方法通常通过安全优化来提高LLMs的安全性,但往往会导致模型过于保守,拒绝许多正常请求,从而降低了可用性。因此,如何在保证安全性的前提下,尽可能提高LLMs的可用性,是本研究要解决的核心问题。

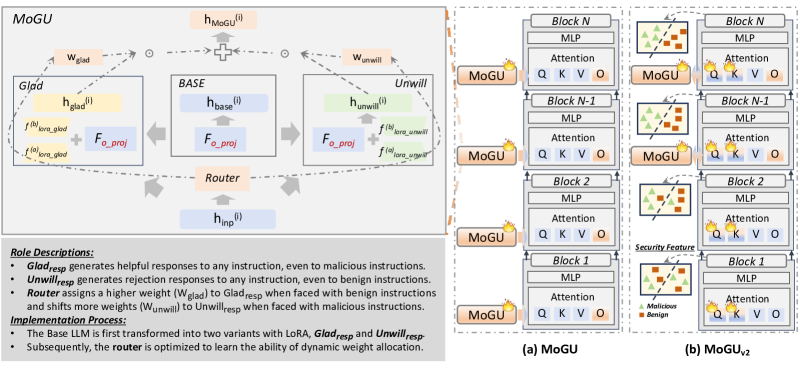

核心思路:MoGU V2的核心思路是通过动态路由机制,在模型的不同层中,根据输入和隐藏状态,自适应地选择安全优化和可用性优化的模块。这样,模型可以根据具体情况,灵活地调整安全性和可用性的权重,从而在两者之间取得更好的平衡。

技术框架:MoGU V2框架主要包含以下几个关键模块:1) 骨干网络(Backbone Modules):可以是各种主流的LLM架构。2) 路由器(Routers):位于骨干网络的特定层中,根据隐藏状态动态分配权重。3) 安全优化模块:旨在提高模型的安全性,例如通过对抗训练或安全微调。4) 可用性优化模块:旨在提高模型的可用性,例如通过指令微调或数据增强。在推理过程中,输入首先通过骨干网络,然后路由器根据隐藏状态计算权重,并将权重分配给安全优化模块和可用性优化模块,最终得到模型的输出。

关键创新:MoGU V2的关键创新在于路由器与隐藏状态的紧密耦合以及双向适应机制。与MoGU相比,MoGU V2将路由器嵌入到编码高度可分类安全特征的层中,减少了参数冗余和性能瓶颈。此外,在路由器优化期间,激活骨干模块,使得路由器和骨干网络可以相互适应,从而提高了模型的整体性能。

关键设计:MoGU V2的关键设计包括:1) 路由器位置的选择:选择编码高度可分类安全特征的层,可以更有效地利用路由器来平衡安全性和可用性。2) 路由器激活策略:在路由器优化期间激活骨干模块,可以实现双向适应,提高模型性能。3) 数据混合策略:通过混合原始数据和安全数据,可以有效地恢复指令微调带来的安全风险,同时保持任务性能的提升。

🖼️ 关键图片

📊 实验亮点

实验结果表明,MoGU V2 在各种LLM系列中表现出强大的适应性和稳定的改进。即使面对指令微调带来的风险,MoGU V2 也可以通过简单的数据混合策略轻松恢复安全性,而不会影响任务性能的提升。这些结果表明,MoGU V2 是一种强大而通用的解决方案,可用于缓解实际应用中的安全风险。

🎯 应用场景

MoGU V2 具有广泛的应用前景,可用于各种需要兼顾安全性和可用性的LLM应用场景。例如,它可以应用于智能客服、聊天机器人、内容生成等领域,在保证模型能够生成高质量内容的同时,防止模型被恶意利用,生成有害信息。此外,MoGU V2 还可以应用于设备端LLM,在资源受限的环境下,实现安全性和可用性的平衡。

📄 摘要(原文)

As Large Language Models (LLMs) increasingly permeate human life, their security has emerged as a critical concern, particularly their ability to maintain harmless responses to malicious instructions. Although extensive methods have improved LLMs' security, they often lead to conservative, rejection-oriented responses that compromise practical usability. This presents a key challenge: how to advance the Pareto frontier between LLMs' usability and security, rather than necessitate a trade-off between them. To address this, we propose the MoGU framework, in which the intra-layer router dynamically allocates weights by sensing hidden states, thereby balancing the contributions of security-optimized and usability-optimized variants. Despite its initial potential, the MoGU framework faces limitations such as parameter redundancy and performance bottlenecks. To overcome these, we further propose an improved MoGU_v2 framework that establishes a tighter coupling between the routers and hidden states. In MoGU_v2, routers are embedded only in layers encoding highly classifiable security features, and backbone modules are activated during router optimization to enable bidirectional adaptation. MoGU_V2 exhibits strong adaptability and stable improvements across various series of LLMs, including mainstream LLMs serving as brains in various applications, on-device LLMs optimized for resource-constrained scenarios, and reasoning LLMs tailored for user interpretability. Meanwhile, even facing risks introduced by Instruction Fine-tuning, MoGU_v2 can easily restore security without compromising the task performance gains via a simple data-mix strategy. These comprehensive improvements highlight MoGU_V2 as a robust and versatile solution for mitigating security risks in real-world applications.