Cross-Question Method Reuse in Large Language Models: From Word-Level Prediction to Rational Logical-Layer Reasoning

作者: Hong Su

分类: cs.CL

发布日期: 2025-09-06 (更新: 2025-10-16)

💡 一句话要点

提出跨问题方法复用框架,扩展大语言模型在低相似度问题上的应用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 方法复用 跨问题学习 解决方案迁移 低相似度问题

📋 核心要点

- 现有方法复用依赖问题的高度相似性,限制了其应用范围,尤其是在处理语义关联隐蔽的问题时。

- 该论文提出分离问题和解决方案,引导LLM专注于解决方案的迁移和适应,而非直接依赖问题识别。

- 实验结果表明,该方法能够有效过滤可复用的解决方案,提升跨问题方法复用的整体效果。

📝 摘要(中文)

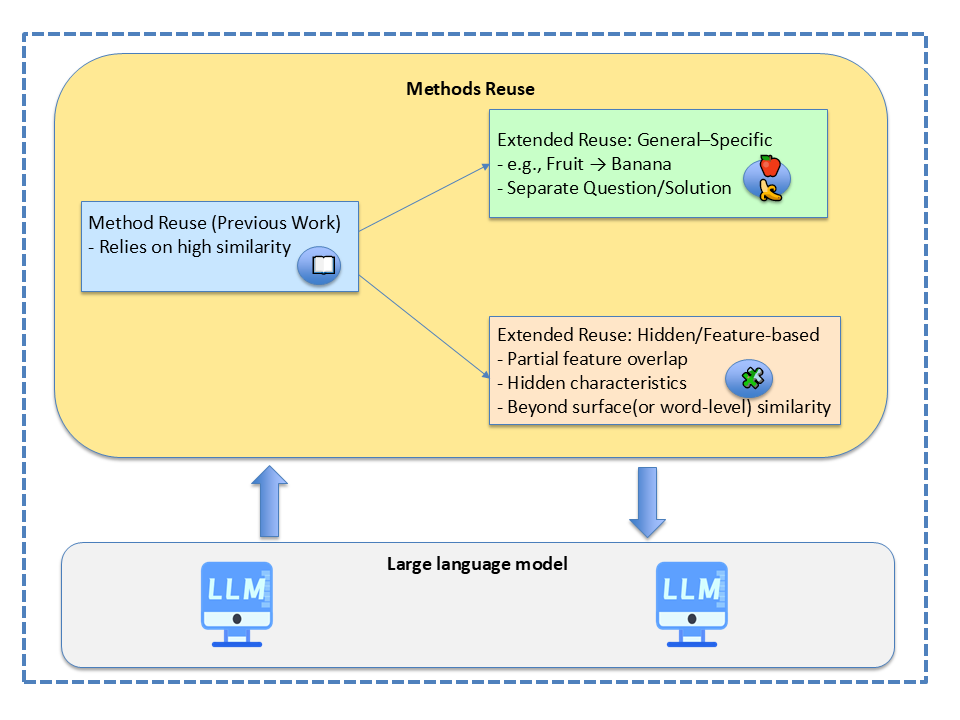

大型语言模型(LLMs)已被广泛应用于辅助解决各种问题。先前的工作提出了将方法表示为问题及其对应解决方案的配对,从而实现方法复用。然而,现有方法通常要求问题具有高度相似性。本文扩展了方法复用的范围,以解决相似度较低或具有未明确观察到的隐藏相似性的问题。对于具有一般-特定意义(即范围更广或更窄)的问题,我们建议首先分离问题和解决方案,而不是直接将配对输入LLM。然后引导LLM将解决方案适应新的但相关的问题,使其专注于解决方案的转移而不是问题识别。此外,我们将此方法扩展到问题仅共享部分特征或隐藏特征的情况。这使得跨问题的方法复用超越了传统的相似性约束。实验验证表明,我们的范围扩展方法增加了过滤可复用解决方案的概率,从而提高了跨问题方法复用的有效性。

🔬 方法详解

问题定义:现有的大语言模型方法复用技术,依赖于问题之间的高度相似性。当问题之间的相似度较低,或者存在隐藏的、不易察觉的相似性时,现有方法的效果会显著下降。这限制了方法复用的应用范围,尤其是在需要处理具有一定泛化能力的问题时。现有方法难以有效识别和利用这些潜在的相似性,导致方法复用效率低下。

核心思路:该论文的核心思路是将问题和解决方案进行解耦,不再直接将问题-解决方案对输入到大语言模型中。而是首先将问题和解决方案分离,然后引导大语言模型专注于将已有的解决方案迁移和适配到新的问题上。通过这种方式,模型可以更加关注解决方案的本质,而减少对问题表面相似性的依赖。

技术框架:该方法主要包含以下几个阶段:1) 问题和解决方案分离:将已有的问题-解决方案对进行解耦。2) 问题分析:分析新问题的特点,确定其与已有问题的潜在关联。3) 解决方案迁移:引导大语言模型将已有的解决方案迁移到新问题上,并进行必要的调整和适配。4) 解决方案验证:验证迁移后的解决方案在新问题上的有效性。

关键创新:该论文的关键创新在于提出了跨问题的方法复用框架,该框架能够处理低相似度或具有隐藏相似性的问题。与现有方法相比,该方法不再依赖于问题之间的表面相似性,而是通过解耦问题和解决方案,引导大语言模型专注于解决方案的迁移和适配,从而提高了方法复用的效率和泛化能力。

关键设计:具体的技术细节包括:如何有效地分离问题和解决方案(例如,使用自然语言处理技术提取问题的关键特征和解决方案的核心逻辑);如何引导大语言模型进行解决方案的迁移和适配(例如,使用提示学习或微调技术);以及如何验证迁移后的解决方案的有效性(例如,使用自动评估指标或人工评估)。论文中可能还涉及一些超参数的设置,例如学习率、batch size等,这些参数需要根据具体的实验数据进行调整。

🖼️ 关键图片

📊 实验亮点

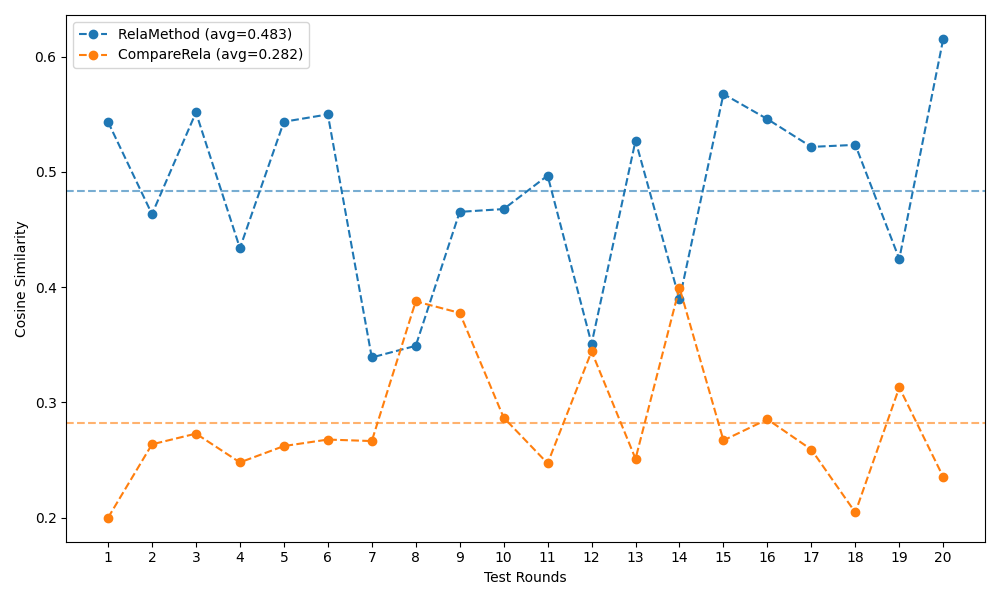

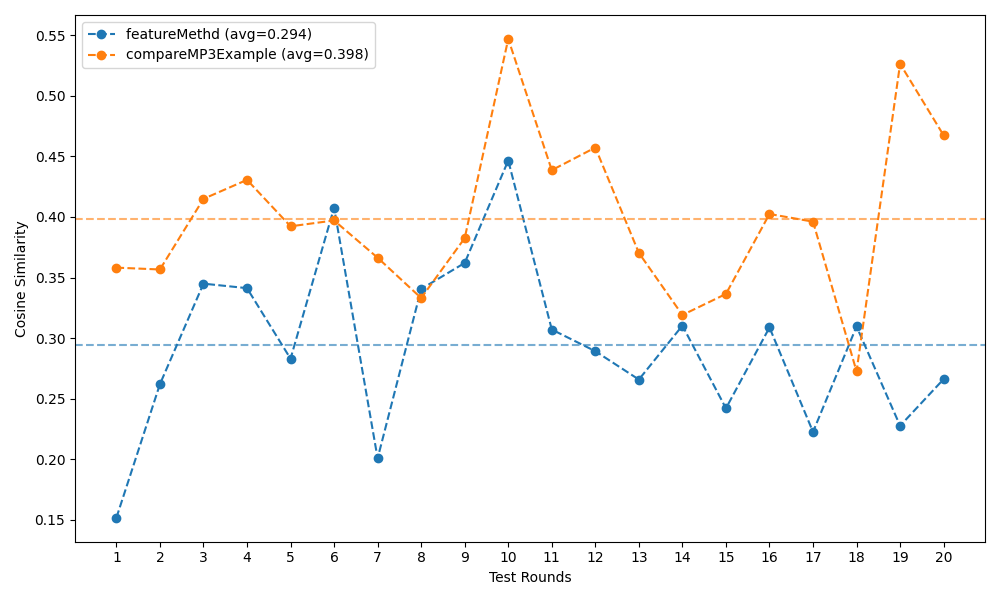

论文通过实验验证了所提出的跨问题方法复用框架的有效性。实验结果表明,该方法能够显著提高过滤可复用解决方案的概率,从而提升跨问题方法复用的整体效果。具体的性能数据和对比基线信息需要在论文中查找,以便进行更精确的总结。

🎯 应用场景

该研究成果可应用于智能问答系统、代码生成、机器人任务规划等领域。通过跨问题方法复用,可以显著提高大语言模型在处理复杂问题时的效率和准确性,降低开发成本,加速人工智能技术的落地应用。未来,该方法有望扩展到更多领域,例如医疗诊断、金融分析等。

📄 摘要(原文)

Large language models (LLMs) have been widely applied to assist in finding solutions for diverse questions. Prior work has proposed representing a method as a pair of a question and its corresponding solution, enabling method reuse. However, existing approaches typically require the questions to be highly similar. In this paper, we extend the scope of method reuse to address questions with low similarity or with hidden similarities that are not explicitly observable. For questions that are similar in a general-specific sense (i.e., broader or narrower in scope), we propose to first separate the question and solution, rather than directly feeding the pair to the LLM. The LLM is then guided to adapt the solution to new but related questions, allowing it to focus on solution transfer rather than question recognition. Furthermore, we extend this approach to cases where questions only share partial features or hidden characteristics. This enables cross-question method reuse beyond conventional similarity constraints. Experimental verification shows that our scope-extension approach increases the probability of filtering out reusable solutions, thereby improving the effectiveness of cross-question method reuse.