HoPE: Hyperbolic Rotary Positional Encoding for Stable Long-Range Dependency Modeling in Large Language Models

作者: Chang Dai, Hongyu Shan, Mingyang Song, Di Liang

分类: cs.CL, cs.AI

发布日期: 2025-09-05 (更新: 2025-09-08)

💡 一句话要点

提出HoPE:一种用于稳定长程依赖建模的双曲旋转位置编码

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 位置编码 长程依赖 Transformer 双曲几何 洛伦兹变换

📋 核心要点

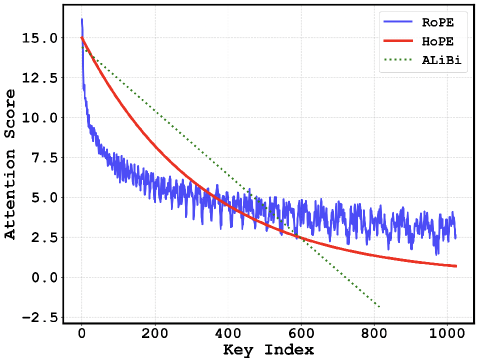

- 现有位置编码方法在处理长文本时面临挑战,绝对位置编码外推性差,RoPE存在振荡问题,影响长程依赖建模的稳定性。

- HoPE通过引入双曲几何中的洛伦兹变换,利用双曲函数实现token表示的旋转,从而解决RoPE的振荡问题,保证注意力权重的单调衰减。

- 实验结果表明,HoPE在长序列建模任务中,性能优于现有位置编码方法,能够更好地表示和泛化长程依赖关系。

📝 摘要(中文)

位置编码机制使Transformer能够对文本中的序列结构和长程依赖关系进行建模。然而,绝对位置编码由于固定的位置表示,难以推广到更长的序列;而像Alibi这样的相对方法在极长的上下文中表现出性能下降。广泛使用的旋转位置编码(RoPE)引入了振荡的注意力模式,阻碍了稳定的长距离依赖建模。为了解决这些限制,我们通过对位置编码进行几何重构。受到双曲几何中洛伦兹变换的启发,我们提出了双曲旋转位置编码(HoPE),它利用双曲函数对token表示执行洛伦兹旋转。理论分析表明,RoPE是我们提出的广义公式的一个特例。HoPE通过强制注意力权重随token距离的增加而单调衰减,从根本上解决了RoPE的振荡问题。大量的实验结果,包括在几个扩展序列基准下的困惑度评估,表明HoPE始终优于现有的位置编码方法。这些发现强调了HoPE在表示和推广长程依赖关系方面的增强能力。数据和代码将会公开。

🔬 方法详解

问题定义:现有Transformer模型中的位置编码方法在处理超长文本时存在问题。绝对位置编码难以泛化到训练长度之外的序列,而RoPE虽然常用,但其固有的旋转特性导致注意力权重出现振荡,不利于模型学习稳定的长距离依赖关系。这种振荡会干扰模型对重要信息的关注,降低长文本建模的准确性。

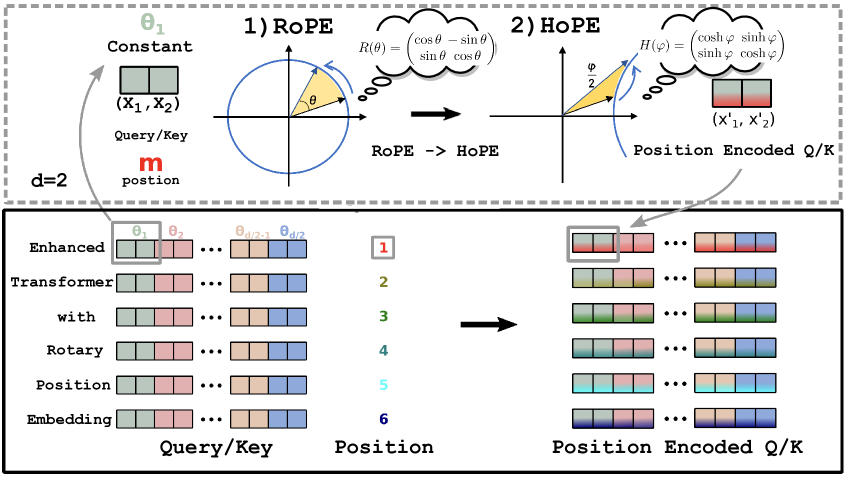

核心思路:HoPE的核心思路是借鉴双曲几何中的洛伦兹变换,将位置编码问题转化为在双曲空间中的旋转操作。通过使用双曲函数,HoPE能够实现注意力权重的单调衰减,避免RoPE中的振荡现象。这种单调衰减的设计符合直觉,即距离越远的token,其相关性应该越弱。

技术框架:HoPE的整体框架与标准的Transformer模型兼容,主要改进在于位置编码模块。HoPE取代了RoPE,作为Transformer的输入。具体来说,对于每个token的表示,HoPE使用双曲函数对其进行洛伦兹旋转,从而引入位置信息。旋转后的token表示被输入到Transformer的后续层进行处理。

关键创新:HoPE最重要的创新在于其将位置编码问题与双曲几何联系起来,并利用洛伦兹变换实现了注意力权重的单调衰减。与RoPE相比,HoPE避免了注意力权重的振荡,从而提高了模型学习长距离依赖关系的能力。此外,论文还证明RoPE是HoPE的一个特例,表明HoPE具有更强的泛化能力。

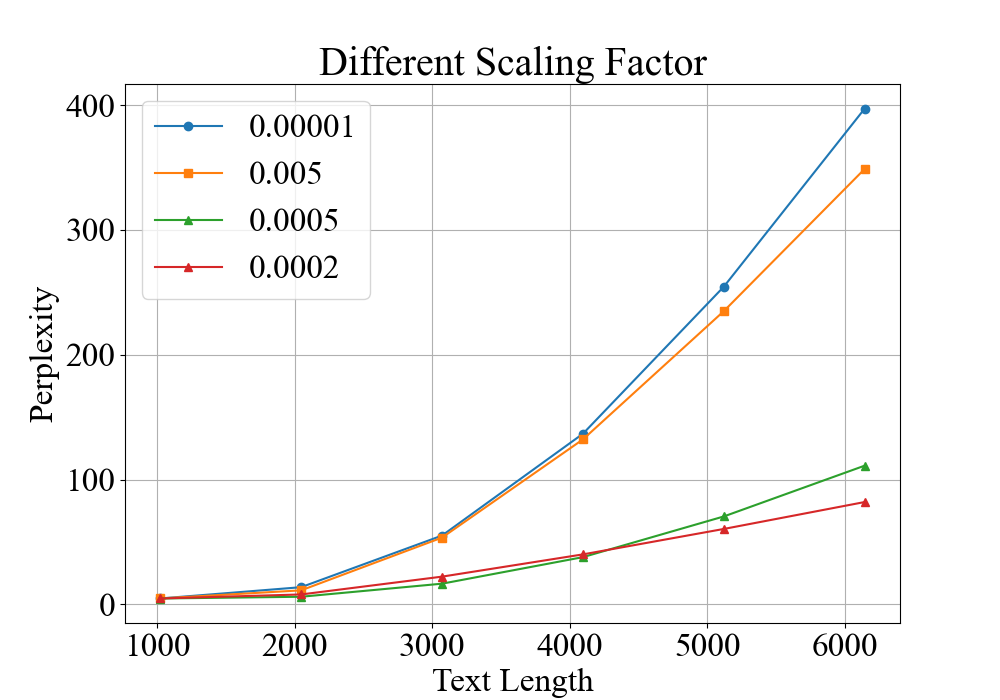

关键设计:HoPE的关键设计在于双曲函数的选择和洛伦兹旋转的实现。论文中具体选择了sinh和cosh等双曲函数,并设计了相应的旋转矩阵。这些参数的选择需要仔细调整,以保证注意力权重的单调衰减和模型的性能。此外,HoPE的实现还需要考虑计算效率,以避免引入过多的计算开销。

🖼️ 关键图片

📊 实验亮点

实验结果表明,HoPE在多个长序列基准测试中,包括困惑度评估,始终优于现有的位置编码方法。具体来说,HoPE在某些任务上取得了显著的性能提升,表明其在表示和泛化长程依赖关系方面具有更强的能力。这些结果验证了HoPE的有效性,并表明其是一种有前景的长文本建模方法。

🎯 应用场景

HoPE具有广泛的应用前景,尤其是在需要处理长文本的领域,例如长文档摘要、机器翻译、对话系统和代码生成等。通过提高模型对长距离依赖关系的建模能力,HoPE可以帮助模型更好地理解长文本的语义,从而提高这些应用的性能。此外,HoPE还可以应用于其他序列建模任务,例如语音识别和时间序列分析。

📄 摘要(原文)

Positional encoding mechanisms enable Transformers to model sequential structure and long-range dependencies in text. While absolute positional encodings struggle with extrapolation to longer sequences due to fixed positional representations, and relative approaches like Alibi exhibit performance degradation on extremely long contexts, the widely-used Rotary Positional Encoding (RoPE) introduces oscillatory attention patterns that hinder stable long-distance dependency modelling. We address these limitations through a geometric reformulation of positional encoding. Drawing inspiration from Lorentz transformations in hyperbolic geometry, we propose Hyperbolic Rotary Positional Encoding (HoPE), which leverages hyperbolic functions to implement Lorentz rotations on token representations. Theoretical analysis demonstrates that RoPE is a special case of our generalized formulation. HoPE fundamentally resolves RoPE's slation issues by enforcing monotonic decay of attention weights with increasing token distances. Extensive experimental results, including perplexity evaluations under several extended sequence benchmarks, show that HoPE consistently exceeds existing positional encoding methods. These findings underscore HoPE's enhanced capacity for representing and generalizing long-range dependencies. Data and code will be available.