Triadic Fusion of Cognitive, Functional, and Causal Dimensions for Explainable LLMs: The TAXAL Framework

作者: David Herrera-Poyatos, Carlos Peláez-González, Cristina Zuheros, Virilo Tejedor, Rosana Montes, Francisco Herrera

分类: cs.CL

发布日期: 2025-09-05

备注: 27 pages, 9 tables and 2 figures

💡 一句话要点

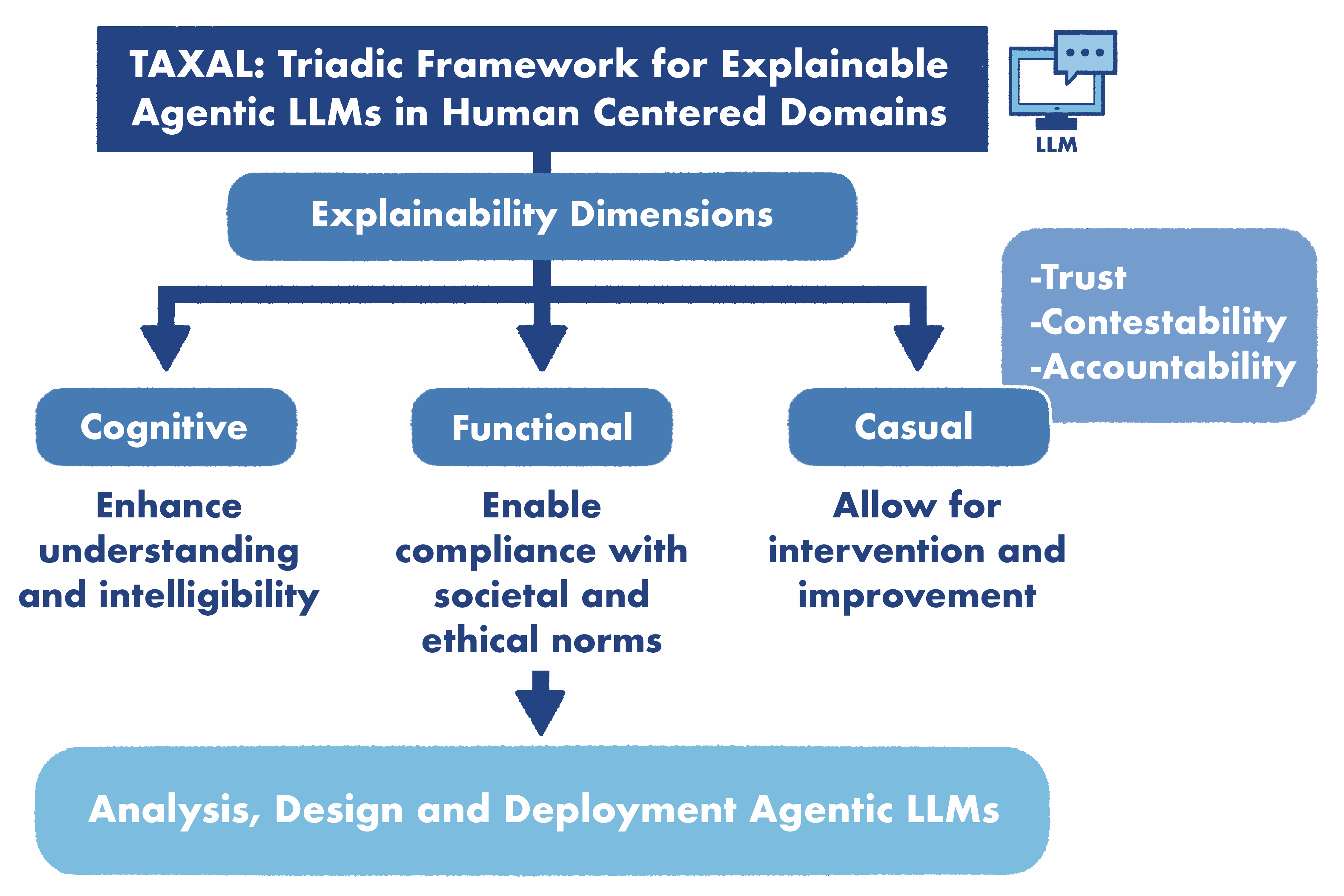

TAXAL框架:融合认知、功能和因果维度,提升Agentic LLM的可解释性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 可解释性AI 大型语言模型 Agentic LLM 三元融合 认知维度

📋 核心要点

- 现有LLM可解释性方法侧重表面输出,无法捕捉深层推理和规划逻辑,导致信任问题。

- TAXAL框架融合认知、功能和因果三个维度,为Agentic LLM提供统一的可解释性基础。

- 通过案例研究展示了TAXAL在法律、教育等领域的适用性,并强调了解释策略需适应具体场景。

📝 摘要(中文)

大型语言模型(LLMs)越来越多地部署在高风险领域,但其不透明性、偏见和不稳定性削弱了信任和责任。传统的解释方法侧重于表面输出,无法捕捉Agentic LLM的推理路径、规划逻辑和系统性影响。本文提出了TAXAL(Agentic LLM可解释性的三元对齐)框架,它融合了三个互补的维度:认知(用户理解)、功能(实际效用)和因果(忠实推理)。TAXAL为在不同的社会技术环境中设计、评估和部署解释提供了一个统一的、角色敏感的基础。本文综合了现有的方法,从事后归因和对话界面到解释感知的提示,并将它们置于TAXAL三元融合模型中。通过法律、教育、医疗保健和公共服务领域的案例研究,进一步展示了其适用性,表明了解释策略如何适应制度约束和利益相关者的角色。通过将概念清晰度与设计模式和部署路径相结合,TAXAL将可解释性提升为一种技术和社会技术实践,支持在Agentic AI时代中值得信赖且上下文敏感的LLM应用。

🔬 方法详解

问题定义:现有的大型语言模型(LLMs)在可解释性方面存在不足,尤其是在Agentic LLM中,其推理过程、规划逻辑以及系统性影响难以被理解。传统的解释方法主要关注模型的表面输出,例如通过事后归因来解释模型的决策,但这些方法无法提供关于模型内部运作机制的深入洞察,导致用户难以信任和理解这些模型。因此,如何提升Agentic LLM的可解释性,使其在各个领域得到更广泛的应用,是一个亟待解决的问题。

核心思路:TAXAL框架的核心思路是将可解释性分解为三个互补的维度:认知、功能和因果。认知维度关注用户对解释的理解程度,功能维度关注解释的实际效用,而因果维度关注解释对模型推理过程的忠实程度。通过融合这三个维度,TAXAL旨在提供一个全面且角色敏感的可解释性框架,从而满足不同用户在不同场景下的需求。这种设计思路旨在弥补传统解释方法只关注表面输出的不足,提供更深入、更可靠的解释。

技术框架:TAXAL框架的整体架构包含三个主要模块,分别对应认知、功能和因果三个维度。首先,认知模块负责评估用户对解释的理解程度,例如通过用户调查或眼动追踪等方法来衡量用户是否能够理解解释的内容。其次,功能模块负责评估解释的实际效用,例如通过评估解释是否能够帮助用户做出更好的决策或提高工作效率。最后,因果模块负责评估解释对模型推理过程的忠实程度,例如通过因果推理方法来验证解释是否能够准确地反映模型的内部运作机制。这三个模块相互协作,共同提升Agentic LLM的可解释性。

关键创新:TAXAL框架最重要的技术创新点在于其三元融合的设计理念。与传统的只关注表面输出的解释方法不同,TAXAL框架将可解释性分解为认知、功能和因果三个维度,并提出了相应的评估方法。这种三元融合的设计理念能够更全面地评估可解释性的各个方面,从而提供更深入、更可靠的解释。此外,TAXAL框架还强调了角色敏感性,即根据不同用户的需求和背景来定制解释策略,从而更好地满足用户的需求。

关键设计:TAXAL框架的关键设计包括以下几个方面:首先,认知模块采用了用户调查和眼动追踪等方法来评估用户对解释的理解程度。其次,功能模块采用了决策评估和效率评估等方法来评估解释的实际效用。最后,因果模块采用了因果推理方法来验证解释对模型推理过程的忠实程度。此外,TAXAL框架还采用了解释感知的提示技术,即在模型生成解释时,考虑到认知、功能和因果三个维度,从而生成更全面、更可靠的解释。

🖼️ 关键图片

📊 实验亮点

论文通过在法律、教育、医疗保健和公共服务领域的案例研究,展示了TAXAL框架的适用性。研究表明,TAXAL框架能够根据不同领域的特点和用户的需求,定制不同的解释策略,从而更好地满足用户的需求。虽然论文没有提供具体的性能数据和对比基线,但通过案例研究证明了TAXAL框架在提升Agentic LLM可解释性方面的潜力。

🎯 应用场景

TAXAL框架具有广泛的应用前景,尤其是在法律、教育、医疗保健和公共服务等高风险领域。它可以帮助律师更好地理解AI系统的决策过程,从而更好地为客户辩护;可以帮助教师更好地利用AI系统进行个性化教学;可以帮助医生更好地利用AI系统进行疾病诊断和治疗;可以帮助政府更好地利用AI系统提供公共服务。TAXAL框架的实际价值在于提升了AI系统的透明度和可信度,从而促进了AI技术在各个领域的应用。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly being deployed in high-risk domains where opacity, bias, and instability undermine trust and accountability. Traditional explainability methods, focused on surface outputs, do not capture the reasoning pathways, planning logic, and systemic impacts of agentic LLMs. We introduce TAXAL (Triadic Alignment for eXplainability in Agentic LLMs), a triadic fusion framework that unites three complementary dimensions: cognitive (user understanding), functional (practical utility), and causal (faithful reasoning). TAXAL provides a unified, role-sensitive foundation for designing, evaluating, and deploying explanations in diverse sociotechnical settings. Our analysis synthesizes existing methods, ranging from post-hoc attribution and dialogic interfaces to explanation-aware prompting, and situates them within the TAXAL triadic fusion model. We further demonstrate its applicability through case studies in law, education, healthcare, and public services, showing how explanation strategies adapt to institutional constraints and stakeholder roles. By combining conceptual clarity with design patterns and deployment pathways, TAXAL advances explainability as a technical and sociotechnical practice, supporting trustworthy and context-sensitive LLM applications in the era of agentic AI.