Chain or tree? Re-evaluating complex reasoning from the perspective of a matrix of thought

作者: Fengxiao Tang, Yufeng Li, Zongzong Wu, Ming Zhao

分类: cs.CL, cs.AI

发布日期: 2025-09-04 (更新: 2025-09-26)

🔗 代码/项目: GITHUB

💡 一句话要点

提出矩阵思维(MoT)框架,提升LLM在复杂推理任务中的效率与准确性

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 复杂推理 矩阵思维 知识图谱 检索增强生成

📋 核心要点

- 现有思维链(CoT)和思维树(ToT)等方法在复杂推理中存在冗余和路径单一等问题,且易受检索到的错误知识误导。

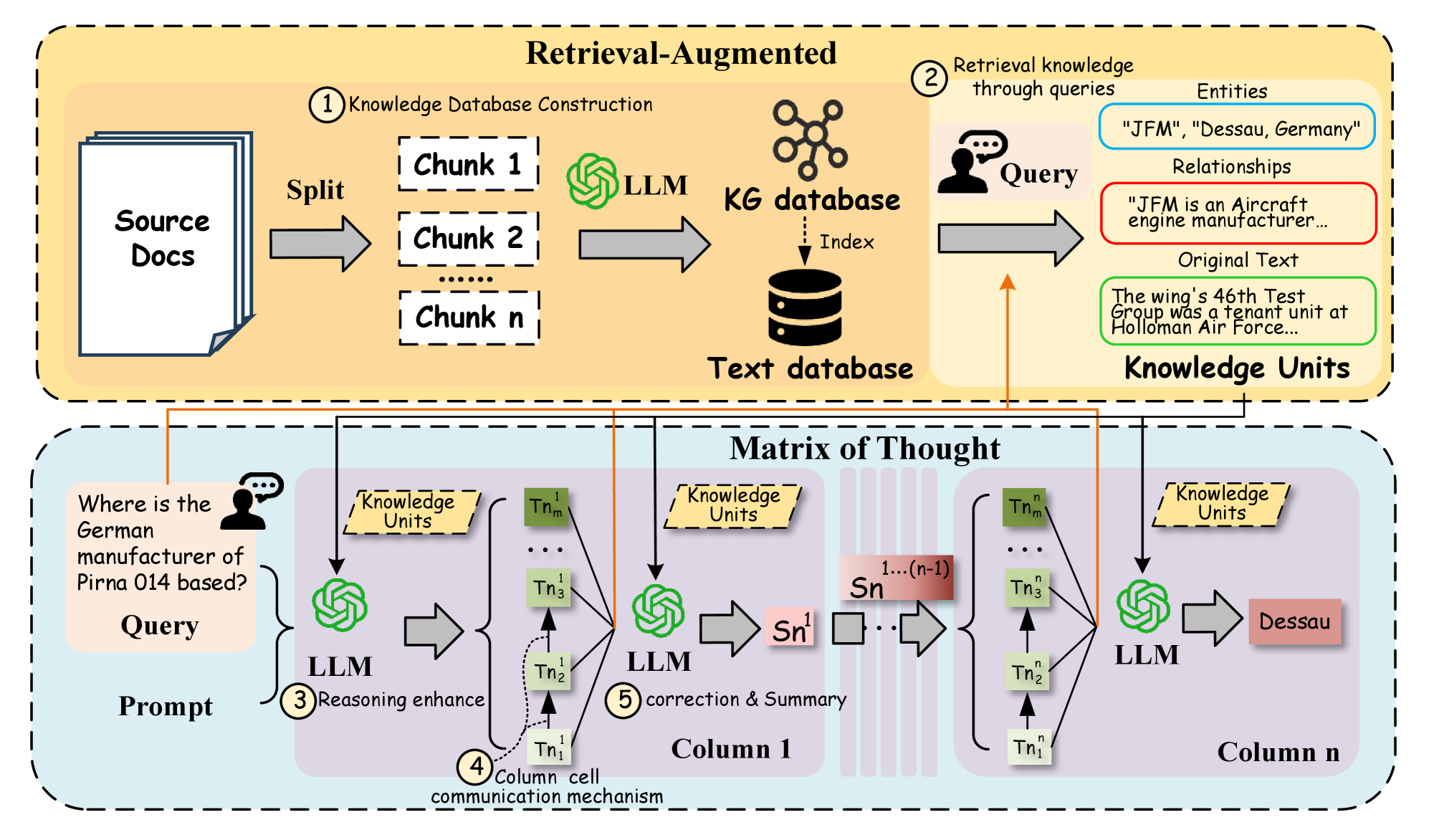

- 提出矩阵思维(MoT)框架,通过列-单元通信机制进行多策略深度思考,并利用事实校正机制纠正错误答案。

- 实验结果表明,MoT在24点游戏、问题回答和命题写作等任务中优于现有方法,推理时间仅为基线方法的14.4%。

📝 摘要(中文)

大型语言模型(LLMs)在处理复杂和抽象任务时,由于推理能力不足,准确性会显著下降。思维链(CoT)和思维树(ToT)等思维结构旨在增强LLMs的推理能力,但存在固有缺陷,如树结构中同一层内的冗余和链结构中路径的单一性。一些研究利用检索增强生成(RAG)方法来增强CoT和ToT,以减轻LLMs中的幻觉,但思维结构的基本缺点仍然存在。此外,在处理多实体和多跳信息时,检索到的验证知识通常包含大量碎片化、表面化甚至错误的数据,误导LLMs的推理过程。为了解决这些问题,我们提出了一种新颖而高效的LLMs思维结构——矩阵思维(MoT)。MoT通过“列-单元通信”机制在水平和垂直维度上探索问题,使LLMs能够积极参与多策略和深度思考,同时减少列单元内思维节点的冗余,从而增强LLMs的推理能力。此外,通过事实校正机制,它利用RAG检索到的知识图谱三元组和原始文本来构建知识单元并纠正错误答案。为了验证该方法的有效性,我们在24点游戏、问题回答评估和命题写作三个任务中进行了大量实验。结果表明,我们的框架优于最先进的方法,推理时间仅为基线方法的14.4%,证明了其效率和准确性。该框架的代码可在https://github.com/lyfiter/mtqa 获得。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在处理复杂推理任务时,由于现有方法(如CoT和ToT)的固有缺陷(冗余、路径单一)以及检索增强生成(RAG)引入的错误知识而导致的准确性下降问题。现有方法的痛点在于无法有效利用检索到的知识,且容易受到错误信息的干扰。

核心思路:论文的核心思路是构建一个矩阵式的思维结构(MoT),通过在水平和垂直维度上进行多策略和深度思考,减少冗余,并利用事实校正机制来纠正错误答案。这种设计旨在模拟人类在解决复杂问题时的多角度思考和验证过程。

技术框架:MoT框架主要包含以下几个阶段:1) 问题分解:将复杂问题分解为更小的子问题;2) 列-单元通信:在矩阵的每一列中,LLM生成多个候选答案,并通过列之间的通信进行信息交换和整合;3) 事实校正:利用RAG检索到的知识图谱三元组和原始文本,构建知识单元,并对候选答案进行验证和纠正;4) 答案生成:基于校正后的知识单元,生成最终答案。

关键创新:MoT的关键创新在于其矩阵式的思维结构和列-单元通信机制。与传统的链式或树状结构相比,MoT能够更全面地探索问题的各个方面,并减少冗余。此外,事实校正机制能够有效利用检索到的知识,并纠正错误答案,从而提高推理的准确性。

关键设计:MoT框架的关键设计包括:1) 列-单元通信策略:设计合适的通信机制,使不同列之间能够有效地交换信息;2) 事实校正机制:设计有效的知识单元构建方法和答案验证策略;3) 损失函数:设计合适的损失函数,以优化LLM在MoT框架下的推理能力。具体的参数设置和网络结构细节在论文中可能未详细说明,属于未知信息。

🖼️ 关键图片

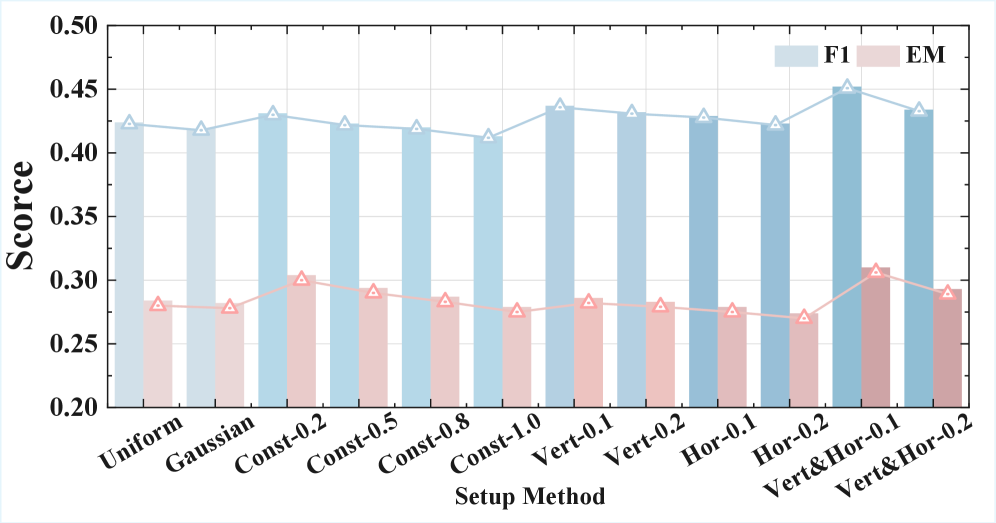

📊 实验亮点

实验结果表明,MoT框架在24点游戏、问题回答评估和命题写作三个任务中均优于现有方法。尤其值得注意的是,MoT的推理时间仅为基线方法的14.4%,这表明MoT在提高推理准确性的同时,还显著提高了推理效率。具体的性能提升数据需要在论文中查找,此处为未知信息。

🎯 应用场景

MoT框架可应用于需要复杂推理能力的各种场景,如智能问答、知识图谱推理、代码生成、数学问题求解等。该研究有助于提升LLM在实际应用中的可靠性和准确性,尤其是在需要处理大量信息和进行多步推理的任务中,具有重要的应用价值和潜力。

📄 摘要(原文)

Large Language Models (LLMs) face significant accuracy degradation due to insufficient reasoning ability when dealing with complex and abstract tasks. Thought structures such as Chain of Thought (CoT) and Tree of Thought (ToT) focus on enhancing the reasoning capability of LLMs. However, they suffer from inherent drawbacks such as redundancy within the same layer of the tree structure and the singularity of the paths in the chain structure. Some studies have utilized Retrieval-Augmented Generation (RAG) methods to enhance CoT and ToT in mitigating hallucinations in LLMs, yet the fundamental shortcomings of the thought structures still persist. Furthermore, when dealing with multi-entity and multi-hop information, the retrieved verification knowledge often contains large amounts of fragmented, superficial, or even erroneous data, misleading the reasoning process of LLMs. To address these issues, we propose the Matrix of Thought (MoT), a novel and efficient thought structure for LLMs. MoT explores problems in both horizontal and vertical dimensions through a "column-cell communication" mechanism, enabling LLMs to actively engage in multi-strategy and deep thinking while reducing redundancy in the thought nodes within the column cells, thereby enhancing the reasoning capability of LLMs. Additionally, through a fact-correction mechanism, it leverages the knowledge graph triples retrieved by RAG and the original text to construct knowledge units and correct erroneous answers. To validate the effectiveness of this method, we conducted extensive experiments in three tasks: 24-point game, question answering evaluation, and proposition writing.The results demonstrate that our framework outperforms state-of-the-art methods, with reasoning time only 14.4\% of that of the baseline method, proving its efficiency and accuracy. The code for framework is available at https://github.com/lyfiter/mtqa.