A Comprehensive Survey on Trustworthiness in Reasoning with Large Language Models

作者: Yanbo Wang, Yongcan Yu, Jian Liang, Ran He

分类: cs.CL, cs.AI, cs.CR

发布日期: 2025-09-04

备注: 38 pages. This survey considers papers published up to June 30, 2025. Work in progress

🔗 代码/项目: GITHUB

💡 一句话要点

综述:大型语言模型推理可信度研究,聚焦CoT技术及其安全性挑战

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 可信推理 链式思维 安全性 鲁棒性 公平性 隐私 人工智能安全

📋 核心要点

- 现有方法在理解CoT推理如何影响大型语言模型的可信度方面存在不足,尤其是在真实性、安全性和隐私等关键维度上。

- 该综述旨在全面评估CoT推理对LLM可信度的影响,并从真实性、安全性、鲁棒性、公平性和隐私五个维度进行深入分析。

- 通过对现有研究的系统性回顾,揭示了推理技术在提升模型可信度方面的潜力,同时也指出了当前推理模型在安全性等方面存在的固有脆弱性。

📝 摘要(中文)

长链式思维(Long-CoT)推理的进步显著提升了大型语言模型在语言理解、复杂问题解决和代码生成等任务中的性能。这种范式使模型能够生成中间推理步骤,从而提高准确性和可解释性。然而,尽管取得了这些进展,但对于基于CoT的推理如何影响语言模型的可信度,仍然缺乏全面的理解。本文综述了关于推理模型和CoT技术的最新研究,重点关注可信推理的五个核心维度:真实性、安全性、鲁棒性、公平性和隐私。对于每个方面,我们按时间顺序对最近的研究进行了清晰而结构化的概述,并详细分析了它们的方法、发现和局限性。最后还附上了未来的研究方向,以供参考和讨论。总的来说,虽然推理技术有望通过减少幻觉、检测有害内容和提高鲁棒性来增强模型的可信度,但前沿的推理模型本身在安全性、鲁棒性和隐私方面通常存在相当甚至更大的漏洞。通过综合这些见解,我们希望这项工作能够成为人工智能安全社区及时了解推理可信度最新进展的宝贵资源。相关论文的完整列表可在https://github.com/ybwang119/Awesome-reasoning-safety找到。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在推理过程中可信度评估的问题。现有方法缺乏对CoT(Chain-of-Thought)推理技术如何影响LLM的真实性、安全性、鲁棒性、公平性和隐私等关键维度的全面理解。现有研究往往侧重于提升性能,而忽略了推理过程可能引入的风险和漏洞。

核心思路:该综述的核心思路是对现有关于LLM推理和CoT技术的研究进行系统性的梳理和分析,从可信推理的五个核心维度出发,评估CoT推理对LLM可信度的影响。通过分析现有方法的优缺点,揭示CoT推理在提升模型可信度的同时,可能引入新的安全和隐私风险。

技术框架:该综述的技术框架主要包括以下几个阶段:1) 文献收集:收集关于LLM推理、CoT技术以及可信推理相关研究的论文。2) 维度划分:将可信推理划分为真实性、安全性、鲁棒性、公平性和隐私五个核心维度。3) 文献分析:针对每个维度,按时间顺序对相关研究进行概述,并分析其方法、发现和局限性。4) 总结与展望:总结现有研究的进展和不足,并提出未来的研究方向。

关键创新:该综述的关键创新在于其全面性和系统性。它不仅关注CoT推理在提升LLM性能方面的作用,更深入地探讨了其对模型可信度的影响,尤其是在安全性、鲁棒性和隐私等关键维度上。此外,该综述还提出了未来研究方向,为人工智能安全社区提供了有价值的参考。

关键设计:该综述的关键设计在于其维度划分和文献分析方法。通过将可信推理划分为五个核心维度,可以更清晰地评估CoT推理对LLM的影响。按时间顺序对文献进行分析,可以更好地了解该领域的研究进展和趋势。此外,该综述还详细分析了现有方法的局限性,为未来的研究提供了方向。

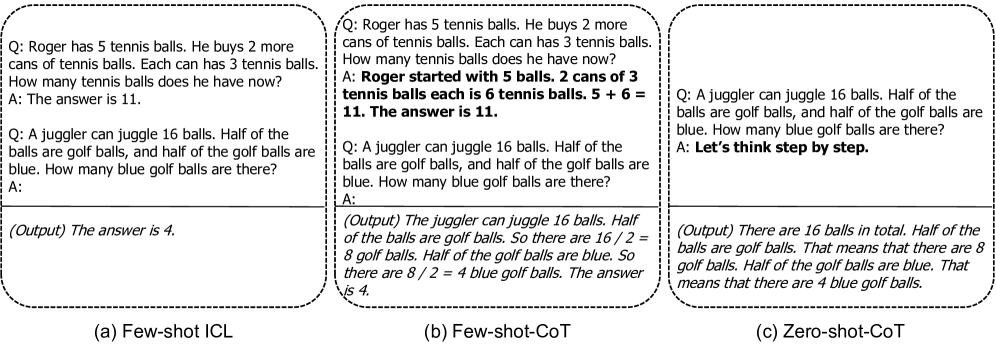

🖼️ 关键图片

📊 实验亮点

该综述强调了CoT推理在提升LLM性能的同时,可能引入新的安全和隐私风险。研究指出,虽然推理技术有望通过减少幻觉、检测有害内容和提高鲁棒性来增强模型的可信度,但前沿的推理模型本身在安全性、鲁棒性和隐私方面通常存在相当甚至更大的漏洞。

🎯 应用场景

该研究成果可应用于评估和改进大型语言模型在各种实际应用中的可信度,例如智能客服、医疗诊断、金融分析等。通过提高模型的真实性、安全性、鲁棒性、公平性和隐私性,可以增强用户对AI系统的信任,并降低潜在的风险。

📄 摘要(原文)

The development of Long-CoT reasoning has advanced LLM performance across various tasks, including language understanding, complex problem solving, and code generation. This paradigm enables models to generate intermediate reasoning steps, thereby improving both accuracy and interpretability. However, despite these advancements, a comprehensive understanding of how CoT-based reasoning affects the trustworthiness of language models remains underdeveloped. In this paper, we survey recent work on reasoning models and CoT techniques, focusing on five core dimensions of trustworthy reasoning: truthfulness, safety, robustness, fairness, and privacy. For each aspect, we provide a clear and structured overview of recent studies in chronological order, along with detailed analyses of their methodologies, findings, and limitations. Future research directions are also appended at the end for reference and discussion. Overall, while reasoning techniques hold promise for enhancing model trustworthiness through hallucination mitigation, harmful content detection, and robustness improvement, cutting-edge reasoning models themselves often suffer from comparable or even greater vulnerabilities in safety, robustness, and privacy. By synthesizing these insights, we hope this work serves as a valuable and timely resource for the AI safety community to stay informed on the latest progress in reasoning trustworthiness. A full list of related papers can be found at \href{https://github.com/ybwang119/Awesome-reasoning-safety}{https://github.com/ybwang119/Awesome-reasoning-safety}.