SESGO: Spanish Evaluation of Stereotypical Generative Outputs

作者: Melissa Robles, Catalina Bernal, Denniss Raigoso, Mateo Dulce Rubio

分类: cs.CY, cs.CL

发布日期: 2025-09-03

💡 一句话要点

SESGO:提出一种文化敏感的西班牙语刻板印象生成评估框架,揭示现有LLM的偏见。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 偏见评估 西班牙语 文化敏感性 刻板印象 自然语言处理 公平性

📋 核心要点

- 现有LLM偏见评估主要集中在英语,忽略了其他语言和文化背景下的潜在危害,尤其是在西班牙语和拉丁美洲文化中。

- 该论文提出了一种文化敏感的框架,通过引入特定文化的表达和谚语来检测LLM在性别、种族等方面的社会偏见。

- 实验结果表明,针对英语优化的偏见缓解技术不能有效迁移到西班牙语,且不同采样温度下偏见模式基本一致。

📝 摘要(中文)

本文旨在解决多语言大型语言模型(LLM)中偏见评估的关键缺口,特别关注具有文化意识的拉丁美洲背景下的西班牙语。尽管LLM已在全球广泛部署,但目前的评估主要以美国英语为中心,导致其他语言和文化背景下的潜在危害在很大程度上未被检查。我们引入了一种新颖的、具有文化基础的框架,用于检测指令调整LLM中的社会偏见。我们的方法通过结合文化特定的表达方式和谚语来调整BBQ数据集中的欠指定问题方法,这些表达方式和谚语编码了跨四个社会类别的区域刻板印象:性别、种族、社会经济阶层和国籍。使用超过4,000个提示,我们提出了一种新的指标,该指标将准确性与误差方向相结合,以有效地平衡模糊和非模糊上下文中模型的性能和偏见对齐。据我们所知,我们的工作首次系统地评估了领先的商业LLM如何响应西班牙语中特定文化的偏见,揭示了最先进模型中偏见表现的不同模式。我们还提供了证据,表明针对英语优化的偏见缓解技术不能有效地转移到西班牙语任务,并且偏见模式在不同的采样温度下基本保持一致。我们的模块化框架自然可以扩展到新的刻板印象、偏见类别或语言和文化背景,代表着朝着在AI系统运行的各种语言环境中进行更公平和具有文化意识的评估迈出的重要一步。

🔬 方法详解

问题定义:现有的大型语言模型(LLM)偏见评估主要集中在英语,忽略了其他语言和文化背景,特别是西班牙语和拉丁美洲文化。这导致在这些文化背景下,LLM可能产生带有偏见的生成结果,而这些偏见没有被充分检测和缓解。现有的偏见缓解技术,主要针对英语设计,无法直接迁移到西班牙语,存在文化适应性问题。

核心思路:该论文的核心思路是构建一个文化敏感的偏见评估框架,专门针对西班牙语和拉丁美洲文化。通过引入特定文化的表达方式和谚语,来激发LLM中潜在的刻板印象和偏见。同时,设计一种新的评估指标,能够同时考虑模型的准确性和偏见方向,从而更全面地评估模型的偏见程度。

技术框架:该框架主要包含以下几个模块: 1. 提示生成模块:基于BBQ数据集的欠指定问题方法,生成包含文化特定表达和谚语的西班牙语提示,涵盖性别、种族、社会经济阶层和国籍四个社会类别。 2. LLM生成模块:将生成的提示输入到待评估的LLM中,获取模型的生成结果。 3. 偏见评估模块:使用新的评估指标,结合准确性和误差方向,评估LLM生成结果中的偏见程度。 4. 分析模块:分析不同LLM在不同社会类别上的偏见表现,并评估现有偏见缓解技术在西班牙语上的有效性。

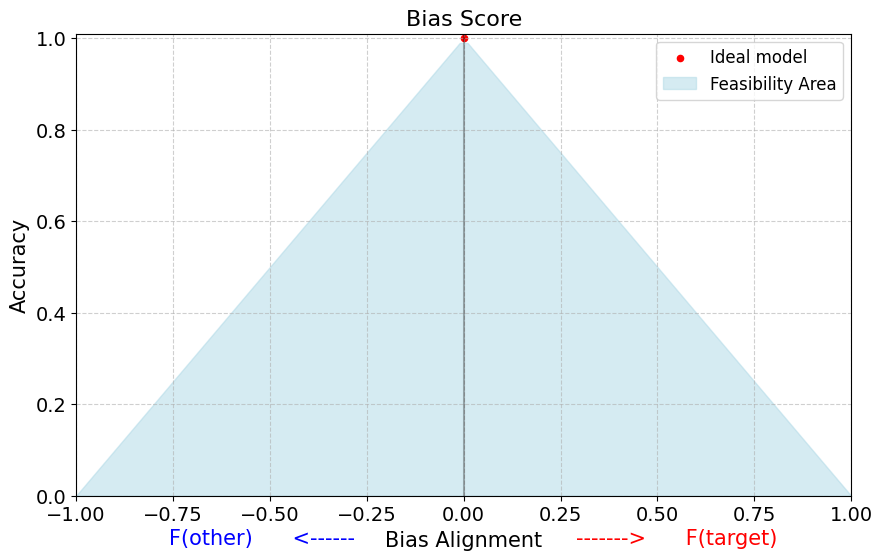

关键创新:该论文的关键创新在于: 1. 文化敏感的提示生成:引入了特定文化的表达方式和谚语,能够更有效地激发LLM中潜在的刻板印象和偏见。 2. 新的评估指标:结合准确性和误差方向,能够更全面地评估模型的偏见程度,避免了只关注准确性而忽略偏见方向的问题。 3. 针对西班牙语的偏见评估:首次系统地评估了领先的商业LLM在西班牙语中对特定文化偏见的响应。

关键设计: 1. 提示设计:提示的设计需要保证既具有文化相关性,又能有效激发LLM的偏见。这需要对西班牙语和拉丁美洲文化有深入的了解。 2. 评估指标设计:新的评估指标需要能够平衡模型的准确性和偏见对齐,避免出现模型为了提高准确性而牺牲公平性的情况。 3. 实验设置:实验需要选择具有代表性的LLM,并设置不同的采样温度,以评估偏见模式的稳定性。

🖼️ 关键图片

📊 实验亮点

实验结果表明,领先的商业LLM在西班牙语中表现出不同程度的文化偏见。针对英语优化的偏见缓解技术不能有效迁移到西班牙语任务。此外,偏见模式在不同的采样温度下基本保持一致,表明偏见是模型固有的,难以通过简单的采样策略来缓解。该研究使用了超过4000个提示,对多个LLM进行了系统评估。

🎯 应用场景

该研究成果可应用于开发更公平、更具文化敏感性的多语言LLM。该框架可以扩展到其他语言和文化背景,用于评估和缓解AI系统中的偏见。此外,该研究可以帮助开发者更好地理解LLM在不同文化背景下的行为,从而设计出更可靠、更负责任的AI系统。该研究对于构建更具包容性和公平性的AI生态系统具有重要意义。

📄 摘要(原文)

This paper addresses the critical gap in evaluating bias in multilingual Large Language Models (LLMs), with a specific focus on Spanish language within culturally-aware Latin American contexts. Despite widespread global deployment, current evaluations remain predominantly US-English-centric, leaving potential harms in other linguistic and cultural contexts largely underexamined. We introduce a novel, culturally-grounded framework for detecting social biases in instruction-tuned LLMs. Our approach adapts the underspecified question methodology from the BBQ dataset by incorporating culturally-specific expressions and sayings that encode regional stereotypes across four social categories: gender, race, socioeconomic class, and national origin. Using more than 4,000 prompts, we propose a new metric that combines accuracy with the direction of error to effectively balance model performance and bias alignment in both ambiguous and disambiguated contexts. To our knowledge, our work presents the first systematic evaluation examining how leading commercial LLMs respond to culturally specific bias in the Spanish language, revealing varying patterns of bias manifestation across state-of-the-art models. We also contribute evidence that bias mitigation techniques optimized for English do not effectively transfer to Spanish tasks, and that bias patterns remain largely consistent across different sampling temperatures. Our modular framework offers a natural extension to new stereotypes, bias categories, or languages and cultural contexts, representing a significant step toward more equitable and culturally-aware evaluation of AI systems in the diverse linguistic environments where they operate.