VaccineRAG: Boosting Multimodal Large Language Models' Immunity to Harmful RAG Samples

作者: Qixin Sun, Ziqin Wang, Hengyuan Zhao, Yilin Li, Kaiyou Song, Linjiang Huang, Xiaolin Hu, Qingpei Guo, Si Liu

分类: cs.CL, cs.AI

发布日期: 2025-09-02

💡 一句话要点

VaccineRAG:通过对抗有害RAG样本提升多模态大语言模型的免疫力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强生成 大语言模型 思维链 有害样本 数据集构建 偏好学习 多模态学习

📋 核心要点

- 现有RAG方法易受检索器返回的无关或误导性样本影响,导致大语言模型性能下降。

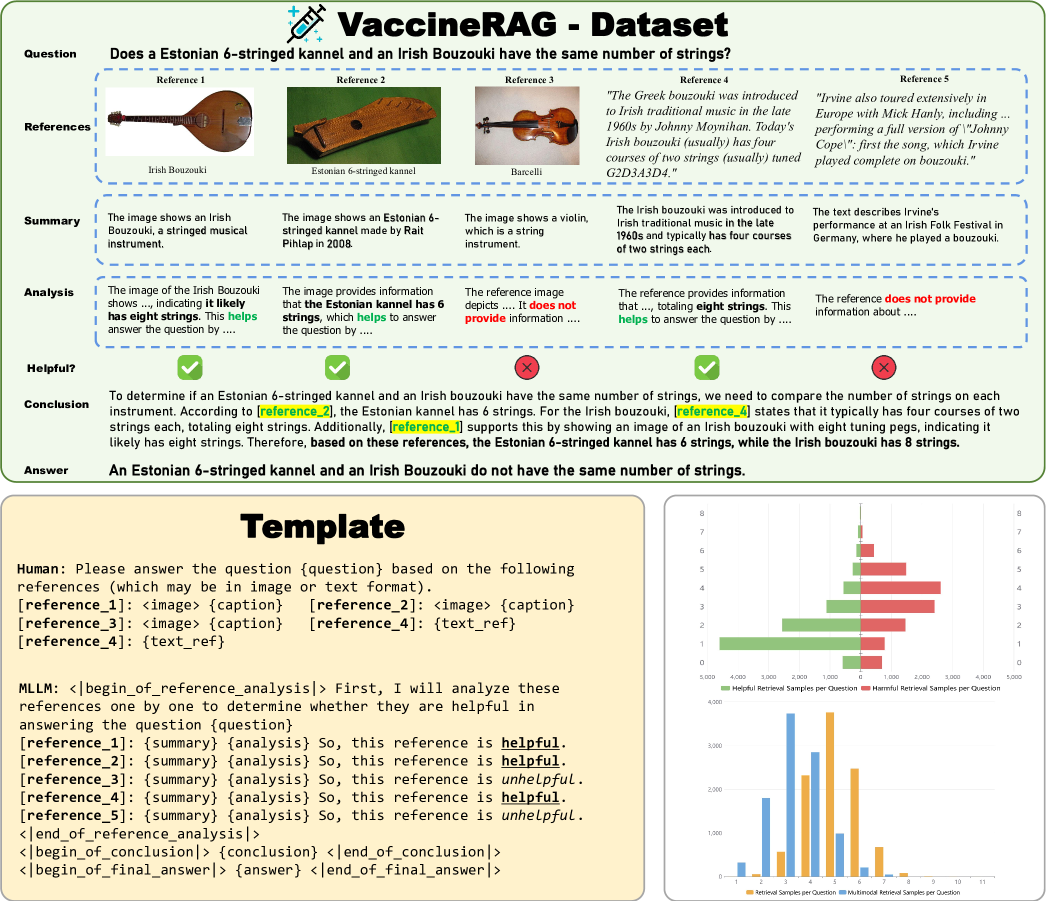

- VaccineRAG通过构建包含不同正负样本比例的数据集,并结合思维链分析,提升模型对样本的辨别能力。

- Partial-GRPO方法将LLM输出建模为多个组件,增强模型学习长序列复杂CoT内容的能力。

📝 摘要(中文)

检索增强生成(RAG)通过整合检索和生成模块与外部知识,增强了大语言模型(LLMs)的响应准确性,尤其在实时查询和视觉问答任务中表现出优势。然而,RAG的有效性经常受到检索器精度的阻碍:许多检索到的样本被输入到生成阶段,但它们是不相关的或具有误导性的,这对LLMs的性能构成了关键瓶颈。为了应对这一挑战,我们引入了VaccineRAG,一种新颖的基于思维链(CoT)的检索增强生成数据集。一方面,VaccineRAG采用基准来评估模型,使用具有不同正/负样本比率的数据,系统地暴露了当前LLMs的内在弱点。另一方面,它通过提示LLMs为每个样本生成显式的思维链(CoT)分析,从而增强了模型对样本的辨别能力,然后再生成最终答案。此外,为了增强模型学习长序列复杂CoT内容的能力,我们提出了Partial-GRPO。通过将LLMs的输出建模为多个组件而不是单个整体,我们的模型可以为复杂序列做出更明智的偏好选择,从而提高其学习复杂CoT的能力。在VaccineRAG上的全面评估和消融研究验证了所提出方案的有效性。代码和数据集即将公开发布。

🔬 方法详解

问题定义:论文旨在解决检索增强生成(RAG)系统中,由于检索器返回的样本质量不高(无关或误导性样本),导致大语言模型(LLM)性能下降的问题。现有方法难以有效区分和利用这些质量参差不齐的检索结果,从而影响最终生成答案的准确性和可靠性。

核心思路:论文的核心思路是构建一个包含不同质量样本的数据集(VaccineRAG),并利用思维链(Chain-of-Thought, CoT)提示,引导LLM在生成答案之前对每个检索到的样本进行分析和评估,从而提高模型对样本的辨别能力。此外,论文还提出了Partial-GRPO方法,用于更好地学习长序列的复杂CoT内容。

技术框架:VaccineRAG框架主要包含以下几个阶段:1) 构建包含不同正负样本比例的VaccineRAG数据集;2) 使用CoT提示引导LLM对检索到的样本进行分析;3) 利用Partial-GRPO方法训练LLM,使其能够更好地学习和利用CoT信息;4) 使用VaccineRAG数据集评估模型的性能。

关键创新:论文的关键创新点在于:1) 提出了VaccineRAG数据集,该数据集专门用于评估和提升LLM在RAG系统中的样本辨别能力;2) 结合CoT提示,引导LLM进行样本分析,从而提高其对样本质量的判断能力;3) 提出了Partial-GRPO方法,用于更好地学习长序列的复杂CoT内容。与现有方法相比,VaccineRAG更加关注RAG系统中样本质量对LLM性能的影响,并提出了相应的解决方案。

关键设计:Partial-GRPO方法将LLM的输出建模为多个组件,而不是一个整体。具体来说,它将CoT推理过程中的每个步骤都视为一个独立的组件,并对每个组件进行单独的偏好选择。这种设计使得模型能够更精细地学习和利用CoT信息,从而提高其生成复杂CoT内容的能力。数据集构建时,控制正负样本的比例,并设计相应的评估指标。

🖼️ 关键图片

📊 实验亮点

论文通过在VaccineRAG数据集上进行实验,验证了所提出方法的有效性。实验结果表明,结合CoT提示和Partial-GRPO方法,可以显著提高LLM在RAG系统中的性能。具体的性能数据和对比基线将在论文的后续版本中公布(根据摘要,代码和数据集即将发布)。

🎯 应用场景

该研究成果可应用于各种需要检索增强生成技术的场景,例如智能客服、知识问答、报告生成等。通过提高模型对检索结果的辨别能力,可以显著提升生成内容的质量和可靠性,减少错误信息的传播。未来,该方法可以进一步扩展到其他模态的数据,例如音频、视频等,从而实现更广泛的应用。

📄 摘要(原文)

Retrieval Augmented Generation enhances the response accuracy of Large Language Models (LLMs) by integrating retrieval and generation modules with external knowledge, demonstrating particular strength in real-time queries and Visual Question Answering tasks. However, the effectiveness of RAG is frequently hindered by the precision of the retriever: many retrieved samples fed into the generation phase are irrelevant or misleading, posing a critical bottleneck to LLMs' performance. To address this challenge, we introduce VaccineRAG, a novel Chain-of-Thought-based retrieval-augmented generation dataset. On one hand, VaccineRAG employs a benchmark to evaluate models using data with varying positive/negative sample ratios, systematically exposing inherent weaknesses in current LLMs. On the other hand, it enhances models' sample-discrimination capabilities by prompting LLMs to generate explicit Chain-of-Thought (CoT) analysis for each sample before producing final answers. Furthermore, to enhance the model's ability to learn long-sequence complex CoT content, we propose Partial-GRPO. By modeling the outputs of LLMs as multiple components rather than a single whole, our model can make more informed preference selections for complex sequences, thereby enhancing its capacity to learn complex CoT. Comprehensive evaluations and ablation studies on VaccineRAG validate the effectiveness of the proposed scheme. The code and dataset will be publicly released soon.