Implicit Reasoning in Large Language Models: A Comprehensive Survey

作者: Jindong Li, Yali Fu, Li Fan, Jiahong Liu, Yao Shu, Chengwei Qin, Menglin Yang, Irwin King, Rex Ying

分类: cs.CL, cs.AI

发布日期: 2025-09-02

🔗 代码/项目: GITHUB

💡 一句话要点

综述:大型语言模型中的隐式推理研究进展与执行范式分析

🎯 匹配领域: 支柱七:动作重定向 (Motion Retargeting) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 隐式推理 思维链 执行范式 潜在优化 信号引导控制 层递归执行

📋 核心要点

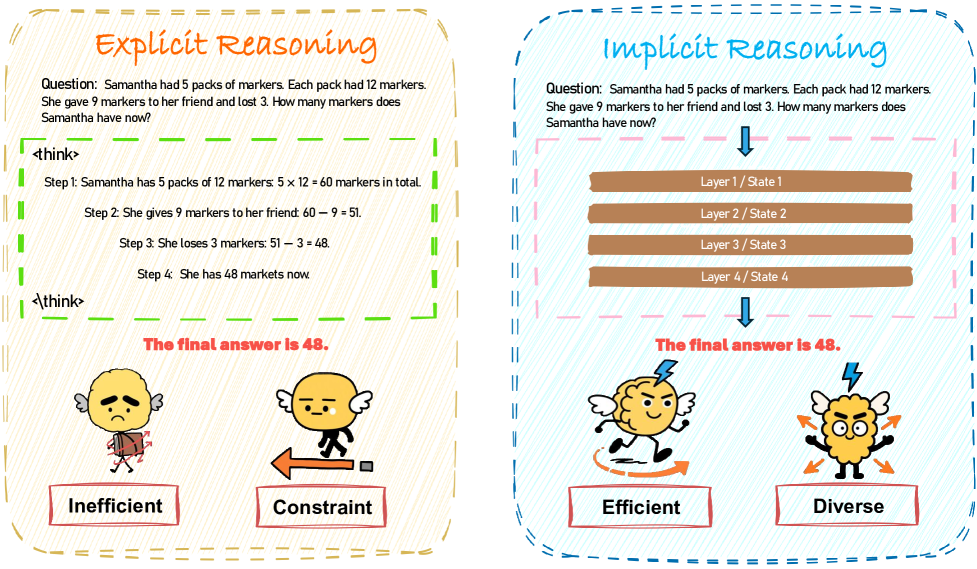

- 现有方法依赖显式思维链,成本高、速度慢,且与模型内部计算不完全一致,限制了推理效率。

- 本研究聚焦隐式推理,通过潜在结构在模型内部静默进行,降低成本,提升速度,并更好地对齐内部计算。

- 论文提出基于执行范式的分类法,分析了三种隐式推理方法,并综述了评估指标和基准。

📝 摘要(中文)

大型语言模型(LLMs)在各种任务中展现了强大的泛化能力。利用LLMs进行推理是解决多步骤问题和复杂决策的关键。为了支持高效推理,最近的研究已将注意力从显式的思维链提示转向隐式推理,即推理在没有中间文本步骤的情况下通过潜在结构静默地发生。隐式推理具有生成成本更低、推理速度更快以及与内部计算更好地对齐等优点。虽然之前的综述已经讨论了推理背景下的潜在表示,但仍然缺乏对LLMs内部推理如何展开的专门和机制层面的考察。本综述通过引入以执行范式为中心的分类法来填补这一空白,将重点从表示形式转移到计算策略。我们根据 extbf{ extit{内部计算如何以及在哪里展开}}将现有方法组织成三种执行范式:潜在优化、信号引导控制和层递归执行。我们还回顾了支持LLMs中存在隐式推理的结构、行为和基于表示的证据。此外,我们还对现有工作中用于评估隐式推理有效性和可靠性的评估指标和基准进行了结构化概述。我们在https://github.com/digailab/awesome-llm-implicit-reasoning维护一个持续更新的项目。

🔬 方法详解

问题定义:现有的大型语言模型推理方法,特别是基于显式思维链的方法,存在生成成本高、推理速度慢,以及与模型内部计算过程不完全对齐的问题。这些问题限制了LLM在复杂推理任务中的应用效率和效果。因此,需要研究更高效、更自然的推理方式,即隐式推理。

核心思路:论文的核心思路是将LLM的推理过程视为一个黑盒,重点关注模型内部的计算过程,而不是外部的文本输出。通过分析和归纳现有的隐式推理方法,提出了一个基于执行范式的分类框架,从计算策略的角度理解和组织这些方法。这种思路强调了推理的本质是模型内部的计算过程,而不是外部的文本表达。

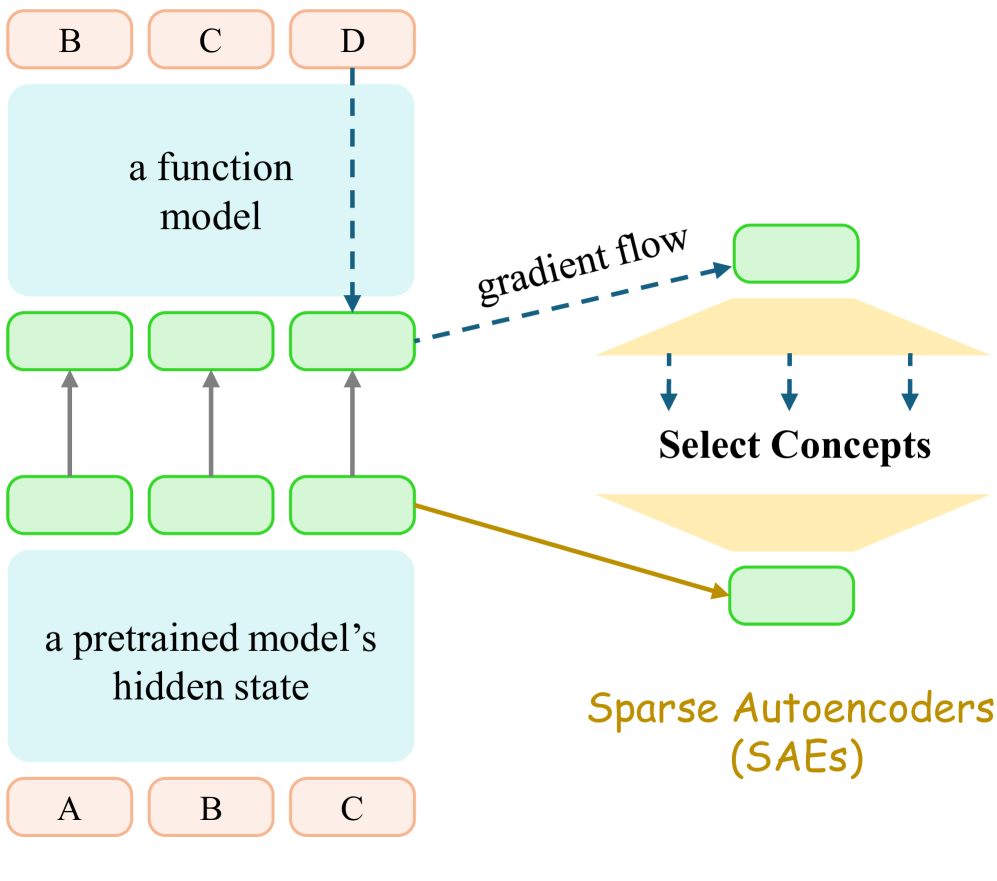

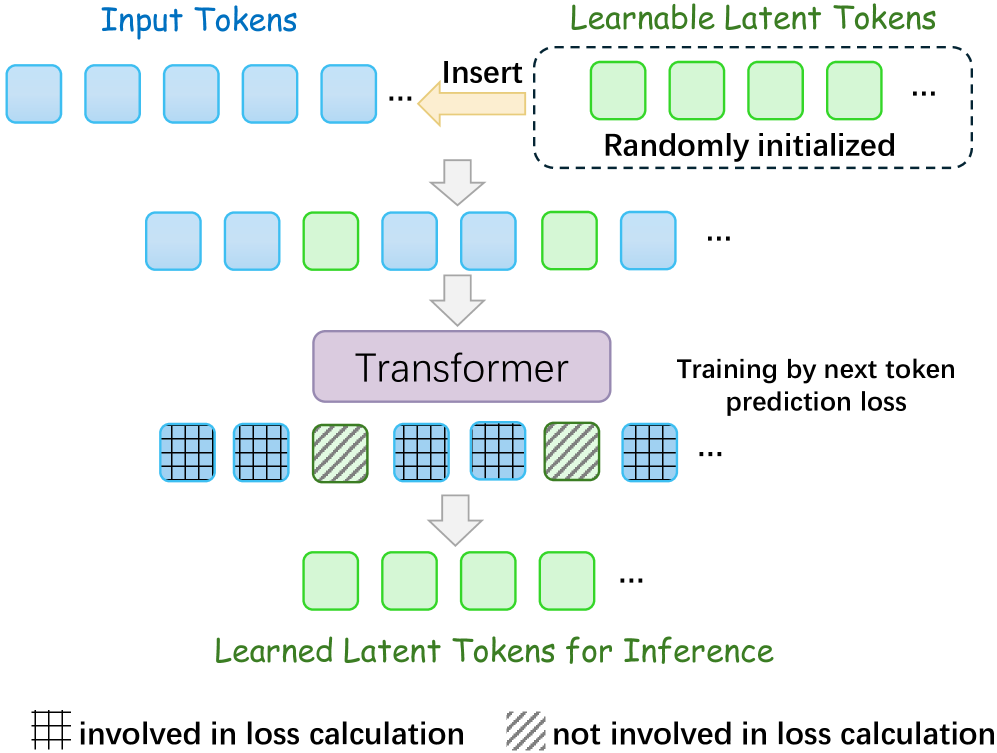

技术框架:论文将现有的隐式推理方法分为三种执行范式: 1. 潜在优化:通过优化潜在空间中的表示来进行推理。 2. 信号引导控制:利用外部信号(例如梯度)来引导模型的推理过程。 3. 层递归执行:通过在模型的不同层之间进行递归计算来进行推理。 论文还回顾了支持LLM中存在隐式推理的结构、行为和基于表示的证据,并对评估指标和基准进行了结构化概述。

关键创新:论文最重要的创新点在于提出了一个基于执行范式的分类框架,用于理解和组织现有的隐式推理方法。与以往关注表示形式的研究不同,该框架强调了计算策略的重要性,从根本上改变了对LLM推理过程的理解。此外,论文还系统地回顾了支持隐式推理的证据和评估方法,为未来的研究提供了重要的参考。

关键设计:论文的关键设计在于对三种执行范式的划分和描述。每种范式都代表了一种不同的计算策略,例如,潜在优化侧重于寻找最优的潜在表示,信号引导控制侧重于利用外部信号来引导推理方向,层递归执行侧重于在模型内部进行迭代计算。这些范式的划分有助于研究人员更好地理解和比较不同的隐式推理方法,并为未来的研究提供新的思路。

🖼️ 关键图片

📊 实验亮点

该综述系统地整理了现有隐式推理方法,并从执行范式的角度进行了分类,为研究人员提供了一个清晰的框架。此外,论文还回顾了支持隐式推理的证据和评估方法,为未来的研究提供了重要的参考。通过该综述,研究人员可以更好地理解LLM的推理机制,并开发更有效的隐式推理方法。

🎯 应用场景

该研究成果可应用于各种需要高效、低成本推理的场景,例如智能客服、自动驾驶、金融分析等。通过利用隐式推理,可以降低LLM的计算成本,提高推理速度,并使其更好地适应实际应用的需求。未来的研究可以进一步探索隐式推理的机制,开发更有效的隐式推理方法,并将其应用于更广泛的领域。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated strong generalization across a wide range of tasks. Reasoning with LLMs is central to solving multi-step problems and complex decision-making. To support efficient reasoning, recent studies have shifted attention from explicit chain-of-thought prompting toward implicit reasoning, where reasoning occurs silently via latent structures without emitting intermediate textual steps. Implicit reasoning brings advantages such as lower generation cost, faster inference, and better alignment with internal computation. Although prior surveys have discussed latent representations in the context of reasoning, a dedicated and mechanism-level examination of how reasoning unfolds internally within LLMs remains absent. This survey fills that gap by introducing a taxonomy centered on execution paradigms, shifting the focus from representational forms to computational strategies. We organize existing methods into three execution paradigms based on \textbf{\textit{how and where internal computation unfolds}}: latent optimization, signal-guided control, and layer-recurrent execution. We also review structural, behavioral and representation-based evidence that supports the presence of implicit reasoning in LLMs. We further provide a structured overview of the evaluation metrics and benchmarks used in existing works to assess the effectiveness and reliability of implicit reasoning. We maintain a continuously updated project at: https://github.com/digailab/awesome-llm-implicit-reasoning.