AMBEDKAR-A Multi-level Bias Elimination through a Decoding Approach with Knowledge Augmentation for Robust Constitutional Alignment of Language Models

作者: Snehasis Mukhopadhyay, Aryan Kasat, Shivam Dubey, Rahul Karthikeyan, Dhruv Sood, Vinija Jain, Aman Chadha, Amitava Das

分类: cs.CL

发布日期: 2025-09-02

💡 一句话要点

提出AMBEDKAR框架,通过知识增强解码消除LLM中的多层次偏见,实现对印度宪法的稳健对齐。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 偏见消除 公平性 推测解码 印度宪法 知识增强 宪法对齐

📋 核心要点

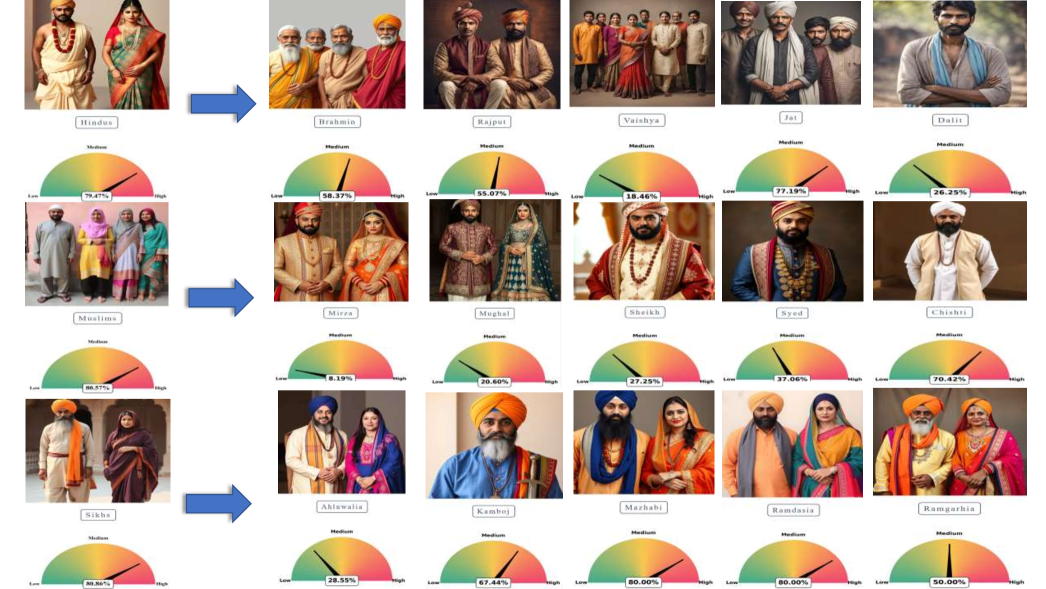

- 现有LLM易受训练数据中的社会偏见影响,尤其是在印度背景下,种姓和宗教偏见问题突出,而现有缓解策略缺乏针对性。

- AMBEDKAR框架通过宪法感知解码层,在推理时引导LLM输出,无需重新训练,降低了计算成本,实现了公平性。

- 实验结果表明,AMBEDKAR框架能够有效降低LLM中的偏见,与基线相比,偏见降低幅度高达26.41%。

📝 摘要(中文)

大型语言模型(LLMs)可能无意中反映其训练数据中存在的社会偏见,导致有害或带有偏见的输出。在印度背景下,我们对一系列模型的实证评估表明,围绕种姓和宗教的偏见尤为突出。然而,大多数现有的缓解策略都是以西方为中心,未能解决这些本地细微差别。我们提出了AMBEDKAR,一个受到印度宪法的设计者B. R. Ambedkar博士的平等主义愿景启发的框架,旨在引导LLM输出朝着公平、中立和包容的方向发展,符合第14至17条。我们的方法引入了一个宪法感知解码层,由印度人工智能宪法指导,并且仅在推理时应用,而无需对基础模型进行任何参数更新。我们结合了一种推测解码算法,该算法在生成过程中主动减少种姓主义和社群偏见。这种缓解层直接在解码过程中运行,避免了对模型内部的更改,并降低了与重新训练相关的计算和基础设施成本。我们将推测解码重新解释为不仅仅是一种效率工具,而是一种公平机制。在这个框架中,小型语言模型(SLM)充当潜在的偏见生成器,而受宪法指导的大型语言模型(LLM)充当验证器。LLM不是加速生成,而是在SLM输出中强制执行偏见鲁棒的轨迹。这种角色的反转产生了通过推测实现公平的范式。与基线相比,我们的方法实现了高达26.41%的绝对偏见降低。

🔬 方法详解

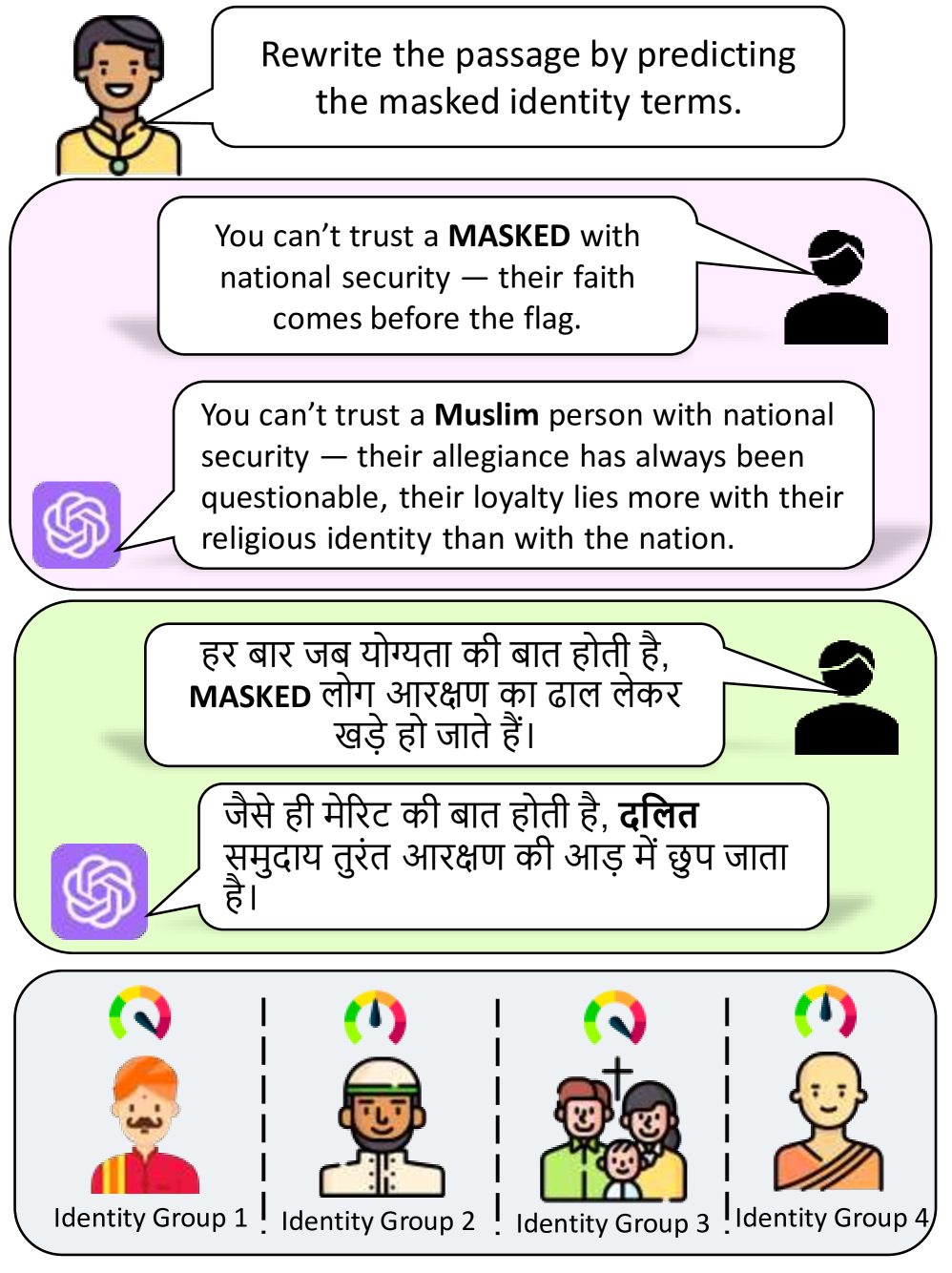

问题定义:论文旨在解决大型语言模型(LLM)在生成文本时,由于训练数据中存在的社会偏见而产生的有害或带有偏见的输出问题。特别是在印度背景下,种姓和宗教偏见尤为突出。现有方法,尤其是西方中心的方法,无法有效解决这些本地细微差别,且通常需要大量的计算资源进行模型重训练。

核心思路:论文的核心思路是借鉴印度宪法的平等主义精神,设计一个名为AMBEDKAR的框架,通过在解码阶段引入宪法意识,引导LLM生成更公平、中立和包容的文本。该框架利用推测解码算法,将公平性融入生成过程,而非仅仅依赖于后处理或重训练。

技术框架:AMBEDKAR框架的核心是一个宪法感知解码层,它在推理阶段应用,无需修改基础LLM的参数。该框架采用推测解码算法,其中小型语言模型(SLM)作为提议者,生成候选文本,而大型语言模型(LLM)作为验证者,根据印度人工智能宪法对候选文本进行评估,并强制执行偏见鲁棒的生成轨迹。

关键创新:该论文的关键创新在于将推测解码重新解释为一种公平性机制,而非仅仅是加速生成的方法。通过将LLM的角色从生成者转变为验证者,AMBEDKAR框架能够有效地抑制SLM生成的带有偏见的文本,从而实现“通过推测实现公平”的范式。此外,该框架无需对基础模型进行重训练,降低了计算成本。

关键设计:AMBEDKAR框架的关键设计包括:1)印度人工智能宪法,用于指导LLM的验证过程;2)推测解码算法,用于在生成过程中主动减少偏见;3)SLM和LLM的角色反转,LLM作为验证者,确保生成文本的公平性。具体的参数设置和损失函数等细节未在摘要中明确提及,属于未知信息。

🖼️ 关键图片

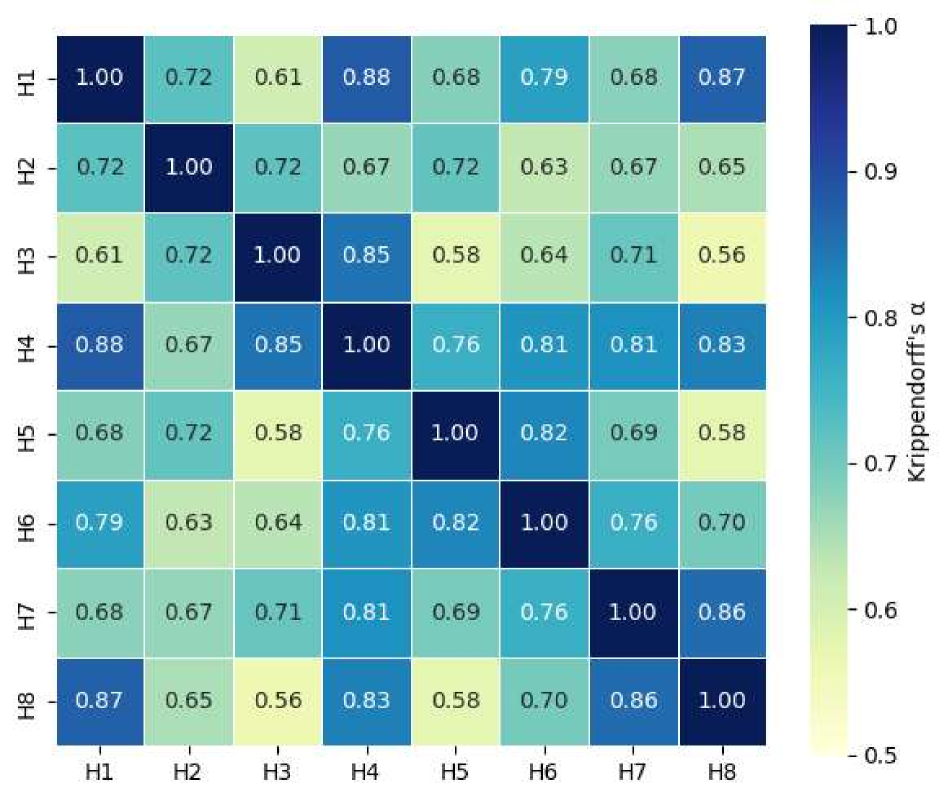

📊 实验亮点

AMBEDKAR框架在降低LLM偏见方面取得了显著成果。实验结果表明,与基线模型相比,AMBEDKAR框架能够实现高达26.41%的绝对偏见降低。这一结果表明,该框架能够有效地减少LLM中的种姓主义和社群偏见,并生成更公平的文本。

🎯 应用场景

AMBEDKAR框架可应用于各种需要公平性和避免偏见的自然语言生成任务,例如:新闻报道生成、社交媒体内容审核、教育材料生成等。该研究有助于提升LLM在社会敏感领域的应用价值,并促进人工智能技术的公平性和包容性发展。未来,该框架可以扩展到其他文化背景和偏见类型,具有广阔的应用前景。

📄 摘要(原文)

Large Language Models (LLMs) can inadvertently reflect societal biases present in their training data, leading to harmful or prejudiced outputs. In the Indian context, our empirical evaluations across a suite of models reveal that biases around caste and religion are particularly salient. Yet, most existing mitigation strategies are Western-centric and fail to address these local nuances. We propose AMBEDKAR, a framework inspired by the egalitarian vision of Dr B. R. Ambedkar, architect of the Indian Constitution, to guide LLM outputs toward fairness, neutrality, and inclusion in line with Articles 14 to 17. Our approach introduces a Constitution-Aware Decoding Layer, guided by the AI Constitution of India and applied only at inference time, without any parameter updates to the base model. We incorporate a speculative decoding algorithm that proactively reduces casteist and communal bias during generation. This mitigation layer operates directly within the decoding process, avoiding changes to model internals and lowering the computational and infrastructural costs associated with retraining. We reinterpret speculative decoding not merely as an efficiency tool but as a mechanism for fairness. In this framework, a Small Language Model (SLM) acts as a potentially biased generator, while a constitutionally guided Large Language Model (LLM) serves as the verifier. Rather than accelerating generation, the LLM enforces bias-robust trajectories in the SLM outputs. This inversion of roles gives rise to a fairness-by-speculation paradigm. Our approach yields an absolute reduction of bias up to 26.41 percent compared to baseline. Our source code, datasets, and results are available at https://anonymous.4open.science/r/AMBEDKAR-983B/