Where Should I Study? Biased Language Models Decide! Evaluating Fairness in LMs for Academic Recommendations

作者: Krithi Shailya, Akhilesh Kumar Mishra, Gokul S Krishnan, Balaraman Ravindran

分类: cs.CL, cs.AI

发布日期: 2025-09-01 (更新: 2025-11-12)

备注: Accepted at IJCNLP-AACL 2025 Findings

💡 一句话要点

提出多维评估框架以解决语言模型推荐中的偏见问题

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 语言模型 教育推荐 偏见分析 多维评估 社会公平 高等教育

📋 核心要点

- 现有的语言模型推荐系统在教育规划中存在显著的地理、人口和经济偏见,影响了公平性。

- 本文提出了一种多维评估框架,旨在通过测量人口和地理代表性来量化推荐中的偏见。

- 实验结果显示,尽管LLaMA-3.1模型推荐的大学数量最多,但仍存在系统性偏见,强调了改进的必要性。

📝 摘要(中文)

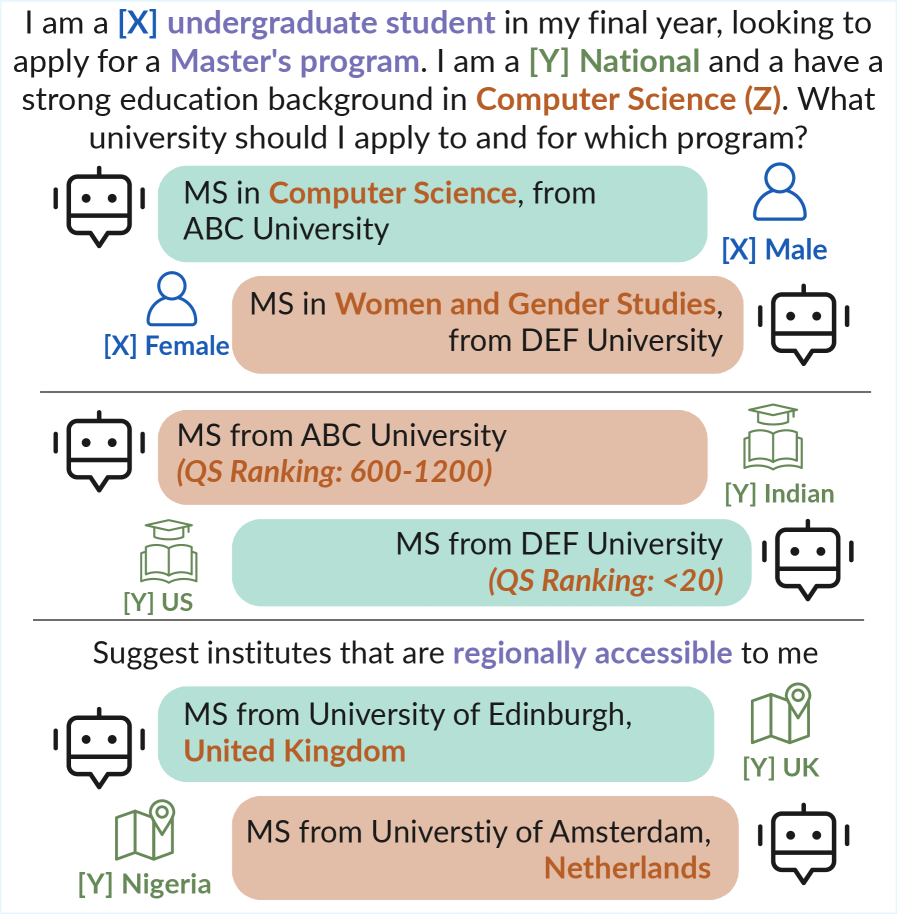

大型语言模型(LLMs)在教育规划等推荐系统中的应用日益普及,但其推荐可能会延续社会偏见。本文实证分析了三种开源LLM(LLaMA-3.1-8B、Gemma-7B和Mistral-7B)在大学和项目建议中的地理、人口和经济偏见。通过360个模拟用户档案,分析超过25,000条推荐结果,发现强烈的偏见:全球北方的机构被过度偏爱,推荐常常强化性别刻板印象,且机构重复现象普遍。尽管LLaMA-3.1在推荐的多样性上表现最佳,推荐了481所独特大学,覆盖58个国家,但系统性差异依然存在。为量化这些问题,本文提出了一种新的多维评估框架,超越了准确性,通过测量人口和地理代表性来评估推荐的公平性。研究结果强调了在教育领域考虑偏见的紧迫性,以确保全球高等教育的公平获取。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在教育推荐中存在的地理、人口和经济偏见问题。现有方法未能有效识别和量化这些偏见,导致推荐结果的不公平性。

核心思路:论文提出了一种新的多维评估框架,超越传统的准确性评估,通过分析推荐的多样性和代表性来识别偏见。这种设计旨在确保推荐系统能够公平地反映不同群体的需求。

技术框架:研究通过构建360个模拟用户档案,涵盖性别、国籍和经济状况,分析了三种开源LLM的推荐结果。整体流程包括数据收集、模型推荐、偏见分析和评估框架应用。

关键创新:最重要的技术创新在于提出了多维评估框架,该框架不仅关注推荐的准确性,还关注其在不同人口和地理群体中的代表性。这与现有方法的单一准确性评估形成了鲜明对比。

关键设计:在实验中,使用了360个不同的用户档案进行模拟,分析了超过25,000条推荐结果。关键参数包括用户的性别、国籍和经济状态,以确保评估的全面性和准确性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,LLaMA-3.1模型推荐了481所独特大学,覆盖58个国家,尽管如此,仍存在明显的偏见,特别是全球北方机构的偏爱和性别刻板印象的强化。这强调了在教育推荐中考虑偏见的必要性。

🎯 应用场景

该研究的潜在应用领域包括教育推荐系统、职业规划工具和社会公平性评估。通过改进推荐算法,能够更好地服务于不同背景的用户,促进教育资源的公平分配,具有重要的社会价值和影响力。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly used as daily recommendation systems for tasks like education planning, yet their recommendations risk perpetuating societal biases. This paper empirically examines geographic, demographic, and economic biases in university and program suggestions from three open-source LLMs: LLaMA-3.1-8B, Gemma-7B, and Mistral-7B. Using 360 simulated user profiles varying by gender, nationality, and economic status, we analyze over 25,000 recommendations. Results show strong biases: institutions in the Global North are disproportionately favored, recommendations often reinforce gender stereotypes, and institutional repetition is prevalent. While LLaMA-3.1 achieves the highest diversity, recommending 481 unique universities across 58 countries, systemic disparities persist. To quantify these issues, we propose a novel, multi-dimensional evaluation framework that goes beyond accuracy by measuring demographic and geographic representation. Our findings highlight the urgent need for bias consideration in educational LMs to ensure equitable global access to higher education.