Do Retrieval Augmented Language Models Know When They Don't Know?

作者: Youchao Zhou, Heyan Huang, Yicheng Liu, Rui Dai, Xinglin Wang, Xingchen Zhang, Shumin Shi, Yang Deng

分类: cs.CL, cs.AI

发布日期: 2025-09-01 (更新: 2025-11-18)

备注: AAAI 2026 camera ready version. Extended version with Appendix is coming soon

💡 一句话要点

研究检索增强语言模型(RALM)的拒答能力,并提出改进方案以平衡拒答与正确回答。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 检索增强语言模型 拒绝回答 不确定性估计 校准 过度拒绝

📋 核心要点

- 现有检索增强语言模型(RALM)存在幻觉问题,且缺乏对其拒绝回答能力的充分评估。

- 该研究旨在评估RALM在不同知识状态下的校准情况,并探究其拒绝能力与校准质量之间的关系。

- 通过上下文微调和结合不确定性估计,提出了一种改进的拒绝机制,以平衡RALM的拒绝和正确回答。

📝 摘要(中文)

现有的大型语言模型(LLM)有时会生成看似合理但实际上不正确的回复,即产生幻觉。目前主要有两种方法来缓解幻觉:检索增强语言模型(RALM)和拒绝后训练。然而,当前的研究主要集中在它们各自的有效性上,而忽略了对RALM的拒绝能力的评估。理想情况下,如果RALM知道自己不知道,它们应该拒绝回答。在本研究中,我们提出了一个基本问题:RALM知道自己什么时候不知道吗?具体来说,我们研究了三个问题。首先,RALM在不同的内部和外部知识状态下是否校准良好?我们考察了各种因素的影响。与预期相反,当所有检索到的文档都不相关时,RALM仍然倾向于拒绝它们本可以正确回答的问题。其次,鉴于模型明显的 extbf{过度拒绝}行为,我们提出了第二个问题:RALM的拒绝能力与其校准质量如何一致?我们的结果表明,过度拒绝问题可以通过上下文微调来缓解。然而,我们观察到,改进的拒绝行为并不一定意味着更好的校准或更高的整体准确性。最后,我们问:我们能否将具有拒绝意识的RALM与基于不确定性的答案回避相结合,以减轻过度拒绝?我们为拒绝后训练的RALM开发了一种简单而有效的拒绝机制,通过平衡拒绝和正确答案来提高其整体答案质量。我们的研究提供了对影响RALM行为的因素的更全面的理解。同时,我们强调,RALM的不确定性估计仍然是一个值得深入研究的开放问题。

🔬 方法详解

问题定义:现有检索增强语言模型(RALM)虽然能缓解幻觉,但仍然存在生成不正确答案的问题。一个关键的挑战是,RALM有时会在缺乏相关知识时仍然给出答案,或者在明明可以回答正确的情况下选择拒绝回答,即存在“过度拒绝”现象。现有方法主要关注提升RALM的准确性,而忽略了对其拒绝回答能力的评估和优化。

核心思路:该论文的核心思路是深入研究RALM的拒绝回答能力,并尝试通过改进的拒绝机制来平衡拒绝回答和正确回答。具体来说,论文首先评估RALM在不同知识状态下的校准情况,然后探究拒绝能力与校准质量之间的关系,最后提出一种结合不确定性估计的拒绝机制,以减少过度拒绝现象。

技术框架:该研究的技术框架主要包括以下几个步骤:1)构建评估数据集,包含不同知识状态下的问题;2)评估现有RALM在不同知识状态下的校准情况和拒绝能力;3)通过上下文微调来改进RALM的拒绝能力;4)设计一种结合不确定性估计的拒绝机制,以平衡拒绝回答和正确回答。

关键创新:该论文的关键创新在于:1)首次系统性地评估了RALM的拒绝回答能力,并发现了“过度拒绝”现象;2)提出了一种结合不确定性估计的拒绝机制,能够有效减少过度拒绝,并提高RALM的整体答案质量。

关键设计:论文的关键设计包括:1)设计了包含不同知识状态(如所有检索文档都不相关)的评估数据集;2)使用了上下文微调来改进RALM的拒绝能力,具体方法未知;3)设计了一种基于不确定性估计的拒绝机制,其具体实现细节未知,但目标是平衡拒绝回答和正确回答。

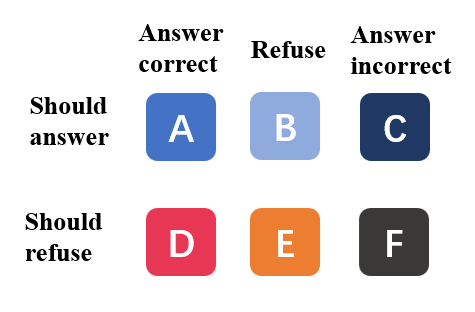

🖼️ 关键图片

📊 实验亮点

实验结果表明,现有的RALM存在过度拒绝现象,即在可以回答正确的情况下仍然选择拒绝回答。通过上下文微调可以缓解过度拒绝问题,但改进的拒绝行为并不一定意味着更好的校准或更高的整体准确性。提出的结合不确定性估计的拒绝机制能够有效减少过度拒绝,并提高RALM的整体答案质量,具体提升幅度未知。

🎯 应用场景

该研究成果可应用于各种需要可靠信息检索和问答的场景,例如智能客服、知识库问答、医疗诊断辅助等。通过提高RALM的拒绝回答能力,可以减少错误信息的传播,提高用户信任度,并为用户提供更准确、可靠的信息服务。未来的研究可以进一步探索更有效的拒绝机制和不确定性估计方法,以提升RALM的整体性能。

📄 摘要(原文)

Existing large language models (LLMs) occasionally generate plausible yet factually incorrect responses, known as hallucinations. Two main approaches have been proposed to mitigate hallucinations: retrieval-augmented language models (RALMs) and refusal post-training. However, current research predominantly focuses on their individual effectiveness while overlooking the evaluation of the refusal capability of RALMs. Ideally, if RALMs know when they do not know, they should refuse to answer.In this study, we ask the fundamental question: Do RALMs know when they don't know? Specifically, we investigate three questions. First, are RALMs well calibrated with respect to different internal and external knowledge states? We examine the influence of various factors. Contrary to expectations, when all retrieved documents are irrelevant, RALMs still tend to refuse questions they could have answered correctly. Next, given the model's pronounced \textbf{over-refusal} behavior, we raise a second question: How does a RALM's refusal ability align with its calibration quality? Our results show that the over-refusal problem can be mitigated through in-context fine-tuning. However, we observe that improved refusal behavior does not necessarily imply better calibration or higher overall accuracy. Finally, we ask: Can we combine refusal-aware RALMs with uncertainty-based answer abstention to mitigate over-refusal? We develop a simple yet effective refusal mechanism for refusal-post-trained RALMs that improves their overall answer quality by balancing refusal and correct answers. Our study provides a more comprehensive understanding of the factors influencing RALM behavior. Meanwhile, we emphasize that uncertainty estimation for RALMs remains an open problem deserving deeper investigation.