GDLLM: A Global Distance-aware Modeling Approach Based on Large Language Models for Event Temporal Relation Extraction

作者: Jie Zhao, Wanting Ning, Yuxiao Fei, Yubo Feng, Lishuang Li

分类: cs.CL, cs.IR

发布日期: 2025-08-28

备注: Proceedings of the 2025 Conference on Empirical Methods in Natural Language Processing (EMNLP Findings)

💡 一句话要点

提出GDLLM,利用全局距离感知建模提升大语言模型在事件时序关系抽取中的性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 事件时序关系抽取 大语言模型 图注意力网络 距离感知建模 软推理 自然语言处理

📋 核心要点

- 现有事件时序关系抽取方法依赖小语言模型,但其知识储备不足,难以处理不平衡数据集中的少数类关系。

- GDLLM通过引入距离感知图结构和软推理时间特征学习范式,增强大语言模型对长距离依赖和短距离关系的建模能力。

- 在TB-Dense和MATRES数据集上的实验表明,GDLLM显著提升了少数关系类的性能,并达到了最先进水平。

📝 摘要(中文)

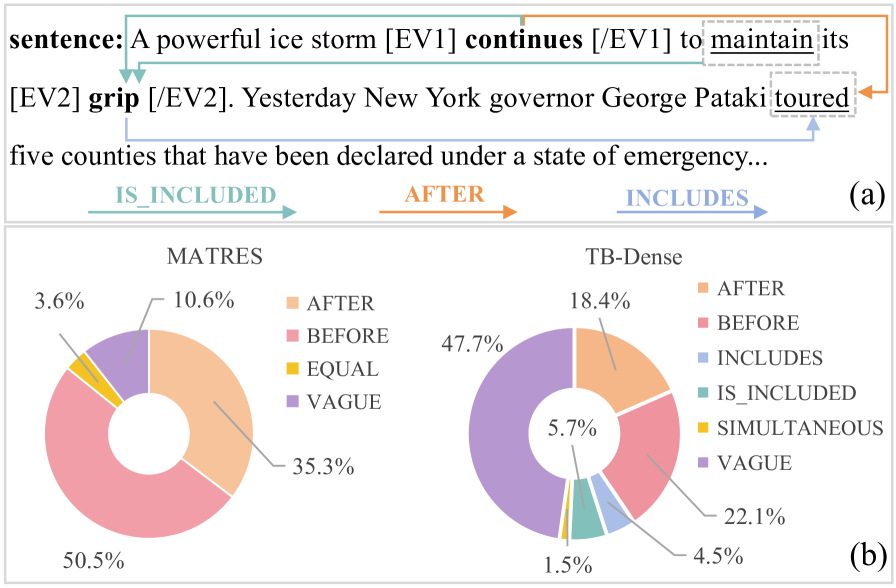

事件时序关系抽取(ETRE)旨在识别两个事件之间的时间关系。现有研究表明语言模型对ETRE至关重要。然而,小语言模型(SLM)的预训练知识有限,难以处理不平衡分类数据集中少数类关系。对于大语言模型(LLM),研究人员采用手动设计的提示或指令,这可能会引入额外的噪声,干扰模型对事件之间长距离依赖关系的判断。为了解决这些问题,我们提出了一种基于LLM的全局距离感知建模方法GDLLM。我们首先提出了一种距离感知图结构,利用图注意力网络(GAT)来辅助LLM捕获长距离依赖特征。此外,我们设计了一种基于软推理的时间特征学习范式,以增强对短距离邻近带关系的识别,将LLM生成的概率信息补充到多头注意力机制中。由于可以有效地捕获全局特征,我们的框架大大提高了少数关系类的性能,并提高了整体学习能力。在两个公开数据集TB-Dense和MATRES上的实验表明,我们的方法实现了最先进(SOTA)的性能。

🔬 方法详解

问题定义:事件时序关系抽取旨在识别文本中两个事件之间的时间关系。现有方法,特别是基于大语言模型的方法,在处理长距离依赖和不平衡数据集时面临挑战。手动设计的提示词可能引入噪声,影响模型判断。

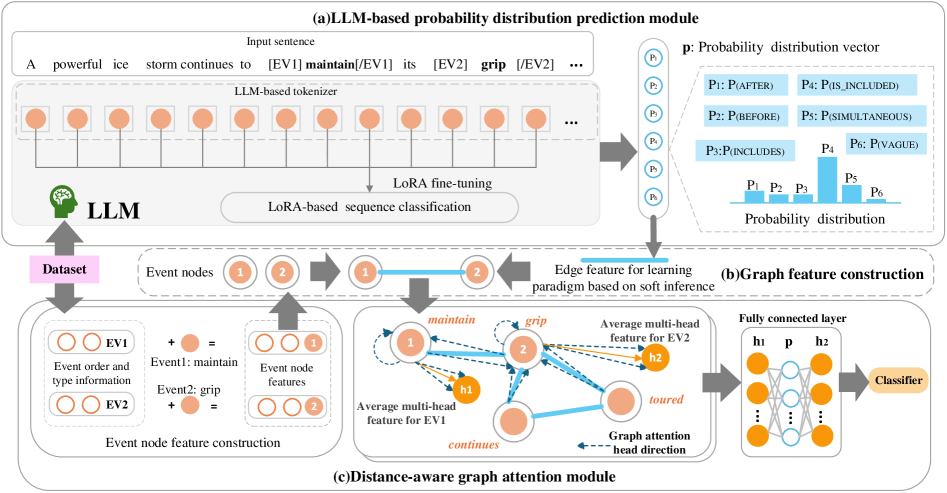

核心思路:GDLLM的核心思路是利用图结构建模事件之间的距离关系,并结合软推理机制增强模型对局部时序信息的感知。通过全局距离感知和局部信息增强,提升模型对事件时序关系的抽取能力。

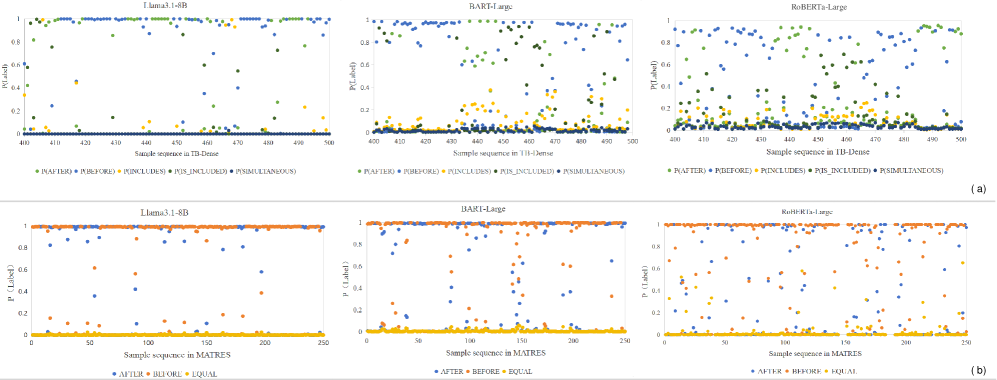

技术框架:GDLLM框架包含两个主要模块:1) 距离感知图建模:使用图注意力网络(GAT)构建事件之间的图结构,节点表示事件,边表示事件之间的距离关系。GAT用于学习节点表示,从而捕获长距离依赖关系。2) 软推理时间特征学习:设计了一种基于软推理的时间特征学习范式,将LLM生成的概率信息补充到多头注意力机制中,增强对短距离邻近带关系的识别。

关键创新:GDLLM的关键创新在于:1) 提出了距离感知图结构,有效建模事件之间的长距离依赖关系。2) 设计了软推理时间特征学习范式,增强了模型对局部时序信息的感知。3) 将图结构和软推理机制与大语言模型相结合,充分利用了LLM的知识和推理能力。

关键设计:距离感知图结构使用GAT进行建模,GAT的注意力权重基于事件之间的距离计算。软推理时间特征学习范式通过将LLM的概率输出与多头注意力机制的输出进行融合,实现局部时序信息的增强。损失函数未知,但目标是提升少数类关系的识别精度。

🖼️ 关键图片

📊 实验亮点

GDLLM在TB-Dense和MATRES两个公开数据集上进行了实验,结果表明该方法取得了最先进的性能。尤其是在少数关系类上,GDLLM的性能提升显著,验证了其在处理不平衡数据集方面的优势。具体的性能数据和对比基线在论文中给出,但这里没有提供。

🎯 应用场景

GDLLM在事件时序关系抽取方面具有广泛的应用前景,例如:新闻事件分析、医疗记录理解、金融风险预测等。通过准确识别事件之间的时间关系,可以帮助人们更好地理解事件的发展过程、预测未来的趋势,并做出更明智的决策。该研究成果有助于提升自然语言处理在实际应用中的智能化水平。

📄 摘要(原文)

In Natural Language Processing(NLP), Event Temporal Relation Extraction (ETRE) is to recognize the temporal relations of two events. Prior studies have noted the importance of language models for ETRE. However, the restricted pre-trained knowledge of Small Language Models(SLMs) limits their capability to handle minority class relations in imbalanced classification datasets. For Large Language Models(LLMs), researchers adopt manually designed prompts or instructions, which may introduce extra noise, leading to interference with the model's judgment of the long-distance dependencies between events. To address these issues, we propose GDLLM, a Global Distance-aware modeling approach based on LLMs. We first present a distance-aware graph structure utilizing Graph Attention Network(GAT) to assist the LLMs in capturing long-distance dependency features. Additionally, we design a temporal feature learning paradigm based on soft inference to augment the identification of relations with a short-distance proximity band, which supplements the probabilistic information generated by LLMs into the multi-head attention mechanism. Since the global feature can be captured effectively, our framework substantially enhances the performance of minority relation classes and improves the overall learning ability. Experiments on two publicly available datasets, TB-Dense and MATRES, demonstrate that our approach achieves state-of-the-art (SOTA) performance.