Joint Enhancement of Relational Reasoning for Long-Context LLMs

作者: Zhirui Chen, Wei Shen, Jiashui Huang, Ling Shao

分类: cs.CL

发布日期: 2025-08-28

备注: 9 pages, 5 pages Accepted by EMNLP 2025 Findings

💡 一句话要点

提出JERR框架,通过图推理增强长文本LLM的关系推理能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 长文本理解 关系推理 图神经网络 蒙特卡洛树搜索 大型语言模型

📋 核心要点

- 现有LLM在处理长文本时面临内存限制和复杂推理能力不足的问题,且缺乏透明度,容易产生幻觉。

- JERR框架通过概要提取、图构建和关系推理三个关键步骤,增强LLM对长文本的理解和推理能力。

- 实验结果表明,JERR在ROUGE、F1指标和LLM-Rater评估中均优于现有基线方法,提升了性能。

📝 摘要(中文)

大型语言模型(LLM)在长文本处理方面面临内存限制和复杂任务处理能力不足的挑战,同时缺乏透明度和容易产生幻觉。为了解决这些问题,我们提出了JERR,一种新颖的框架,旨在通过LLM中基于图的推理来增强长文本理解能力。JERR集成了三个关键组件:概要提取、图构建和关系推理。首先,通过策略性地分块文本来提取概要,使模型能够更有效地总结和理解信息。其次,我们构建有向无环图(DAG)来解决冗余,确保逻辑一致性和清晰度。最后,我们结合蒙特卡洛树搜索(MCTS)来帮助模型导航复杂的推理路径,确保更准确和可解释的输出。该框架提供了一种新颖的解决方案,使LLM能够处理扩展的上下文和复杂的推理任务,并具有更高的可靠性和透明度。实验结果表明,JERR在ROUGE和F1指标上始终优于所有基线,并在LLM-Rater评估中获得了最高分。

🔬 方法详解

问题定义:LLM在处理长文本时,由于内存限制和注意力机制的局限性,难以捕捉长距离依赖关系,导致推理能力下降,并且缺乏透明度,容易产生幻觉。现有方法难以有效地提取关键信息,并进行逻辑一致的推理。

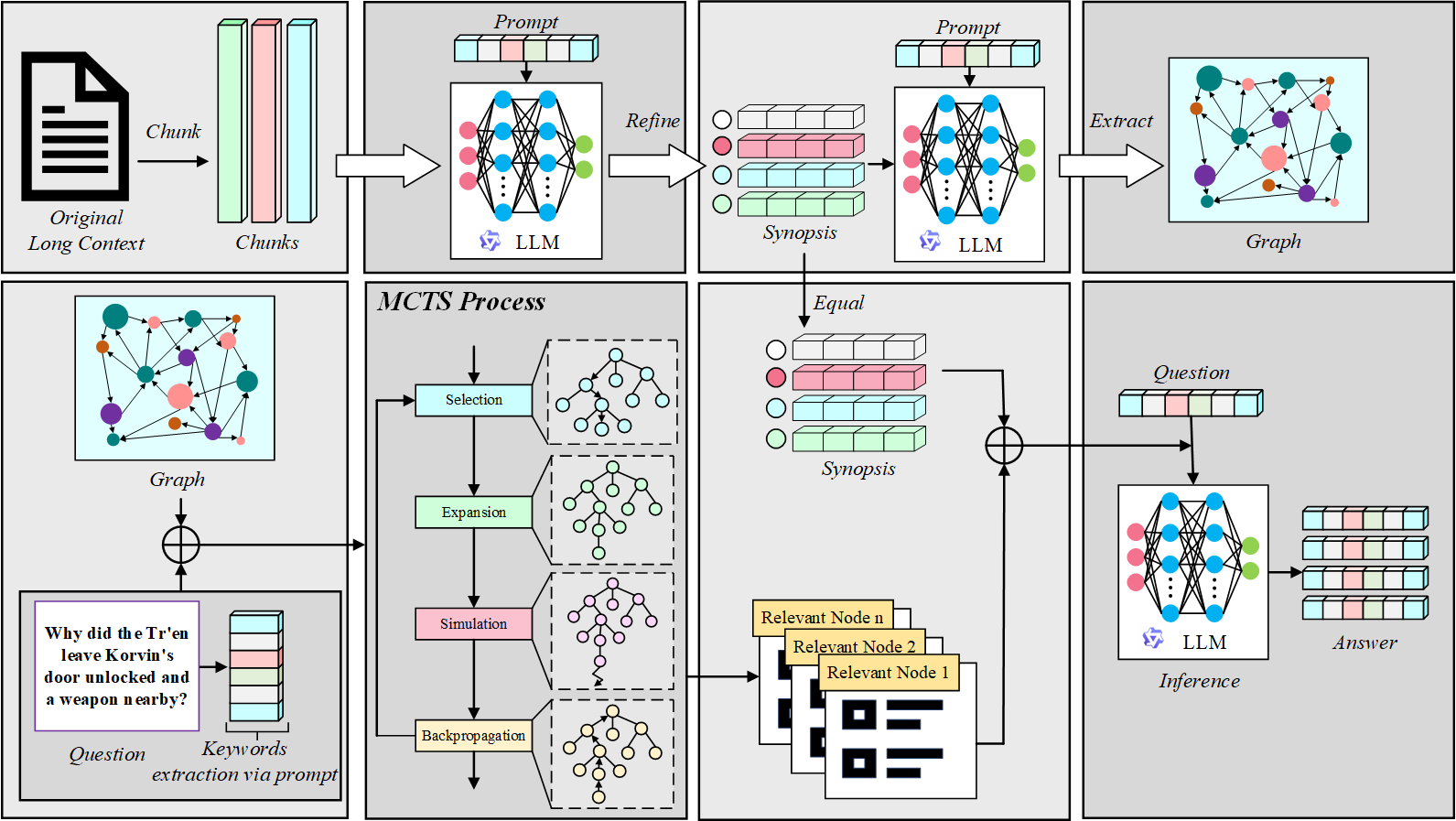

核心思路:JERR的核心思路是将长文本分解为概要信息,构建有向无环图(DAG)来表示文本中的关系,并利用蒙特卡洛树搜索(MCTS)在图上进行推理。通过概要提取减少信息冗余,通过图结构保证逻辑一致性,通过MCTS探索更准确的推理路径。

技术框架:JERR框架包含三个主要模块:1) 概要提取:将长文本分块,并对每个块进行总结,提取关键信息。2) 图构建:基于提取的概要信息,构建有向无环图(DAG),节点表示概要,边表示关系。3) 关系推理:利用蒙特卡洛树搜索(MCTS)在DAG上进行推理,寻找最优的推理路径。

关键创新:JERR的关键创新在于将图推理引入到长文本LLM中,通过显式的图结构来表示文本中的关系,从而增强了模型的推理能力和可解释性。同时,结合MCTS算法,能够有效地探索复杂的推理路径,提高推理的准确性。

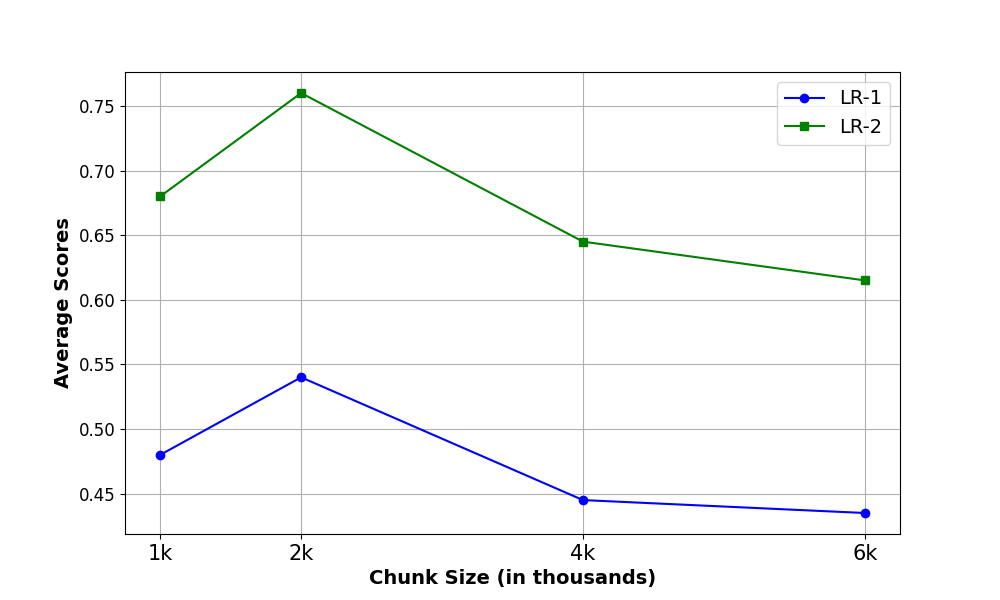

关键设计:概要提取模块采用策略性的文本分块方法,并使用LLM进行摘要生成。图构建模块设计了合理的边连接策略,保证图的逻辑一致性。MCTS模块设计了合适的奖励函数,引导模型探索更准确的推理路径。具体的参数设置和损失函数细节在论文中未明确说明,属于未知信息。

🖼️ 关键图片

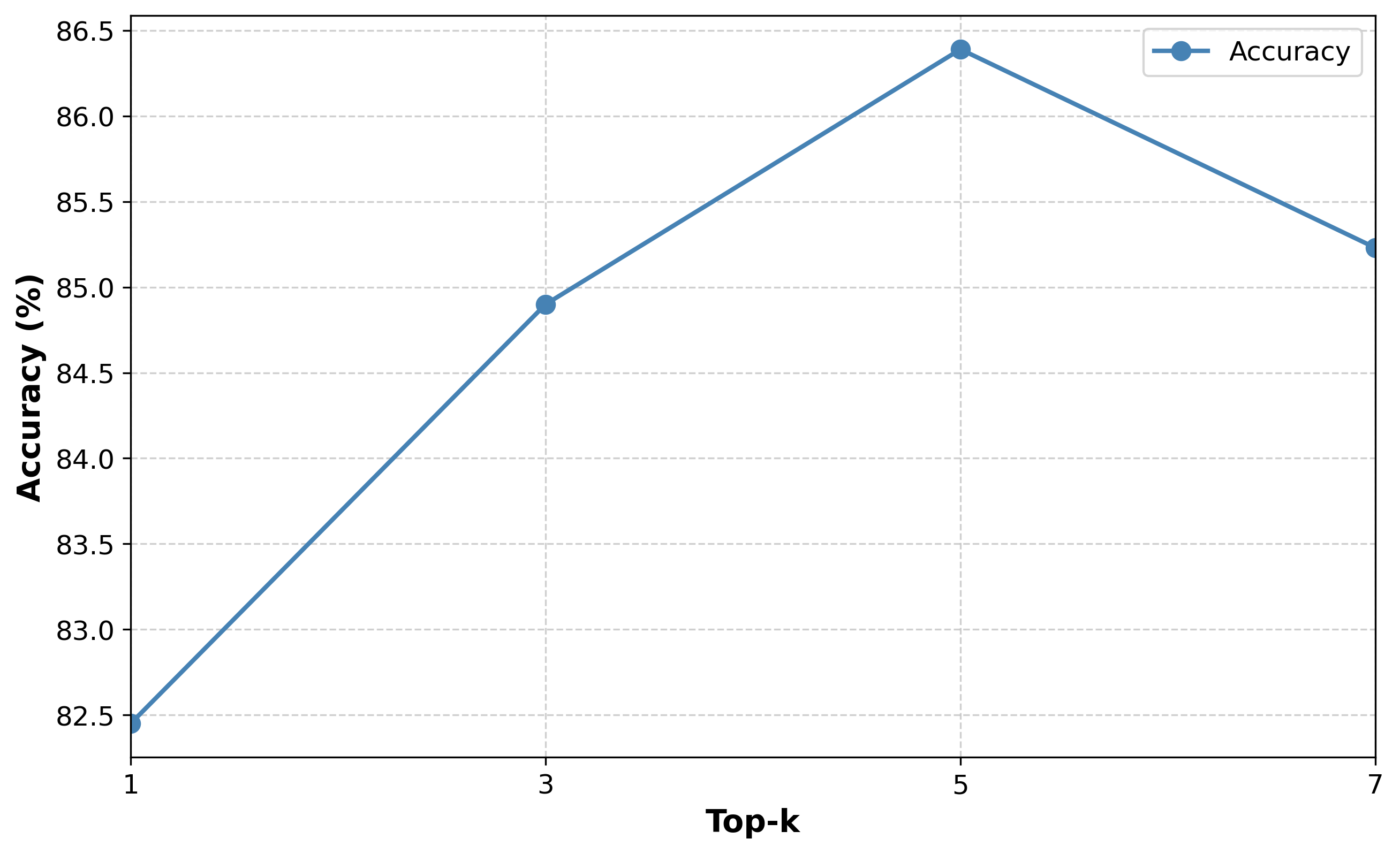

📊 实验亮点

JERR在ROUGE和F1指标上始终优于所有基线方法,表明其在长文本理解和摘要生成方面具有显著优势。此外,JERR在LLM-Rater评估中获得了最高分,证明其生成的文本质量更高,更符合人类的偏好。具体的性能提升幅度在摘要中已提及,此处不再赘述。

🎯 应用场景

JERR框架可应用于需要处理长文本和复杂推理的场景,例如法律文档分析、医学报告解读、金融风险评估等。该研究有助于提升LLM在这些领域的应用能力,提高决策的准确性和可靠性,并增强模型的可解释性,从而提高用户信任度。

📄 摘要(原文)

Despite significant progress, large language models (LLMs) still struggle with long contexts due to memory limitations and their inability to tackle complex and long-context tasks. Additionally, LLMs often suffer from a lack of transparency and are prone to producing hallucinations. To address these challenges, we propose \textbf{JERR}, a novel framework designed to enhance long-context comprehension via graph-based reasoning in LLMs. JERR integrates three key components: synopsis extraction, graph construction, and relational reasoning. First, synopsis is extracted by chunking text strategically, allowing the model to summarize and understand information more efficiently. Second, we build a directed acyclic graph (DAG) to resolve redundancy, ensuring logical consistency and clarity. Finally, we incorporate Monte Carlo Tree Search (MCTS) to help the model navigate complex reasoning paths, ensuring more accurate and interpretable outputs. This framework provides a novel solution that enables LLMs to handle extended contexts and complex reasoning tasks with improved reliability and transparency. Experimental results show that JERR consistently outperforms all baselines on the ROUGE and F1 metrics, achieving the highest scores on the LLM-Rater evaluation.