A Survey on Large Language Model Benchmarks

作者: Shiwen Ni, Guhong Chen, Shuaimin Li, Xuanang Chen, Siyi Li, Bingli Wang, Qiyao Wang, Xingjian Wang, Yifan Zhang, Liyang Fan, Chengming Li, Ruifeng Xu, Le Sun, Min Yang

分类: cs.CL

发布日期: 2025-08-21

💡 一句话要点

系统性综述大语言模型评测基准,分析现有问题并提出未来设计方向。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 评测基准 数据污染 文化偏见 模型评估 自然语言处理 人工智能

📋 核心要点

- 现有大语言模型评测基准存在数据污染、文化偏见等问题,导致评估结果不准确。

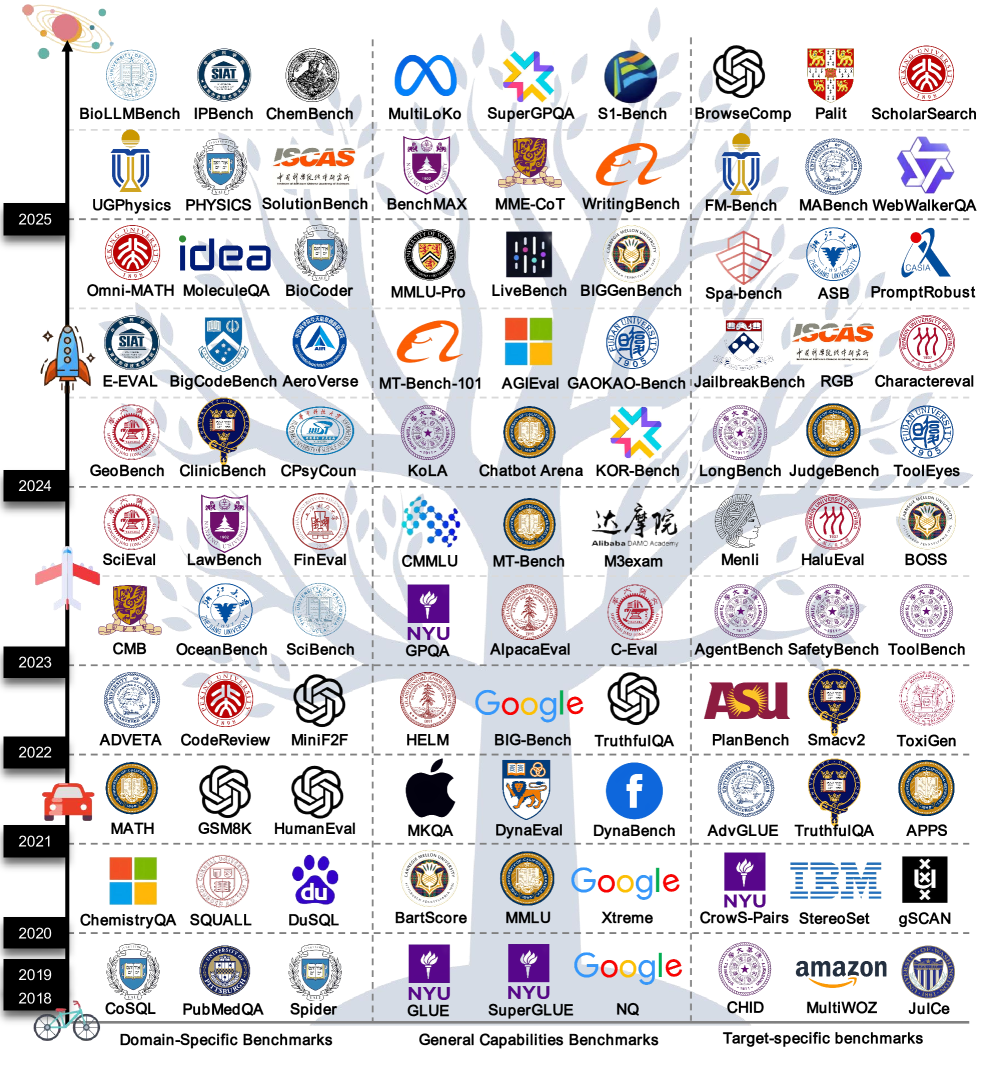

- 该综述对283个基准进行分类,涵盖通用能力、领域特定和目标特定三个方面。

- 论文分析了现有基准的不足,并为未来基准的设计提供了参考方向和建议。

📝 摘要(中文)

近年来,随着大型语言模型能力的深度和广度快速发展,各种相应的评估基准也大量涌现。作为模型性能的定量评估工具,基准不仅是衡量模型能力的核心手段,也是指导模型发展方向和促进技术创新的关键要素。本文首次系统地回顾了当前大型语言模型基准的现状和发展,将283个具有代表性的基准分为三类:通用能力、领域特定和目标特定。通用能力基准涵盖了核心语言学、知识和推理等方面;领域特定基准侧重于自然科学、人文社会科学和工程技术等领域;目标特定基准关注风险、可靠性、代理等方面。我们指出,当前的基准存在数据污染导致的分数虚高、文化和语言偏见导致的不公平评估,以及缺乏对过程可信度和动态环境的评估等问题,并为未来的基准创新提供了可参考的设计范式。

🔬 方法详解

问题定义:现有的大语言模型评测基准存在诸多问题。首先,数据污染问题导致模型在训练过程中接触到测试数据,从而造成评估分数虚高,无法真实反映模型的泛化能力。其次,文化和语言偏见使得某些语言或文化背景的模型在评估中处于劣势,导致评估结果不公平。此外,现有基准缺乏对模型推理过程可信度的评估,以及在动态环境下的适应性评估。这些问题严重影响了基准的有效性和可靠性。

核心思路:该综述的核心思路是对现有的大语言模型评测基准进行系统性的梳理和分类,从而全面了解当前基准的发展现状和存在的问题。通过对各类基准的深入分析,总结出当前基准的不足之处,并为未来的基准设计提供指导方向。这种思路旨在推动大语言模型评测体系的完善,从而更好地评估和提升模型的能力。

技术框架:该综述的技术框架主要包括以下几个步骤:1) 收集整理现有的大语言模型评测基准,共收集了283个具有代表性的基准。2) 对这些基准进行分类,将其分为通用能力、领域特定和目标特定三个类别。3) 对每个类别的基准进行深入分析,评估其优点和不足。4) 总结现有基准存在的问题,例如数据污染、文化偏见等。5) 提出未来基准设计的建议,例如加强对过程可信度和动态环境的评估。

关键创新:该综述的关键创新在于首次对大语言模型评测基准进行了系统性的回顾和分类。以往的研究往往只关注个别基准或特定领域的基准,而该综述则对各类基准进行了全面的梳理,从而更全面地了解了当前基准的发展现状。此外,该综述还深入分析了现有基准存在的问题,并为未来的基准设计提供了具体的建议,具有重要的指导意义。

关键设计:该综述的关键设计在于其分类体系和问题分析。分类体系将基准分为通用能力、领域特定和目标特定三个类别,从而更清晰地了解各类基准的特点和适用范围。问题分析则深入探讨了现有基准存在的数据污染、文化偏见等问题,并提出了相应的解决方案。这些设计使得该综述具有较高的学术价值和实用价值。

🖼️ 关键图片

📊 实验亮点

该综述收集并分类了283个大语言模型评测基准,是目前最全面的基准综述之一。论文指出了现有基准普遍存在的数据污染和文化偏见问题,这些问题会导致模型评估结果失真。此外,论文还强调了对模型推理过程可信度和动态环境适应性的评估的重要性。

🎯 应用场景

该研究成果可应用于大语言模型的开发、评估和优化。通过了解现有基准的优缺点,开发者可以更好地选择合适的基准来评估模型的性能,并针对性地改进模型。此外,该研究提出的未来基准设计建议,可以指导研究人员开发更有效、更公平的评估基准,从而推动大语言模型技术的进步。

📄 摘要(原文)

In recent years, with the rapid development of the depth and breadth of large language models' capabilities, various corresponding evaluation benchmarks have been emerging in increasing numbers. As a quantitative assessment tool for model performance, benchmarks are not only a core means to measure model capabilities but also a key element in guiding the direction of model development and promoting technological innovation. We systematically review the current status and development of large language model benchmarks for the first time, categorizing 283 representative benchmarks into three categories: general capabilities, domain-specific, and target-specific. General capability benchmarks cover aspects such as core linguistics, knowledge, and reasoning; domain-specific benchmarks focus on fields like natural sciences, humanities and social sciences, and engineering technology; target-specific benchmarks pay attention to risks, reliability, agents, etc. We point out that current benchmarks have problems such as inflated scores caused by data contamination, unfair evaluation due to cultural and linguistic biases, and lack of evaluation on process credibility and dynamic environments, and provide a referable design paradigm for future benchmark innovation.