eDIF: A European Deep Inference Fabric for Remote Interpretability of LLM

作者: Irma Heithoff. Marc Guggenberger, Sandra Kalogiannis, Susanne Mayer, Fabian Maag, Sigurd Schacht, Carsten Lanquillon

分类: cs.CL

发布日期: 2025-08-14

备注: 9 pages

💡 一句话要点

构建欧洲深度推理平台eDIF,实现LLM远程可解释性研究

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: LLM可解释性 深度推理平台 远程访问 GPU集群 机制可解释性

📋 核心要点

- 现有LLM可解释性研究资源分布不均,欧洲研究人员难以获得足够的计算资源和工具。

- eDIF项目旨在构建一个可远程访问的、基于GPU的集群,提供LLM可解释性分析所需的基础设施。

- 试点研究表明,该平台性能稳定,用户参与度高,为构建LLM可解释性研究社区奠定了基础。

📝 摘要(中文)

本文介绍了一项关于部署欧洲深度推理平台(eDIF)的可行性研究,该平台是与NDIF兼容的基础设施,旨在支持大型语言模型(LLM)的机制可解释性研究。为了在欧洲广泛普及LLM可解释性基础设施,该项目旨在为研究界普及先进的模型分析能力。该项目引入了一个位于安斯巴赫应用科技大学的基于GPU的集群,并与合作机构互连,从而可以通过NNsight API进行远程模型检查。一项结构化的试点研究涉及来自欧洲各地的16位研究人员,评估了该平台的技术性能、可用性和科学效用。用户对GPT-2和DeepSeek-R1-70B等模型进行了干预,例如激活修补、因果追踪和表征分析。研究表明,用户参与度逐渐提高,平台性能稳定,并且远程实验能力受到好评。它也标志着围绕该平台建立用户社区的起点。未来的发展路线图将解决已发现的局限性,例如激活数据下载持续时间过长以及间歇性执行中断。这项举措标志着在欧洲广泛普及LLM可解释性基础设施方面迈出了重要一步,并为更广泛的部署、扩展的工具和机制可解释性研究中持续的社区协作奠定了基础。

🔬 方法详解

问题定义:当前大型语言模型(LLM)的可解释性研究需要大量的计算资源和专业工具。欧洲的研究人员,特别是那些不在大型研究机构的研究人员,往往难以获得这些资源,这阻碍了该领域的发展。现有的可解释性工具和平台可能不够普及,或者使用起来过于复杂,限制了研究的范围和深度。

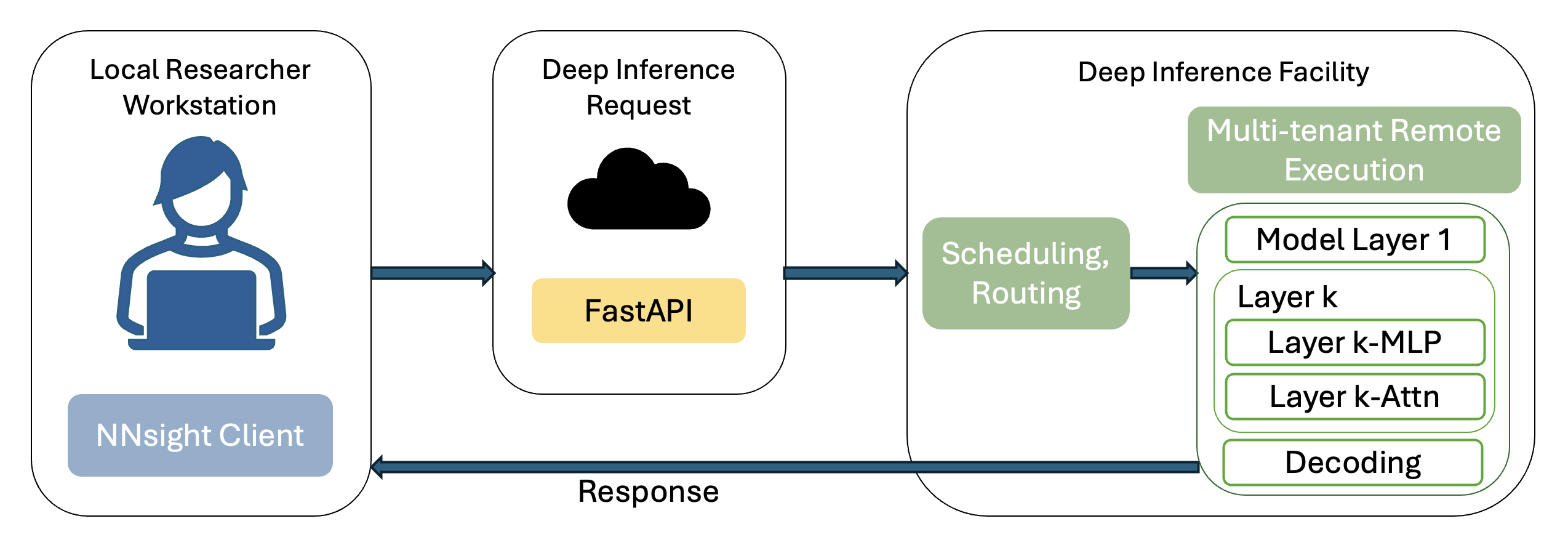

核心思路:eDIF的核心思路是创建一个可远程访问的、高性能的计算平台,并配备易于使用的可解释性工具,从而 democratize LLM 的可解释性研究。通过集中资源并提供标准化的接口,eDIF 旨在降低研究门槛,促进更广泛的参与和合作。

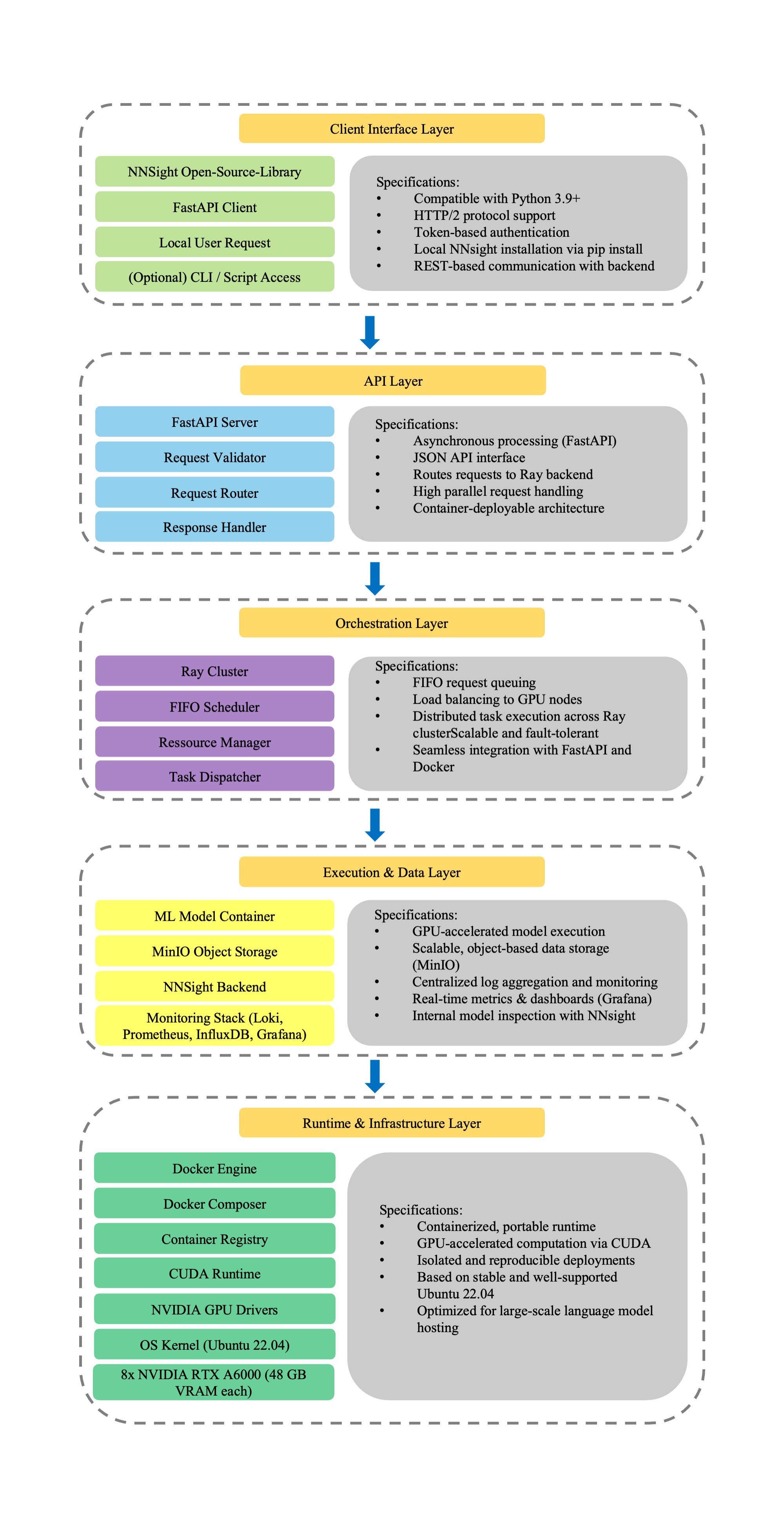

技术框架:eDIF 的整体架构包括一个位于安斯巴赫应用科技大学的 GPU 集群,该集群通过网络与欧洲各地的合作机构连接。研究人员可以通过 NNsight API 远程访问该集群,并使用各种可解释性工具,例如激活修补、因果追踪和表征分析。该平台还提供数据存储和管理功能,以便研究人员可以共享和重用实验数据。

关键创新:eDIF 的关键创新在于其作为欧洲范围内首个专门为 LLM 可解释性研究设计的大规模基础设施。它不仅提供了强大的计算能力,还集成了各种先进的可解释性工具,并致力于构建一个活跃的用户社区。这种综合性的方法旨在加速 LLM 可解释性研究的进展。

关键设计:eDIF 的关键设计包括:(1) 选择高性能 GPU 以满足 LLM 可解释性研究的计算需求;(2) 使用 NNsight API 提供统一的远程访问接口;(3) 集成常用的可解释性工具,例如激活修补和因果追踪;(4) 建立用户社区,促进知识共享和合作;(5) 实施监控和维护机制,确保平台的稳定性和可靠性。

🖼️ 关键图片

📊 实验亮点

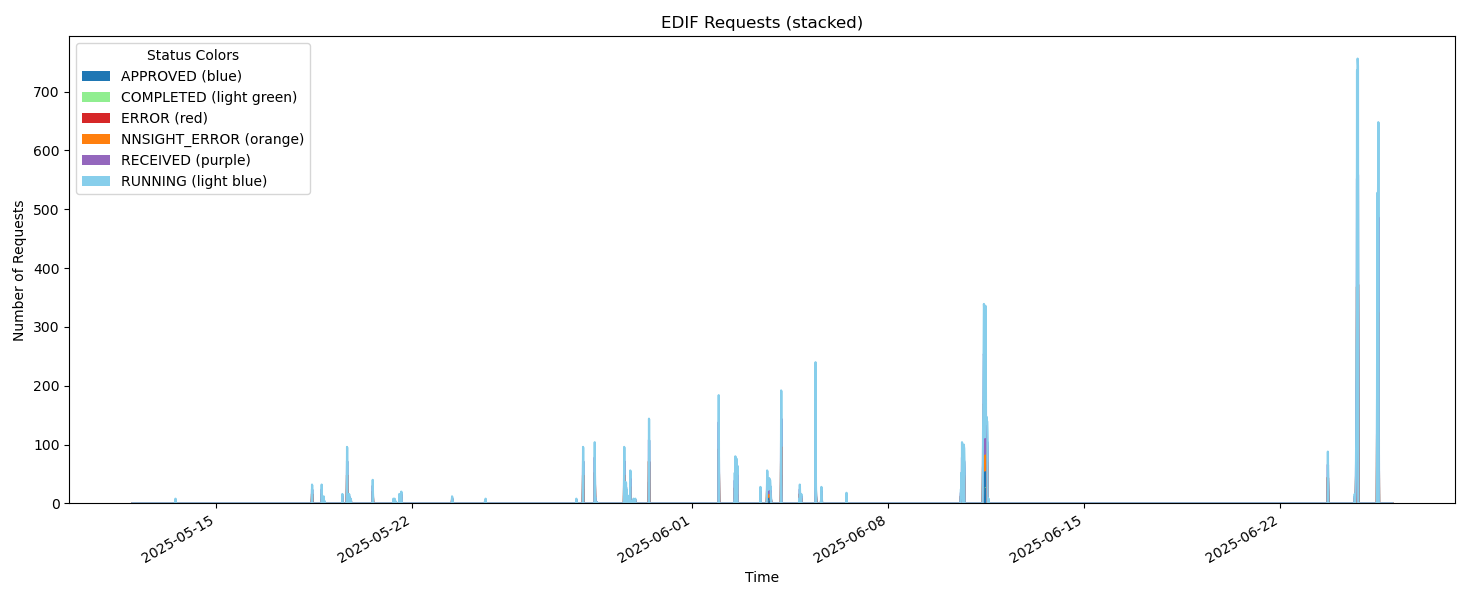

试点研究表明,eDIF平台能够稳定运行,并支持用户进行激活修补、因果追踪等可解释性实验。用户对平台的远程访问能力和易用性给予了积极评价。虽然存在激活数据下载时间较长等问题,但平台的用户参与度逐渐提高,表明其具有良好的发展潜力。该平台成功支持了对GPT-2和DeepSeek-R1-70B等模型的分析。

🎯 应用场景

eDIF平台可应用于LLM安全风险评估、模型偏见检测与消除、以及提升模型透明度和可信度等领域。通过提供可解释性分析工具,该平台有助于研究人员和开发者更好地理解LLM的行为,从而开发出更安全、可靠和公平的AI系统。未来,eDIF有望成为欧洲乃至全球LLM可解释性研究的重要基础设施。

📄 摘要(原文)

This paper presents a feasibility study on the deployment of a European Deep Inference Fabric (eDIF), an NDIF-compatible infrastructure designed to support mechanistic interpretability research on large language models. The need for widespread accessibility of LLM interpretability infrastructure in Europe drives this initiative to democratize advanced model analysis capabilities for the research community. The project introduces a GPU-based cluster hosted at Ansbach University of Applied Sciences and interconnected with partner institutions, enabling remote model inspection via the NNsight API. A structured pilot study involving 16 researchers from across Europe evaluated the platform's technical performance, usability, and scientific utility. Users conducted interventions such as activation patching, causal tracing, and representation analysis on models including GPT-2 and DeepSeek-R1-70B. The study revealed a gradual increase in user engagement, stable platform performance throughout, and a positive reception of the remote experimentation capabilities. It also marked the starting point for building a user community around the platform. Identified limitations such as prolonged download durations for activation data as well as intermittent execution interruptions are addressed in the roadmap for future development. This initiative marks a significant step towards widespread accessibility of LLM interpretability infrastructure in Europe and lays the groundwork for broader deployment, expanded tooling, and sustained community collaboration in mechanistic interpretability research.