How Do LLMs Persuade? Linear Probes Can Uncover Persuasion Dynamics in Multi-Turn Conversations

作者: Brandon Jaipersaud, David Krueger, Ekdeep Singh Lubana

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-08-07

💡 一句话要点

利用线性探针揭示LLM在多轮对话中的说服动态

🎯 匹配领域: 支柱一:机器人控制 (Robot Control) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 说服力 线性探针 多轮对话 认知科学

📋 核心要点

- 现有方法难以有效分析LLM在多轮对话中的说服过程,计算效率低。

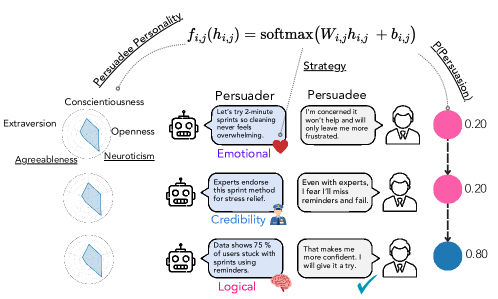

- 利用认知科学知识,训练线性探针来识别说服过程中的关键因素,如说服成功、被说服者人格和说服策略。

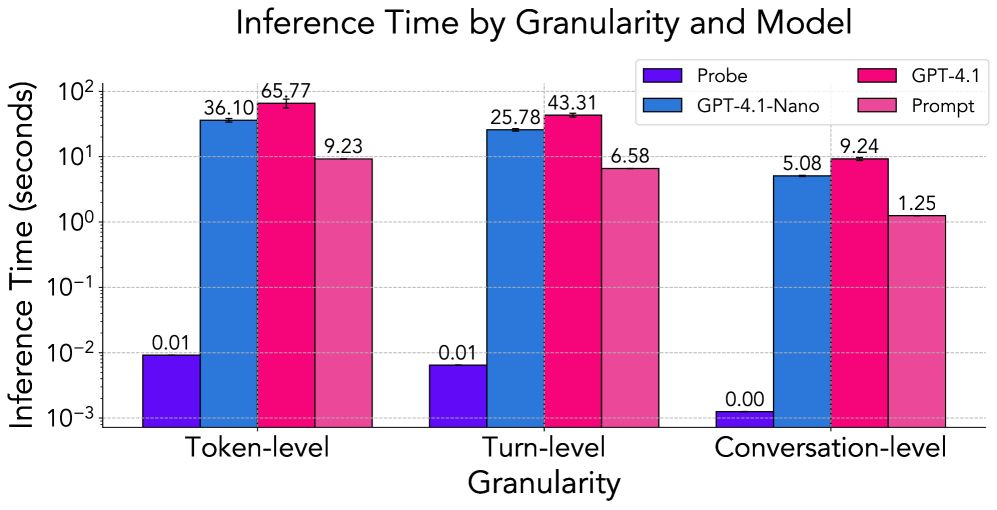

- 实验表明,线性探针能够有效捕获说服动态,且在某些情况下优于基于提示的方法,同时计算效率更高。

📝 摘要(中文)

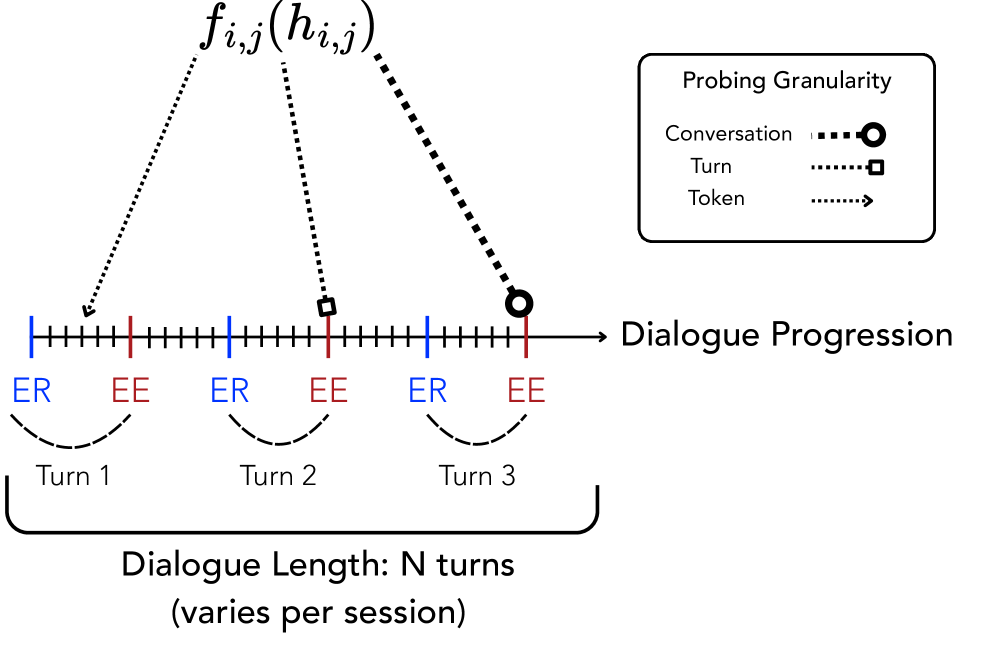

大型语言模型(LLM)已经展现出说服人类的能力,但我们对这种动态如何发生的理解仍然有限。最近的研究使用线性探针这种轻量级工具来分析模型表征,以研究LLM的各种能力,例如模拟用户情感和政治观点。受此启发,我们应用探针来研究自然、多轮对话中的说服动态。我们利用认知科学的见解,训练探针来识别说服的不同方面:说服成功、被说服者的人格和说服策略。结果表明,尽管探针很简单,但它们可以在样本和数据集层面捕获说服的各个方面。例如,探针可以识别对话中被说服者被说服的点,或者说服成功通常发生在整个数据集中的哪个位置。我们还表明,除了比基于提示的方法更快之外,探针在某些设置中(例如揭示说服策略时)可以做得同样好,甚至优于提示。这表明探针是研究其他复杂行为(如欺骗和操纵)的可行途径,尤其是在多轮设置和大规模数据集分析中,在这些情况下,基于提示的方法在计算上效率低下。

🔬 方法详解

问题定义:论文旨在理解大型语言模型(LLM)如何在多轮对话中进行说服,以及如何有效地分析这种说服动态。现有方法,特别是基于提示的方法,计算成本高昂,难以应用于大规模数据集和多轮对话场景。因此,需要一种更高效、更轻量级的方法来研究LLM的说服能力。

核心思路:论文的核心思路是利用线性探针来分析LLM在对话过程中的内部表征,从而揭示其说服策略和动态。线性探针是一种轻量级的分析工具,可以用来预测模型内部状态与特定任务或属性之间的关系。通过训练探针来预测说服相关的因素,可以有效地理解LLM的说服机制。

技术框架:整体框架包括以下几个主要步骤:1) 收集多轮对话数据集,其中包含说服者和被说服者之间的交互;2) 使用LLM处理对话数据,提取每一轮对话的表征;3) 基于认知科学的理论,定义与说服相关的关键属性,如说服成功、被说服者人格和说服策略;4) 训练线性探针来预测这些属性,使用LLM的内部表征作为输入;5) 分析探针的预测结果,从而理解LLM的说服动态。

关键创新:论文的关键创新在于将线性探针应用于分析LLM的说服能力,特别是在多轮对话的场景下。与传统的基于提示的方法相比,线性探针具有更高的计算效率和可解释性。此外,论文还结合了认知科学的理论,定义了与说服相关的关键属性,从而使得探针的训练更加有效。

关键设计:论文的关键设计包括:1) 选择合适的LLM作为对话处理的基础模型;2) 设计有效的线性探针结构,通常是一个简单的线性层,将LLM的内部表征映射到预测的属性;3) 选择合适的损失函数来训练探针,例如交叉熵损失或均方误差损失,取决于预测属性的类型;4) 使用合适的评估指标来评估探针的性能,例如准确率、F1值等。

🖼️ 关键图片

📊 实验亮点

实验结果表明,线性探针能够有效识别对话中被说服者被说服的关键点,以及说服成功在整个数据集中的普遍发生位置。在揭示说服策略方面,线性探针的性能与基于提示的方法相当,甚至在某些情况下优于后者,同时计算效率显著提高。

🎯 应用场景

该研究成果可应用于开发更具说服力的对话系统,例如智能客服、谈判助手等。同时,也有助于理解和防范LLM的潜在滥用,例如欺骗和操纵。未来,可以进一步研究如何利用这些知识来提高人机交互的安全性与可靠性。

📄 摘要(原文)

Large Language Models (LLMs) have started to demonstrate the ability to persuade humans, yet our understanding of how this dynamic transpires is limited. Recent work has used linear probes, lightweight tools for analyzing model representations, to study various LLM skills such as the ability to model user sentiment and political perspective. Motivated by this, we apply probes to study persuasion dynamics in natural, multi-turn conversations. We leverage insights from cognitive science to train probes on distinct aspects of persuasion: persuasion success, persuadee personality, and persuasion strategy. Despite their simplicity, we show that they capture various aspects of persuasion at both the sample and dataset levels. For instance, probes can identify the point in a conversation where the persuadee was persuaded or where persuasive success generally occurs across the entire dataset. We also show that in addition to being faster than expensive prompting-based approaches, probes can do just as well and even outperform prompting in some settings, such as when uncovering persuasion strategy. This suggests probes as a plausible avenue for studying other complex behaviours such as deception and manipulation, especially in multi-turn settings and large-scale dataset analysis where prompting-based methods would be computationally inefficient.