MyCulture: Exploring Malaysia's Diverse Culture under Low-Resource Language Constraints

作者: Zhong Ken Hew, Jia Xin Low, Sze Jue Yang, Chee Seng Chan

分类: cs.CL, cs.AI

发布日期: 2025-08-07 (更新: 2025-08-08)

💡 一句话要点

MyCulture:提出马来西亚文化基准,评估低资源语言约束下LLM的文化理解能力。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 低资源语言 文化理解 大型语言模型 评估基准 马来西亚文化 文化偏见 开放式问答

📋 核心要点

- 现有LLM训练数据偏向高资源语言,导致其在低资源语言文化理解方面存在不足和偏见。

- MyCulture基准通过开放式多项选择题形式,减少猜测和格式偏见,更准确评估LLM的文化理解能力。

- 实验结果揭示了不同LLM在马来西亚文化理解方面的显著差异,强调了文化包容性基准的重要性。

📝 摘要(中文)

大型语言模型(LLM)由于训练数据主要由英语和汉语等高资源语言主导,常常表现出文化偏见。这给准确地表示和评估不同的文化背景带来了挑战,尤其是在低资源语言环境中。为了解决这个问题,我们推出了MyCulture,这是一个旨在全面评估LLM在马来西亚文化方面的基准,涵盖艺术、服饰、习俗、娱乐、食物和宗教六个方面,并以马来语呈现。与传统的基准不同,MyCulture采用了一种新颖的开放式多项选择题形式,没有预定义的选项,从而减少了猜测并减轻了格式偏见。我们为这种开放式结构在提高公平性和区分能力方面的有效性提供了理论依据。此外,我们通过比较模型在结构化输出与自由形式输出上的性能来分析结构性偏见,并通过多语言提示变体来评估语言偏见。我们对一系列区域和国际LLM的评估揭示了文化理解方面的显著差异,突显了在LLM的开发和评估中迫切需要具有文化基础和语言包容性的基准。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLM)在低资源语言环境下,对特定文化(如马来西亚文化)理解不足和存在偏见的问题。现有方法依赖于高资源语言数据,导致LLM在处理低资源语言文化相关任务时表现不佳,缺乏针对性的评估基准。

核心思路:论文的核心思路是构建一个专门针对马来西亚文化的评估基准MyCulture,并采用开放式的多项选择题形式,以减少猜测和格式偏见。通过这种方式,更真实地反映LLM对马来西亚文化的理解程度,并促进更公平和更具区分度的评估。

技术框架:MyCulture基准包含六个文化支柱:艺术、服饰、习俗、娱乐、食物和宗教。评估过程包括:1) 使用马来语提出与文化支柱相关的问题;2) LLM生成答案;3) 评估生成的答案的质量。论文还设计了结构化输出与自由形式输出的对比实验,以及多语言提示变体实验,以分析结构性偏见和语言偏见。

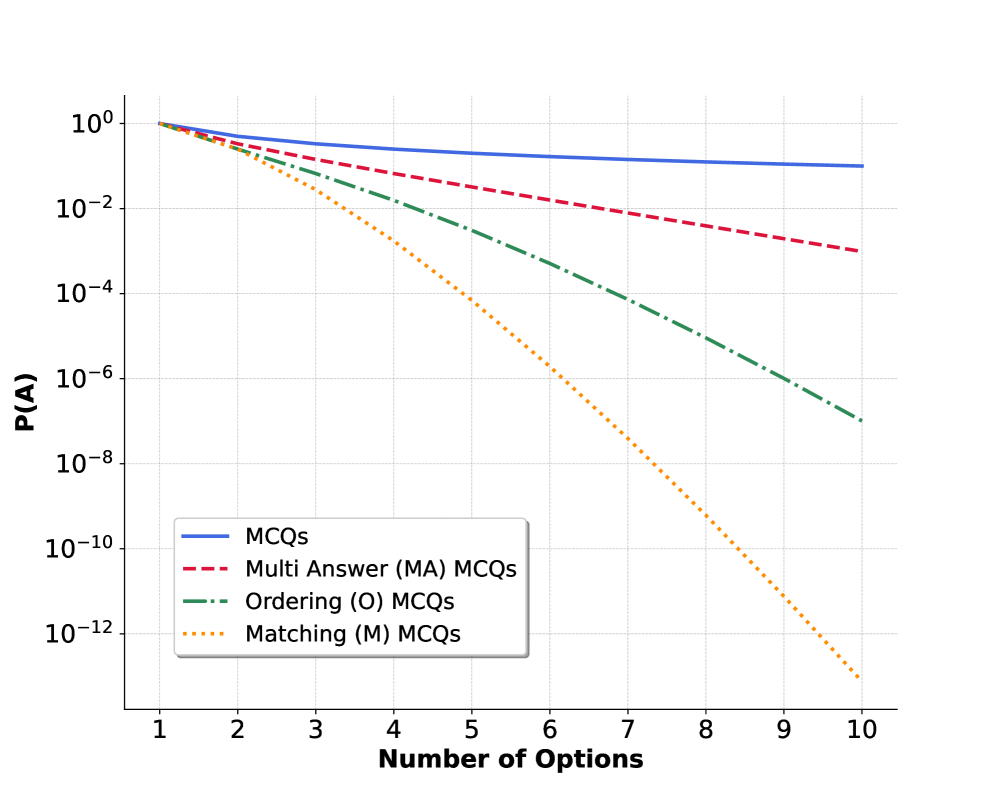

关键创新:MyCulture基准的关键创新在于其开放式的多项选择题形式,即不提供预定义的选项。这种设计可以有效减少模型通过猜测获得高分的可能性,从而更准确地评估模型对文化的真正理解。此外,该基准专注于低资源语言环境下的文化理解,填补了现有LLM评估基准的空白。

关键设计:开放式多项选择题的设计是关键。问题以马来语提出,要求模型生成答案,然后人工或自动评估答案的准确性和相关性。论文可能使用了BLEU、ROUGE等指标来评估生成答案的质量。此外,结构化输出与自由形式输出的对比实验,以及多语言提示变体实验,旨在分析不同类型的偏见对模型性能的影响。具体的参数设置、损失函数、网络结构等技术细节在论文中可能没有详细描述,属于LLM本身的技术细节。

🖼️ 关键图片

📊 实验亮点

该研究构建了MyCulture基准,揭示了现有LLM在马来西亚文化理解方面的显著差异。通过开放式多项选择题形式,有效减少了猜测和格式偏见,提供了更准确的文化理解评估。实验结果表明,即使是大型LLM,在低资源语言文化理解方面仍存在较大提升空间,突显了文化包容性基准的必要性。

🎯 应用场景

MyCulture基准可用于评估和改进LLM在低资源语言文化理解方面的能力,促进文化包容性AI的发展。该研究成果可应用于文化遗产保护、跨文化交流、个性化推荐系统等领域,有助于构建更公平、更具文化敏感性的AI系统,并提升LLM在特定文化背景下的应用效果。

📄 摘要(原文)

Large Language Models (LLMs) often exhibit cultural biases due to training data dominated by high-resource languages like English and Chinese. This poses challenges for accurately representing and evaluating diverse cultural contexts, particularly in low-resource language settings. To address this, we introduce MyCulture, a benchmark designed to comprehensively evaluate LLMs on Malaysian culture across six pillars: arts, attire, customs, entertainment, food, and religion presented in Bahasa Melayu. Unlike conventional benchmarks, MyCulture employs a novel open-ended multiple-choice question format without predefined options, thereby reducing guessing and mitigating format bias. We provide a theoretical justification for the effectiveness of this open-ended structure in improving both fairness and discriminative power. Furthermore, we analyze structural bias by comparing model performance on structured versus free-form outputs, and assess language bias through multilingual prompt variations. Our evaluation across a range of regional and international LLMs reveals significant disparities in cultural comprehension, highlighting the urgent need for culturally grounded and linguistically inclusive benchmarks in the development and assessment of LLMs.