Efficient Reasoning for Large Reasoning Language Models via Certainty-Guided Reflection Suppression

作者: Jiameng Huang, Baijiong Lin, Guhao Feng, Jierun Chen, Di He, Lu Hou

分类: cs.CL, cs.AI, cs.LG

发布日期: 2025-08-07 (更新: 2025-11-17)

备注: Accepted by AAAI 2026

💡 一句话要点

提出CGRS方法,通过置信度引导抑制反思,提升大语言模型推理效率。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 推理效率 置信度引导 反思抑制 自回归生成

📋 核心要点

- 大型推理语言模型存在过度思考问题,反思行为导致冗余推理,增加计算成本。

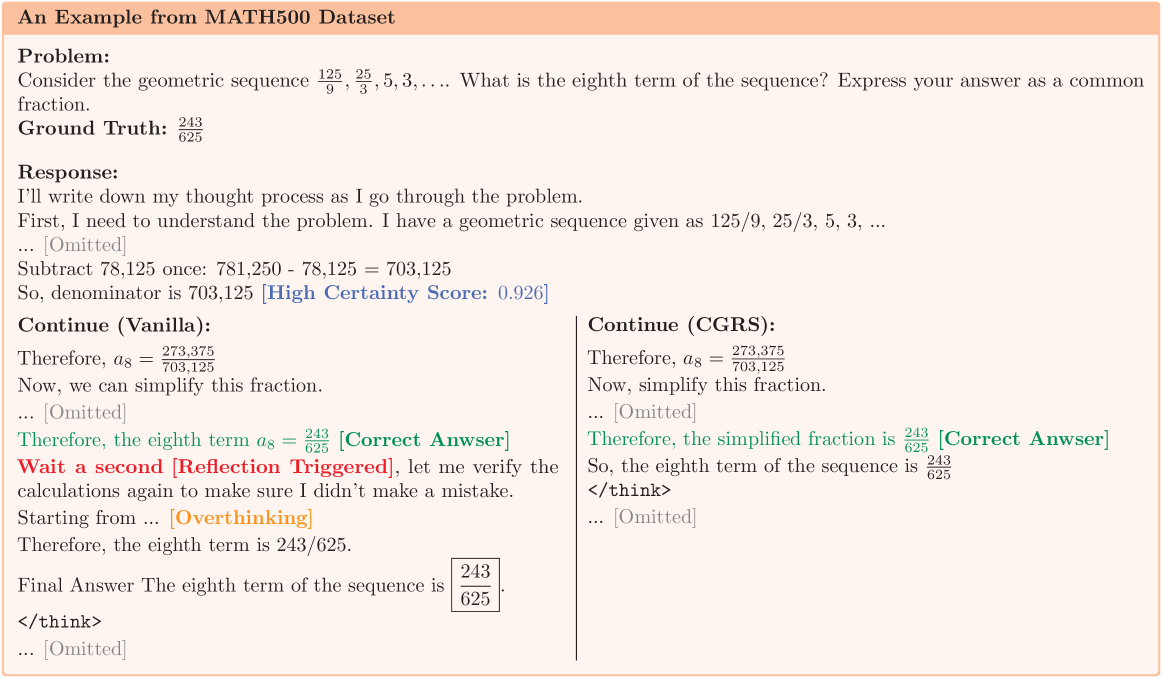

- CGRS方法通过置信度引导,动态抑制反思触发词生成,避免不必要的反思循环。

- 实验表明,CGRS在多个推理基准上显著减少token使用,同时保持甚至提升推理准确性。

📝 摘要(中文)

现有的大型推理语言模型(LRLM)采用长链式思维推理,并具有复杂的反思行为,通常由特定的触发词(例如“Wait”和“Alternatively”)来指示,以提高性能。然而,这些反思行为可能导致过度思考问题,即生成冗余的推理步骤,不必要地增加token使用量,提高推理成本,并降低实际效用。本文提出了一种名为置信度引导反思抑制(CGRS)的新方法,该方法在保持推理准确性的同时,减轻LRLM中的过度思考。CGRS通过在模型对其当前响应表现出高度置信度时,动态抑制模型生成反思触发词,从而防止冗余的反思循环,而不影响输出质量。我们的方法与模型无关,不需要重新训练或架构修改,并且可以与现有的自回归生成流程无缝集成。在四个推理基准(即AIME24、AMC23、MATH500和GPQA-D)上进行的大量实验证明了CGRS的有效性:它在保持准确性的同时,平均减少了18.5%到41.9%的token使用量。与最先进的基线相比,它还在长度减少和性能之间实现了最佳平衡。这些结果在模型架构(例如,DeepSeek-R1-Distill系列、QwQ-32B和Qwen3系列)和规模(4B到32B参数)上保持一致,突出了CGRS在高效推理方面的实际价值。

🔬 方法详解

问题定义:大型推理语言模型(LRLM)在进行复杂推理时,会生成大量的中间步骤,其中一些步骤是冗余的,导致token使用量增加,推理速度降低,实际应用成本上升。现有方法难以有效区分必要的反思和冗余的反思,容易造成过度思考。

核心思路:论文的核心思路是利用模型自身的置信度来判断是否需要进行反思。当模型对当前答案的置信度较高时,则认为不需要进一步的反思,从而抑制反思行为的发生。这样可以在保证推理准确性的前提下,减少冗余的推理步骤。

技术框架:CGRS方法可以无缝集成到现有的自回归生成流程中,无需对模型架构进行修改或重新训练。其主要流程包括:1)模型生成token序列;2)计算模型对当前token序列的置信度;3)如果置信度高于设定的阈值,则抑制反思触发词的生成;4)否则,允许模型继续生成,进行反思。

关键创新:CGRS的关键创新在于利用模型自身的置信度来动态控制反思行为。与现有方法相比,CGRS不需要人工干预或额外的训练数据,能够自适应地调整反思的程度,从而在推理准确性和效率之间取得更好的平衡。

关键设计:CGRS的关键设计包括:1)置信度计算方法:可以使用模型输出的softmax概率或其他置信度估计方法;2)阈值设定:需要根据具体的任务和模型选择合适的置信度阈值,以控制反思抑制的强度;3)反思触发词列表:需要定义一组反思触发词,用于判断模型是否正在进行反思。

🖼️ 关键图片

📊 实验亮点

实验结果表明,CGRS在AIME24、AMC23、MATH500和GPQA-D四个推理基准上,平均减少了18.5%到41.9%的token使用量,同时保持了推理准确性。与现有方法相比,CGRS在长度减少和性能之间取得了更好的平衡,并且在不同模型架构和规模上都表现出一致的有效性。

🎯 应用场景

CGRS方法可广泛应用于需要高效推理的场景,例如智能问答、代码生成、数学问题求解等。通过减少token使用量,可以降低推理成本,提高响应速度,从而提升用户体验。该方法尤其适用于资源受限的设备或需要大规模部署的场景。

📄 摘要(原文)

Recent Large Reasoning Language Models (LRLMs) employ long chain-of-thought reasoning with complex reflection behaviors, typically signaled by specific trigger words (e.g., "Wait" and "Alternatively") to enhance performance. However, these reflection behaviors can lead to the overthinking problem where the generation of redundant reasoning steps that unnecessarily increase token usage, raise inference costs, and reduce practical utility. In this paper, we propose Certainty-Guided Reflection Suppression (CGRS), a novel method that mitigates overthinking in LRLMs while maintaining reasoning accuracy. CGRS operates by dynamically suppressing the model's generation of reflection triggers when it exhibits high confidence in its current response, thereby preventing redundant reflection cycles without compromising output quality. Our approach is model-agnostic, requires no retraining or architectural modifications, and can be integrated seamlessly with existing autoregressive generation pipelines. Extensive experiments across four reasoning benchmarks (i.e., AIME24, AMC23, MATH500, and GPQA-D) demonstrate CGRS's effectiveness: it reduces token usage by an average of 18.5% to 41.9% while preserving accuracy. It also achieves the optimal balance between length reduction and performance compared to state-of-the-art baselines. These results hold consistently across model architectures (e.g., DeepSeek-R1-Distill series, QwQ-32B, and Qwen3 family) and scales (4B to 32B parameters), highlighting CGRS's practical value for efficient reasoning.