Resource-Limited Joint Multimodal Sentiment Reasoning and Classification via Chain-of-Thought Enhancement and Distillation

作者: Haonan Shangguan, Xiaocui Yang, Shi Feng, Daling Wang, Yifei Zhang, Ge Yu

分类: cs.CL, cs.AI

发布日期: 2025-08-07

💡 一句话要点

提出MulCoT-RD以解决资源受限环境下的多模态情感推理与分类问题

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多模态情感分析 蒸馏训练 轻量级模型 情感推理 社交媒体分析 多任务学习 模型可解释性

📋 核心要点

- 现有方法主要依赖于大型模型进行情感分类,忽视了在资源受限环境中进行自主情感推理的能力。

- 本文提出的MulCoT-RD模型通过教师-助手-学生蒸馏范式,旨在实现轻量级的多模态情感推理与分类。

- 在四个数据集上的实验表明,MulCoT-RD在仅3B参数的情况下,表现出强大的性能和良好的可解释性。

📝 摘要(中文)

随着社交媒体平台上丰富的多模态内容的激增,多模态情感分析(MSA)得到了显著发展。当前的方法主要依赖于参数庞大的多模态大型语言模型(MLLM)进行情感分类,而忽视了在资源受限环境中自主生成多模态情感推理的能力。为此,本文聚焦于资源受限的联合多模态情感推理与分类任务(JMSRC),提出了一种轻量级模型MulCoT-RD,采用“教师-助手-学生”蒸馏范式,旨在解决资源受限环境中的部署约束。实验结果表明,MulCoT-RD在仅有3B参数的情况下,在JMSRC任务上表现出色,具有良好的泛化能力和增强的可解释性。

🔬 方法详解

问题定义:本文旨在解决资源受限环境下的联合多模态情感推理与分类(JMSRC)问题。现有方法多依赖于参数庞大的模型,导致在资源有限的情况下难以部署。

核心思路:提出MulCoT-RD模型,通过教师-助手-学生的蒸馏机制,利用高性能的多模态大型语言模型生成初步推理数据集,并训练中型助手模型,从而实现轻量级的情感推理与分类。

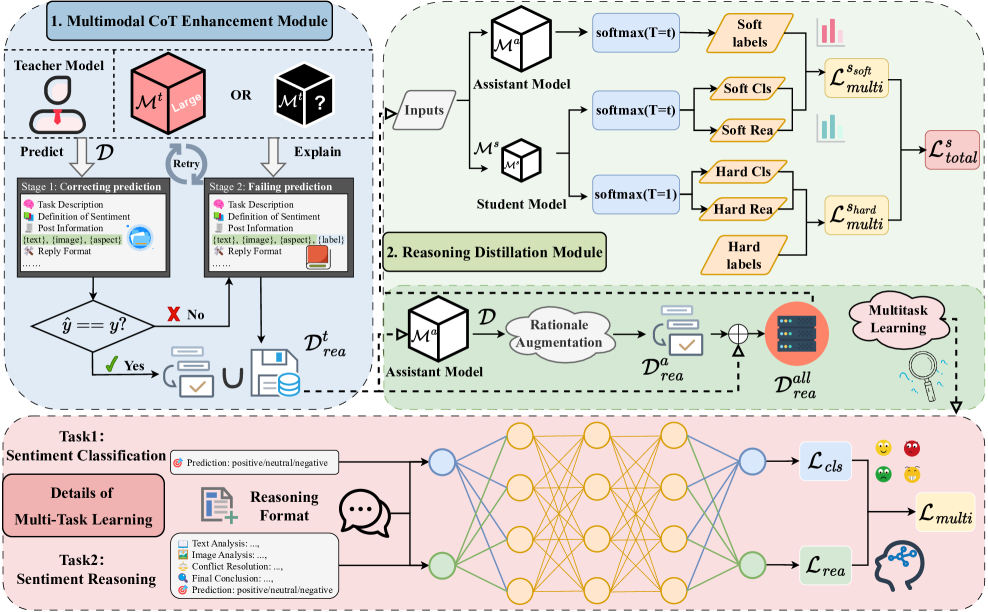

技术框架:MulCoT-RD的整体架构包括三个主要模块:教师模型用于生成推理数据,助手模型进行多任务学习,学生模型则负责高效的情感推理生成与分类。

关键创新:MulCoT-RD的核心创新在于其蒸馏范式的设计,使得轻量级模型能够在资源受限环境中实现与大型模型相媲美的性能,显著提升了模型的可用性与可解释性。

关键设计:在模型设计中,采用了多任务学习机制来训练助手模型,并通过特定的损失函数优化学生模型的推理与分类能力,确保在参数量受限的情况下仍能保持良好的性能。

🖼️ 关键图片

📊 实验亮点

实验结果显示,MulCoT-RD在四个数据集上均表现优异,尤其是在仅使用3B参数的情况下,模型在JMSRC任务上达到了与大型模型相当的性能,展现出良好的泛化能力和可解释性,显著提升了多模态情感分析的实用性。

🎯 应用场景

该研究的潜在应用领域包括社交媒体情感分析、在线评论监测以及用户反馈处理等。通过在资源受限环境中实现高效的多模态情感推理与分类,能够为企业和研究机构提供更为灵活和经济的解决方案,提升用户体验和决策支持能力。

📄 摘要(原文)

The surge in rich multimodal content on social media platforms has greatly advanced Multimodal Sentiment Analysis (MSA), with Large Language Models (LLMs) further accelerating progress in this field. Current approaches primarily leverage the knowledge and reasoning capabilities of parameter-heavy (Multimodal) LLMs for sentiment classification, overlooking autonomous multimodal sentiment reasoning generation in resource-constrained environments. Therefore, we focus on the Resource-Limited Joint Multimodal Sentiment Reasoning and Classification task, JMSRC, which simultaneously performs multimodal sentiment reasoning chain generation and sentiment classification only with a lightweight model. We propose a Multimodal Chain-of-Thought Reasoning Distillation model, MulCoT-RD, designed for JMSRC that employs a "Teacher-Assistant-Student" distillation paradigm to address deployment constraints in resource-limited environments. We first leverage a high-performance Multimodal Large Language Model (MLLM) to generate the initial reasoning dataset and train a medium-sized assistant model with a multi-task learning mechanism. A lightweight student model is jointly trained to perform efficient multimodal sentiment reasoning generation and classification. Extensive experiments on four datasets demonstrate that MulCoT-RD with only 3B parameters achieves strong performance on JMSRC, while exhibiting robust generalization and enhanced interpretability.