Semantic Compression for Word and Sentence Embeddings using Discrete Wavelet Transform

作者: Rana Aref Salama, Abdou Youssef, Mona Diab

分类: cs.CL

发布日期: 2025-07-31

期刊: https://aclanthology.org/2024.findings-acl.945/

💡 一句话要点

提出基于离散小波变换的语义压缩方法,用于压缩词和句子嵌入。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 离散小波变换 词嵌入压缩 句子嵌入压缩 语义相似性 降维 自然语言处理 多分辨率分析

📋 核心要点

- 现有词和句子嵌入维度较高,计算和存储成本大,如何在保证语义信息的前提下进行压缩是一个挑战。

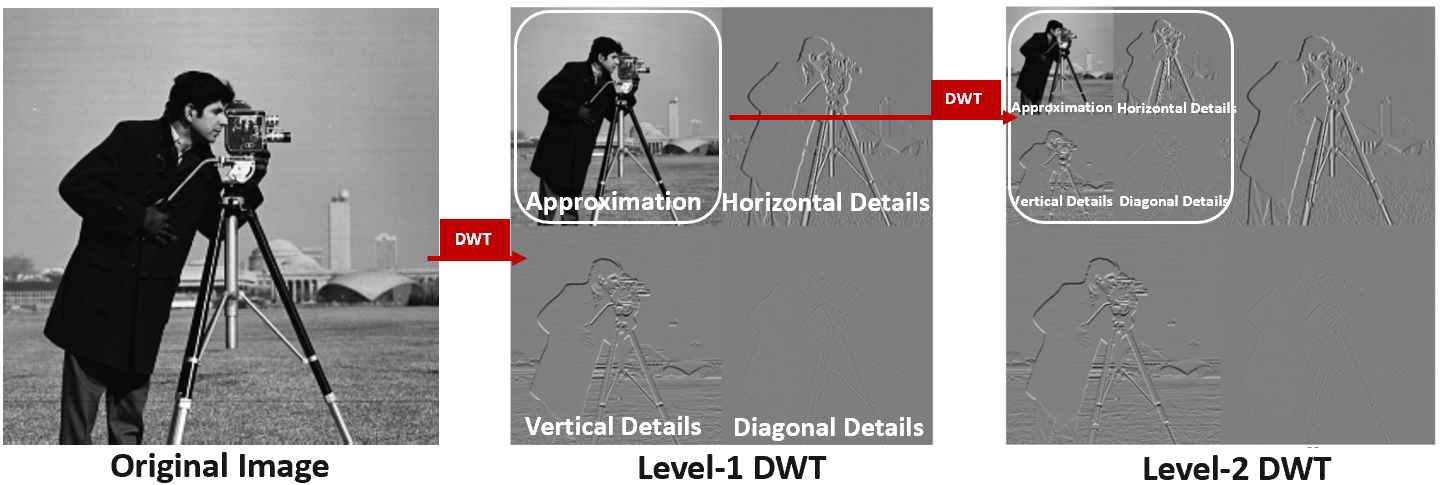

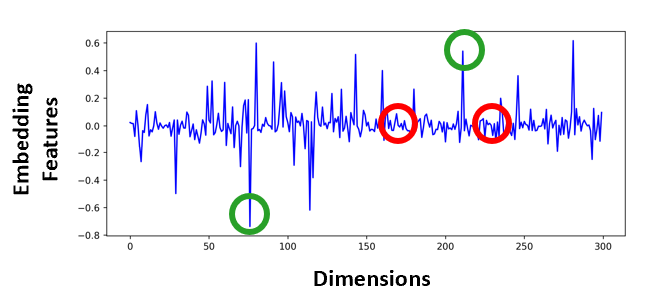

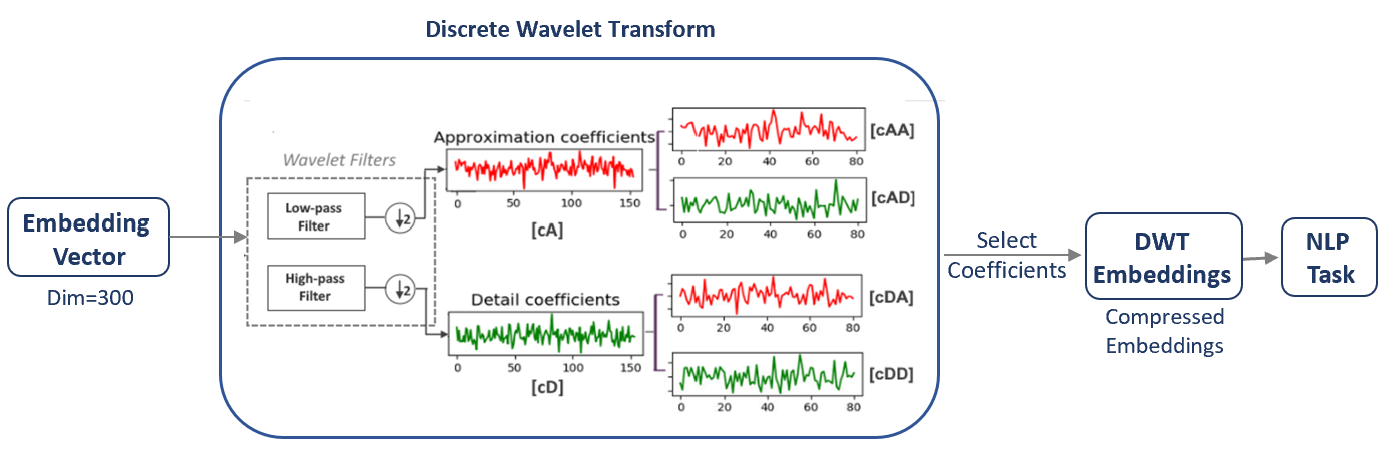

- 利用离散小波变换(DWT)的多分辨率分析能力,将嵌入向量分解为不同频率的成分,并选择性地保留重要成分。

- 实验表明,DWT能够显著降低嵌入维度(50-93%),同时在语义相似性任务中保持性能,并在下游任务中提升准确率。

📝 摘要(中文)

本文探讨了将离散小波变换(DWT)应用于词和句子嵌入的可能性。小波变换是一种强大的数学工具,已广泛应用于信号和图像处理等领域,以揭示复杂模式、增强数据表示并从数据中提取有意义的特征。本文旨在展示DWT在不同分辨率级别分析嵌入表示以及在保持其整体质量的同时压缩它们的能力。通过语义相似性任务评估DWT嵌入的有效性,展示DWT如何用于整合嵌入向量中的重要语义信息。在下游任务中使用不同的嵌入模型(包括大型语言模型)验证了所提出范例的有效性。结果表明,DWT可以将嵌入的维度降低50-93%,而语义相似性任务的性能几乎没有变化,并且在大多数下游任务中实现了更高的准确性。这些发现为应用DWT来改进NLP应用铺平了道路。

🔬 方法详解

问题定义:论文旨在解决词和句子嵌入维度过高的问题。高维嵌入增加了计算和存储成本,限制了其在资源受限环境中的应用。现有方法可能无法在压缩的同时有效保留嵌入中的语义信息。

核心思路:论文的核心思路是利用离散小波变换(DWT)对嵌入向量进行分解,将嵌入分解为不同频率的成分。通过保留重要的低频成分和部分高频成分,可以实现对嵌入的压缩,同时尽可能地保留其语义信息。DWT能够有效地提取嵌入中的关键特征,并去除冗余信息。

技术框架:该方法主要包含以下步骤:1) 对词或句子嵌入向量应用DWT,将其分解为不同尺度的系数。2) 根据系数的能量或重要性,选择保留一部分系数,丢弃其余系数。3) 对保留的系数进行逆DWT,重构压缩后的嵌入向量。4) 使用压缩后的嵌入向量进行下游任务评估。

关键创新:该方法的关键创新在于将DWT应用于词和句子嵌入的压缩。与传统的降维方法(如PCA)相比,DWT能够更好地保留嵌入中的局部特征和语义信息。此外,DWT的多分辨率分析能力使得可以根据不同的任务需求,选择不同尺度的系数进行保留。

关键设计:论文中需要选择合适的小波基函数和分解层数。小波基函数的选择会影响DWT的性能,需要根据具体的嵌入类型进行选择。分解层数决定了嵌入分解的粒度,需要根据压缩率和性能要求进行调整。此外,还需要设计合适的系数选择策略,例如基于能量的阈值选择或基于重要性的排序选择。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用DWT可以将词和句子嵌入的维度降低50-93%,而语义相似性任务的性能几乎没有下降。在下游任务中,使用DWT压缩后的嵌入在大多数情况下取得了比原始嵌入更高的准确率。例如,在某个下游任务中,DWT压缩后的嵌入的准确率比原始嵌入提高了2%。这些结果表明,DWT是一种有效的嵌入压缩方法。

🎯 应用场景

该研究成果可应用于各种自然语言处理任务,尤其是在资源受限的环境中,例如移动设备或嵌入式系统。通过压缩词和句子嵌入,可以降低模型的存储空间和计算复杂度,从而提高模型的效率和可部署性。此外,该方法还可以用于提高模型的鲁棒性,通过去除噪声和冗余信息,提高模型对输入变化的适应能力。

📄 摘要(原文)

Wavelet transforms, a powerful mathematical tool, have been widely used in different domains, including Signal and Image processing, to unravel intricate patterns, enhance data representation, and extract meaningful features from data. Tangible results from their application suggest that Wavelet transforms can be applied to NLP capturing a variety of linguistic and semantic properties. In this paper, we empirically leverage the application of Discrete Wavelet Transforms (DWT) to word and sentence embeddings. We aim to showcase the capabilities of DWT in analyzing embedding representations at different levels of resolution and compressing them while maintaining their overall quality. We assess the effectiveness of DWT embeddings on semantic similarity tasks to show how DWT can be used to consolidate important semantic information in an embedding vector. We show the efficacy of the proposed paradigm using different embedding models, including large language models, on downstream tasks. Our results show that DWT can reduce the dimensionality of embeddings by 50-93% with almost no change in performance for semantic similarity tasks, while achieving superior accuracy in most downstream tasks. Our findings pave the way for applying DWT to improve NLP applications.