Failures Are the Stepping Stones to Success: Enhancing Few-Shot In-Context Learning by Leveraging Negative Samples

作者: Yunhao Liang, Ruixuan Ying, Takuya Taniguchi, Zhe Cui

分类: cs.CL

发布日期: 2025-07-31

💡 一句话要点

利用负样本提升少样本上下文学习(ICL)性能

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 少样本学习 上下文学习 负样本挖掘 语义相似性 自然语言处理

📋 核心要点

- 现有少样本上下文学习(ICL)方法对示例选择敏感,且主要依赖正样本,忽略了负样本中蕴含的有用信息。

- 该论文提出一种新颖方法,利用负样本辅助正样本选择,从而提升少样本ICL的性能。

- 实验结果表明,该方法优于仅使用最相似正样本的ICL方法,验证了负样本信息对提升ICL性能的有效性。

📝 摘要(中文)

大型语言模型展现出强大的少样本上下文学习(ICL)能力,但其性能对提供的示例非常敏感。最近的研究主要集中在为每个输入查询检索相应的示例,这不仅提高了学习过程的效率和可扩展性,还减轻了手动选择示例时固有的偏差。然而,这些研究主要强调利用正样本,而忽略了负样本中包含的额外信息。我们提出了一种新方法,该方法利用负样本来更好地选择正样本示例,从而提高少样本ICL的性能。首先,我们基于Zero-Shot-CoT构建正样本和负样本语料库。然后在推理过程中,我们采用基于语义相似性的方法,从正样本和负样本语料库中选择与给定查询最相似的示例。随后,我们基于负样本的语义相似性,从正样本语料库中进一步检索正样本,然后将它们与先前选择的正样本连接起来,作为ICL演示。实验结果表明,我们的方法优于仅依赖于最相似正样本的方法,验证了负样本中的额外信息有助于通过改进正样本选择来提高ICL性能。

🔬 方法详解

问题定义:现有少样本上下文学习(ICL)方法的性能高度依赖于所提供的示例。虽然检索增强的方法试图通过寻找与输入查询相关的正样本来缓解这个问题,但它们忽略了负样本中可能包含的有用信息。如何有效地利用负样本来提升ICL性能是一个挑战。

核心思路:该论文的核心思路是利用负样本来辅助选择更合适的正样本,从而提升ICL的性能。通过将负样本信息纳入正样本选择过程,模型可以更好地理解输入查询的语义,并选择更具代表性的正样本。

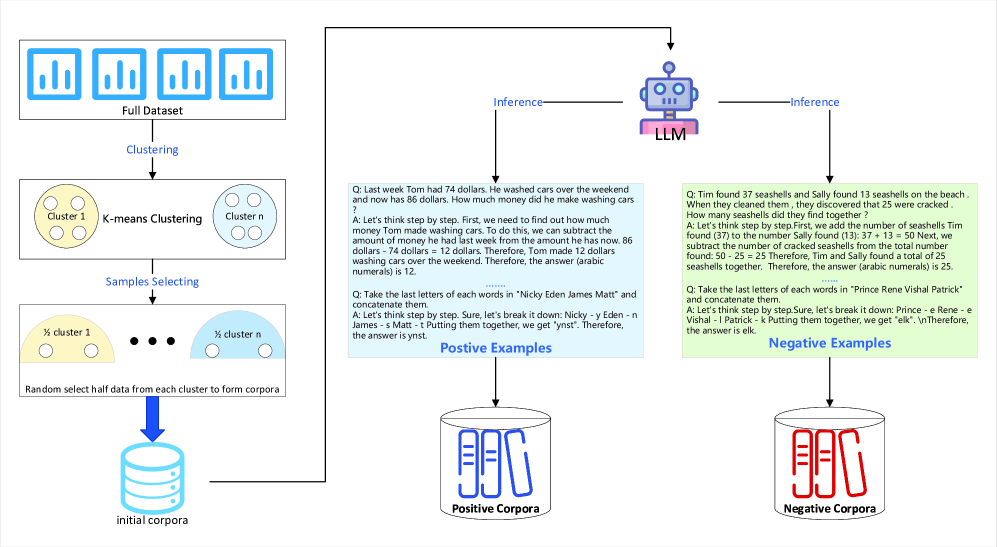

技术框架:该方法主要包含以下几个阶段: 1. 构建正负样本语料库:基于Zero-Shot-CoT方法生成正样本和负样本语料库。 2. 初始样本选择:对于给定的查询,使用语义相似性度量从正负样本语料库中分别选择最相似的样本。 3. 二次正样本检索:基于负样本的语义相似性,从正样本语料库中进一步检索正样本。 4. 构建ICL演示:将初始选择的正样本和二次检索的正样本连接起来,作为ICL的上下文示例。

关键创新:该论文的关键创新在于提出了利用负样本信息来辅助正样本选择的策略。与传统方法只关注正样本不同,该方法通过引入负样本信息,使得模型能够更全面地理解输入查询的语义,从而选择更合适的正样本。

关键设计: 1. 语义相似性度量:使用预训练的语言模型(如BERT)计算查询、正样本和负样本之间的语义相似性。 2. Zero-Shot-CoT:使用Zero-Shot-CoT生成正负样本,确保样本的多样性和质量。 3. 超参数调优:需要调整正负样本选择的数量,以及二次检索正样本的数量,以达到最佳性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在多个NLP任务上优于仅使用正样本的ICL方法。例如,在文本分类任务上,该方法相比于基线方法取得了显著的性能提升,验证了负样本信息在提升ICL性能方面的有效性。具体的性能提升幅度取决于具体的任务和数据集。

🎯 应用场景

该研究成果可应用于各种自然语言处理任务,例如文本分类、问答系统、文本生成等。通过利用负样本信息,可以提升少样本学习场景下的模型性能,降低对大量标注数据的依赖,具有重要的实际应用价值和潜力。未来可以探索更复杂的负样本利用方式,进一步提升ICL性能。

📄 摘要(原文)

Large Language Models exhibit powerful few-shot in-context learning (ICL) capabilities, but the performance is highly sensitive to provided examples. Recent research has focused on retrieving corresponding examples for each input query, not only enhancing the efficiency and scalability of the learning process but also mitigating inherent biases in manual example selection. However, these studies have primarily emphasized leveraging Positive samples while overlooking the additional information within Negative samples for contextual learning. We propose a novel method that utilizes Negative samples to better select Positive sample examples, thereby enhancing the performance of few-shot ICL. Initially, we construct Positive and Negative sample corpora based on Zero-Shot-Cot. Then, during inference, we employ a semantic similarity-based approach to select the most similar examples from both the Positive and Negative corpora for a given query. Subsequently, we further retrieve Positive examples from the Positive sample corpus based on semantic similarity to the Negative examples, then concatenating them with the previously selected Positive examples to serve as ICL demonstrations. Experimental results demonstrate that our approach surpasses methods solely relying on the most similar positive examples for context, validating that the additional information in negative samples aids in enhancing ICL performance through improved Positive sample selection.