SGPO: Self-Generated Preference Optimization based on Self-Improver

作者: Hyeonji Lee, Daejin Jo, Seohwan Yun, Sungwoong Kim

分类: cs.CL, cs.AI

发布日期: 2025-07-27

💡 一句话要点

提出SGPO:基于自提升器的自生成偏好优化,无需人工标注数据对齐LLM。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 偏好对齐 自提升学习 直接偏好优化 在线学习

📋 核心要点

- 现有LLM对齐方法依赖人工标注数据,成本高昂且易引入分布偏移,限制了其泛化能力。

- SGPO利用自提升机制,通过改进策略模型的响应来生成偏好数据,实现高效的在线对齐。

- 实验表明,SGPO在AlpacaEval 2.0和Arena-Hard上显著优于DPO等基线方法,无需外部偏好数据。

📝 摘要(中文)

大型语言模型(LLMs)虽然经过了大量数据集的预训练,但仍需要有效的对齐人类偏好才能实现可靠的应用。传统的对齐方法通常采用离线学习,依赖于人工标注的数据集,这限制了其广泛适用性,并在训练过程中引入了分布偏移问题。为了解决这些挑战,我们提出了基于自提升器的自生成偏好优化(SGPO),这是一个创新的对齐框架,利用在线自提升机制。具体来说,提升器改进策略模型的响应,从而自生成偏好数据,用于策略模型的直接偏好优化(DPO)。在这里,提升器和策略模型被统一为一个单一模型,为了生成更高质量的偏好数据,这个自提升器学习通过参考监督微调输出来对当前响应进行增量但可辨别的改进。在AlpacaEval 2.0和Arena-Hard上的实验结果表明,所提出的SGPO在没有使用外部偏好数据的情况下,显著提高了DPO和基线自提升方法的性能。

🔬 方法详解

问题定义:现有的大型语言模型对齐方法依赖于人工标注的偏好数据,这不仅成本高昂,而且容易引入标注偏差,导致模型在实际应用中表现不佳。此外,离线学习方式也可能导致训练数据与实际应用场景存在分布差异,影响模型的泛化能力。因此,如何高效、低成本地对齐LLM,使其更好地符合人类偏好,是一个亟待解决的问题。

核心思路:SGPO的核心思路是利用模型自身的改进能力,通过自提升的方式生成高质量的偏好数据,并在此基础上进行策略优化。具体来说,SGPO将策略模型和提升器合二为一,提升器负责对策略模型的输出进行改进,从而生成更符合人类偏好的响应。这种自提升的过程可以看作是一种在线学习,能够更好地适应实际应用场景。

技术框架:SGPO的整体框架包含一个统一的模型,该模型同时充当策略模型和提升器。训练过程主要分为两个阶段:首先,使用监督微调数据训练模型,使其具备初步的生成能力。然后,利用自提升机制,模型生成初始响应,并由自身进行改进,生成偏好数据。最后,使用直接偏好优化(DPO)算法,利用生成的偏好数据对策略模型进行优化。

关键创新:SGPO的关键创新在于提出了自提升的偏好数据生成方法。与传统的依赖人工标注数据的方法不同,SGPO通过模型自身的改进来生成偏好数据,从而避免了人工标注的成本和偏差。此外,SGPO将策略模型和提升器合二为一,简化了模型结构,提高了训练效率。

关键设计:SGPO的关键设计包括:1) 使用监督微调数据初始化模型,使其具备良好的生成能力;2) 设计合适的提升策略,使提升器能够有效地改进策略模型的响应;3) 使用DPO算法进行策略优化,DPO算法能够直接优化策略模型,避免了中间奖励模型的训练。

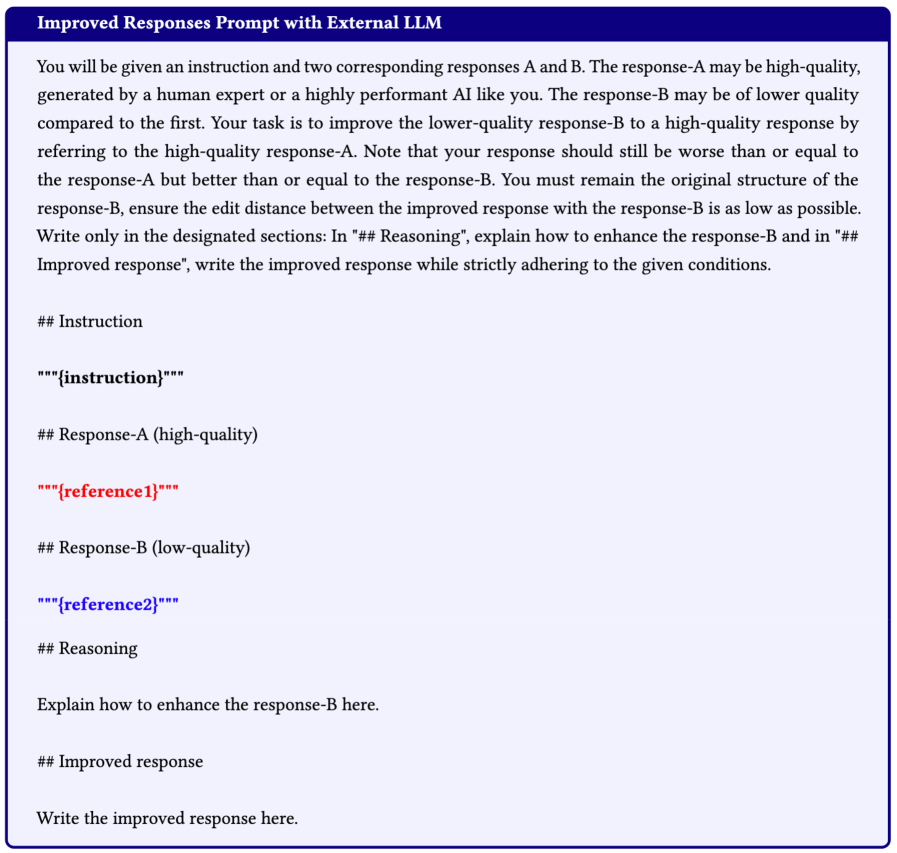

🖼️ 关键图片

📊 实验亮点

SGPO在AlpacaEval 2.0和Arena-Hard数据集上进行了评估,实验结果表明,SGPO显著优于DPO和基线自提升方法。例如,在AlpacaEval 2.0上,SGPO的胜率比DPO提高了超过10%,在Arena-Hard上也有显著提升。这些结果表明,SGPO能够有效地提高LLM的性能,并且无需依赖外部偏好数据。

🎯 应用场景

SGPO可应用于各种需要对齐人类偏好的大型语言模型应用场景,例如智能助手、对话系统、内容生成等。通过自生成偏好数据,降低了对人工标注数据的依赖,使得LLM能够更高效、低成本地适应不同用户的偏好,提升用户体验和应用价值。未来,该方法有望推广到其他需要偏好对齐的AI系统中。

📄 摘要(原文)

Large language models (LLMs), despite their extensive pretraining on diverse datasets, require effective alignment to human preferences for practical and reliable deployment. Conventional alignment methods typically employ off-policy learning and depend on human-annotated datasets, which limits their broad applicability and introduces distribution shift issues during training. To address these challenges, we propose Self-Generated Preference Optimization based on Self-Improver (SGPO), an innovative alignment framework that leverages an on-policy self-improving mechanism. Specifically, the improver refines responses from a policy model to self-generate preference data for direct preference optimization (DPO) of the policy model. Here, the improver and policy are unified into a single model, and in order to generate higher-quality preference data, this self-improver learns to make incremental yet discernible improvements to the current responses by referencing supervised fine-tuning outputs. Experimental results on AlpacaEval 2.0 and Arena-Hard show that the proposed SGPO significantly improves performance over DPO and baseline self-improving methods without using external preference data.