TurQUaz at CheckThat! 2025: Debating Large Language Models for Scientific Web Discourse Detection

作者: Tarık Saraç, Selin Mergen, Mucahid Kutlu

分类: cs.CL, cs.AI

发布日期: 2025-07-26

💡 一句话要点

提出基于LLM辩论的科学网络文本判别方法,用于识别科学研究引用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 科学文本判别 委员会辩论 自然语言处理 信息检索

📋 核心要点

- 现有方法难以有效识别科学网络文本中的科学主张、研究引用和科学实体提及。

- 论文提出模拟LLM委员会辩论,通过多模型协商达成共识,判断文本是否包含特定科学信息。

- 实验表明,该方法在识别科学研究引用方面表现出色,但在其他两项任务中表现一般。

📝 摘要(中文)

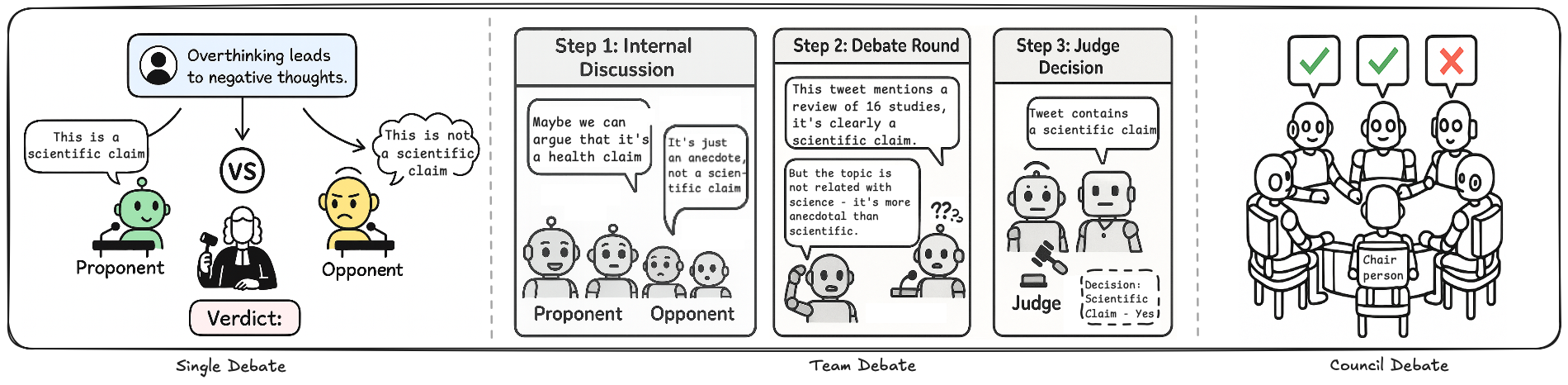

本文介绍了为CheckThat! 2025科学网络文本判别任务(Task 4a)开发的工作。我们提出了一种新颖的委员会辩论方法,该方法模拟多个大型语言模型(LLM)之间结构化的学术讨论,以识别给定的推文是否包含(i)科学主张,(ii)对科学研究的引用,或(iii)提及科学实体。我们探索了三种辩论方法:i)单一辩论,其中两个LLM为对立的立场辩论,而第三个LLM充当法官;ii)团队辩论,其中多个模型在辩论的每一方内协作;以及iii)委员会辩论,其中多个专家模型共同审议以达成共识,由主席模型主持。我们选择委员会辩论作为我们的主要模型,因为它在开发测试集中优于其他模型。虽然我们提出的方法在识别科学主张(10个中排名第8)或提及科学实体(10个中排名第9)方面排名不高,但它在检测对科学研究的引用方面排名第一。

🔬 方法详解

问题定义:论文旨在解决科学网络文本判别问题,具体而言,判断给定的推文是否包含科学主张、对科学研究的引用或提及科学实体。现有方法可能无法充分利用大型语言模型的推理和辩论能力,导致识别准确率不高。

核心思路:论文的核心思路是模拟人类学术讨论中的辩论过程,利用多个LLM扮演不同的角色(辩论者、法官、主席),通过辩论和协商来提高判别的准确性和可靠性。这种方法旨在模仿专家委员会的审议过程,从而更全面地评估文本内容。

技术框架:整体框架包括三个主要的辩论方法:1) 单一辩论:两个LLM就某一观点进行辩论,第三个LLM作为法官进行评判;2) 团队辩论:多个LLM组成团队,分别支持或反对某一观点;3) 委员会辩论:多个专家LLM共同审议,由一个主席LLM主持,最终达成共识。论文选择委员会辩论作为主要模型。

关键创新:关键创新在于引入了委员会辩论的概念,将多个LLM组合成一个专家委员会,通过模拟学术讨论的方式进行判别。这种方法不同于传统的单模型判别或简单的模型集成,它更注重模型之间的互动和协商,从而提高判别的鲁棒性和准确性。

关键设计:委员会辩论的关键设计包括:1) 选择合适的LLM作为专家模型和主席模型;2) 设计有效的提示语,引导LLM进行辩论和协商;3) 定义明确的共识达成机制,例如投票或加权平均;4) 针对不同的判别任务(科学主张、研究引用、科学实体),调整辩论策略和模型参数。

🖼️ 关键图片

📊 实验亮点

实验结果表明,该方法在检测对科学研究的引用方面表现出色,排名第一。虽然在识别科学主张和提及科学实体方面表现一般(分别排名第8和第9),但委员会辩论的框架为未来的研究提供了新的思路,可以通过优化模型选择、提示语设计和共识机制来进一步提高性能。

🎯 应用场景

该研究成果可应用于科学信息检索、学术文献分析、虚假信息检测等领域。通过自动识别网络文本中的科学研究引用,可以帮助研究人员快速定位相关文献,提高科研效率。此外,该方法还可以用于识别和过滤不实的科学主张,维护科学信息的准确性和可靠性。

📄 摘要(原文)

In this paper, we present our work developed for the scientific web discourse detection task (Task 4a) of CheckThat! 2025. We propose a novel council debate method that simulates structured academic discussions among multiple large language models (LLMs) to identify whether a given tweet contains (i) a scientific claim, (ii) a reference to a scientific study, or (iii) mentions of scientific entities. We explore three debating methods: i) single debate, where two LLMs argue for opposing positions while a third acts as a judge; ii) team debate, in which multiple models collaborate within each side of the debate; and iii) council debate, where multiple expert models deliberate together to reach a consensus, moderated by a chairperson model. We choose council debate as our primary model as it outperforms others in the development test set. Although our proposed method did not rank highly for identifying scientific claims (8th out of 10) or mentions of scientific entities (9th out of 10), it ranked first in detecting references to scientific studies.