Identifying Fine-grained Forms of Populism in Political Discourse: A Case Study on Donald Trump's Presidential Campaigns

作者: Ilias Chalkidis, Stephanie Brandl, Paris Aslanidis

分类: cs.CL

发布日期: 2025-07-25

备注: Pre-print

💡 一句话要点

提出新型数据集并评估LLM在识别政治语篇中细粒度民粹主义形式的能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 民粹主义 大型语言模型 政治话语分析 自然语言处理 文本分类

📋 核心要点

- 现有方法难以准确识别政治语篇中细粒度的民粹主义形式,缺乏针对性数据集。

- 论文通过构建新的数据集,并结合多种提示策略,评估LLM识别民粹主义的能力。

- 实验表明,微调的RoBERTa模型优于多数LLM,指令调整的LLM在跨领域数据上更鲁棒。

📝 摘要(中文)

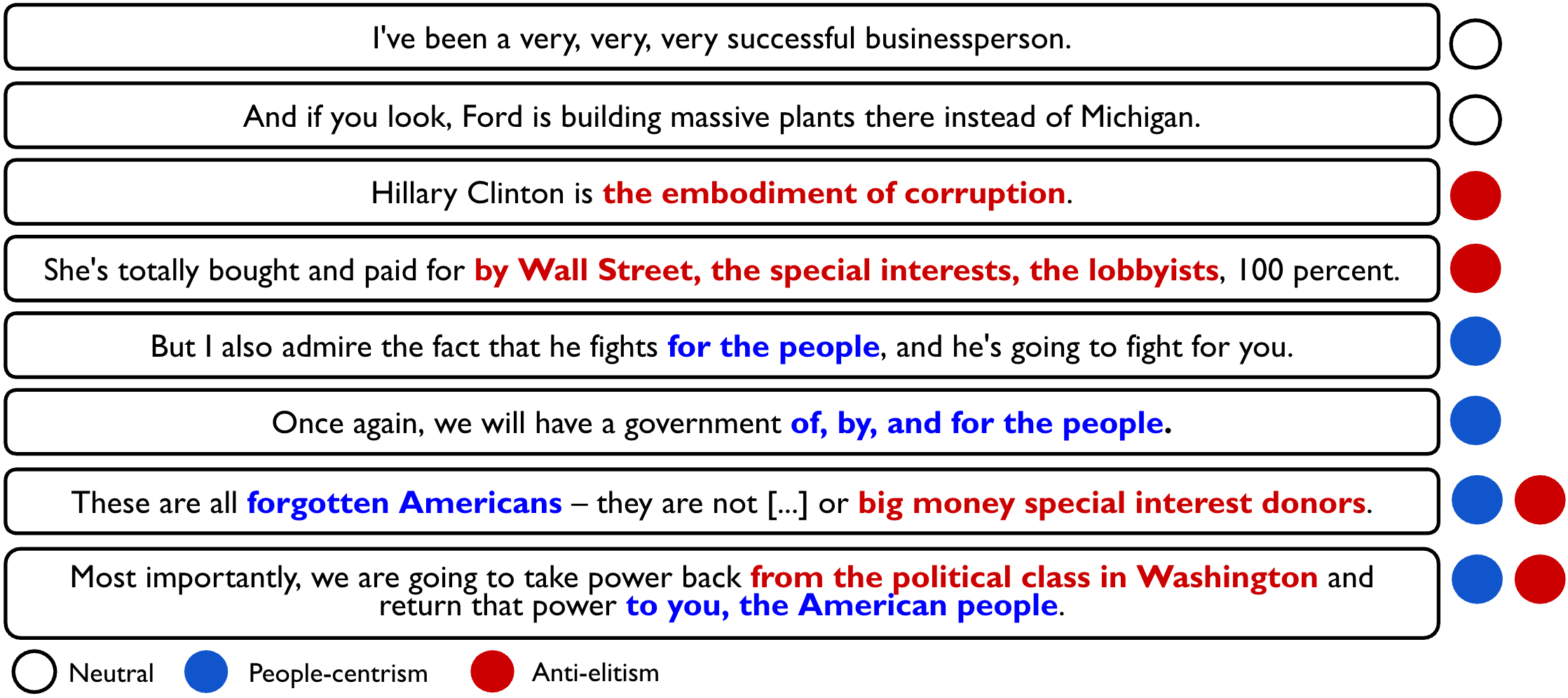

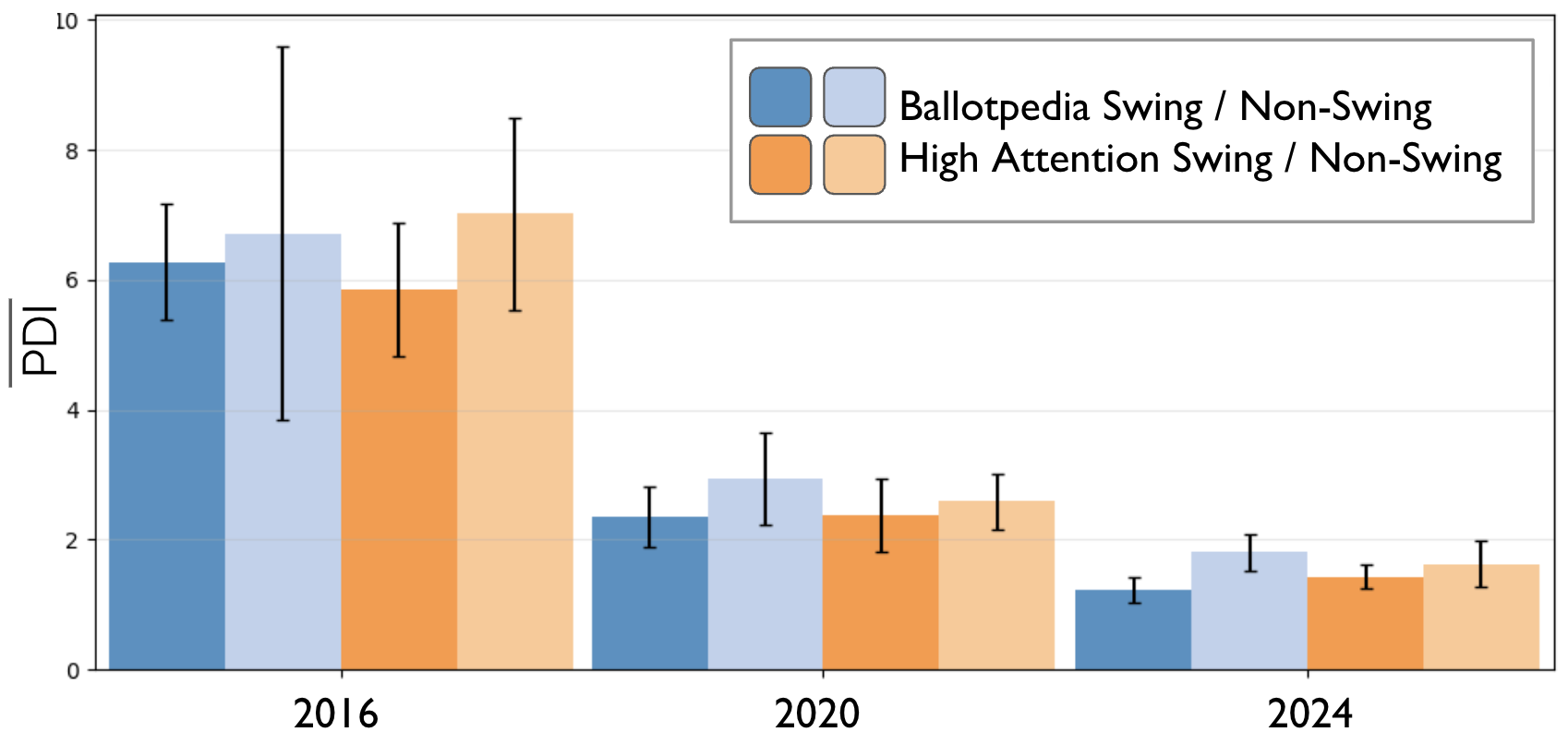

大型语言模型(LLM)在各种指令跟随任务中表现出卓越的能力,但它们对细微的社会科学概念的掌握程度仍未得到充分探索。本文研究了LLM是否能够识别和分类细粒度的民粹主义形式,这是一个在学术界和媒体辩论中复杂且有争议的概念。为此,我们整理并发布了专门用于捕捉民粹主义话语的新数据集。我们评估了一系列预训练(大型)语言模型,包括开源和专有模型,以及多种提示范式。我们的分析揭示了性能方面的显著差异,突出了LLM在检测民粹主义话语方面的局限性。我们发现,经过微调的RoBERTa分类器大大优于所有新型指令调整的LLM,除非也经过微调。此外,我们应用性能最佳的模型来分析唐纳德·特朗普的竞选演讲,提取了关于他战略性地使用民粹主义言论的宝贵见解。最后,我们通过在欧洲政治家的竞选演讲中对这些模型进行基准测试来评估这些模型的泛化能力,从而提供了政治话语分析中跨语境可转移性的视角。在这种情况下,我们发现指令调整的LLM在领域外数据上表现出更大的鲁棒性。

🔬 方法详解

问题定义:论文旨在解决LLM在识别政治语篇中细粒度民粹主义形式方面的不足。现有方法缺乏针对性数据集,难以准确捕捉民粹主义的细微差别,并且LLM对社会科学概念的理解深度有待考察。

核心思路:论文的核心思路是构建专门用于捕捉民粹主义话语的数据集,并利用该数据集评估各种LLM在识别民粹主义方面的能力。通过比较不同模型的性能,以及分析特朗普的竞选演讲,揭示LLM在理解和应用复杂社会科学概念方面的局限性和潜力。

技术框架:整体框架包括以下几个主要阶段:1) 数据集构建:收集并标注政治语篇数据,用于训练和评估模型。2) 模型选择与训练:选择一系列预训练的LLM(包括开源和专有模型),并采用不同的提示范式进行训练。3) 性能评估:在构建的数据集上评估模型的性能,并进行比较分析。4) 应用分析:将性能最佳的模型应用于特朗普的竞选演讲,提取民粹主义言论。5) 跨领域泛化能力评估:在欧洲政治家的竞选演讲中评估模型的泛化能力。

关键创新:论文的关键创新在于:1) 构建了专门用于捕捉民粹主义话语的新数据集,填补了相关领域的空白。2) 系统地评估了各种LLM在识别细粒度民粹主义形式方面的能力,揭示了LLM在理解复杂社会科学概念方面的局限性。3) 提出了利用LLM分析政治语篇的新方法,为政治学研究提供了新的工具。

关键设计:论文的关键设计包括:1) 数据集的标注方案,需要定义清晰的民粹主义分类标准。2) 提示策略的选择,需要探索不同的提示方式对模型性能的影响。3) 模型评估指标的选择,需要选择能够准确反映模型识别民粹主义能力的指标。4) 跨领域泛化能力评估的设计,需要选择具有代表性的欧洲政治家竞选演讲数据。

🖼️ 关键图片

📊 实验亮点

实验结果表明,经过微调的RoBERTa分类器在识别民粹主义话语方面优于大多数未经微调的LLM。此外,指令调整的LLM在跨领域数据上表现出更强的鲁棒性,表明其具有一定的泛化能力。对特朗普竞选演讲的分析揭示了他战略性地使用民粹主义言论的模式。

🎯 应用场景

该研究成果可应用于政治学、社会学、传播学等领域,帮助研究人员更深入地理解政治话语中的民粹主义现象。此外,该研究还可以用于舆情监控、虚假信息检测等领域,提高社会对民粹主义言论的识别和防范能力。未来,该研究可以扩展到其他政治议题和文化背景,为更广泛的政治话语分析提供支持。

📄 摘要(原文)

Large Language Models (LLMs) have demonstrated remarkable capabilities across a wide range of instruction-following tasks, yet their grasp of nuanced social science concepts remains underexplored. This paper examines whether LLMs can identify and classify fine-grained forms of populism, a complex and contested concept in both academic and media debates. To this end, we curate and release novel datasets specifically designed to capture populist discourse. We evaluate a range of pre-trained (large) language models, both open-weight and proprietary, across multiple prompting paradigms. Our analysis reveals notable variation in performance, highlighting the limitations of LLMs in detecting populist discourse. We find that a fine-tuned RoBERTa classifier vastly outperforms all new-era instruction-tuned LLMs, unless fine-tuned. Additionally, we apply our best-performing model to analyze campaign speeches by Donald Trump, extracting valuable insights into his strategic use of populist rhetoric. Finally, we assess the generalizability of these models by benchmarking them on campaign speeches by European politicians, offering a lens into cross-context transferability in political discourse analysis. In this setting, we find that instruction-tuned LLMs exhibit greater robustness on out-of-domain data.