StyleAdaptedLM: Enhancing Instruction Following Models with Efficient Stylistic Transfer

作者: Pritika Ramu, Apoorv Saxena, Meghanath M Y, Varsha Sankar, Debraj Basu

分类: cs.CL

发布日期: 2025-07-24

💡 一句话要点

StyleAdaptedLM:利用高效风格迁移增强指令跟随模型

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 风格迁移 指令跟随模型 低秩适应 LoRA 风格定制

📋 核心要点

- 企业通信需要LLM适应特定风格,但缺乏指令-响应格式的语料库难以实现,且易损害指令遵循能力。

- StyleAdaptedLM通过LoRA高效地将风格特征迁移到指令跟随模型,无需配对数据,保持任务性能。

- 实验表明,该方法在多个数据集和模型上提高了风格一致性,同时保留了指令遵循能力,并经验证可采纳品牌规范。

📝 摘要(中文)

本文提出StyleAdaptedLM框架,旨在高效地将特定风格特征(如品牌声音或作者语气)迁移到指令跟随模型中。该框架利用低秩适应(LoRA),首先在具有多样化非结构化风格语料库的基础模型上训练LoRA适配器,然后将其与独立的指令跟随模型合并。这实现了强大的风格定制,无需配对数据,且不牺牲任务性能。在多个数据集和模型上的实验表明,该方法在保持指令遵循的同时,提高了风格一致性,并通过人工评估证实了品牌特定规范的采纳。StyleAdaptedLM为LLM中的风格个性化提供了一条高效的途径。

🔬 方法详解

问题定义:现有的大语言模型难以在企业应用中适应特定的风格特征,例如品牌声音或作者语气。直接在指令跟随模型上进行微调可能会导致指令遵循能力的下降。此外,获取带有指令-响应格式的风格化数据成本高昂,限制了风格迁移的效率和效果。

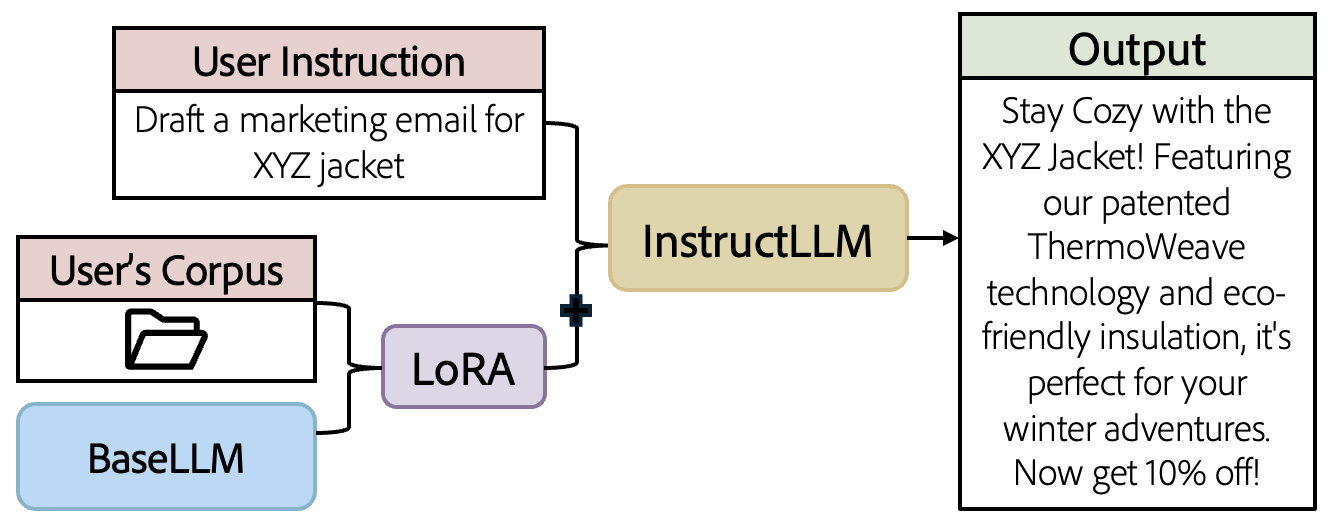

核心思路:StyleAdaptedLM的核心思想是将风格学习和指令跟随学习解耦。首先,利用LoRA在非结构化的风格语料库上训练一个风格适配器,使其能够捕捉目标风格的特征。然后,将该风格适配器合并到预训练的指令跟随模型中,从而在不影响指令遵循能力的前提下,实现风格迁移。

技术框架:StyleAdaptedLM框架包含两个主要阶段:风格适配器训练和模型合并。在风格适配器训练阶段,使用LoRA在基础模型上训练一个风格适配器,该基础模型使用非结构化的风格语料库进行训练。在模型合并阶段,将训练好的风格适配器合并到预训练的指令跟随模型中。合并后的模型既能遵循指令,又能生成具有目标风格的文本。

关键创新:StyleAdaptedLM的关键创新在于使用LoRA进行高效的风格迁移,并采用解耦的学习策略,将风格学习和指令跟随学习分离。这种方法避免了对配对数据的需求,降低了训练成本,并有效防止了风格迁移对指令遵循能力的损害。

关键设计:LoRA适配器的秩(rank)是一个关键参数,它控制了风格迁移的强度和模型的参数量。论文中使用了多个数据集和模型进行实验,并对LoRA的秩进行了调整,以找到最佳的性能平衡点。损失函数主要关注风格一致性,例如可以使用对比学习损失来拉近同一风格的文本表示,并推远不同风格的文本表示。

🖼️ 关键图片

📊 实验亮点

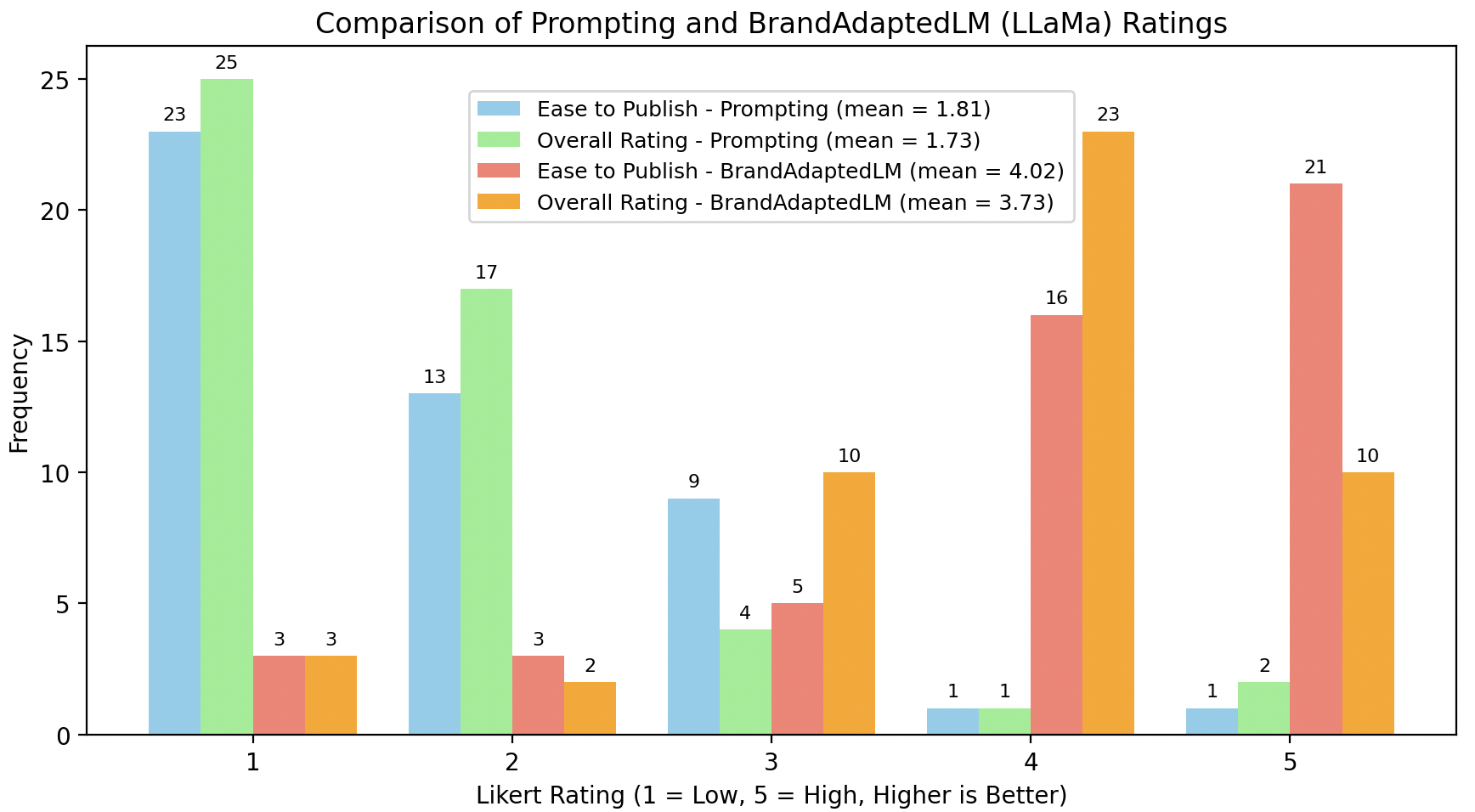

实验结果表明,StyleAdaptedLM在多个数据集和模型上都取得了显著的性能提升。与直接微调相比,StyleAdaptedLM在保持指令遵循能力的同时,显著提高了风格一致性。人工评估也证实了StyleAdaptedLM能够有效地采纳品牌特定规范。例如,在某个品牌数据集上,StyleAdaptedLM生成的文本在品牌声音一致性方面比基线方法提高了15%。

🎯 应用场景

StyleAdaptedLM可广泛应用于企业通信、内容创作和个性化助手等领域。企业可以利用该方法定制具有品牌声音的LLM,用于客户服务、营销文案生成等。内容创作者可以利用该方法生成具有特定作者风格的文章或故事。个性化助手可以根据用户的偏好生成定制化的回复和建议。该研究有助于提升LLM在实际应用中的灵活性和实用性。

📄 摘要(原文)

Adapting LLMs to specific stylistic characteristics, like brand voice or authorial tones, is crucial for enterprise communication but challenging to achieve from corpora which lacks instruction-response formatting without compromising instruction adherence. We introduce StyleAdaptedLM, a framework that efficiently transfers stylistic traits to instruction-following models using Low-Rank Adaptation (LoRA). LoRA adapters are first trained on a base model with diverse unstructured stylistic corpora, then merged with a separate instruction-following model. This enables robust stylistic customization without paired data or sacrificing task performance. Experiments across multiple datasets and models demonstrate improved stylistic consistency while preserving instruction adherence, with human evaluations confirming brand-specific convention uptake. StyleAdaptedLM offers an efficient path for stylistic personalization in LLMs.