Megrez2 Technical Report

作者: Boxun Li, Yadong Li, Zhiyuan Li, Congyi Liu, Weilin Liu, Guowei Niu, Zheyue Tan, Haiyang Xu, Zhuyu Yao, Tao Yuan, Dong Zhou, Yueqing Zhuang, Bo Zhao, Guohao Dai, Yu Wang

分类: cs.CL

发布日期: 2025-07-23

💡 一句话要点

Megrez2:一种轻量级高性能语言模型架构,优化设备原生部署。

🎯 匹配领域: 支柱二:RL算法与架构 (RL & Architecture) 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 轻量级模型 专家共享 预门控路由 设备原生部署 语言模型

📋 核心要点

- 现有大模型部署受限于高昂的计算和存储成本,难以在资源受限的设备上原生运行。

- Megrez2通过跨层专家共享和预门控路由,在显著减少参数量的同时,保持模型性能。

- Megrez2-Preview模型在多种任务上表现出与更大模型相当甚至更优的性能,验证了架构的有效性。

📝 摘要(中文)

本文介绍了Megrez2,一种新颖的轻量级高性能语言模型架构,专为设备原生部署而优化。Megrez2引入了一种新颖的跨层专家共享机制,通过在相邻Transformer层之间重用专家模块,显著减少了总参数量,同时保持了模型的大部分容量。它还结合了预门控路由,实现了内存高效的专家加载和更快的推理。作为Megrez2架构的第一个实例,我们推出了Megrez2-Preview模型,该模型在包含5万亿个token的语料库上进行了预训练,并通过监督微调和具有可验证奖励的强化学习进一步增强。Megrez2-Preview仅激活30亿参数并存储75亿参数,在包括语言理解、指令跟随、数学推理和代码生成在内的各种任务上,表现出与更大模型相比具有竞争力或更优越的性能。这些结果突出了Megrez2架构在精度、效率和可部署性之间实现平衡的有效性,使其成为现实世界中资源受限应用的有力候选者。

🔬 方法详解

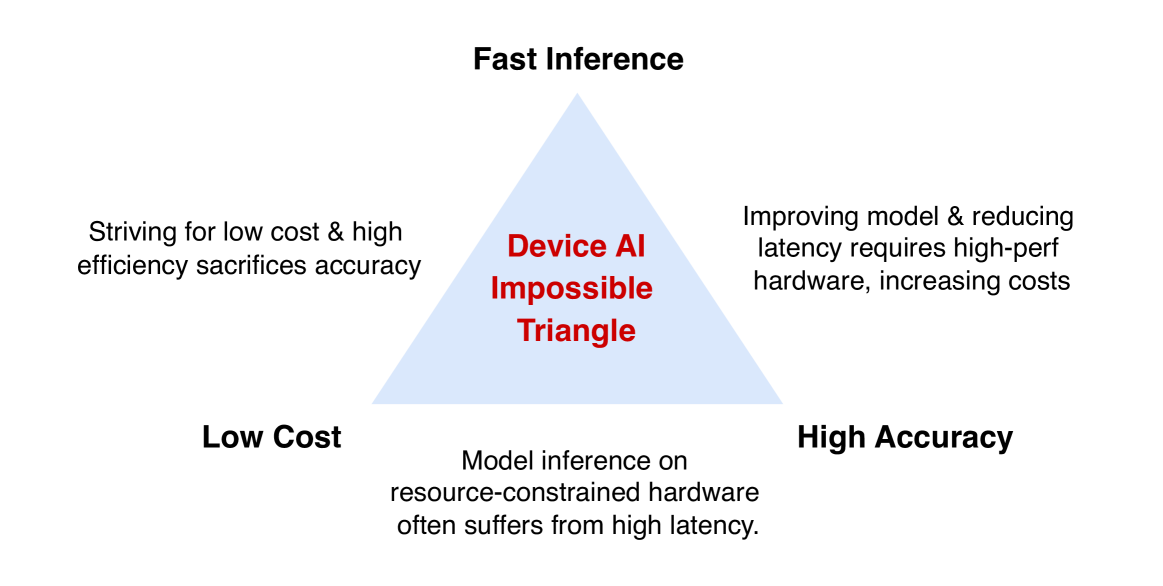

问题定义:现有的大型语言模型参数量巨大,难以在移动设备或边缘设备等资源受限的环境中部署和运行。现有的模型压缩和加速方法通常会牺牲模型性能。因此,如何在保持模型性能的同时,显著降低模型大小,是当前面临的一个重要挑战。

核心思路:Megrez2的核心思路是通过跨层专家共享和预门控路由来减少模型的参数量和计算复杂度。跨层专家共享允许相邻Transformer层共享专家模块,从而减少了总参数量。预门控路由则通过在推理时只加载必要的专家模块,实现了内存高效的专家加载和更快的推理。

技术框架:Megrez2架构基于Transformer结构,主要包含以下几个关键模块:Transformer层、专家模块、跨层专家共享机制和预门控路由机制。Transformer层负责处理输入序列并提取特征。专家模块包含多个独立的神经网络,每个专家模块擅长处理不同的输入。跨层专家共享机制允许相邻的Transformer层共享专家模块,从而减少参数量。预门控路由机制根据输入动态选择需要激活的专家模块,从而减少计算量。

关键创新:Megrez2的关键创新在于跨层专家共享机制和预门控路由机制。跨层专家共享机制通过在相邻Transformer层之间重用专家模块,显著减少了总参数量,同时保持了模型的大部分容量。预门控路由机制通过在推理时只加载必要的专家模块,实现了内存高效的专家加载和更快的推理。这两种机制的结合使得Megrez2能够在保持模型性能的同时,显著降低模型大小和计算复杂度。

关键设计:Megrez2-Preview模型使用7.5B存储参数,但只激活3B参数。模型在包含5万亿个token的语料库上进行了预训练,并通过监督微调和具有可验证奖励的强化学习进一步增强。预门控路由的具体实现细节(例如门控函数的选择、专家选择策略等)以及跨层专家共享的共享比例是影响模型性能的关键设计参数。

🖼️ 关键图片

📊 实验亮点

Megrez2-Preview模型在多种任务上表现出与更大模型相当甚至更优的性能。例如,在语言理解、指令跟随、数学推理和代码生成等任务上,Megrez2-Preview的性能优于或与参数量更大的模型相媲美。该模型仅激活30亿参数并存储75亿参数,证明了Megrez2架构在精度、效率和可部署性之间实现平衡的有效性。

🎯 应用场景

Megrez2架构适用于各种资源受限的应用场景,例如移动设备上的自然语言处理、边缘计算设备上的智能助手、以及嵌入式系统中的语音识别等。该架构的轻量级和高性能特性使其能够在这些场景中实现高效的模型部署和推理,从而为用户提供更好的体验。未来,Megrez2有望推动人工智能技术在更多资源受限场景中的应用。

📄 摘要(原文)

We present Megrez2, a novel lightweight and high-performance language model architecture optimized for device native deployment. Megrez2 introduces a novel cross-layer expert sharing mechanism, which significantly reduces total parameter count by reusing expert modules across adjacent transformer layers while maintaining most of the model's capacity. It also incorporates pre-gated routing, enabling memory-efficient expert loading and faster inference. As the first instantiation of the Megrez2 architecture, we introduce the Megrez2-Preview model, which is pre-trained on a 5-trillion-token corpus and further enhanced through supervised fine-tuning and reinforcement learning with verifiable rewards. With only 3B activated and 7.5B stored parameters, Megrez2-Preview demonstrates competitive or superior performance compared to larger models on a wide range of tasks, including language understanding, instruction following, mathematical reasoning, and code generation. These results highlight the effectiveness of the Megrez2 architecture to achieve a balance between accuracy, efficiency, and deployability, making it a strong candidate for real-world, resource-constrained applications.