Deep Researcher with Test-Time Diffusion

作者: Rujun Han, Yanfei Chen, Zoey CuiZhu, Lesly Miculicich, Guan Sun, Yuanjun Bi, Weiming Wen, Hui Wan, Chunfeng Wen, Solène Maître, George Lee, Vishy Tirumalashetty, Emily Xue, Zizhao Zhang, Salem Haykal, Burak Gokturk, Tomas Pfister, Chen-Yu Lee

分类: cs.CL

发布日期: 2025-07-21

💡 一句话要点

提出Test-Time Diffusion Deep Researcher (TTD-DR),解决LLM在生成复杂研究报告时性能瓶颈问题。

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 深度研究智能体 大型语言模型 扩散模型 研究报告生成 迭代优化 信息检索 自进化算法

📋 核心要点

- 现有基于LLM的深度研究智能体在生成复杂研究报告时,由于缺乏迭代优化机制,性能容易达到瓶颈。

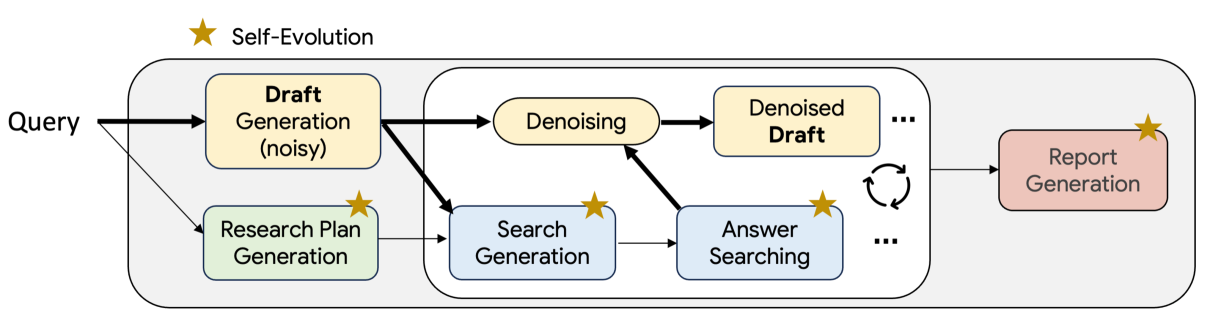

- TTD-DR将研究报告生成视为一个扩散过程,通过迭代的“去噪”和检索外部信息来逐步完善报告草案。

- 实验表明,TTD-DR在需要密集搜索和多跳推理的基准测试中显著优于现有方法,达到state-of-the-art水平。

📝 摘要(中文)

深度研究智能体(Deep research agents),由大型语言模型(LLMs)驱动,正在迅速发展;然而,当使用通用的测试时缩放算法生成复杂的长篇研究报告时,它们的性能常常达到瓶颈。受到人类研究迭代性质的启发,人类研究涉及搜索、推理和修订的循环,我们提出了测试时扩散深度研究者(TTD-DR)。这个新颖的框架将研究报告的生成概念化为一个扩散过程。TTD-DR以初步草案启动这个过程,该草案是一个可更新的骨架,作为不断发展的基础来指导研究方向。然后,通过“去噪”过程迭代地改进草案,该过程由检索机制动态地告知,该检索机制在每个步骤中都包含外部信息。通过应用于智能体工作流程的每个组件的自进化算法进一步增强了核心过程,从而确保为扩散过程生成高质量的上下文。这种以草案为中心的设计使报告编写过程更加及时和连贯,同时减少了迭代搜索过程中的信息丢失。我们证明了我们的TTD-DR在需要密集搜索和多跳推理的各种基准测试中取得了最先进的结果,显著优于现有的深度研究智能体。

🔬 方法详解

问题定义:论文旨在解决大型语言模型(LLMs)在生成复杂、长篇研究报告时遇到的性能瓶颈问题。现有的深度研究智能体在测试时使用通用的缩放算法,缺乏迭代优化和信息整合机制,导致生成报告的质量受限,无法充分利用外部信息进行深度推理和分析。

核心思路:论文的核心思路是将研究报告的生成过程类比为扩散过程,通过迭代地“去噪”和完善草案来逐步生成高质量的报告。这种方法模拟了人类研究的迭代性质,即通过搜索、推理和修订的循环来不断改进研究成果。核心在于利用草案作为研究方向的指导,并通过检索外部信息来动态地更新和完善草案。

技术框架:TTD-DR的整体框架包含以下几个主要模块:1) 初步草案生成:生成报告的初始骨架,作为后续迭代的基础。2) 迭代去噪:通过扩散过程逐步完善草案,每次迭代都基于检索到的外部信息进行更新。3) 检索机制:在每次迭代中,检索相关的外部信息,为去噪过程提供上下文。4) 自进化算法:应用于智能体工作流程的每个组件,确保生成高质量的上下文,从而提升扩散过程的效果。

关键创新:该方法最重要的创新点在于将扩散模型引入到研究报告生成任务中,并以草案为中心进行迭代优化。与传统的单次生成方法相比,TTD-DR能够更好地整合外部信息,进行深度推理和分析,从而生成更全面、更准确的研究报告。此外,自进化算法的引入进一步提升了智能体的工作效率和生成质量。

关键设计:论文中关于关键设计的具体细节描述有限,例如扩散模型的具体实现方式(例如,噪声schedule,采样策略),检索机制的实现细节(例如,使用何种索引结构,如何选择检索结果),以及自进化算法的具体实现方式(例如,使用何种强化学习算法,如何定义奖励函数)等。这些细节需要参考论文原文或后续研究才能进一步了解。目前已知的是,该方法强调了草案的重要性,并利用检索到的外部信息动态地指导扩散过程。

🖼️ 关键图片

📊 实验亮点

TTD-DR在需要密集搜索和多跳推理的多个基准测试中取得了state-of-the-art的结果,显著优于现有的深度研究智能体。具体的性能数据和提升幅度需要在论文原文中查找。该方法证明了将扩散模型应用于研究报告生成任务的有效性,并为未来的研究提供了新的方向。

🎯 应用场景

该研究成果可应用于自动化科研、智能报告生成、辅助决策等领域。例如,可以帮助研究人员快速生成初步的研究报告,节省时间和精力;也可以用于生成特定领域的分析报告,为决策者提供参考;还可以应用于教育领域,辅助学生进行研究和写作。

📄 摘要(原文)

Deep research agents, powered by Large Language Models (LLMs), are rapidly advancing; yet, their performance often plateaus when generating complex, long-form research reports using generic test-time scaling algorithms. Drawing inspiration from the iterative nature of human research, which involves cycles of searching, reasoning, and revision, we propose the Test-Time Diffusion Deep Researcher (TTD-DR). This novel framework conceptualizes research report generation as a diffusion process. TTD-DR initiates this process with a preliminary draft, an updatable skeleton that serves as an evolving foundation to guide the research direction. The draft is then iteratively refined through a "denoising" process, which is dynamically informed by a retrieval mechanism that incorporates external information at each step. The core process is further enhanced by a self-evolutionary algorithm applied to each component of the agentic workflow, ensuring the generation of high-quality context for the diffusion process. This draft-centric design makes the report writing process more timely and coherent while reducing information loss during the iterative search process. We demonstrate that our TTD-DR achieves state-of-the-art results on a wide array of benchmarks that require intensive search and multi-hop reasoning, significantly outperforming existing deep research agents.