Reservoir Computing as a Language Model

作者: Felix Köster, Atsushi Uchida

分类: cs.CL

发布日期: 2025-07-21 (更新: 2026-01-09)

备注: 8 pages, 5 figures, 1 table Code available at: https://github.com/fekoester/Shakespeare_Res and https://github.com/fekoester/LAERC

💡 一句话要点

提出水库计算作为语言模型以解决能耗与速度瓶颈

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 水库计算 语言模型 能效 变换器 自然语言处理 字符级建模 注意力机制

📋 核心要点

- 现有的大型语言模型在能耗和处理速度上存在显著瓶颈,限制了其进一步的应用和普及。

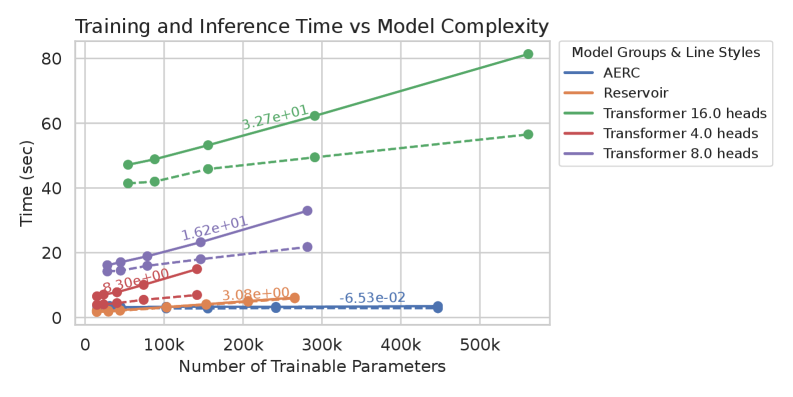

- 本文提出通过水库计算方法进行自然语言处理,以实现更快和更节能的模型设计。

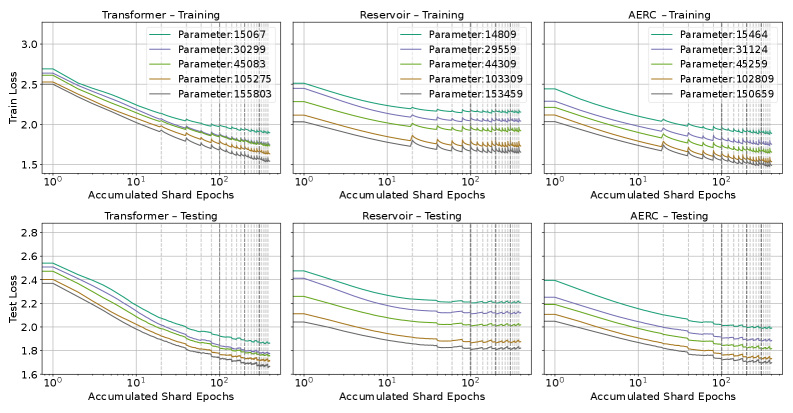

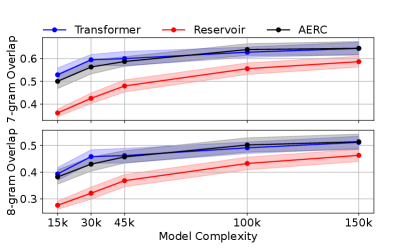

- 实验结果显示,变换器在预测质量上优于水库计算,但后者在训练和推理速度上具有明显优势。

📝 摘要(中文)

大型语言模型(LLM)因其在处理大量数据和生成类人文本方面的卓越表现而备受关注。然而,它们的高能耗和慢处理速度仍然是提升质量和普及应用的瓶颈。为了解决这一问题,本文探讨了水库计算在自然文本处理中的表现,可能实现快速且节能的硬件实现。我们比较了三种不同的字符级语言建模方法,包括两种水库计算方法和基于变换器的架构,分析了它们的性能、计算成本和预测准确性。研究表明,变换器在预测质量上表现优异,而水库计算则在训练和推理速度上保持高效。

🔬 方法详解

问题定义:本文旨在解决大型语言模型在能耗和处理速度上的瓶颈,探讨水库计算在自然语言处理中的应用潜力。

核心思路:通过比较传统水库计算和增强注意力机制的水库计算,评估其在字符级语言建模中的表现,以实现高效的文本处理。

技术框架:研究包括三种方法:传统水库计算、增强注意力的水库计算和基于变换器的架构,所有模型在相同的训练参数下进行比较。

关键创新:提出了两种水库计算方法,分别是静态线性读出和动态适应输出权重的注意力增强水库,展示了其在速度和能效上的优势。

关键设计:在模型设计中,关键参数设置和损失函数的选择对模型性能影响显著,确保了不同方法的公平比较。实验中,所有模型的可训练参数数量保持一致,以便于评估各自的性能。

🖼️ 关键图片

📊 实验亮点

实验结果表明,变换器在预测质量上显著优于水库计算,而后者在训练和推理速度上表现出色,能够在相同参数条件下实现更快的处理速度,展示了其在高效文本处理中的潜力。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、实时文本生成和低功耗设备上的智能应用。水库计算的高效性使其在资源受限的环境中尤为重要,未来可能推动更多智能硬件的普及与应用。

📄 摘要(原文)

Large Language Models (LLM) have dominated the science and media landscape duo to their impressive performance on processing large chunks of data and produce human-like levels of text. Nevertheless, their huge energy demand and slow processing are still a bottleneck to further increasing quality while also making the models accessible to everyone. To solve this bottleneck, we will investigate how reservoir computing performs on natural text processing, which could enable fast and energy efficient hardware implementations. Studies investigating the use of reservoir computing as a language model remain sparse. In this paper, we compare three distinct approaches for character-level language modeling, two different \emph{reservoir computing} approaches, where only an output layer is trainable, and the well-known \emph{transformer}-based architectures, which fully learn an attention-based sequence representation. We explore the performance, computational cost and prediction accuracy for both paradigms by equally varying the number of trainable parameters for all models. Using a consistent pipeline for all three approaches, we demonstrate that transformers excel in prediction quality, whereas reservoir computers remain highly efficient reducing the training and inference speed. Furthermore, we investigate two types of reservoir computing: a \emph{traditional reservoir} with a static linear readout, and an \emph{attention-enhanced reservoir} that dynamically adapts its output weights via an attention mechanism. Our findings underline how these paradigms scale and offer guidelines to balance resource constraints with performance.