Large Language Models' Internal Perception of Symbolic Music

作者: Andrew Shin, Kunitake Kaneko

分类: cs.CL, cs.AI, cs.LG, cs.SD, eess.AS

发布日期: 2025-07-17

💡 一句话要点

探索大语言模型对符号音乐的内在感知能力

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 符号音乐 音乐生成 音乐理解 MIDI 文本提示 神经网络 流派分类

📋 核心要点

- 现有方法难以有效利用大语言模型对音乐结构的潜在理解能力,缺乏对其隐式音乐知识的深入挖掘。

- 本文提出一种方法,通过文本提示生成音乐数据,并以此训练音乐任务模型,从而间接评估LLM的音乐理解能力。

- 实验结果表明,LLM在没有显式音乐训练的情况下,能够推断出基本的音乐结构和时间关系,但仍存在局限性。

📝 摘要(中文)

大型语言模型(LLM)擅长建模自然语言中的字符串关系,并在代码或数学等其他符号领域展现出潜力。然而,它们对符号音乐的隐式建模程度仍未得到充分探索。本文通过从描述流派和风格组合的文本提示生成符号音乐数据,并评估其在识别和生成任务中的效用,来研究LLM如何表示音乐概念。我们生成了一个LLM生成的MIDI文件数据集,而无需依赖显式的音乐训练。然后,我们完全基于此LLM生成的MIDI数据集训练神经网络,并执行流派和风格分类以及旋律补全,将它们的性能与已建立的模型进行基准测试。我们的结果表明,LLM可以从文本中推断出基本的音乐结构和时间关系,突出了它们隐式编码音乐模式的潜力以及由于缺乏显式音乐上下文而造成的局限性,从而揭示了它们在符号音乐生成方面的能力。

🔬 方法详解

问题定义:论文旨在研究大型语言模型(LLM)在多大程度上能够理解和表示符号音乐,并探索其在音乐生成方面的潜力。现有方法主要依赖于显式的音乐训练数据,而忽略了LLM可能已经具备的从文本中学习到的隐式音乐知识。因此,如何有效利用LLM的文本理解能力来辅助音乐生成是一个关键问题。

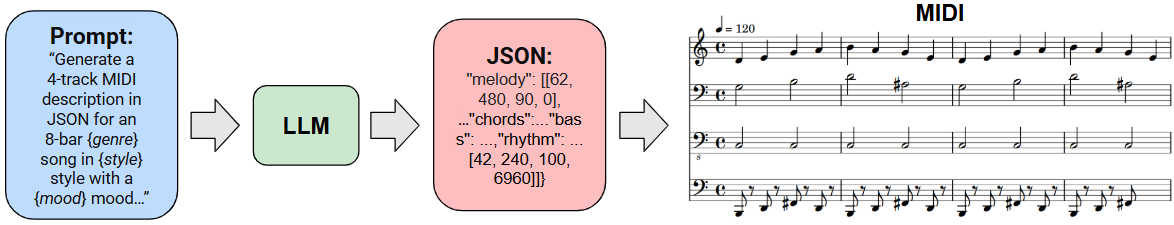

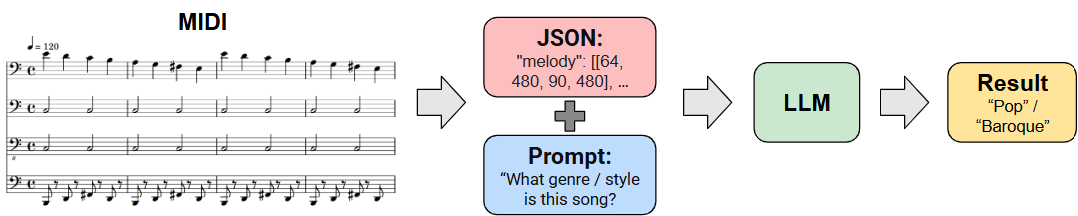

核心思路:论文的核心思路是利用LLM的文本生成能力,通过文本提示(例如,描述音乐流派和风格)生成MIDI格式的音乐数据。然后,使用这些LLM生成的音乐数据来训练专门的音乐任务模型(例如,流派分类器和旋律补全模型)。通过评估这些音乐任务模型的性能,间接评估LLM对音乐的理解程度。

技术框架:整体框架包含两个主要阶段:1) 使用LLM生成MIDI数据集。给定文本提示(例如,“爵士钢琴曲”),LLM生成相应的MIDI文件。重复此过程以创建包含各种流派和风格的MIDI数据集。2) 使用LLM生成的数据训练音乐任务模型。使用第一阶段生成的MIDI数据集训练神经网络,用于流派和风格分类以及旋律补全任务。

关键创新:该论文的关键创新在于提出了一种间接评估LLM音乐理解能力的方法,即不直接分析LLM的内部表示,而是通过LLM生成的数据来训练下游任务模型,并根据下游任务模型的性能来推断LLM的音乐理解能力。这种方法避免了直接访问和解释LLM内部状态的复杂性。

关键设计:论文的关键设计包括:1) 使用文本提示控制LLM生成的音乐数据的多样性,确保数据集包含各种流派和风格。2) 选择流派和风格分类以及旋律补全作为下游任务,因为这些任务能够反映LLM对音乐结构和时间关系的理解。3) 将使用LLM生成的数据训练的模型与使用传统音乐数据集训练的模型进行比较,以评估LLM生成数据的质量。

🖼️ 关键图片

📊 实验亮点

实验结果表明,使用LLM生成的MIDI数据训练的神经网络在流派和风格分类以及旋律补全任务上取得了有竞争力的性能,证明了LLM能够从文本中推断出基本的音乐结构和时间关系。虽然性能不如使用传统音乐数据集训练的模型,但考虑到LLM没有接受显式的音乐训练,这一结果仍然令人鼓舞。

🎯 应用场景

该研究成果可应用于音乐生成、音乐教育和音乐信息检索等领域。例如,可以利用LLM生成具有特定风格和流派的音乐作品,辅助音乐创作;可以利用LLM生成的数据训练音乐教育工具,帮助学生学习音乐理论和创作技巧;可以利用LLM的音乐理解能力改进音乐推荐系统和音乐搜索引擎。

📄 摘要(原文)

Large language models (LLMs) excel at modeling relationships between strings in natural language and have shown promise in extending to other symbolic domains like coding or mathematics. However, the extent to which they implicitly model symbolic music remains underexplored. This paper investigates how LLMs represent musical concepts by generating symbolic music data from textual prompts describing combinations of genres and styles, and evaluating their utility through recognition and generation tasks. We produce a dataset of LLM-generated MIDI files without relying on explicit musical training. We then train neural networks entirely on this LLM-generated MIDI dataset and perform genre and style classification as well as melody completion, benchmarking their performance against established models. Our results demonstrate that LLMs can infer rudimentary musical structures and temporal relationships from text, highlighting both their potential to implicitly encode musical patterns and their limitations due to a lack of explicit musical context, shedding light on their generative capabilities for symbolic music.