Value-Based Large Language Model Agent Simulation for Mutual Evaluation of Trust and Interpersonal Closeness

作者: Yuki Sakamoto, Takahisa Uchida, Hiroshi Ishiguro

分类: cs.CL, cs.MA

发布日期: 2025-07-16 (更新: 2025-10-20)

期刊: Scientific Reports volume 15, Article number: 41653 (2025)

DOI: 10.1038/s41598-025-25531-1

💡 一句话要点

基于价值的大语言模型智能体模拟,用于互评估信任和人际亲密度

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大语言模型 智能体模拟 价值观相似性 信任关系 人际亲密度

📋 核心要点

- 现有研究缺乏对LLM智能体社会中价值观相似性如何影响信任和人际关系建立的深入探索。

- 本研究通过构建具有特定价值观的LLM智能体,模拟它们之间的互动,并分析价值观相似性与信任、亲密度之间的关系。

- 实验结果表明,价值观相似性高的LLM智能体对,在对话后表现出更高的相互信任和人际亲密度,验证了社会科学理论。

📝 摘要(中文)

大型语言模型(LLMs)已成为强大的工具,能够利用具有特定特征的类人智能体来模拟复杂的社会现象。在人类社会中,价值观相似性对于建立信任和亲密关系至关重要;然而,这种原则是否适用于由LLM智能体组成的人工社会仍有待探索。因此,本研究通过两个实验,调查了价值观相似性对LLM智能体之间关系建立的影响。首先,在一个初步实验中,我们评估了LLM中价值观的可控性,以确定控制价值观的最有效模型和提示设计。随后,在主要实验中,我们生成了具有特定价值观的LLM智能体对,并分析了他们在对话后对彼此的信任和人际亲密度的互评估。实验以英语和日语进行,以调查语言依赖性。结果证实,价值观相似性较高的智能体对表现出更高的相互信任和人际亲密度。我们的研究结果表明,LLM智能体模拟可以作为社会科学理论的有效试验平台,有助于阐明价值观影响关系建立的机制,并为激发社会科学的新理论和见解奠定基础。

🔬 方法详解

问题定义:论文旨在研究在人工社会中,LLM智能体之间的价值观相似性如何影响彼此的信任和人际亲密度。现有方法缺乏对LLM智能体价值观的有效控制,以及对价值观相似性在人工社会关系构建中作用的系统性研究。

核心思路:论文的核心思路是构建一个基于价值的LLM智能体模拟环境,通过控制智能体的价值观,观察不同价值观相似度的智能体在互动后的信任和亲密度变化。通过模拟对话和互评估,量化价值观相似性对关系建立的影响。

技术框架:整体框架包含两个主要实验阶段:1) 价值观可控性评估:选择合适的LLM模型和提示工程方法,以确保能够有效控制智能体的价值观。2) 主实验:生成具有特定价值观的LLM智能体对,进行对话模拟,并收集智能体对彼此的信任和人际亲密度评估数据。实验同时采用英语和日语进行,以考察语言依赖性。

关键创新:该研究的关键创新在于将LLM智能体模拟应用于社会科学研究,验证了价值观相似性在人工社会关系构建中的作用。通过可控的LLM智能体,为社会科学理论提供了一个新的实验平台。

关键设计:在价值观可控性评估中,论文探索了不同的LLM模型(具体模型未知)和提示工程方法(具体方法未知),以确定最佳的价值观控制方案。在主实验中,智能体对进行多轮对话(具体轮数未知),并通过问卷调查(具体问题未知)的方式评估彼此的信任和人际亲密度。实验数据采用统计分析方法(具体方法未知)进行处理,以验证价值观相似性与信任、亲密度之间的关系。

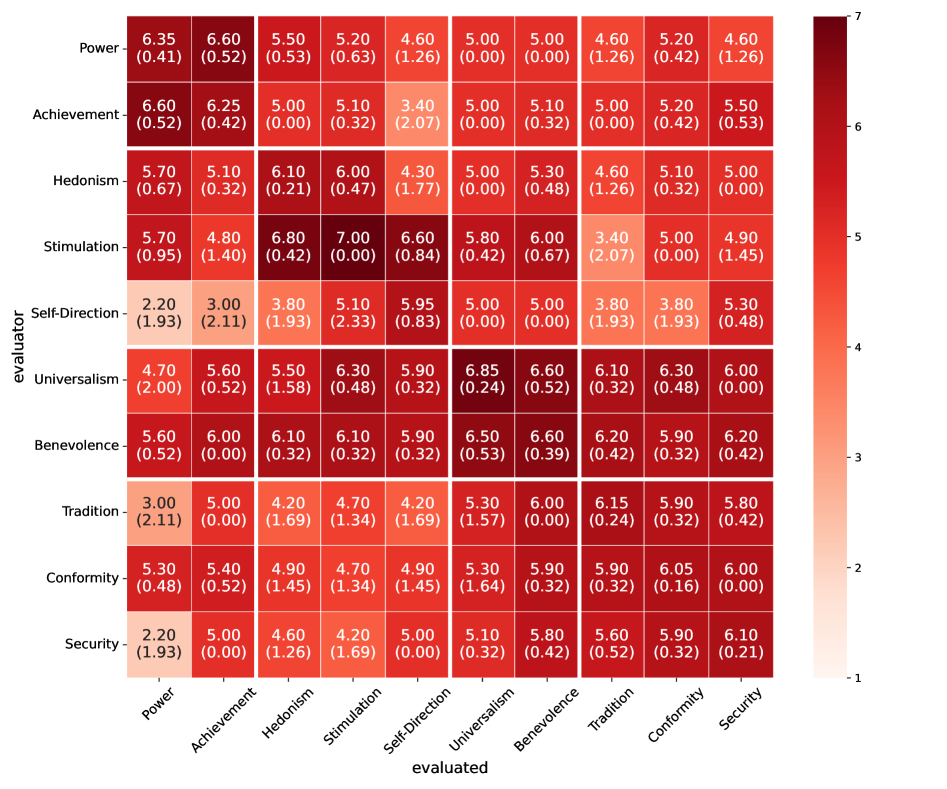

🖼️ 关键图片

📊 实验亮点

实验结果表明,价值观相似性与LLM智能体之间的相互信任和人际亲密度呈正相关。具体而言,价值观相似性高的智能体对,在对话后表现出显著更高的信任度和亲密度(具体提升幅度未知)。该结果在英语和日语两种语言环境下均得到验证,表明该结论具有一定的普适性。

🎯 应用场景

该研究成果可应用于社交机器人设计、人机交互优化、以及理解在线社区的形成机制。通过模拟不同价值观人群的互动,可以预测和改善群体关系,促进社会和谐。此外,该方法还可以用于评估AI系统的价值观对用户信任度的影响,从而开发更值得信赖的AI系统。

📄 摘要(原文)

Large language models (LLMs) have emerged as powerful tools for simulating complex social phenomena using human-like agents with specific traits. In human societies, value similarity is important for building trust and close relationships; however, it remains unexplored whether this principle holds true in artificial societies comprising LLM agents. Therefore, this study investigates the influence of value similarity on relationship-building among LLM agents through two experiments. First, in a preliminary experiment, we evaluated the controllability of values in LLMs to identify the most effective model and prompt design for controlling the values. Subsequently, in the main experiment, we generated pairs of LLM agents imbued with specific values and analyzed their mutual evaluations of trust and interpersonal closeness following a dialogue. The experiments were conducted in English and Japanese to investigate language dependence. The results confirmed that pairs of agents with higher value similarity exhibited greater mutual trust and interpersonal closeness. Our findings demonstrate that the LLM agent simulation serves as a valid testbed for social science theories, contributes to elucidating the mechanisms by which values influence relationship building, and provides a foundation for inspiring new theories and insights into the social sciences.