What is the Best Process Model Representation? A Comparative Analysis for Process Modeling with Large Language Models

作者: Alexis Brissard, Frédéric Cuppens, Amal Zouaq

分类: cs.CL

发布日期: 2025-07-15

备注: 12 pages, 7 figures, to be published in AI4BPM 2025 Proceedings

💡 一句话要点

对比分析不同流程模型表示,为大语言模型流程建模任务选择最优方案

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 流程建模 大型语言模型 流程模型表示 数据集构建 性能评估

📋 核心要点

- 现有流程模型表示(PMRs)在结构和复杂性上差异大,缺乏系统性的比较研究,阻碍了大语言模型在流程建模中的应用。

- 该研究构建了包含多种PMRs的流程建模数据集,并从LLM适用性和模型生成性能两个维度对不同PMRs进行评估。

- 实验结果表明,Mermaid在LLM流程建模方面表现最佳,而BPMN text在流程元素相似性方面具有最佳的流程模型生成性能。

📝 摘要(中文)

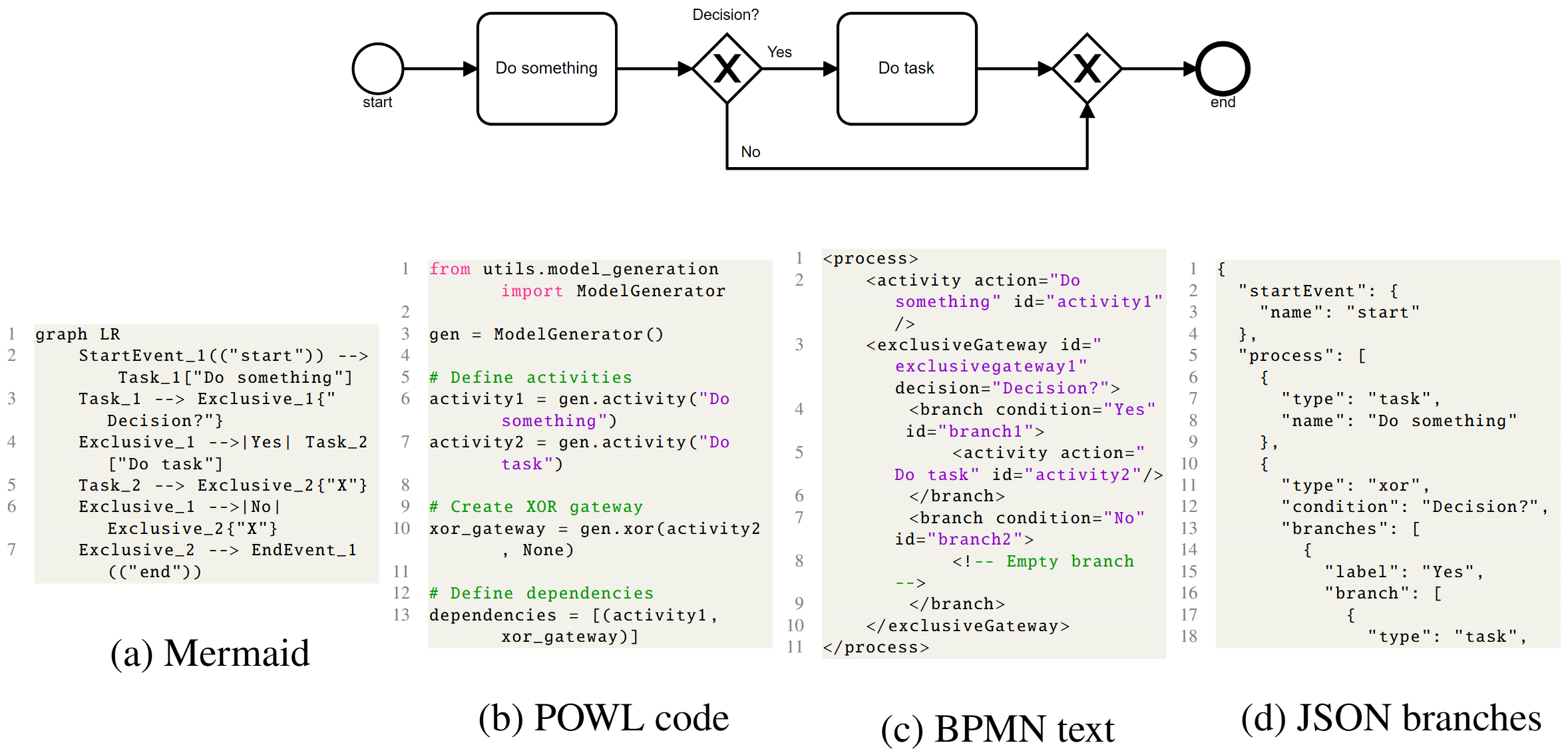

大型语言模型(LLMs)越来越多地应用于流程建模(PMo)任务,例如流程模型生成(PMG)。为了支持这些任务,研究人员引入了各种流程模型表示(PMRs),作为模型抽象或生成目标。然而,这些PMRs在结构、复杂性和可用性方面差异很大,并且从未经过系统地比较。此外,最近的PMG方法依赖于不同的评估策略和生成技术,这使得比较变得困难。本文提出了第一个实证研究,评估了LLM流程建模中多种PMRs。我们引入了PMo数据集,这是一个包含55个流程描述以及九种不同PMRs模型的的新数据集。我们从两个维度评估PMRs:基于LLM的PMo的适用性和PMG的性能。结果表明, extit{Mermaid}在六个PMo标准中获得了最高的总体评分,而 extit{BPMN text}在流程元素相似性方面提供了最佳的PMG结果。

🔬 方法详解

问题定义:论文旨在解决流程建模任务中,如何选择最适合大型语言模型(LLMs)的流程模型表示(PMRs)的问题。现有的PMRs种类繁多,结构各异,缺乏统一的评估标准和比较,导致难以选择合适的PMRs来提升LLMs在流程建模任务中的性能。

核心思路:论文的核心思路是通过构建一个包含多种PMRs的流程建模数据集,并从LLM的适用性和流程模型生成的性能两个维度对不同的PMRs进行评估和比较,从而为LLMs选择最合适的PMRs。

技术框架:该研究主要包含以下几个阶段:1) 构建PMo数据集,该数据集包含55个流程描述以及九种不同的PMRs模型。2) 定义评估指标,从LLM的适用性和流程模型生成的性能两个维度评估不同的PMRs。3) 使用LLMs进行流程模型生成,并根据定义的评估指标对生成的模型进行评估。4) 对比分析不同PMRs的评估结果,从而选择最适合LLMs的PMRs。

关键创新:该研究的主要创新点在于:1) 构建了一个包含多种PMRs的流程建模数据集,为PMRs的评估和比较提供了基础。2) 从LLM的适用性和流程模型生成的性能两个维度对PMRs进行评估,提供了一个全面的评估框架。3) 通过实验对比分析,为LLMs选择最合适的PMRs提供了指导。

关键设计:论文的关键设计包括:1) PMo数据集的构建,需要选择具有代表性的流程描述和PMRs。2) 评估指标的选择,需要能够反映LLM的适用性和流程模型生成的性能。3) LLM的选择和训练,需要选择合适的LLM并进行微调,以提升其在流程建模任务中的性能。具体的参数设置、损失函数、网络结构等技术细节在论文中未详细说明,属于未知信息。

🖼️ 关键图片

📊 实验亮点

该研究通过实验评估了九种不同的流程模型表示(PMRs)在大型语言模型(LLMs)流程建模中的性能。实验结果表明, extit{Mermaid}在六个PMo标准中获得了最高的总体评分,表明其更适合LLM的流程建模任务。 extit{BPMN text}在流程元素相似性方面提供了最佳的PMG结果,表明其在流程模型生成方面具有优势。这些结果为选择合适的PMRs提供了重要的参考依据。

🎯 应用场景

该研究成果可应用于自动化流程建模、业务流程优化、软件工程等领域。通过选择合适的流程模型表示,可以提升大语言模型在流程建模任务中的性能,从而实现更高效、更准确的流程自动化和优化,降低人工成本,提高生产效率。未来,该研究可以进一步扩展到更复杂的流程建模场景,并探索新的流程模型表示方法。

📄 摘要(原文)

Large Language Models (LLMs) are increasingly applied for Process Modeling (PMo) tasks such as Process Model Generation (PMG). To support these tasks, researchers have introduced a variety of Process Model Representations (PMRs) that serve as model abstractions or generation targets. However, these PMRs differ widely in structure, complexity, and usability, and have never been systematically compared. Moreover, recent PMG approaches rely on distinct evaluation strategies and generation techniques, making comparison difficult. This paper presents the first empirical study that evaluates multiple PMRs in the context of PMo with LLMs. We introduce the PMo Dataset, a new dataset containing 55 process descriptions paired with models in nine different PMRs. We evaluate PMRs along two dimensions: suitability for LLM-based PMo and performance on PMG. \textit{Mermaid} achieves the highest overall score across six PMo criteria, whereas \textit{BPMN text} delivers the best PMG results in terms of process element similarity.