Teach Me Sign: Stepwise Prompting LLM for Sign Language Production

作者: Zhaoyi An, Rei Kawakami

分类: cs.CL, cs.CV, cs.MM

发布日期: 2025-07-15

备注: Accepted by IEEE ICIP 2025

💡 一句话要点

提出TEAM-Sign:利用逐步提示的大语言模型进行手语生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 手语生成 大型语言模型 逐步提示 自然语言处理 微调 多模态学习

📋 核心要点

- 现有手语生成方法难以有效利用大型语言模型的知识和推理能力,无法很好地对齐口语和手语的差异。

- TEAM-Sign通过微调LLM,并采用逐步提示策略,使LLM能够学习和生成手语,从而弥合口语和手语的差距。

- 在How2Sign和Phoenix14T数据集上的实验表明,该方法能够有效利用LLM的知识和推理能力,提升手语生成效果。

📝 摘要(中文)

大型语言模型(LLM)凭借其强大的推理能力和丰富的知识,给人工智能的许多任务带来了革命,但由于手语的复杂性和独特的规则,它们对手语生成的影响仍然有限。本文提出了TEAch Me Sign(TEAM-Sign),将手语视为另一种自然语言。通过微调LLM,使其能够学习文本和手语之间的对应关系,并促进生成。考虑到手语和口语之间的差异,我们采用逐步提示策略来提取LLM中固有的手语知识,从而支持学习和生成过程。在How2Sign和Phoenix14T数据集上的实验结果表明,我们的方法有效地利用了LLM的手语知识和推理能力,以对齐手语和口语之间不同的分布和语法规则。

🔬 方法详解

问题定义:论文旨在解决手语生成任务中,如何有效利用大型语言模型(LLM)的知识和推理能力,并克服口语和手语之间差异的问题。现有方法难以直接应用LLM,因为手语具有独特的语法规则和表达方式,与口语的分布存在显著差异。这导致LLM在手语生成任务中表现不佳。

核心思路:论文的核心思路是将手语视为另一种自然语言,通过微调LLM,使其能够学习文本和手语之间的对应关系。为了更好地利用LLM中固有的手语知识,并适应手语的特殊性,论文提出了逐步提示策略。该策略通过一系列精心设计的提示,引导LLM逐步理解和生成手语。

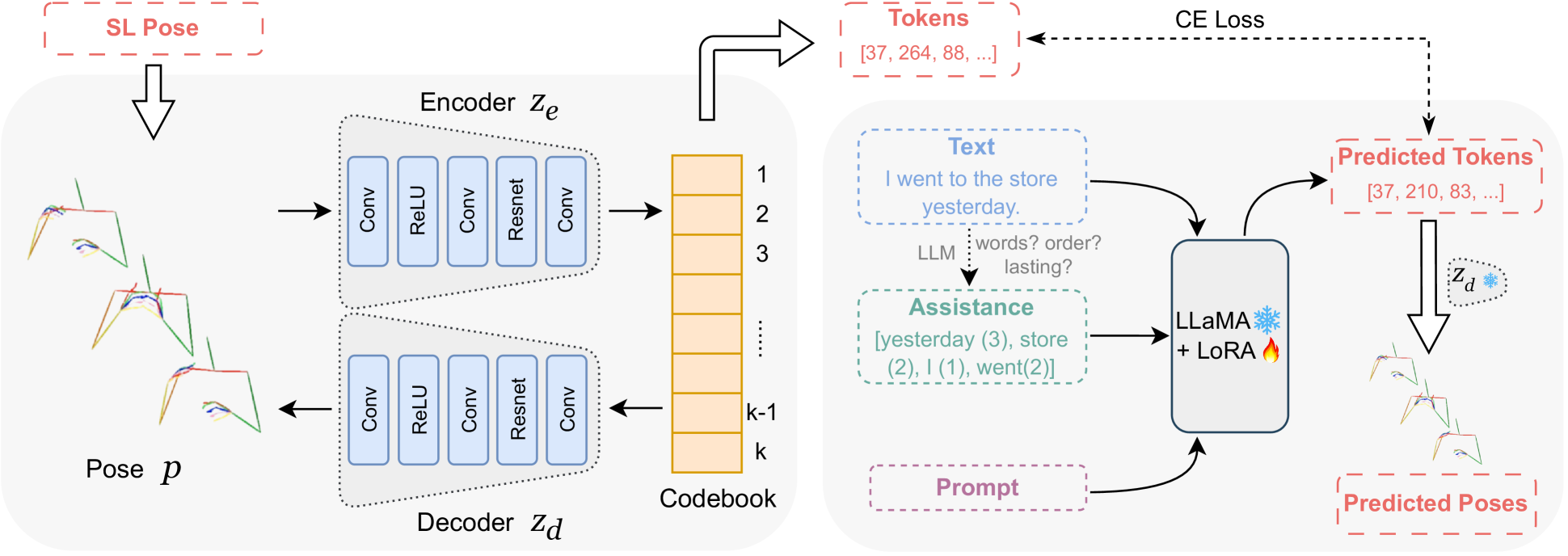

技术框架:TEAM-Sign的整体框架包括以下几个主要阶段:1) LLM微调:使用手语数据集对LLM进行微调,使其初步具备手语生成能力。2) 逐步提示:设计一系列逐步提示,引导LLM逐步理解手语的语法规则和表达方式。这些提示可以包括手语的词汇、语法、语义等信息。3) 手语生成:利用微调后的LLM和逐步提示,生成手语序列。4) 评估:使用标准的手语生成评估指标,评估生成的手语质量。

关键创新:论文最重要的技术创新点在于提出了逐步提示策略。该策略能够有效地提取LLM中固有的手语知识,并引导LLM生成符合手语语法规则的序列。与直接使用LLM生成手语相比,逐步提示策略能够更好地适应手语的特殊性,提高生成质量。

关键设计:逐步提示策略的具体设计是关键。论文可能采用了以下关键设计:1) 提示的粒度:提示的粒度需要适当,既要能够提供足够的信息,又要避免过于冗余。2) 提示的顺序:提示的顺序需要精心设计,以便LLM能够逐步理解手语的复杂性。3) 提示的内容:提示的内容需要涵盖手语的各个方面,包括词汇、语法、语义等。此外,损失函数可能采用交叉熵损失,网络结构则基于预训练的LLM进行微调。

🖼️ 关键图片

📊 实验亮点

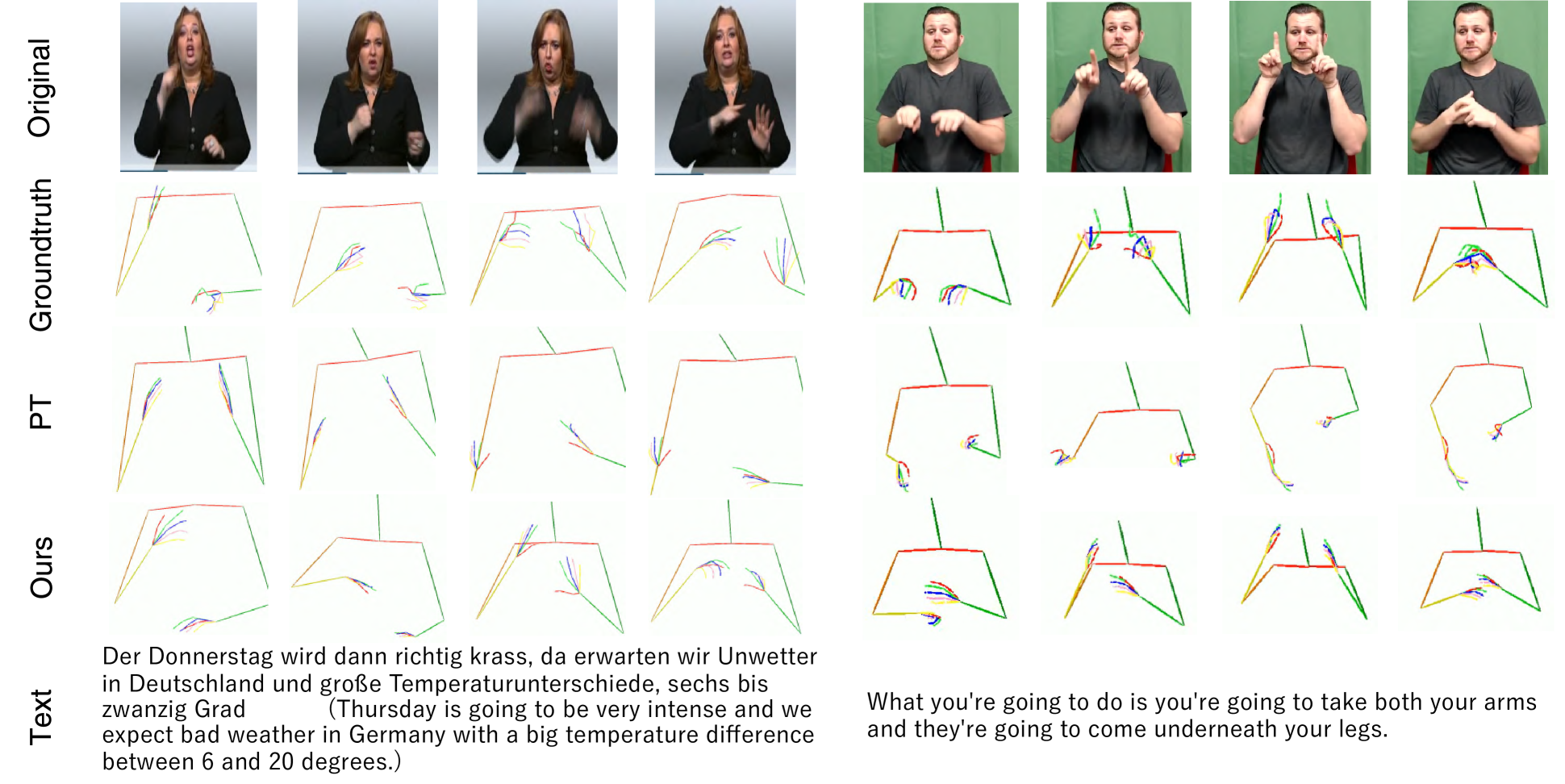

实验结果表明,TEAM-Sign在How2Sign和Phoenix14T数据集上取得了显著的性能提升。具体而言,TEAM-Sign能够有效地利用LLM的知识和推理能力,对齐手语和口语之间不同的分布和语法规则,从而生成更加准确和自然的手语序列。具体的性能数据和对比基线需要在论文中查找。

🎯 应用场景

该研究成果可应用于手语翻译、手语教学、人机交互等领域。例如,可以开发自动手语翻译系统,帮助听障人士与健听人士进行交流。还可以用于手语教学,帮助学习者更好地掌握手语。此外,还可以应用于虚拟现实和增强现实等领域,创建更加自然和便捷的人机交互界面。

📄 摘要(原文)

Large language models, with their strong reasoning ability and rich knowledge, have brought revolution to many tasks of AI, but their impact on sign language generation remains limited due to its complexity and unique rules. In this paper, we propose TEAch Me Sign (TEAM-Sign), treating sign language as another natural language. By fine-tuning an LLM, we enable it to learn the correspondence between text and sign language, and facilitate generation. Considering the differences between sign and spoken language, we employ a stepwise prompting strategy to extract the inherent sign language knowledge within the LLM, thereby supporting the learning and generation process. Experimental results on How2Sign and Phoenix14T datasets demonstrate that our approach effectively leverages both the sign language knowledge and reasoning capabilities of LLM to align the different distribution and grammatical rules between sign and spoken language.