Exploring Design of Multi-Agent LLM Dialogues for Research Ideation

作者: Keisuke Ueda, Wataru Hirota, Takuto Asakura, Takahiro Omi, Kosuke Takahashi, Kosuke Arima, Tatsuya Ishigaki

分类: cs.CL, cs.MA

发布日期: 2025-07-11

备注: 16 pages, 1 figure, appendix. Accepted to SIGDIAL 2025

🔗 代码/项目: GITHUB

💡 一句话要点

探索多智能体LLM对话设计,用于科研创意生成

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 多智能体系统 大型语言模型 科研创意生成 对话系统 创新性 可行性 智能体角色 迭代优化

📋 核心要点

- 现有方法在利用LLM进行科研创意生成时,缺乏对多智能体对话设计的系统性研究,导致生成想法的质量和多样性受限。

- 论文提出通过探索不同智能体角色、数量和对话深度等因素,优化多智能体LLM对话,从而提升科研创意的新颖性和可行性。

- 实验结果表明,扩大智能体规模、加深对话深度以及增加智能体角色异质性,均能有效提升生成创意的多样性和可行性。

📝 摘要(中文)

大型语言模型(LLMs)越来越多地被用于支持科研创意生成等创造性任务。虽然最近的研究表明,LLM之间结构化的对话可以提高生成想法的新颖性和可行性,但这种交互的最佳设计仍然不清楚。本研究对用于科学创意的多智能体LLM对话进行了全面分析。我们比较了智能体角色、智能体数量和对话深度的不同配置,以了解这些因素如何影响生成想法的新颖性和可行性。我们的实验设置包括一个智能体生成想法,另一个智能体批判性地评价这些想法,从而实现迭代改进。结果表明,扩大智能体群体、加深交互深度以及拓宽智能体角色异质性,都能丰富生成想法的多样性。此外,在创意-评论-修订循环中,专门增加评论方的多样性,可以进一步提高最终方案的可行性。我们的研究结果为构建有效的多智能体LLM系统用于科学创意提供了实用的指导。

🔬 方法详解

问题定义:论文旨在解决如何设计多智能体LLM对话系统,以更有效地支持科研创意生成。现有方法缺乏对智能体角色、数量和交互深度等关键因素的系统性研究,导致生成的想法在多样性、新颖性和可行性方面存在不足。

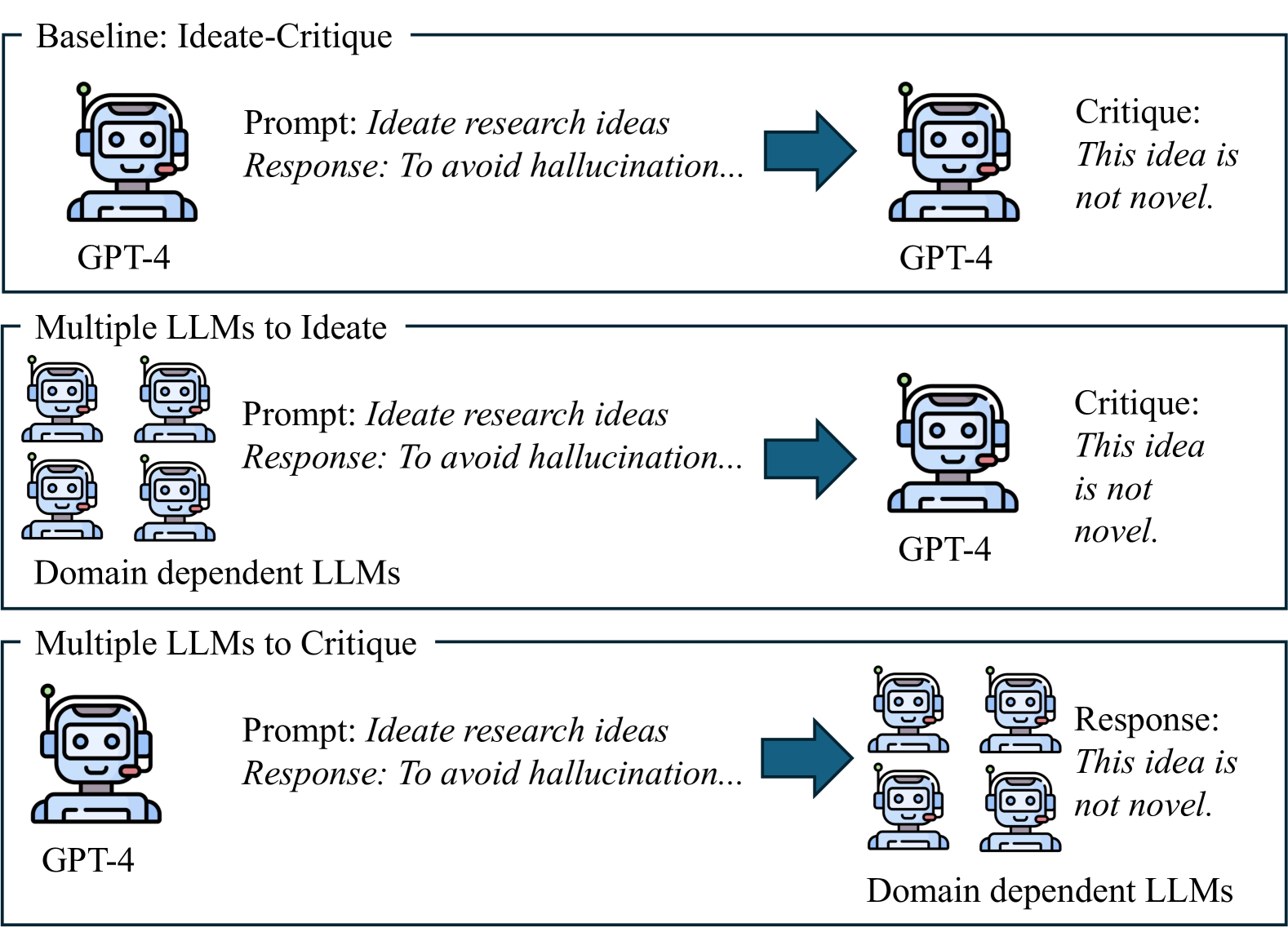

核心思路:核心思路是通过构建一个包含多个智能体的对话系统,模拟科研人员之间的头脑风暴和批判性评估过程。通过调整智能体的角色(例如,创意生成者、评论者)、数量以及对话的迭代深度,探索不同配置对生成创意质量的影响。

技术框架:整体框架是一个迭代的创意-评论-修订循环。首先,一个或多个智能体负责生成初步的科研想法。然后,另一个或多个智能体对这些想法进行批判性评估,指出其潜在的缺陷和不足。最后,基于评论者的反馈,最初的创意生成者对想法进行修订和改进。这个过程可以重复多次,以逐步完善想法。

关键创新:关键创新在于对多智能体LLM对话系统的设计空间进行了系统性的探索,并量化了不同设计选择对生成创意质量的影响。特别地,论文强调了增加评论方智能体多样性的重要性,这有助于提高最终方案的可行性。

关键设计:实验中,研究者使用了不同的LLM作为智能体,并赋予它们不同的角色和背景。对话深度通过设置迭代次数来控制。通过人工评估生成创意的质量(新颖性和可行性),来比较不同配置的效果。具体的技术细节包括:LLM的选择、角色prompt的设计、评估指标的定义等。论文开源了代码,方便其他研究者复现和扩展。

🖼️ 关键图片

📊 实验亮点

实验结果表明,增加智能体数量、加深对话深度以及增加智能体角色异质性,均能有效提升生成创意的多样性。更重要的是,增加评论方智能体的多样性,能够显著提高最终方案的可行性。这些发现为构建高效的科研创意生成系统提供了重要的设计指导。

🎯 应用场景

该研究成果可应用于科研领域的创意生成、项目规划和可行性分析。通过构建多智能体LLM对话系统,可以辅助科研人员快速产生大量新颖且可行的研究思路,提高科研效率和创新能力。此外,该方法也可推广到其他需要创造性思维的领域,如产品设计、市场营销等。

📄 摘要(原文)

Large language models (LLMs) are increasingly used to support creative tasks such as research idea generation. While recent work has shown that structured dialogues between LLMs can improve the novelty and feasibility of generated ideas, the optimal design of such interactions remains unclear. In this study, we conduct a comprehensive analysis of multi-agent LLM dialogues for scientific ideation. We compare different configurations of agent roles, number of agents, and dialogue depth to understand how these factors influence the novelty and feasibility of generated ideas. Our experimental setup includes settings where one agent generates ideas and another critiques them, enabling iterative improvement. Our results show that enlarging the agent cohort, deepening the interaction depth, and broadening agent persona heterogeneity each enrich the diversity of generated ideas. Moreover, specifically increasing critic-side diversity within the ideation-critique-revision loop further boosts the feasibility of the final proposals. Our findings offer practical guidelines for building effective multi-agent LLM systems for scientific ideation. Our code is available at https://github.com/g6000/MultiAgent-Research-Ideator.