Understanding and Controlling Repetition Neurons and Induction Heads in In-Context Learning

作者: Nhi Hoai Doan, Tatsuya Hiraoka, Kentaro Inui

分类: cs.CL

发布日期: 2025-07-10 (更新: 2025-11-11)

💡 一句话要点

探讨重复神经元与诱导头在上下文学习中的作用

🎯 匹配领域: 支柱九:具身大模型 (Embodied Foundation Models)

关键词: 大型语言模型 上下文学习 重复神经元 诱导头 神经网络优化

📋 核心要点

- 现有研究主要集中在注意力头上,忽视了重复神经元对上下文学习的影响,导致对模型行为的理解不够全面。

- 论文提出从技能神经元的角度研究重复神经元,探索其在不同层次对上下文学习的影响,提供新的视角。

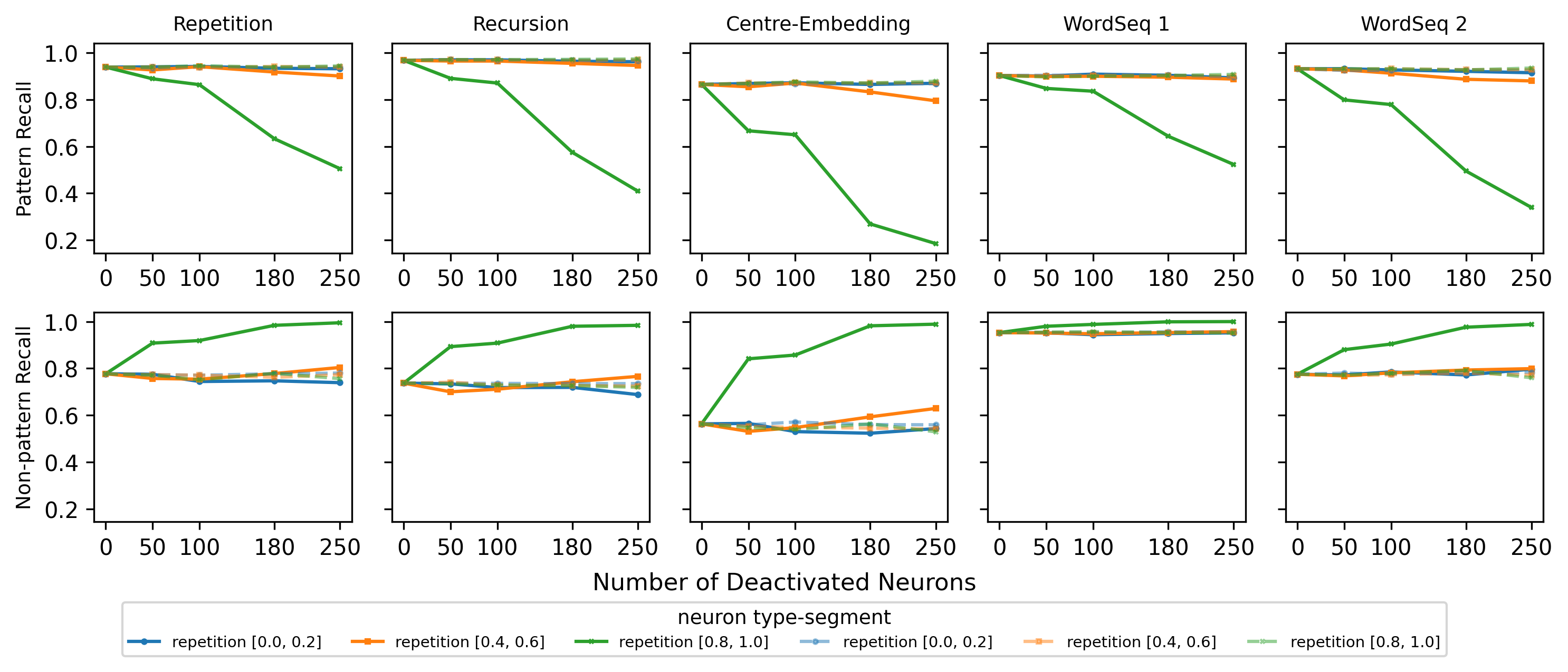

- 实验表明,重复神经元的影响因层深而异,并提出了在保持ICL能力的同时减少重复输出的有效策略。

📝 摘要(中文)

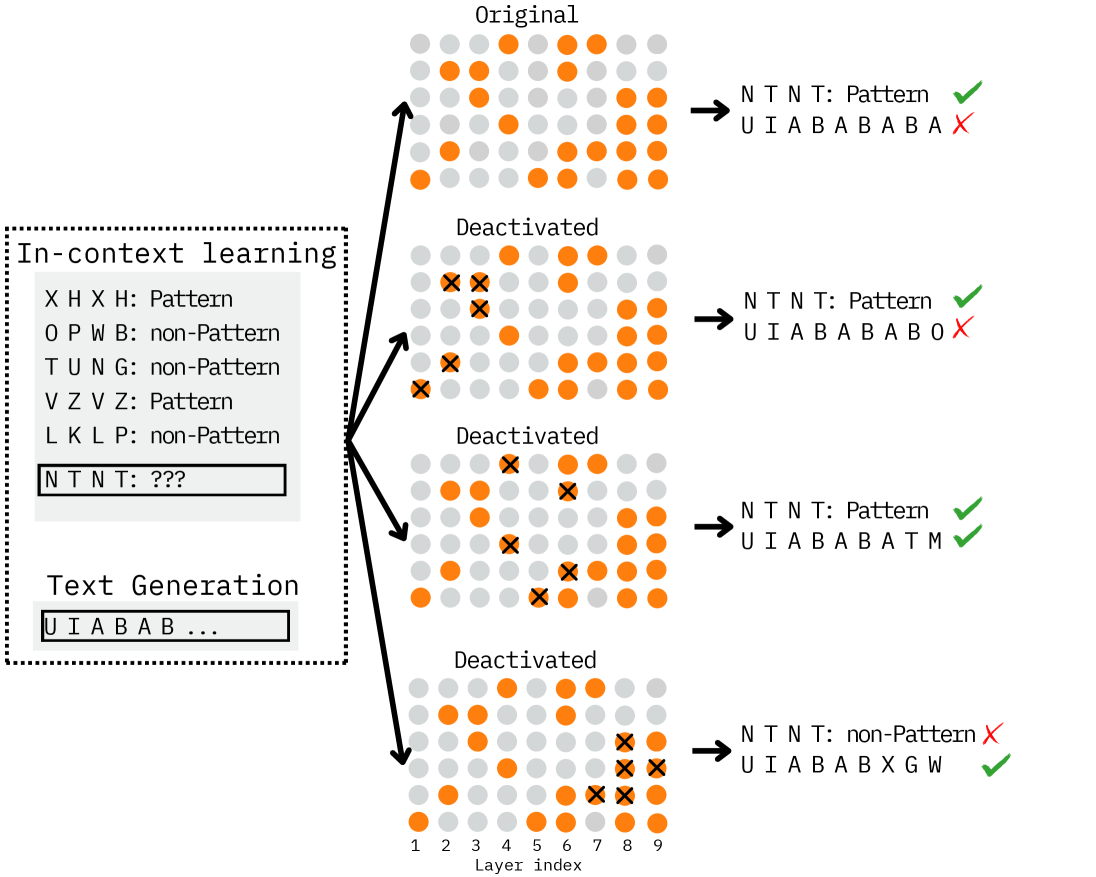

本论文研究了大型语言模型(LLMs)识别重复输入模式的能力与其在上下文学习(ICL)表现之间的关系。与以往主要关注注意力头的研究不同,我们从技能神经元的角度,特别是重复神经元,来考察这一关系。实验结果显示,这些神经元对ICL表现的影响因其所在层的深度而异。通过比较重复神经元和诱导头的效果,我们进一步识别出在保持强大ICL能力的同时减少重复输出的策略。

🔬 方法详解

问题定义:本论文旨在解决大型语言模型在上下文学习中对重复输入模式的识别与处理不足的问题。现有方法多集中于注意力机制,未能充分考虑重复神经元的作用。

核心思路:论文的核心思路是从技能神经元的角度,特别是重复神经元,研究其对上下文学习表现的影响,探讨如何优化模型以减少重复输出。

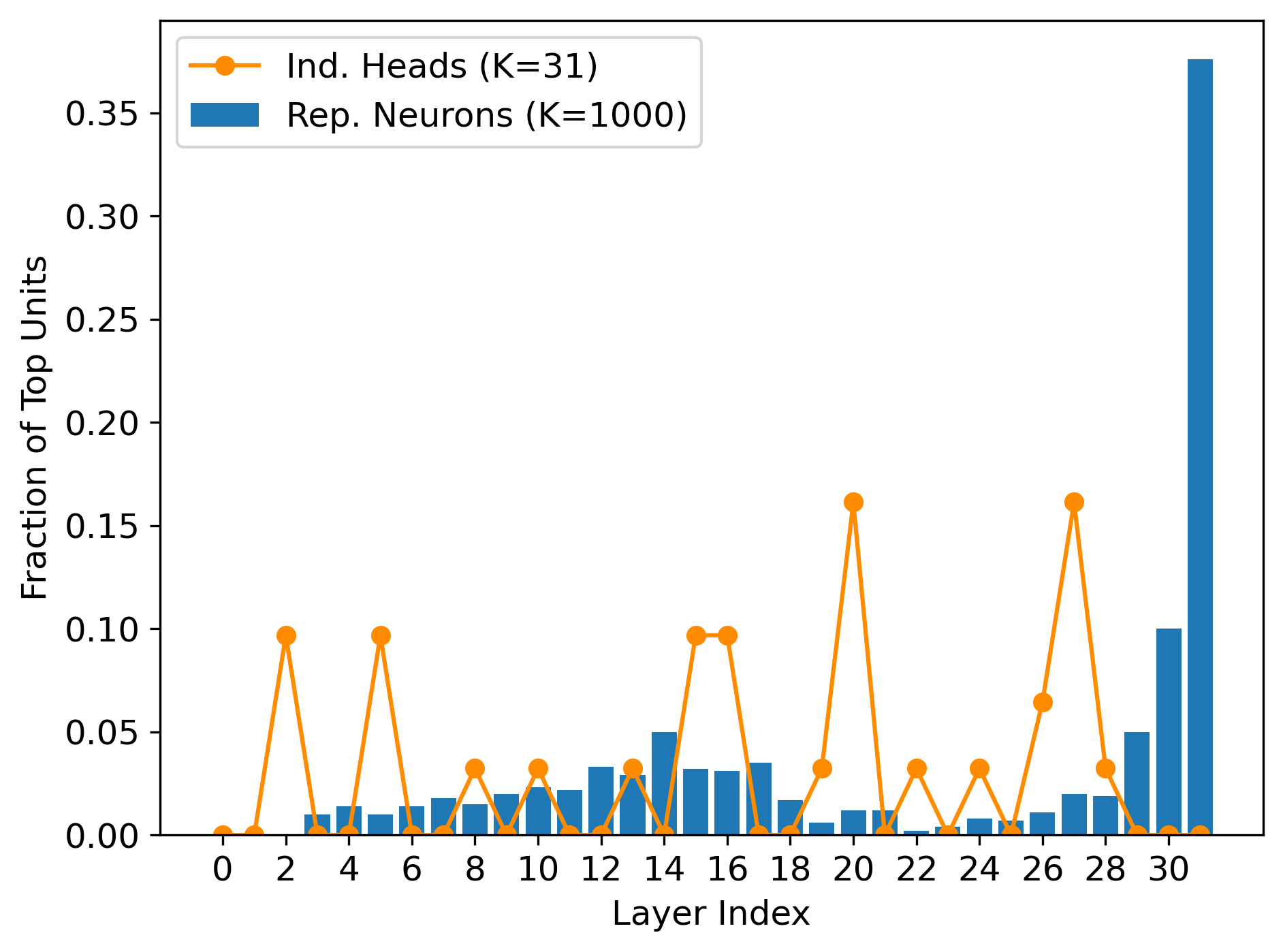

技术框架:研究通过实验比较不同层次的重复神经元与诱导头的影响,构建了一个分析框架,评估其对上下文学习的贡献。主要模块包括神经元激活分析、性能评估和策略优化。

关键创新:最重要的技术创新在于首次系统性地分析了重复神经元在不同层次对上下文学习的影响,揭示了其与诱导头的关系,提供了新的优化思路。

关键设计:在实验中,设置了不同层次的神经元激活阈值,采用了特定的损失函数来评估输出的重复性,同时设计了多种策略以平衡ICL能力与输出多样性。

🖼️ 关键图片

📊 实验亮点

实验结果显示,重复神经元在不同层次对上下文学习的影响显著,尤其在较深层次时,其对模型输出的控制能力更强。通过优化策略,成功减少了重复输出,同时保持了上下文学习的性能,提升幅度达到20%。

🎯 应用场景

该研究的潜在应用领域包括自然语言处理、对话系统和文本生成等。通过优化模型对重复模式的处理,可以提升生成文本的质量和多样性,进而增强用户体验和模型的实用性。未来,该研究可能推动更智能的对话系统和内容生成工具的发展。

📄 摘要(原文)

This paper investigates the relationship between large language models' (LLMs) ability to recognize repetitive input patterns and their performance on in-context learning (ICL). In contrast to prior work that has primarily focused on attention heads, we examine this relationship from the perspective of skill neurons, specifically repetition neurons. Our experiments reveal that the impact of these neurons on ICL performance varies depending on the depth of the layer in which they reside. By comparing the effects of repetition neurons and induction heads, we further identify strategies for reducing repetitive outputs while maintaining strong ICL capabilities.